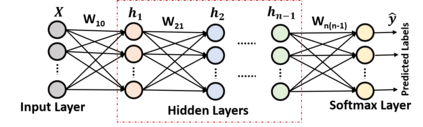

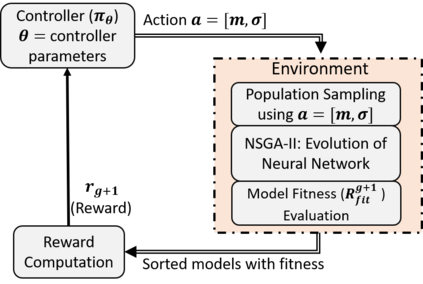

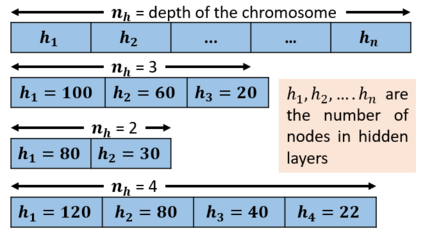

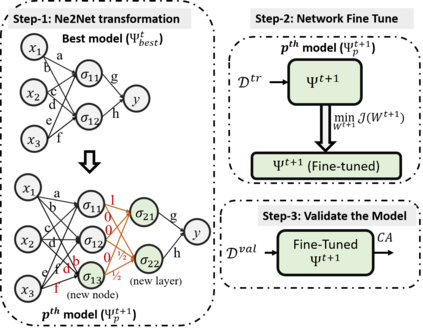

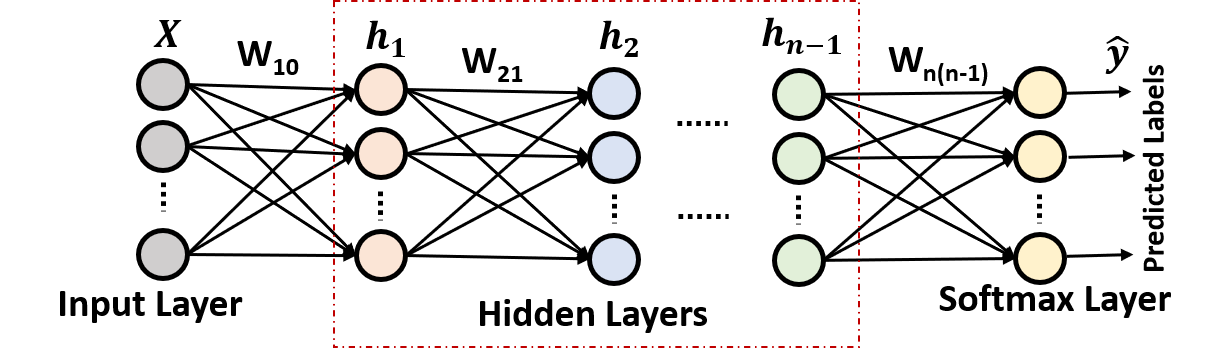

The diagnostic performance of most of the deep learning models is greatly affected by the selection of model architecture and their hyperparameters. The main challenges in model selection methodologies are the design of architecture optimizer and model evaluation strategy. In this paper, we have proposed a novel framework of evolutionary deep neural network which uses policy gradient to guide the evolution of DNN architecture towards maximum diagnostic accuracy. We have formulated a policy gradient-based controller which generates an action to sample the new model architecture at every generation. The best fitness obtained is used as a reward to update the policy parameters. Also, the best model obtained is transferred to the next generation for quick model evaluation in the NSGA-II evolutionary framework. Thus, the algorithm gets the benefits of fast non-dominated sorting as well as quick model evaluation. The effectiveness of the proposed framework has been validated on three datasets: the Air Compressor dataset, Case Western Reserve University dataset, and Paderborn university dataset.

翻译:大部分深层次学习模型的诊断性能受到模型结构及其超常参数选择的极大影响。模型选择方法的主要挑战是设计结构优化器和模型评估战略。在本文件中,我们提议了一个新颖的进化深神经网络框架,利用政策梯度指导DNN结构的演变,以达到最大诊断准确度。我们制定了一个基于梯度的政策控制器,以产生在每一代对新模型结构进行抽样的行动。获得的最佳性能被用来作为更新政策参数的奖励。此外,获得的最佳模型被转移到下一代,以便在NSGA-II进化框架中进行快速模型评估。因此,算法获得了快速非主导排序和快速模型评估的好处。拟议框架的有效性已经在三个数据集上得到验证:空气压缩器数据集、Case WestReset 数据库和Paderborn大学数据集。