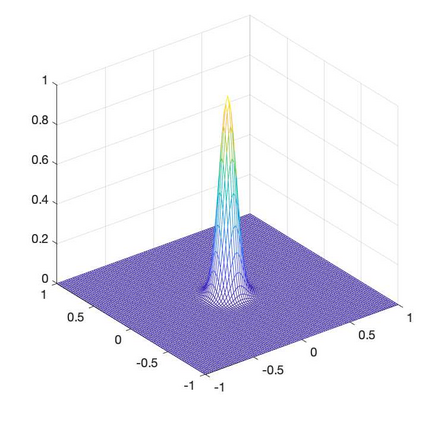

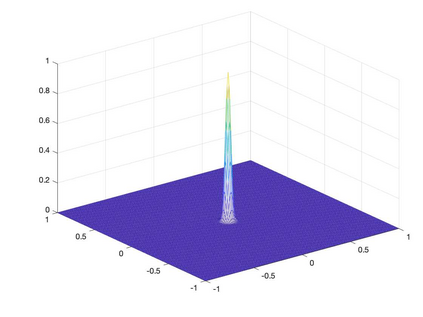

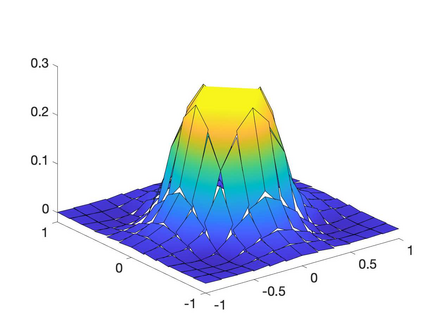

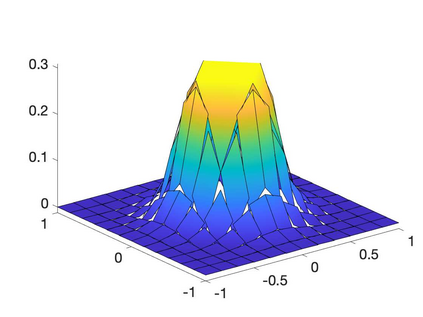

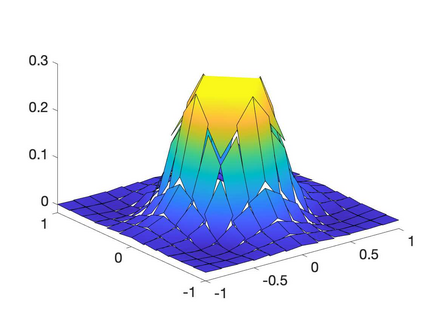

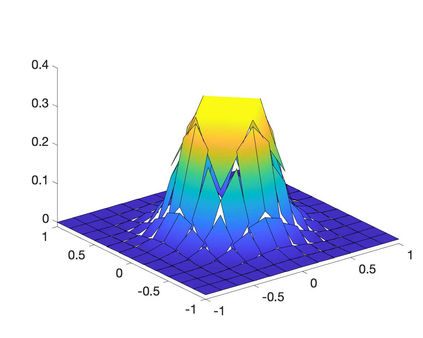

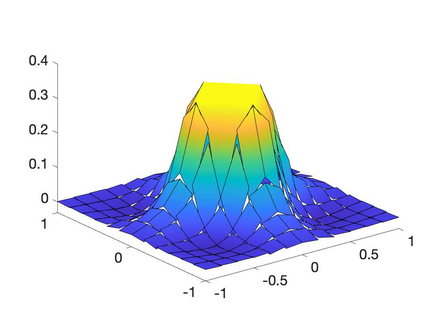

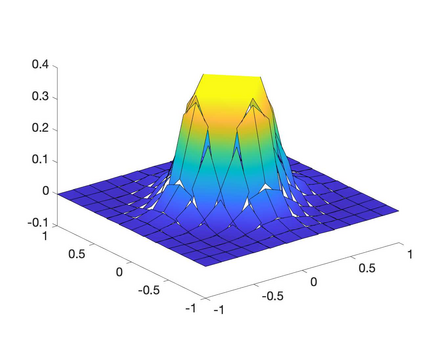

Classical interior penalty discontinuous Galerkin (IPDG) methods for diffusion problems require a number of assumptions on the local variation of mesh-size, polynomial degree, and of the diffusion coefficient to determine the values of the, so-called, discontinuity-penalization parameter and/or to perform error analysis. Variants of IPDG methods involving weighted averages of the gradient of the approximate solution have been proposed in the context of high-contrast diffusion coefficients to mitigate the dependence of the contrast in the stability and in the error analysis. Here, we present a new IPDG method, involving carefully constructed weighted averages of the gradient of the approximate solution, which is shown to be robust even for the most extreme simultaneous local mesh, polynomial degree and diffusion coefficient variation scenarios, without resulting in unreasonably large penalization. The new method, henceforth termed as \emph{robust IPDG} (RIPDG), offers typically significantly better conditioning than the standard IPDG method when applied to scenarios with strong mesh/polynomial degree/diffusion local variation. On the other hand, when using uniform meshes, constant polynomial degree and for problems with constant diffusion coefficients, the RIPDG method is identical to the classical IPDG. Numerical experiments indicate the favourable performance of the new RIPDG method over the classical version in terms of conditioning and error.

翻译:Galerkin (IPDG) 的传播问题经典内部处罚不连续的 Galerkin (IPDG) 方法的传播问题, 需要对本地网格大小、多元度和扩散系数的变化进行若干假设, 以及对于确定所谓不连续-惩罚参数和/或进行错误分析的所谓不连续- 同步- 惩罚参数值的分布系数值的本地变异, 以及对于确定所谓最极端同时的本地网格、 多元度和扩散系数变异假设值的传播系数。 在高相调扩散系数的背景下, 提出了IPDG 方法的变异, 以降低在稳定性和错误分析中对比的依赖性。 在这里, 我们提出了一个新的 IPDG 方法, 包括精心构建的近似溶方梯度加权平均值, 即便对于最极端同时的本地网格、 多元度和扩散系数变异的假设值, 也证明这种变异性 。 新的方法, 以 emph{robubt IPGDG} (RIPG), 通常比标准的IP 方法的调度/ Prealmacialalalalalalalal- destal laphalal laveal deal deal deal deal deal deal demodal degmental degal deal deal deal degyal degyal.