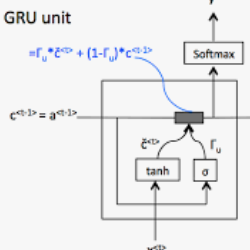

With the evolution of power systems as it is becoming more intelligent and interactive system while increasing in flexibility with a larger penetration of renewable energy sources, demand prediction on a short-term resolution will inevitably become more and more crucial in designing and managing the future grid, especially when it comes to an individual household level. Projecting the demand for electricity for a single energy user, as opposed to the aggregated power consumption of residential load on a wide scale, is difficult because of a considerable number of volatile and uncertain factors. This paper proposes a customized GRU (Gated Recurrent Unit) and Long Short-Term Memory (LSTM) architecture to address this challenging problem. LSTM and GRU are comparatively newer and among the most well-adopted deep learning approaches. The electricity consumption datasets were obtained from individual household smart meters. The comparison shows that the LSTM model performs better for home-level forecasting than alternative prediction techniques-GRU in this case. To compare the NN-based models with contrast to the conventional statistical technique-based model, ARIMA based model was also developed and benchmarked with LSTM and GRU model outcomes in this study to show the performance of the proposed model on the collected time series data.

翻译:随着电力系统的发展,随着可再生能源的更大渗透,电力系统变得更加智能和互动的系统正在演变,随着可再生能源的更大渗透,灵活性也在增加,对短期解决办法的需求预测在设计和管理未来电网方面将不可避免地变得越来越重要,特别是在单个家庭一级。预测单一能源用户的电力需求,而不是大规模住宅载荷的总电耗,由于许多不稳定和不确定因素,因此很难预测,本文件提议建立一个定制的GRU(Gated经常单元)和长期短期内存(LSTM)结构,以解决这一具有挑战性的问题。LSTM和GRU是比较新和采用得力最强的深层次学习方法之一。电力消费数据集是从单个家庭智能计获得的。比较表明,LSTM模型在家庭一级预测方面比在本案中的替代预测技术-GRU要好。将基于NN的模式与传统的统计技术模型相比,还开发了基于ARIMA模型,并将该模型与LSTM和GRU模型结果作为基准,以显示所收集的时间序列模型的绩效。