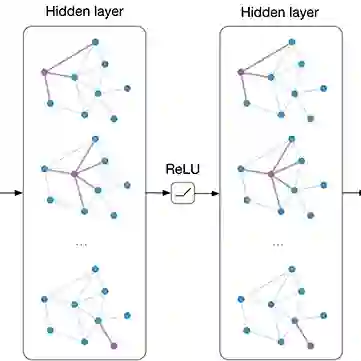

While there have been many studies on hardware acceleration for deep learning on images, there has been a rather limited focus on accelerating deep learning applications involving graphs. The unique characteristics of graphs, such as the irregular memory access and dynamic parallelism, impose several challenges when the algorithm is mapped to a CPU or GPU. To address these challenges while exploiting all the available sparsity, we propose a flexible architecture called SPA-GCN for accelerating Graph Convolutional Networks (GCN), the core computation unit in deep learning algorithms on graphs. The architecture is specialized for dealing with many small graphs since the graph size has a significant impact on design considerations. In this context, we use SimGNN, a neural-network-based graph matching algorithm, as a case study to demonstrate the effectiveness of our architecture. The experimental results demonstrate that SPA-GCN can deliver a high speedup compared to a multi-core CPU implementation and a GPU implementation, showing the efficiency of our design.

翻译:虽然对硬件加速进行了许多研究,以深入了解图像,但对于加快与图表有关的深层学习应用,重点却相当有限。图表的独特性,如不规则的记忆存取和动态平行性,在将算法映射到CPU或GPU时,会带来若干挑战。为了应对这些挑战,我们利用所有可用的宽度,提议了一个称为SPA-GCN的灵活结构,以加速图形革命网络(GCN),这是图表中深层学习算法的核心计算单位。这个结构专门处理许多小图表,因为图形大小对设计考虑有重大影响。在这方面,我们使用神经网络图的匹配算法SimGNN,作为案例研究,以展示我们的架构的有效性。实验结果表明SPA-GCN可以提供与多核心的CPU实施和GPU实施相比的高速度,显示我们的设计效率。