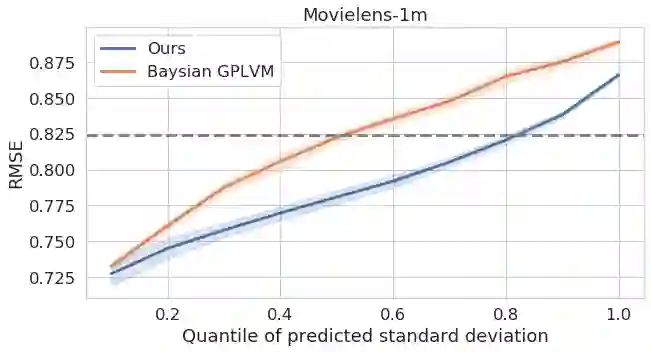

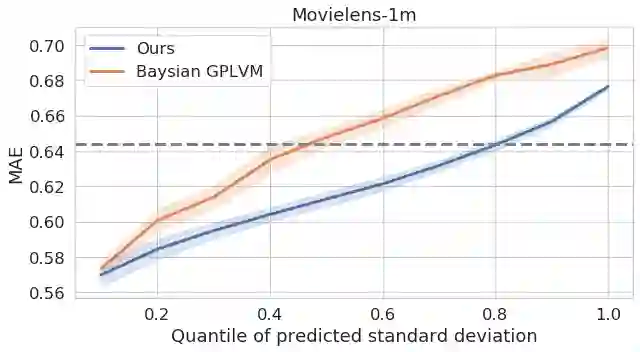

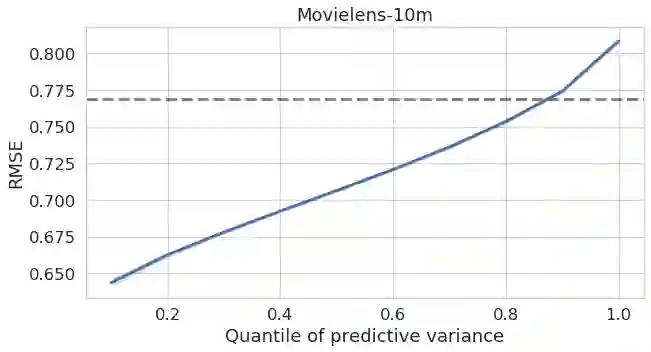

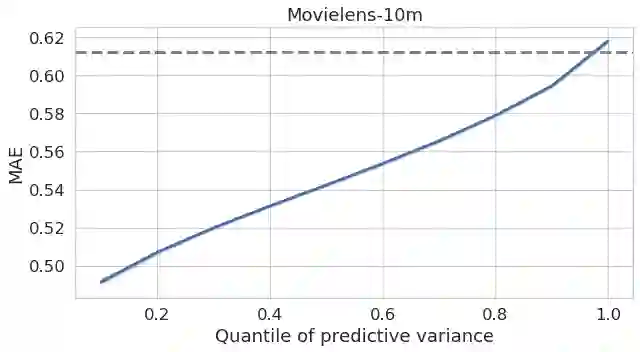

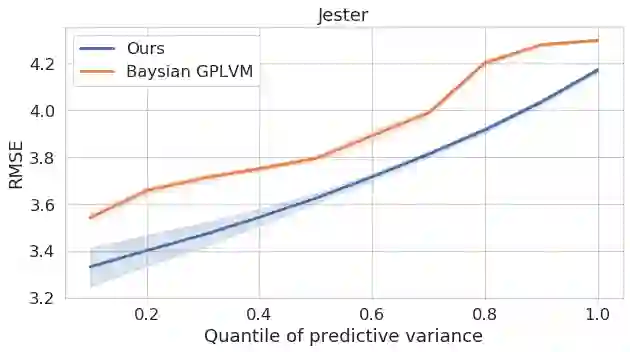

Recommender systems are often designed based on a collaborative filtering approach, where user preferences are predicted by modelling interactions between users and items. Many common approaches to solve the collaborative filtering task are based on learning representations of users and items, including simple matrix factorization, Gaussian process latent variable models, and neural-network based embeddings. While matrix factorization approaches fail to model nonlinear relations, neural networks can potentially capture such complex relations with unprecedented predictive power and are highly scalable. However, neither of them is able to model predictive uncertainties. In contrast, Gaussian Process based models can generate a predictive distribution, but cannot scale to large amounts of data. In this manuscript, we propose a novel approach combining the representation learning paradigm of collaborative filtering with multi-output Gaussian processes in a joint framework to generate uncertainty-aware recommendations. We introduce an efficient strategy for model training and inference, resulting in a model that scales to very large and sparse datasets and achieves competitive performance in terms of classical metrics quantifying the reconstruction error. In addition to accurately predicting user preferences, our model also provides meaningful uncertainty estimates about that prediction.

翻译:建议系统往往是基于合作过滤方法设计的,用户偏好通过模拟用户和项目之间的相互作用来预测用户的偏好。许多解决协作过滤任务的共同方法都是基于用户和项目的学习表现,包括简单的矩阵因子化、高斯进程潜在变量模型和基于神经网络的嵌入。矩阵因子化方法无法建模非线性关系,神经网络可能捕捉出这种具有前所未有的预测力的复杂关系,而且高度可扩展。然而,它们都无法建模预测不确定性。相比之下,基于高斯进程的模式可以产生预测性分布,但不能扩大数据的规模。在这个手稿中,我们提出了一个新颖的方法,将合作过滤和多输出高斯进程的代表性学习模式结合到一个联合框架中,产生不确定性建议。我们引入了高效的模型培训和推论战略,从而形成一个规模非常大和稀少的数据集模型,在对重建错误进行量化的典型指标方面实现竞争性的绩效。除了准确预测用户偏好外,我们的模式还提供了对预测的有意义的不确定性估计。