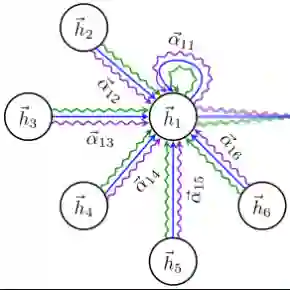

Gene regulatory relationships can be abstracted as a gene regulatory network (GRN), which plays a key role in characterizing complex cellular processes and pathways. Recently, graph neural networks (GNNs), as a class of deep learning models, have emerged as a useful tool to infer gene regulatory relationships from gene expression data. However, deep learning models have been found to be vulnerable to noise, which greatly hinders the adoption of deep learning in constructing GRNs, because high noise is often unavoidable in the process of gene expression measurement. Can we preferably prototype a robust GNN for constructing GRNs? In this paper, we give a positive answer by proposing a Quadratic Graph Attention Network (Q-GAT) with a dual attention mechanism. We study the changes in the predictive accuracy of Q-GAT and 9 state-of-the-art baselines by introducing different levels of adversarial perturbations. Experiments in the E. coli and S. cerevisiae datasets suggest that Q-GAT outperforms the state-of-the-art models in robustness. Lastly, we dissect why Q-GAT is robust through the signal-to-noise ratio (SNR) and interpretability analyses. The former informs that nonlinear aggregation of quadratic neurons can amplify useful signals and suppress unwanted noise, thereby facilitating robustness, while the latter reveals that Q-GAT can leverage more features in prediction thanks to the dual attention mechanism, which endows Q-GAT with the ability to confront adversarial perturbation. We have shared our code in https://github.com/Minorway/Q-GAT_for_Robust_Construction_of_GRN for readers' evaluation.

翻译:基因调控关系可以抽象为基因调控网络(GRN),在表征复杂的细胞过程和通路方面扮演着关键角色。最近,作为一类深度学习模型的图神经网络(GNN)在从基因表达数据中推断基因调控关系方面已被证明是一种有用的工具。然而,深度学习模型易受到噪声的干扰,这极大地阻碍了深度学习在构建GRNs方面的应用,因为在基因表达测量过程中高噪声通常是不可避免的。我们能否设计一个更加健壮的图神经网络用于构建GRNs呢?本文通过提出一种带有防御机制的Quadratic Graph Attention Network(Q-GAT)给出了正面回答。我们通过引入不同程度的对抗扰动研究了Q-GAT和9种最先进的基线模型的预测精度变化。生物实验数据表明Q-GAT比最先进的模型具有更好的鲁棒性。最后,我们通过信噪比和可解释性分析来剖析Q-GAT为什么是健壮的。前者提醒我们,二次神经元的非线性聚合可以放大有用信号并抑制无用的噪声,从而促进健壮性;后者揭示Q-GAT可以通过双重注意机制利用更多特征进行预测,从而赋予Q-GAT应对对抗性干扰的能力。我们已将代码分享在 https://github.com/Minorway/Q-GAT_for_Robust_Const