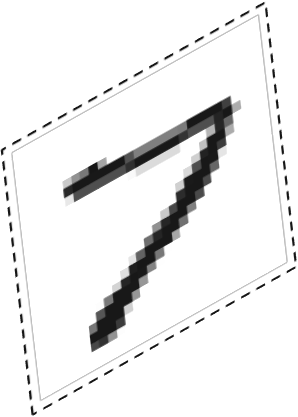

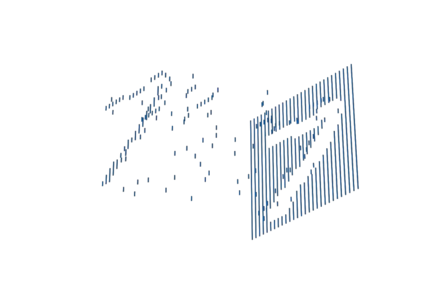

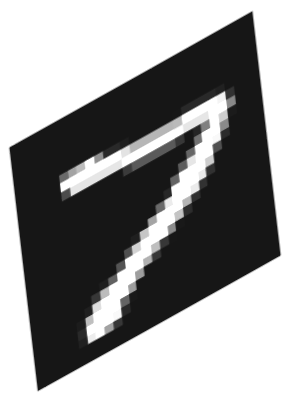

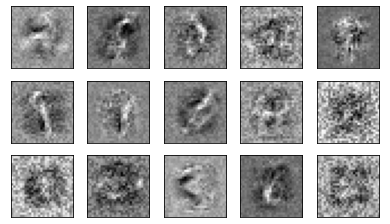

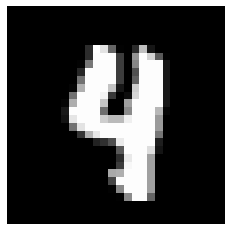

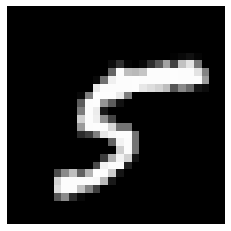

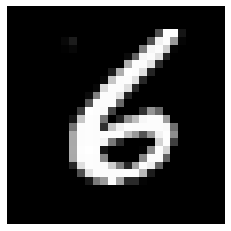

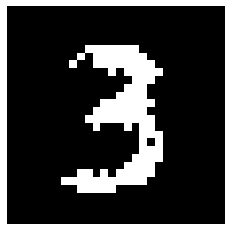

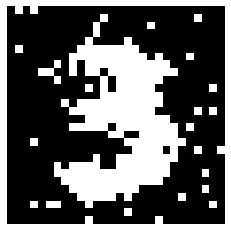

Spiking Neural Networks (SNNs) have shown great potential in solving deep learning problems in an energy-efficient manner. However, they are still limited to simple classification tasks. In this paper, we propose Spiking-GAN, the first spike-based Generative Adversarial Network (GAN). It employs a kind of temporal coding scheme called time-to-first-spike coding. We train it using approximate backpropagation in the temporal domain. We use simple integrate-and-fire (IF) neurons with very high refractory period for our network which ensures a maximum of one spike per neuron. This makes the model much sparser than a spike rate-based system. Our modified temporal loss function called 'Aggressive TTFS' improves the inference time of the network by over 33% and reduces the number of spikes in the network by more than 11% compared to previous works. Our experiments show that on training the network on the MNIST dataset using this approach, we can generate high quality samples. Thereby demonstrating the potential of this framework for solving such problems in the spiking domain.

翻译:斯皮克神经网络(SNNS)在以节能的方式解决深层学习问题方面显示出巨大的潜力。 但是,它们仍然局限于简单的分类任务。 在本文中, 我们提议Spiking- GAN, 即第一个基于钉钉的基因反转网络(GAN) 。 它使用一种叫做时间到第一次冲刺编码的时序编码办法。 我们用时间范围内的近似反向转换法来训练它。 我们使用简单的集成和火灾神经神经元(IF), 其耐冲期非常高, 保证每个神经元最多有一个峰值。 这让模型比一个基于峰值的系统更加稀疏。 我们修改过的时间损失函数叫做“ 递增 TTFS ”, 将网络的推导时间提高了33%以上, 并将网络的峰值数量比以前的工作减少了11%以上。 我们的实验显示, 使用这种方法在MNIST数据集上培训网络时, 我们可以产生高质量的样本。 通过展示这个框架在悬浮域中解决这类问题的潜力。