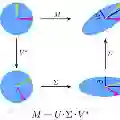

By adhering to the dictum, "No causation without manipulation (treatment, intervention)", cause and effect data analysis represents changes in observed data in terms of changes in the causal factors. When causal factors are not amenable for active manipulation in the real world due to current technological limitations or ethical considerations, a counterfactual approach performs an intervention on the model of data formation. In the case of object representation or activity (temporal object) representation, varying object parts is generally unfeasible whether they be spatial and/or temporal. Multilinear algebra, the algebra of higher-order tensors, is a suitable and transparent framework for disentangling the causal factors of data formation. Learning a part-based intrinsic causal factor representations in a multilinear framework requires applying a set of interventions on a part-based multilinear model. We propose a unified multilinear model of wholes and parts. We derive a hierarchical block multilinear factorization, the M-mode Block SVD, that computes a disentangled representation of the causal factors by optimizing simultaneously across the entire object hierarchy. Given computational efficiency considerations, we introduce an incremental bottom-up computational alternative, the Incremental M-mode Block SVD, that employs the lower-level abstractions, the part representations, to represent the higher level of abstractions, the parent wholes. This incremental computational approach may also be employed to update the causal model parameters when data becomes available incrementally. The resulting object representation is an interpretable combinatorial choice of intrinsic causal factor representations related to an object's recursive hierarchy of wholes and parts that renders object recognition robust to occlusion and reduces training data requirements.

翻译:通过坚持判词“没有操纵(处理、干预)就没有因果关系,”原因和效果数据分析代表了从因果因素变化角度观察数据的变化。当因果因素由于当前的技术限制或道德考虑而不适合在现实世界中积极操纵时,反事实方法对数据形成模型进行干预。在物体表示或活动(时标)代表方面,不同对象部分一般不可行,无论它们是空间和/或时间。多线性代数,高阶目标振标的代数是分散数据形成因果因素的合适和透明的框架。在多线性框架内学习基于部分内在因果因素的表述,需要在基于部分的多线模型模型模型中应用一套干预措施。在物体表示或活动(时标对象)代表整体和/或时间。多线性模型SVD,通过在整个目标等级中优化对因果因素的分解表示。鉴于计算效率水平的计算,我们从基于部分内在因果因素的内在因果因素显示在多线性说明中学习一套基于部分的因果因果因果因果因素的表达方式。我们引入了一种基于部分的递增因果的代数的代数,当进行成本的计算时,在可变的计算时,可以将可变的递增性分析到整个的递增的递增性表示值的递增的递增性表示值表示值,而逐渐的递减到递增的递减到递减到递制的计算。