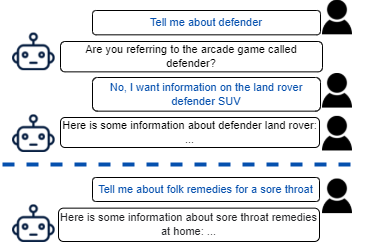

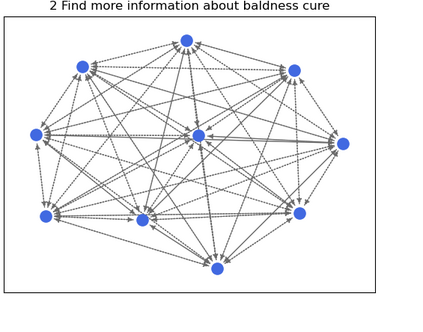

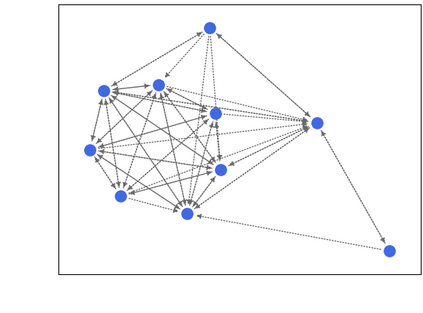

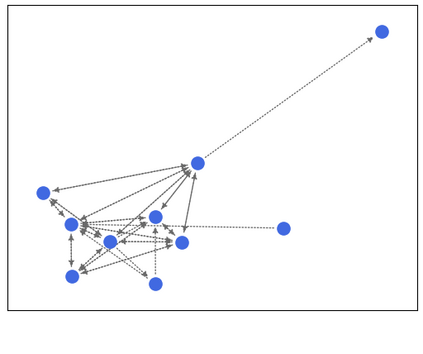

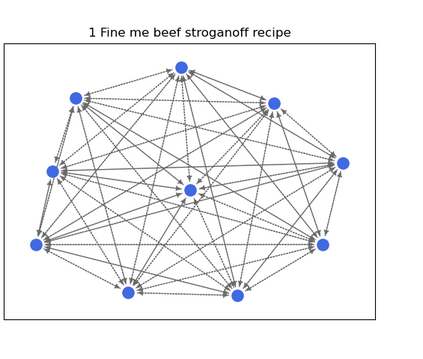

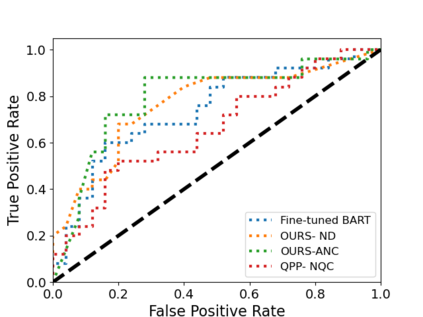

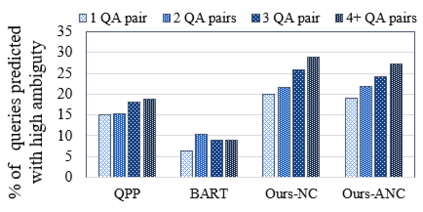

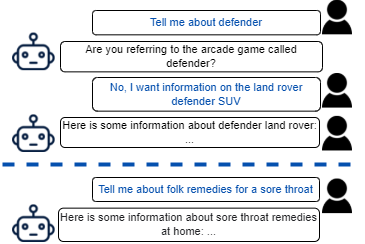

Despite recent progress on conversational systems, they still do not perform smoothly and coherently when faced with ambiguous requests. When questions are unclear, conversational systems should have the ability to ask clarifying questions, rather than assuming a particular interpretation or simply responding that they do not understand. Previous studies have shown that users are more satisfied when asked a clarifying question, rather than receiving an unrelated response. While the research community has paid substantial attention to the problem of predicting query ambiguity in traditional search contexts, researchers have paid relatively little attention to predicting when this ambiguity is sufficient to warrant clarification in the context of conversational systems. In this paper, we propose an unsupervised method for predicting the need for clarification. This method is based on the measured coherency of results from an initial answer retrieval step, under the assumption that a less ambiguous query is more likely to retrieve more coherent results when compared to an ambiguous query. We build a graph from retrieved items based on their context similarity, treating measures of graph connectivity as indicators of ambiguity. We evaluate our approach on two recently released open-domain conversational question answering datasets, ClariQ and AmbigNQ, comparing it with neural and non-neural baselines. Our unsupervised approach performs as well as supervised approaches while providing better generalization.

翻译:尽管在对话系统方面最近取得了进展,但在面对模棱两可的要求时,这些系统仍然不能顺利和连贯地运作。当问题不明确时,对话系统应该能够提出澄清问题,而不是假设某种解释或简单地回答他们不理解的问题。以前的研究表明,用户在被问到澄清问题时更满意,而不是得到不相干的答复。虽然研究界对传统搜索环境中预测查询模糊性的问题给予了极大关注,但研究人员相对较少地注意预测何时这种模糊性足以在对话系统范围内得到澄清。在本文中,我们提出了一种不监督地预测需要澄清问题的方法。这种方法基于初步答复检索步骤的结果的衡量一致性,假设比较模糊的查询更有可能在与模糊性查询相比的情况下取得更加一致的结果。我们根据背景相似性从检索到的项目中绘制一个图表,将图形连接度作为模糊性指标处理。我们最近公布的两个公开对话问题回答数据集、ClariQ和AmbigNQ的处理方法,我们采用的方法是用来预测需要澄清的。这个方法所依据的假设是初步答复检索步骤所衡量的结果是否一致,同时将它与监督性和非直观基线进行比较。