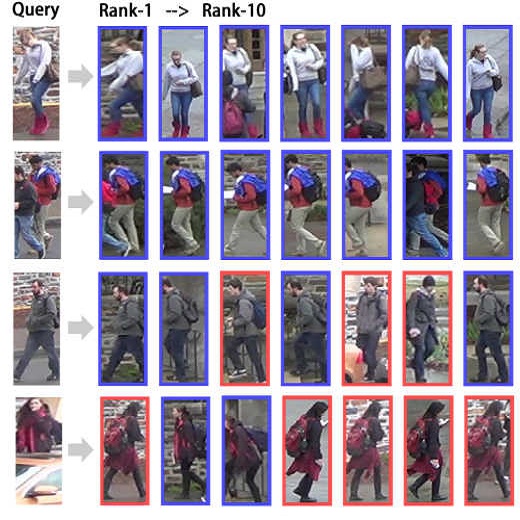

Generalization to out-of-distribution (OOD) data is a capability natural to humans yet challenging for machines to reproduce. This is because most statistical learning algorithms strongly rely on the i.i.d.~assumption on source/target data, while in practice domain shift between source and target is common. Domain generalization (DG) aims to achieve OOD generalization by using only source data for model learning. Since first introduced in 2011, research in DG has made great progresses. In particular, intensive research in this topic has led to a broad spectrum of methodologies, e.g., those based on domain alignment, meta-learning, data augmentation, or ensemble learning, just to name a few; and has covered various applications such as object recognition, segmentation, action recognition, and person re-identification. In this paper, for the first time, a comprehensive literature review is provided to summarize the developments in DG in the past decade. Specifically, we first cover the background by formally defining DG and relating it to other research fields like domain adaptation and transfer learning. Second, we conduct a thorough review into existing methods and present a categorization based on their methodologies and motivations. Finally, we conclude this survey with insights and discussions on future research directions.

翻译:向外分配(OOD)数据普及是人类的一种自然能力,但对于机器复制来说却具有挑战性。这是因为大多数统计学习算法都强烈依赖源/目标数据的i.d.-sumpation,而实际上源/目标之间的领域转移是常见的。DG(DG)的目的是通过只使用源数据实现OOOD的概括化。自2011年首次引入以来,DG的研究取得了巨大进展。特别是,这个专题的密集研究导致了一系列广泛的方法,例如基于领域调整、元学习、数据增强或共同学习的方法,仅举几个例子;并涵盖各种应用,如对象识别、分解、行动识别和个人重新定位。本文首次提供了全面的文献审查,以总结DG在过去十年中的发展情况。具体地说,我们首先通过正式界定DG,将其与其他研究领域适应和转移学习等领域联系起来,从而覆盖了背景。第二,我们对现有方法进行了彻底审查,并根据研究方向和动机对今后进行分类。最后,我们以其研究方向和动机为基础,对现有方法进行了透彻的讨论,并根据未来研究方向和分类。