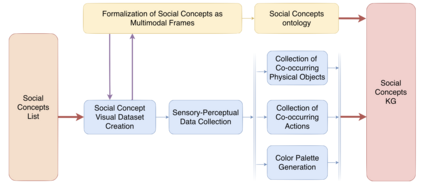

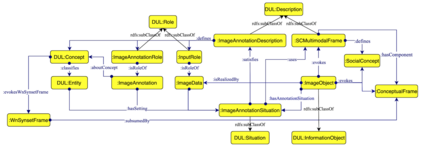

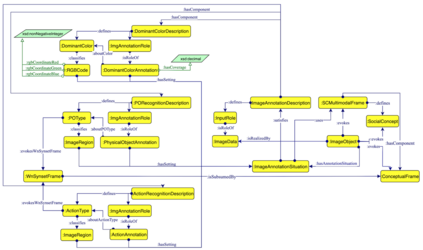

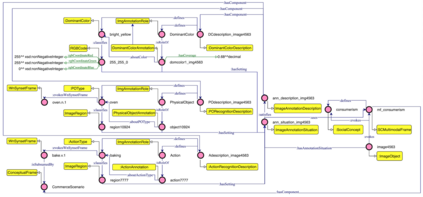

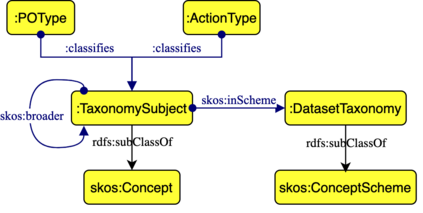

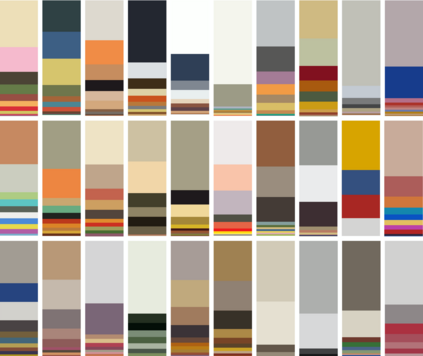

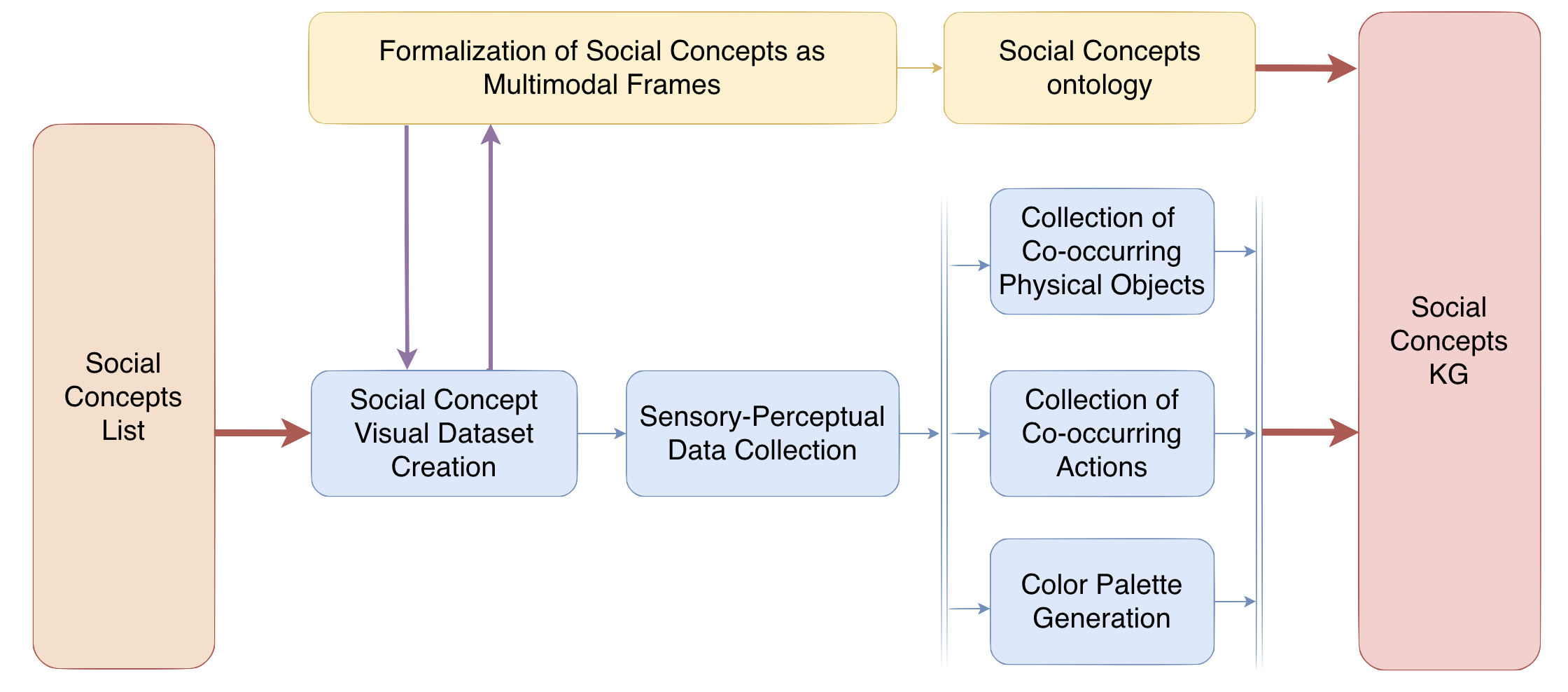

Social concepts referring to non-physical objects--such as revolution, violence, or friendship--are powerful tools to describe, index, and query the content of visual data, including ever-growing collections of art images from the Cultural Heritage (CH) field. While much progress has been made towards complete image understanding in computer vision, automatic detection of social concepts evoked by images is still a challenge. This is partly due to the well-known semantic gap problem, worsened for social concepts given their lack of unique physical features, and reliance on more unspecific features than concrete concepts. In this paper, we propose the translation of recent cognitive theories about social concept representation into a software approach to represent them as multimodal frames, by integrating multisensory data. Our method focuses on the extraction, analysis, and integration of multimodal features from visual art material tagged with the concepts of interest. We define a conceptual model and present a novel ontology for formally representing social concepts as multimodal frames. Taking the Tate Gallery's collection as an empirical basis, we experiment our method on a corpus of art images to provide a proof of concept of its potential. We discuss further directions of research, and provide all software, data sources, and results.

翻译:社会概念是指非物理物体,例如革命、暴力或友谊的强大工具,用以描述、索引和查询视觉数据的内容,包括不断增长的从文化遗产领域收集的艺术图像,尽管在计算机视觉中完全理解图像方面已取得很大进展,但自动发现图像产生的社会概念仍是一项挑战,部分原因是众所周知的语义差距问题,社会概念由于缺乏独特的物理特征而恶化,以及依赖比具体概念更不具体的特征。在本文件中,我们提议将最近关于社会概念代表的认知理论转换成一种软件方法,通过综合多感性数据来将社会概念表述为多式框架。我们的方法侧重于提取、分析和整合与利益概念挂钩的视觉艺术材料中的多式特征。我们定义了一个概念模型,并提出了正式将社会概念作为多式联运框架的新型理论。以塔特美术馆的收集作为经验基础,我们将我们的方法试验一套艺术图像,以提供其潜力概念的证明。我们讨论了研究的进一步方向,并提供所有软件、数据来源和结果。