今日 Paper | COVID-19;深度兴趣网络;COVIDX-NET;场景文本迁移等

目录

针对COVID-19绘制人工智能应用的地图

COVIDX-NET:一种用于诊断X射线图像中COVID-19的深度学习分类器框架

COVID-NET:一种用于从胸部X光图像中检测COVID-19病例的定制深度卷积神经网络设计

用于点击率预测的深度兴趣网络

CVPR 2020 | SwapText: 基于图像的场景文本迁移

针对COVID-19绘制人工智能应用的地图

论文名称:Mapping the Landscape of Artificial Intelligence Applications against COVID-19

作者:Bullock Joseph /Alexandra /Luccioni /Pham Katherine Hoffmann /Lam Cynthia Sin Nga /Luengo-Oroz Miguel

发表时间:2020/3/25

论文链接:https://arxiv.org/abs/2003.11336v1

推荐原因

这是一篇综述论文,概述了最近在新冠病毒研究中使用的计算机和人工智能相关的技术应用。目前新冠病毒的研究重点包括追踪病毒传播、促进病毒检测、开发疫苗、寻找新的治疗方法、了解疫情的社会经济影响等。人工智能技术在不同层次上有助于解决COVID-19危机,包括分子、医学和流行病学应用,其中分子层面包括药物挖掘等相关研究,医疗层面包括个体病人的诊断和治疗,社会层面包括流行病学和信息医学研究等。最后,这篇论文还讨论了有潜力的未来研究方向及促进人工智能研究所需的工具和资源。

COVIDX-NET:一种用于诊断X射线图像中COVID-19的深度学习分类器框架

论文名称:COVIDX-Net: A Framework of Deep Learning Classifiers to Diagnose COVID-19 in X-Ray Images

作者:Hemdan Ezz El-Din /Shouman Marwa A. /Karar Mohamed Esmail

发表时间:2020/3/24

论文链接:https://arxiv.org/abs/2003.11055v1

推荐原因

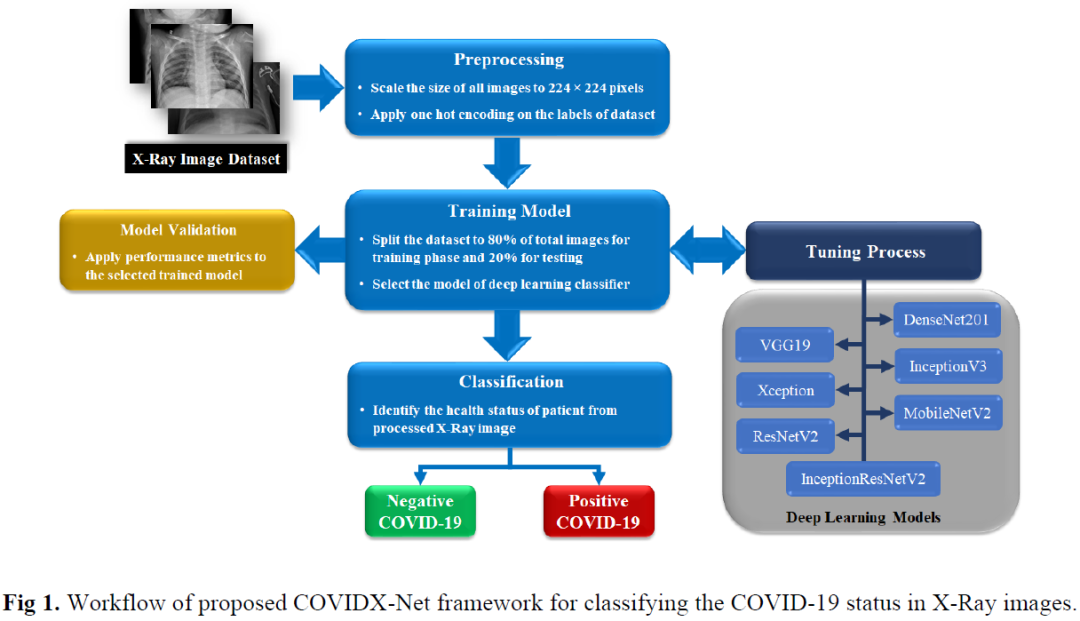

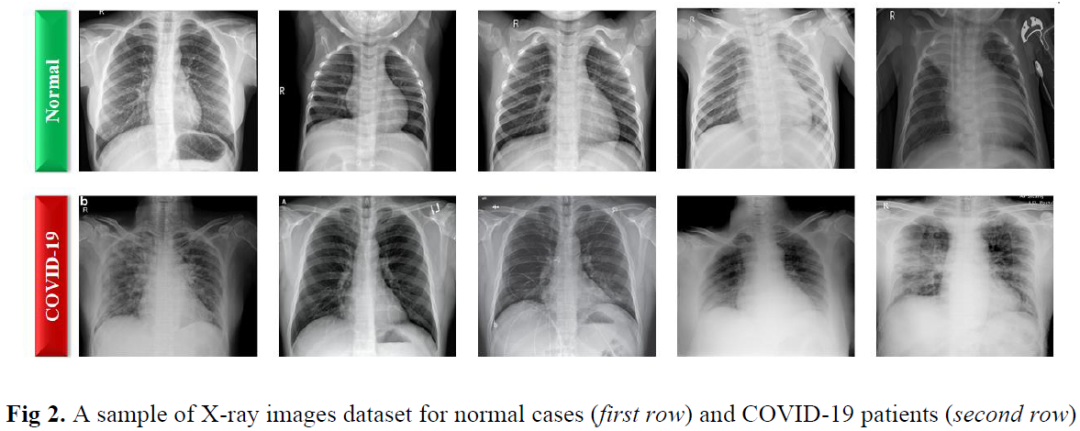

这篇论文提出了一个名为COVIDX-Net的深度学习框架,以帮助放射科医生自动诊断X射线图像中的COVID-19。这篇论文在50例胸部X射线图像上对7种不同的深度卷积神经网络模型进行了验证,包括VGG19、MobileNet等。基于80%-20%的训练集-测试集划分,这篇论文发现VGG19和DenseNet分类表现更好,f1分数分别为0.89和0.91。这只是一个初步的研究工作,随着更多的开放数据集出现,还可以进行进一步的评估。

COVID-NET:一种用于从胸部X光图像中检测COVID-19病例的定制深度卷积神经网络设计

论文名称:COVID-Net: A Tailored Deep Convolutional Neural Network Design for Detection of COVID-19 Cases from Chest Radiography Images

作者:Wang Linda /Wong Alexander

发表时间:2020/3/22

论文链接:https://arxiv.org/abs/2003.09871v1

推荐原因

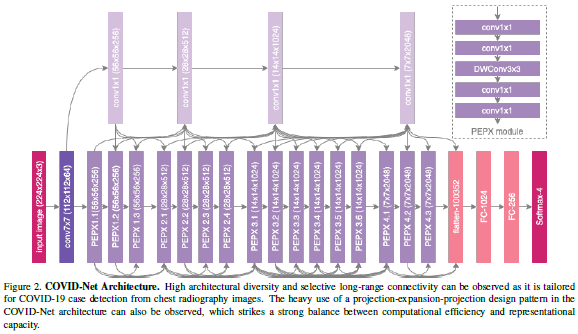

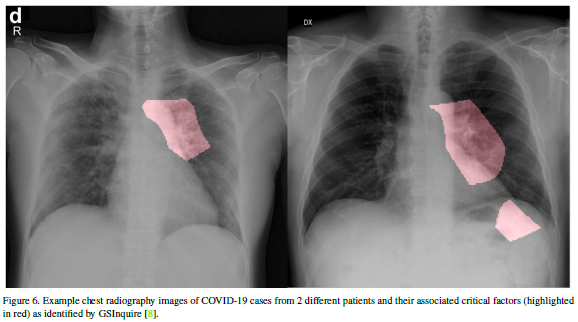

这篇论文开源了一个用于从胸部X射线图像中检测COVID-19病例而设计的深度卷积神经网络,即COVID-Net。用于训练COVID-Net的胸部放射线图像数据集名为COVIDx,包含了来自两个开放数据库的2839例患者的5941个由后向前胸部放射线图像。这篇论文还分析了COVID-Net如何使用可解释性方法做出预测,以期深入了解与COVID病例相关的关键因素,从而可以帮助临床医生进行更好的筛查。开放的数据和代码有助于进一步开发高精度和实用的深度学习解决方案,用于检测COVID-19病例。

用于点击率预测的深度兴趣网络

论文名称:Deep Interest Network for Click-Through Rate Prediction

作者:Guorui Zhou

发表时间:2018/3/1

论文链接:https://arxiv.org/pdf/1706.06978.pdf

推荐原因

本文的研究意义以及核心内容:

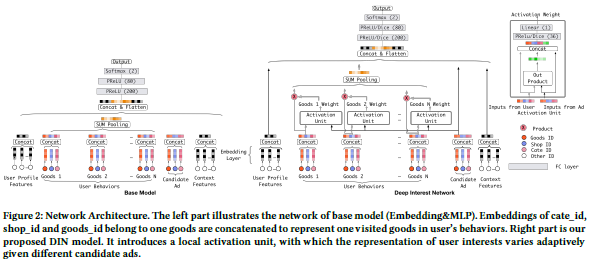

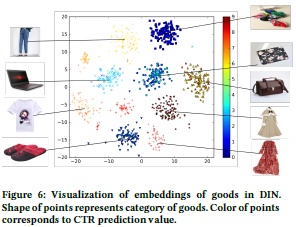

点击率预估问题在工业领域中是一项很基本的任务,通常适用于广告投放。为了解决广告投放中的CTR任务,很多学者进行了这方面的相关研究,其中部分研究人员提出了采用深度学习的新模型,该模型遵循类似的Embedding+MLP范式。但是当我们采用这种模型,在实际应用中,发现存在着模型的特征映射被压缩的问题,这对于CTR任务有着较大的影响,也不利于实际预测问题的解决。为了解决这一困境,作者基于前人的成果,提出了一种新颖的模型:深度兴趣网络(DIN),该模型通过构建本地激活单元,根据特定广告的历史行为,自适应地学习用户行为最终进行用户兴趣的预测,除此之外,由于作者提出的DIN模型是用不同广告来生成的向量,从而大大提高了该模型在实际工程中的应用。

CVPR 2020 | SwapText: 基于图像的场景文本迁移

论文名称:SwapText: Image Based Texts Transfer in Scenes

作者:Qiangpeng Yang /Hongsheng Jin /Jun Huang /Wei Lin

发表时间:2020/3/18

论文链接:https://arxiv.org/abs/2003.08152

推荐原因

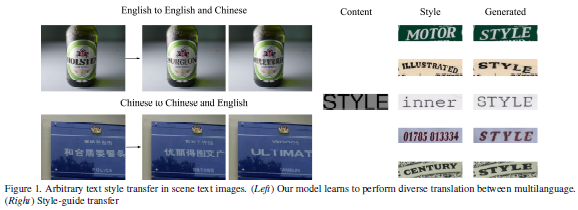

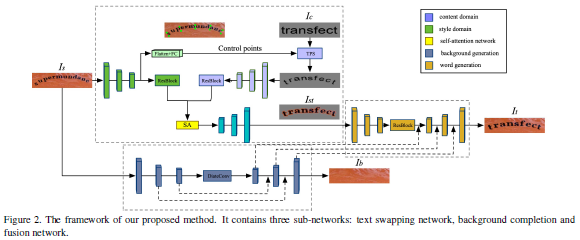

本文出自阿里巴巴达摩院,已经被CVPR2020接收,文章主要解决的是图像中的文本替换问题。

由于不同因素之间的复杂相互作用,在保留原始字体,颜色,大小和背景纹理的同时交换场景图像中的文本是一项具有挑战性的任务。为了解决这个问题,作者提出了SwapText,一个能够在场景图像之间迁移文本的三阶段框架,首先通过文本交换网络仅替换前景图像中的文本,然后背景补全网络重建背景图像,最后融合网络将前、背景图像进行融合。文章方法即使在图像具有严重几何扭曲的情况下也能操纵输入图像的文本。作者最后对文章方法在几个数据集上进行了定性和定量的分析,验证了方法的有效性。