SemEval-2022组队参赛啦!八节课带你入门全球最大的语义测评大赛

# 首场免费直播课 #

直播时间:12月15日 晚20:00、12月23日 晚20:00

直播内容:BERT模型101

直播地址:https://live.bilibili.com/23928550

过完2021马上又到一年一度的春招了,不管是校招还是社招,你是否正在为一份更好的AI算法岗而发愁呢?希望大厂录取,但是没有一个亮眼的项目经历,应该如何是好?那么打一场AI大赛将会是你的最佳选择!拥有一个完整的大赛经验不仅能为你的简历加分,也能快速提高项目实战能力!

但每年各种各样的比赛,如:Kaggle、天池、DataCastle、科赛网,DataFountain,我该选择哪个呢?才能让我得到有效锻炼?

经过择数导师调研发现,国际计算语言学协会(Association for Computational Linguistics, ACL)主办的国际语义评测大赛SemEval-2022!正是当下的热门赛题,也是NLP入门的首选比赛!

这场比赛直接反映了当前NLP中最前沿的研究方向,而且涵盖了词义分析,信息抽取,语义理解等多个方向,对大家夯实NLP基础与培养更高阶的语义建模能力非常有帮助。

赛题类型

语义理解、信息抽取

赛题背景

SemEval(InternationalWorkshoponSemanticEvaluation)是国际知名的自然语言学术研会,其前身是SenseEval。其在每年年初举办高质量的计算语言学评测任务,涵盖词义分析、信息抽取,语义理解等一系列NLP基础问题。SemEval为NLP学界提供了大量基准数集,极大的推动了NLP技术的发展。

官方赛程

A榜截止日期 :2022年1月10日 (UTC - 12)

B榜截止日期 :2022年1月31日 (UTC - 12)

选好了比赛,又容易遇到这些问题:

相关论文太多,不知道从什么地方开始着手;

不理解模型的具体原理,只会跑开源模型代码;

没有深入理解建模方法,不知道如何进行优化;

没有志同道合的小伙伴,孤掌难鸣;

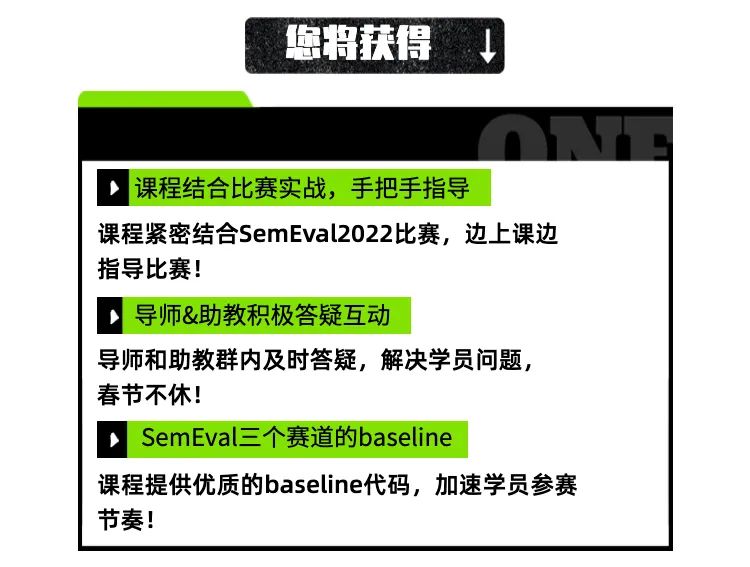

没关系,你的顾虑我们都替你解决!为了让大家少走弯路、少踩坑,能让更多的人参与到竞赛中来,择数科技推出NLP比赛入门班,TOP级导师传授经验,课程结合本次SemEval2022比赛进行实战,手把手带你打比赛!

「NLP比赛入门班」学习路线

— 通过以下3步,解决你的所有难题 —

STEP

01

BERT 原理

BERT模型为什么成功?BERT模型有哪些组件?

BERT模型如何实现?

STEP

02

分类任务SOTA

如何搭建一个基于BERT模型微调的代码项目?

分类任务如何上分?

STEP

03

复杂信息抽取任务建模

如何处理复杂NER任务?如何端到端建模复杂信息抽取任务?

「NLP比赛入门班」直播课安排

— 8场直播课,搞定算法大赛 —

课程1.BERT模型101 /1h 免费课

知识点:

1.预训练模型发展概览

2.分类任务实战:SemEval2022 iSarcasmEval任务,分析一个句子是否是讽刺意义

课程2.BERT模型架构深入分析/1h

知识点:

1.BERT模型中的核心模块与辅助模块详解

2.transformer的q,k,v多头注意力模块代码实现;BERT modeling代码解析

3.BERT为什么可以成功?原因分析

课程3.BERT模型代码项目解析/1h

知识点:

1.BERT微调项目代码:代码结构梳理,数据处理,输入输出格式,训练过程

2.BERT微调时哪些超参数需要注意

课程4.BERT模型变体/1h

知识点:

1.全词掩码WWM (MLM代码实现)

2.NEZHA相对位置编码 (代码实现)

课程5.BERT分类模型进阶/1h

知识点:

样本不均衡应该如何解决

课程6.BERT实体抽取模型(一) /1h

知识点:

1.BERT+MLP还是BERT+CRF

2.基于BERT的NER模型代码实现

3.NER模型调参

4.赛题初探:SemEval2022 MultiCoNER 任务

课程7.BERT实体抽取模型(二)/1h

知识点:

1.嵌套实体问题如何建模

2.NER标注量少:应该怎么做

课程8.BERT信息抽取任务/1h

知识点:

1.三元组抽取模型UniRE

2.UniRE代码详解

3.结构化情感分类:SemEval2022任务10;基于table filling的解法

直播答疑课/1h

每周收集问题统一直播答疑

Michael老师

港大硕士,985高校博士

在ACL, EMNLP, CIKM, NAACL等顶级人工智能学术会议发表多篇文章

获得过多项世界级人工智能大赛冠军,拥有丰富的论文指导和竞赛指导经验。

左玉辉 助教

桂电研究生

在多次nlp竞赛中获得优异名次;2021年达观杯比赛第四名

多篇学术文章发表

8场直播专题讲解+1场直播答疑

限时特价:299元/人!

两人拼团价:259元/人!

第一场直播课免费!免费!免费!

可先免费试听!

扫码购买

和导师一起打比赛~

报名时间截至:2021.12.30

报名成功请添加班主任入内部群

备注「比赛」

开启你的进阶之旅吧~

# 首场免费直播课 #

直播时间:12月15日 晚20:00、12月23日 晚20:00

直播内容:BERT模型101

直播地址:https://live.bilibili.com/23928550

订阅须知

Q:课程资料在哪看?

A:通过公众号【择数AI】下方菜单栏的课程入口观看或咨询客服,报名后务必添加客服入群。

Q:课程有效期多久?

A:自购买课程之日起一年有效期。

Q:报名后可以退款吗?

A:本课程不支持退款,请谅解。

Q:可以开发票吗?

A:可以开具普通电子发票,请联系班主任提供开票信息即可。

「关注我们」

大神不定期分享个人顶刊论文、算法大赛技巧...