【DeepMind】首发并开源Alchemy,一种元强化学习(meta-RL)基准环境。

深度强化学习实验室

元学习作为一种增加强化学习的灵活性和样本效率的方法,科研学者对此的关注兴趣迅速增长。然而,该研究领域中的一个问题是缺乏足够的基准测试任务。通常,过去基准的基础结构要么太简单以至于无法引起兴趣,要么就太不明确了以至于无法进行有原则的分析。在当前的工作中,DeepMind科学家介绍了用于元RL研究的新基准:Alchemy,该基准是将结构丰富性与结构透明性相结合。它是在Unity中实现的3D视频游戏,涉及潜在的因果结构,该过程都经过程序重新采样,从而提供了结构学习,在线推理,假设测试以及基于抽象领域知识的动作排序。并在Alchemy上评估了一对功能强大的RL方法,并对这些方法进行了深入分析。结果清楚地表明,Alchemy作为元RL的挑战性基准提供了验证。

一种有前途的方法是元学习或学习学习(learning to learn)。这里的想法是,学习者可以从大量的经验中获得可用于目标的知识,并且随着知识的积累,学习者可以越来越快地适应遇到的每个新任务。在深度RL中开发元学习方法的兴趣迅速增长。尽管在“元强化学习”方面取得了实质性进展,但由于缺乏基准测试任务,这一领域的研究受到了阻碍。在当前的工作中,作者旨在通过引入(和开源)Alchemy(一种有用的meta-RL基准环境)以及一套分析工具来缓解此问题。

为了进行元学习,环境必须向学习者提供的不是单一任务,而是一系列任务或一系列任务,所有这些任务都有一些共同的高级特征。以前关于meta-RL的工作通常依赖于任务分布,这些任务分布要么是有趣的(例如强盗任务),要么是有趣的(例如,Atari游戏),而没有兴趣。Alchemy旨在提供两全其美的体验。

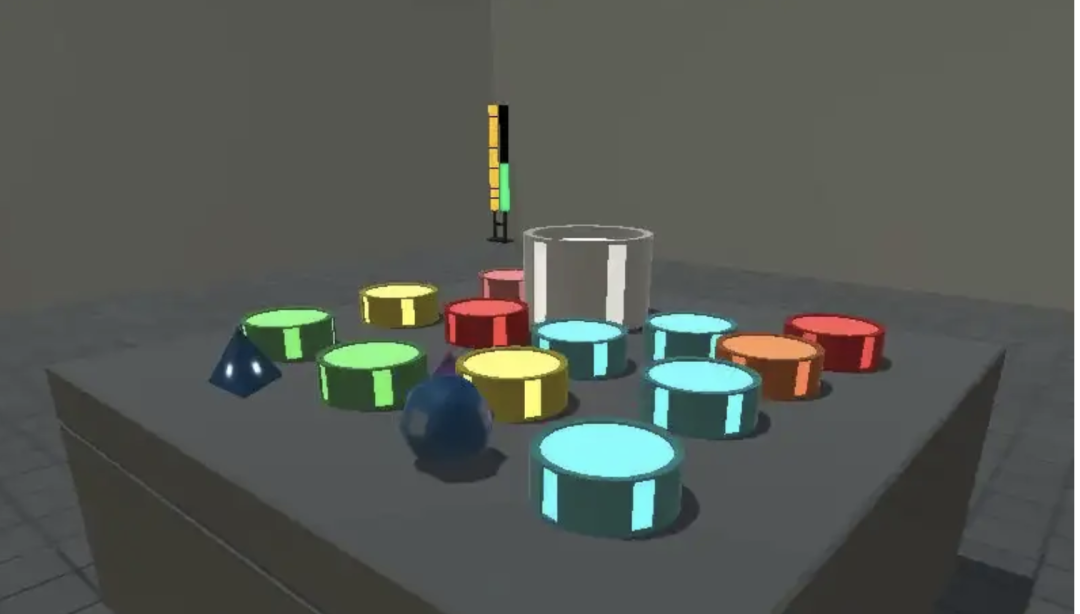

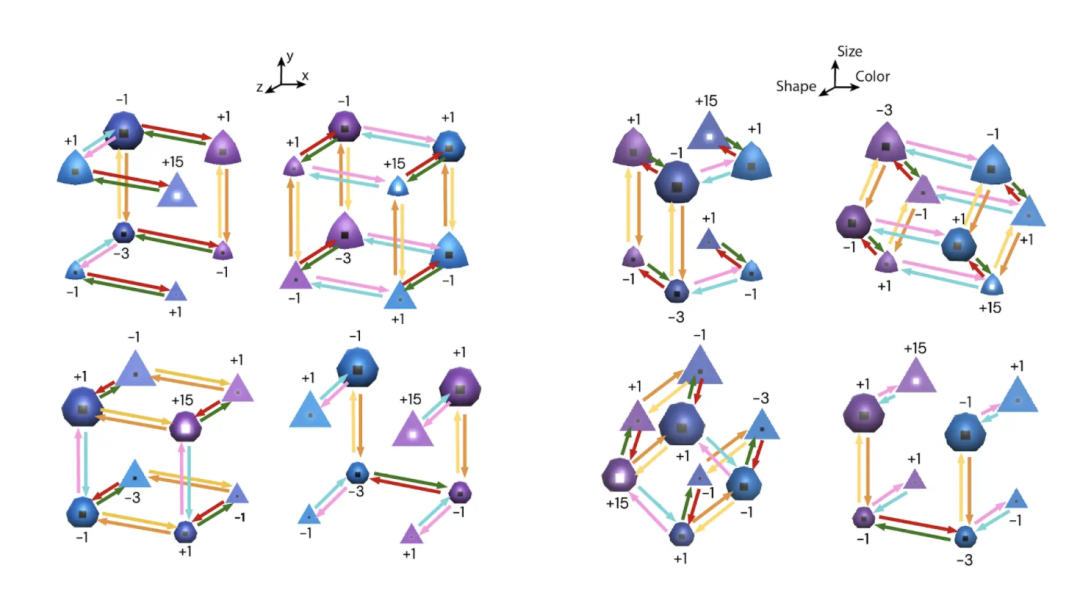

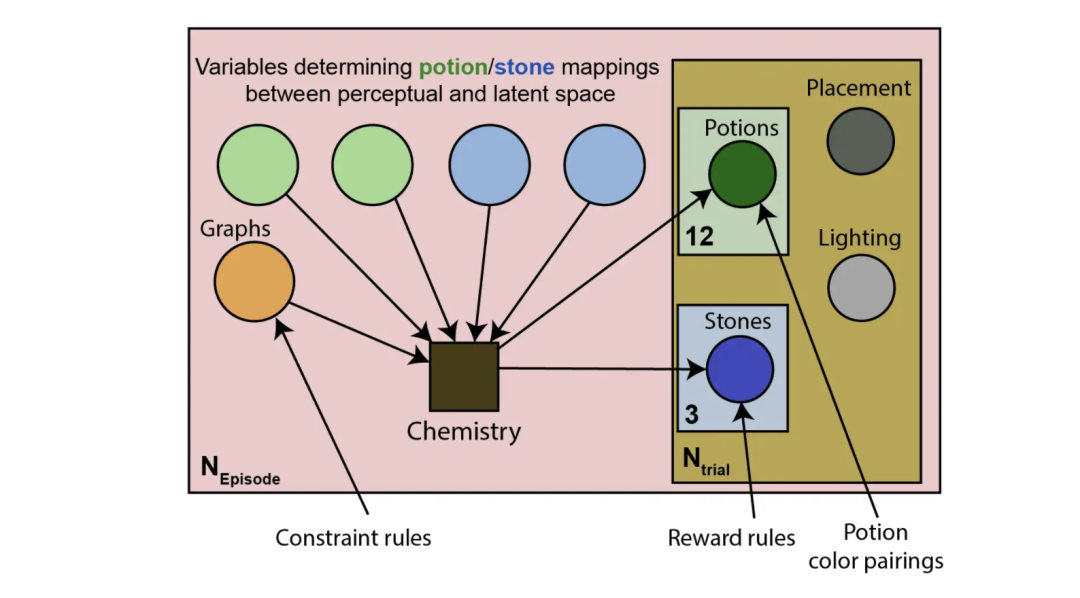

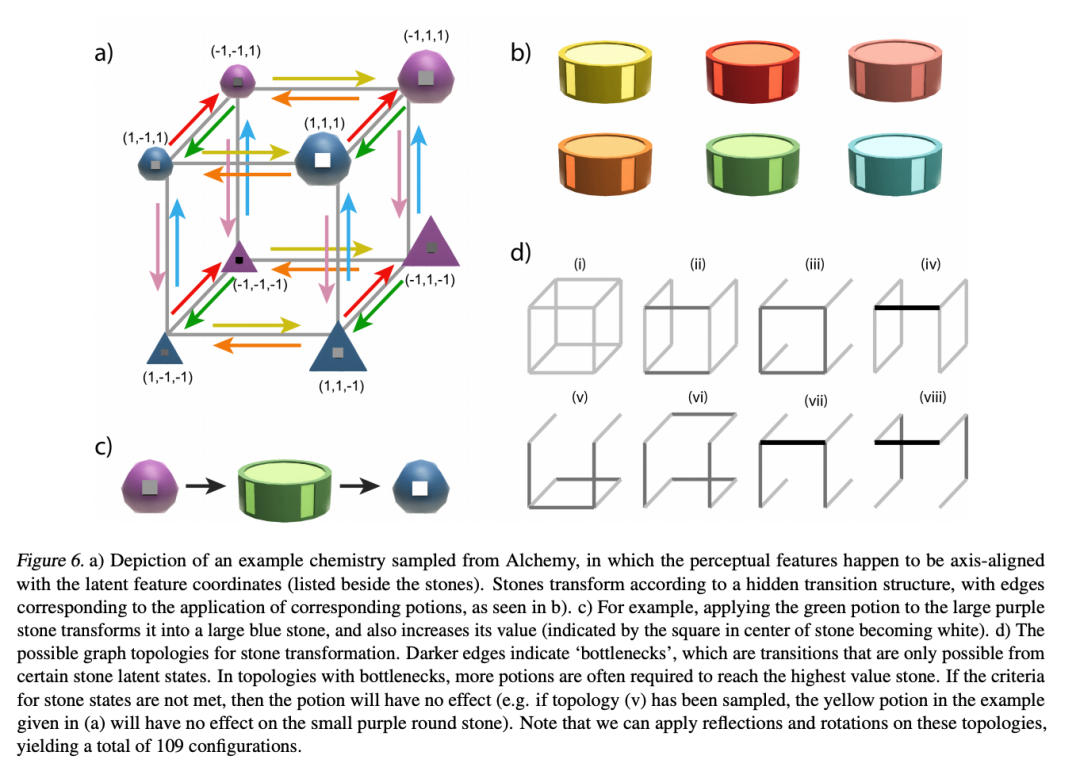

Alchemy是在Unity中实现的单人视频游戏。玩家可以看到桌子上的第一人称视角,桌子上有许多物体,包括一组彩色的石头,一组装有彩色药水的盘子和一个中央大锅。石头具有不同的点值,并且在将石头添加到大锅中时会收集点。通过将石头浸入魔药中,玩家可以改变石头的外观,从而改变它们的价值,从而增加可赢得的分数。

但是,Alchemy也涉及到一个至关重要的陷阱:每次玩游戏时,控制药水如何影响石头的“化学作用”都会改变。熟练的演奏者必须执行一组有针对性的实验,以发现当前化学反应的原理,并使用这些实验的结果来指导战略行动序列。在多轮Alchemy中学习如何做到这一点,正是meta-RL的挑战。

Alchemy具有“有趣”的结构,从某种意义上讲,它涉及潜在的因果关系组成的集合,并且需要策略性实验和动作排序。但是Alchemy的结构也是“可访问的”,因为游戏级别是根据明确的生成过程创建的。

通过创建可访问生成过程的贝叶斯最优求解器,这种可访问性使我们能够确定Alchemy中的最佳元学习性能。这种最佳试剂提供了宝贵的金标准,可与任何深层RL进行比较。

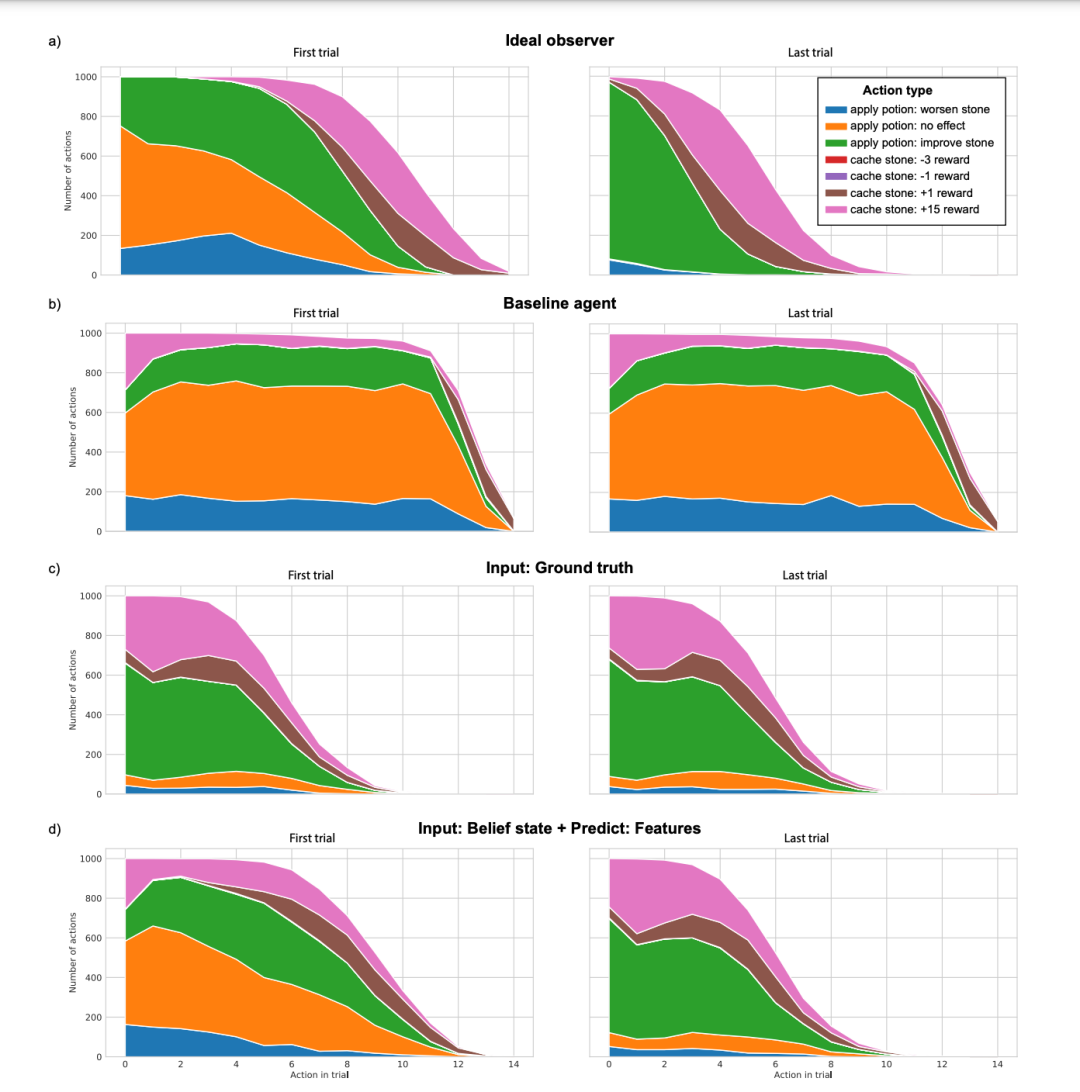

作为Alchemy的首次应用,作者将其介绍给了两种功能强大的深层RL智能体(IMPALA和V-MPO)。正如我们的论文中详细介绍的那样,尽管这些智能体在许多单任务RL环境中都表现良好,但在Alchemy中,它们都显示出非常差的元学习性能。即使经过大量的训练,两位特工的行为也仅反映了对任务的表面“理解”-本质上是将石头随机浸入药水中,直到碰巧产生了很高的石头价值。通过一系列详细的分析,我们能够确定元学习的失败不仅是由于3D环境的视觉运动挑战,也不是为了实现目标而对动作进行排序的难度。相反,智能体的糟糕表现特别反映了结构学习和潜伏状态推理的失败,这是元学习所涉及的核心功能。

开源代码初始化应用:

$ git clone https://github.com/deepmind/dm_alchemy.git

$ pip install wheel

$ pip install --upgrade setuptools

$ pip install ./dm_alchemy

# To also install the dependencies for the examples/, install with:

$ pip install ./dm_alchemy[examples]

Once dm_alchemy is installed, to instantiate a dm_env instance run the following:

import dm_alchemy

LEVEL_NAME = ('alchemy/perceptual_mapping_'

'randomized_with_rotation_and_random_bottleneck')

settings = dm_alchemy.EnvironmentSettings(seed=123, level_name=LEVEL_NAME)

env = dm_alchemy.load_from_docker(settings)

Blog: https://deepmind.com/research/publications/alchemy

Github: https://github.com/deepmind/dm_alchemy

Paper: https://arxiv.org/pdf/2102.02926.pdf

完

总结3: 《强化学习导论》代码/习题答案大全

总结6: 万字总结 || 强化学习之路

完

第98篇:全面总结(值函数与优势函数)的估计方法

第97篇:MuZero算法过程详细解读

第96篇: 值分布强化学习(Distributional RL)总结

第95篇:如何提高"强化学习算法模型"的泛化能力?

第94篇:多智能体强化学习《星际争霸II》研究

第93篇:MuZero在Atari基准上取得了新SOTA效果

第91篇:详解用TD3算法通关BipedalWalker环境

第88篇:分层强化学习(HRL)全面总结

第85篇:279页总结"基于模型的强化学习方法"

第84篇:阿里强化学习领域研究助理/实习生招聘

第83篇:180篇NIPS2020顶会强化学习论文

第81篇:《综述》多智能体强化学习算法理论研究

第80篇:强化学习《奖励函数设计》详细解读

第79篇: 诺亚方舟开源高性能强化学习库“刑天”

第77篇:深度强化学习工程师/研究员面试指南

第75篇:Distributional Soft Actor-Critic算法

第74篇:【中文公益公开课】RLChina2020

第73篇:Tensorflow2.0实现29种深度强化学习算法

第72篇:【万字长文】解决强化学习"稀疏奖励"

第71篇:【公开课】高级强化学习专题

第70篇:DeepMind发布"离线强化学习基准“

第66篇:分布式强化学习框架Acme,并行性加强

第65篇:DQN系列(3): 优先级经验回放(PER)

第64篇:UC Berkeley开源RAD来改进强化学习算法

第61篇:David Sliver 亲自讲解AlphaGo、Zero

第59篇:Agent57在所有经典Atari 游戏中吊打人类

第58篇:清华开源「天授」强化学习平台

第57篇:Google发布"强化学习"框架"SEED RL"

第53篇:TRPO/PPO提出者John Schulman谈科研

第52篇:《强化学习》可复现性和稳健性,如何解决?

第51篇:强化学习和最优控制的《十个关键点》

第50篇:微软全球深度强化学习开源项目开放申请

第49篇:DeepMind发布强化学习库 RLax

第48篇:AlphaStar过程详解笔记

第47篇:Exploration-Exploitation难题解决方法

第45篇:DQN系列(1): Double Q-learning

第44篇:科研界最全工具汇总

第42篇:深度强化学习入门到精通资料综述

第41篇:顶会征稿 || ICAPS2020: DeepRL

第40篇:实习生招聘 || 华为诺亚方舟实验室

第39篇:滴滴实习生|| 深度强化学习方向

第37篇:Call For Papers# IJCNN2020-DeepRL

第36篇:复现"深度强化学习"论文的经验之谈

第35篇:α-Rank算法之DeepMind及Huawei改进

第34篇:从Paper到Coding, DRL挑战34类游戏

第31篇:强化学习,路在何方?

第30篇:强化学习的三种范例

第29篇:框架ES-MAML:进化策略的元学习方法

第28篇:138页“策略优化”PPT--Pieter Abbeel

第27篇:迁移学习在强化学习中的应用及最新进展

第26篇:深入理解Hindsight Experience Replay

第25篇:10项【深度强化学习】赛事汇总

第24篇:DRL实验中到底需要多少个随机种子?

第23篇:142页"ICML会议"强化学习笔记

第22篇:通过深度强化学习实现通用量子控制

第21篇:《深度强化学习》面试题汇总

第20篇:《深度强化学习》招聘汇总(13家企业)

第19篇:解决反馈稀疏问题之HER原理与代码实现

第17篇:AI Paper | 几个实用工具推荐

第16篇:AI领域:如何做优秀研究并写高水平论文?