快截稿了,怎么写好你的NeurIPS2022论文?牛津大学副教授Jakob倾心讲解《写好一篇机器学习顶会论文》关键要点,必看!

以下文章来源于专知。

NeurIPS2022马上截稿了! 如何提高论文命中率,牛津大学副教授Jakob倾心讲解《写好机器学习顶会论文》关键要点,必看!

规范ML论文结构

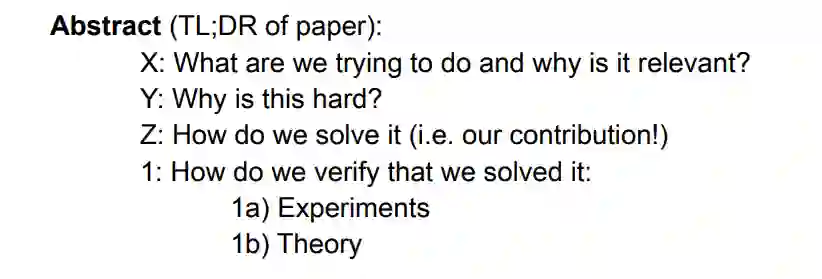

1. 摘要 (TL; 论文DR):

X: 我们想要做什么?为什么它是相关的?

Y: 为什么这么难?

Z: 我们怎么解决(也就是我们的贡献!)

1: 我们如何验证我们解决了它:

1a)实验

1 b)理论

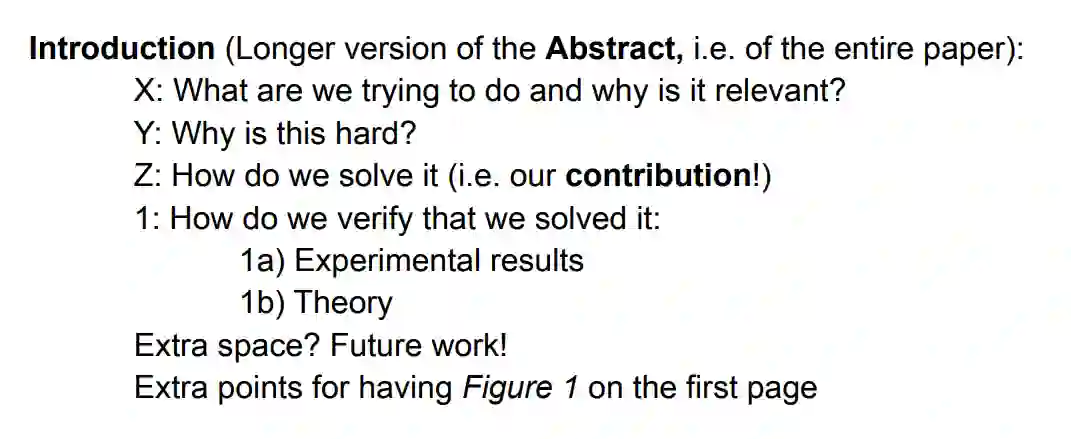

2. 引言 (摘要的长版本,即全文):

X:我们想要做什么?为什么它是相关的?

Y:为什么这么难?

Z:我们怎么解决(也就是我们的贡献!)

1:我们如何验证我们解决了它:

1)实验结果

1 b)理论

额外的空间吗?未来的工作!

在第一页上有图1是额外的要点

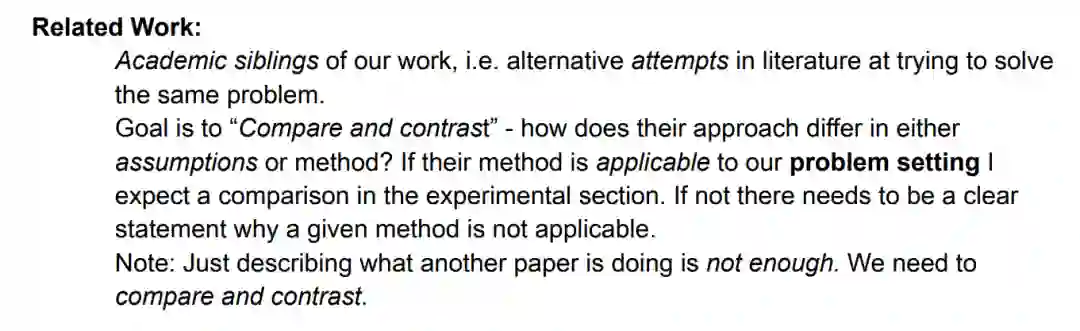

3. 相关工作

我们的学术相关工作,也就是在文献中尝试解决相同的问题。

目标是“比较和对比”——他们的方法在假设或方法上有何不同?如果他们的方法适用于我们的问题设置,我希望在实验部分进行比较。如果不是,就需要明确说明为什么给定的方法不适用。

注意: 仅仅描述另一篇论文正在做什么是不够的。我们需要比较和对比。

4. 背景介绍

我们工作的学术起源,即理解我们的方法所需的所有概念和之前的工作。包括一小节的问题设置,正式介绍问题设置和符号(形式主义)为我们的方法。强调任何不寻常的特定假设。

我们如何验证我们的东西是否有效? 要给出了这个问题设置的具体实例和我们的方法的具体实现细节。

7. 结果和讨论:

展示在实验设置中我们所描述的问题上运行方法的结果。与相关工作中提到的Baseline进行比较。包括统计数据和置信区间。包括关于超参数和其他潜在的公平问题的声明。包括消融研究,以表明具体部分的方法是相关的。讨论该方法的局限性。

从提纲开始,而不是全文。每一行将对应于最终版本中的一个段落。在建造一座建筑之前改变它的轮廓要容易得多。如果你不确定的话,这是和别人交谈的好时机。接下来,展开大纲,但将摘要文本作为Latex注释放在每个段落之前。这将使你保持在正确的方向上,并使任何提供反馈的人能够更容易地快速了解整个流程。

最常见的写作“坑”和其他建议

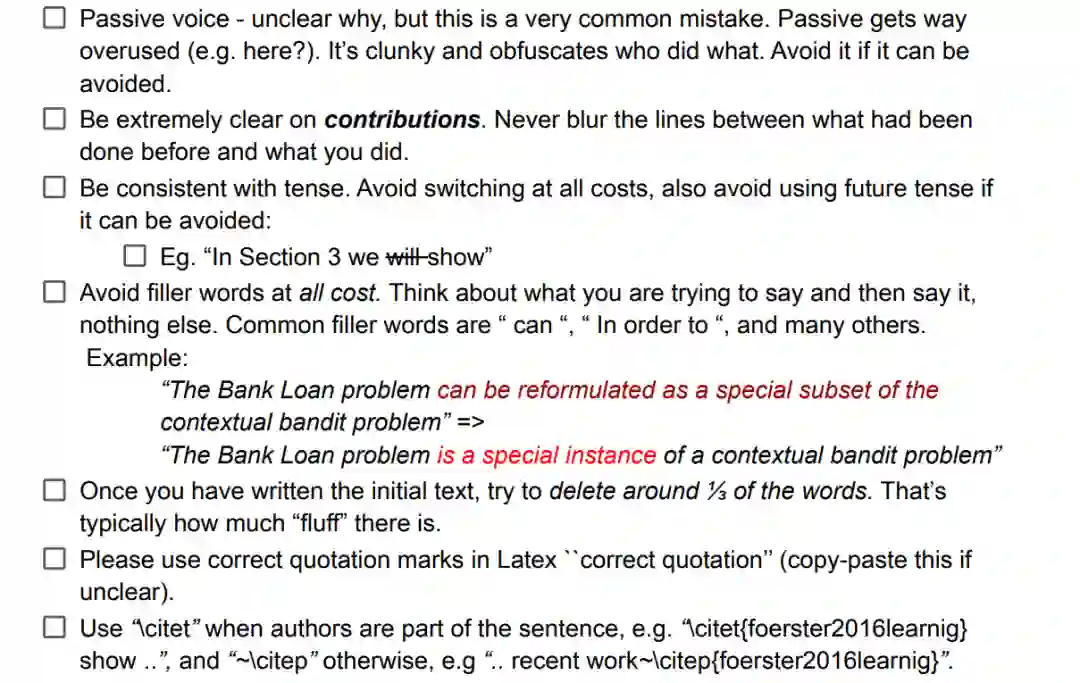

被动语态——不清楚为什么,但这是一个很常见的错误。被动被过度使用了(比如这里?)它既笨拙又模糊了谁做了什么。如果可以避免,就尽量避免。

要非常清楚自己的贡献。永远不要混淆以前做过的事和你做过的事之间的界限。

时态要一致。无论如何都要避免转换,如果可以避免的话,也要避免使用将来时。"In Section 3 we will show"

尽量避免使用填充词。想想你想说什么,然后说出来,别想别的。常见的填充词有“can”、“In order to”等。示例:“The Bank Loan problem can be reformulated as a special subset of the contextual bandit problem”=>“The Bank Loan problem is a special instance of a contextual bandit problem”

写完开头的文字后,试着删除三分之一的单词。这是典型的“绒毛”数量。

请在Latex中使用正确的引号“正确的引号”(如果不清楚,可以复制粘贴)。

当作者是句子的一部分时,使用“\citet”,例如“\citet{foerster2016learnig} show ..”,以及“~\citep”,否则,例如“..”最近的工作~ \ citep {foerster2016learnig}”。

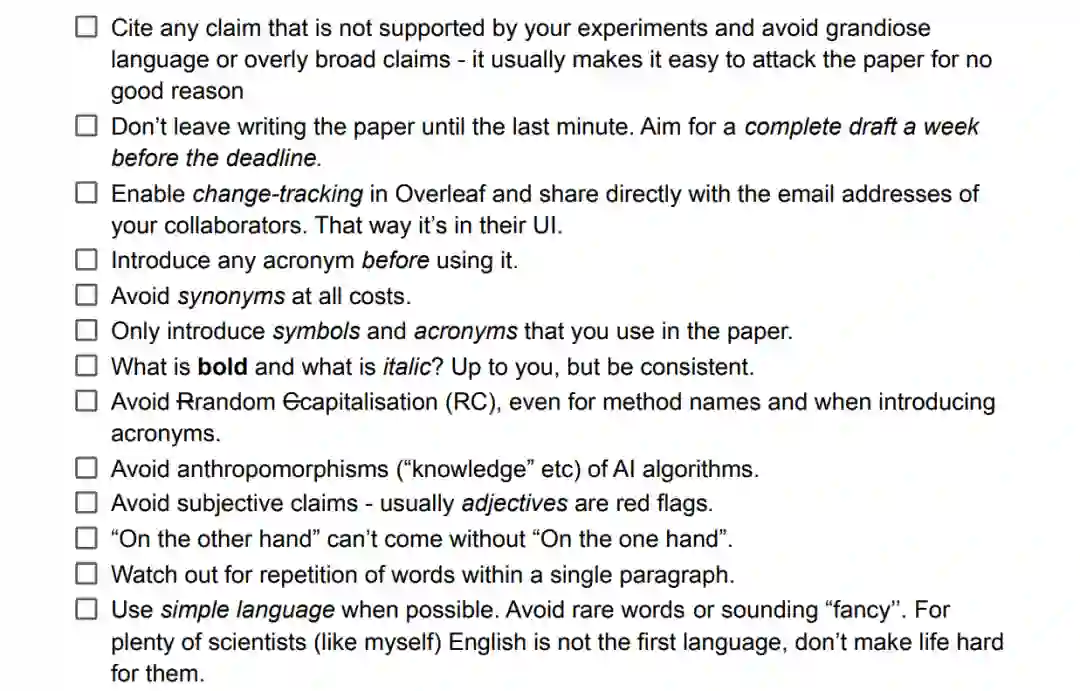

引用任何不被你的实验支持的观点,避免浮夸的语言或过于宽泛的观点——这通常会让你很容易毫无理由地攻击这篇论文

不要把写论文留到最后一分钟。目标是在截止日期前一周完成一份完整的草稿。

在Overleaf中启用更改跟踪,并直接与您的协作者的电子邮件地址共享。这样它就在UI中了

在使用首字母缩略词之前介绍它。

尽量避免同义词。

只介绍你在论文中使用的符号和首字母缩写。

什么是粗体,什么是斜体?这取决于你,但是要始终如一。

避免使用随机大写(RC),即使是方法名和引入首字母缩写时也是如此。

避免人工智能算法的拟人化(“知识”等)。

避免主观主张——通常形容词是危险信号。

“On the other hand”不能没有“On the one hand”。

注意在一段话中单词的重复。

尽可能使用简单的语言。避免使用罕见的词或听起来“花哨”。对于很多科学家(比如我自己)来说,英语不是他们的第一语言。

永远不要复制粘贴其他论文,除非你是逐字引用。

从头开始编写代码要比修改代码更容易(也更合乎道德!)。

最后,与所有的作者进行大量的沟通(即,至少在最后一周每天),以保持正确的方向并享受乐趣!!

更多推荐

ACL 2022 主会长文论文分类整理

SIGIR2022|推荐系统相关论文分类整理

稠密检索模型的zero-shot能力究竟如何?