DiffuserCam——一款不需要光学透镜的低成本光场相机

回顾2017年,光场这个词可以说是不断地刷着存在感,每当这时我就很开心,又有东西可以写了。

毕竟是站在科技最前沿的技术,应用光场技术的产品总是让人感到满满的科技感

以及前些日子刷屏的Magic Leap One。

关于显示器已经说过不少了,今天我们换一个方向——光场信息的采集。

光场相机

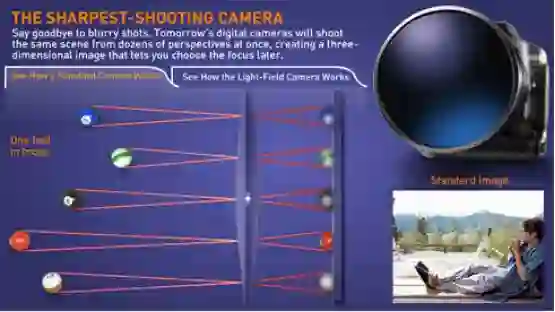

普通摄像机只能记录在某一个特定的空间位置观察对象时,落在感光器上的光线。而光场,是穿过某一个区域所有的光线,在不同的观察点获取的光线的角度、强度均有变化。

普通相机获取的图片获取的是2D信息,是在某个定点,某一个时间点上的确定焦点的二维图。空间环境则是由无数个这样的二维平面叠加而成的,叠加的过程要包含各个焦点在特定的时刻、空间位置关系,而光场,就是要真实的记录跟复原模拟出来这个空间。

为了记录光场信息,需要光场相机。

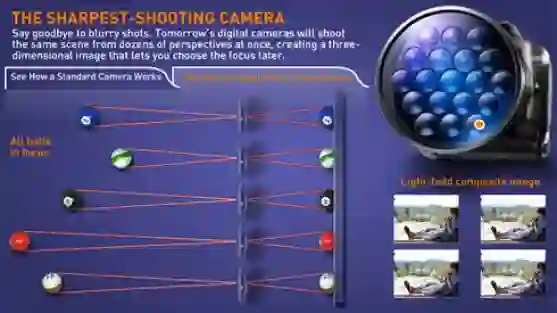

主流的光场相机方案通过排列大量的相机,在不同的位置获取不同角度的场景图像,从而获得四位光场。

比方说去年年底由Lytro推出的,专为高端VR制作而设计的Immerge 2.0阵列相机

Lytro也有小型化的手持产品,对这类小尺度的光场相机,采用的是微透镜阵列方案。

现有的光场获取方式,往往需要扫描和拍摄多次来实现空间高分辨率,会牺牲捕捉的速度。并且需要复杂的硬件,大部分的成像设备体型笨重,而且昂贵。

近日,在美国加州伯克利,一款名为DiffuseCam的新相机发布,可以在不使用任何镜头的情况下,不经扫描地从2D图像创建3D图像。

据研究人员介绍,相机最初旨在监视小鼠的微神经元活动。由于光场相机的特性,研究人员可以识别三维形式的对象,并且允许观察者重新聚焦于对象。

不过基于微透镜阵列的显微镜十分昂贵,于是他们考虑是否可以设计一种简单廉价的光场相机方案。

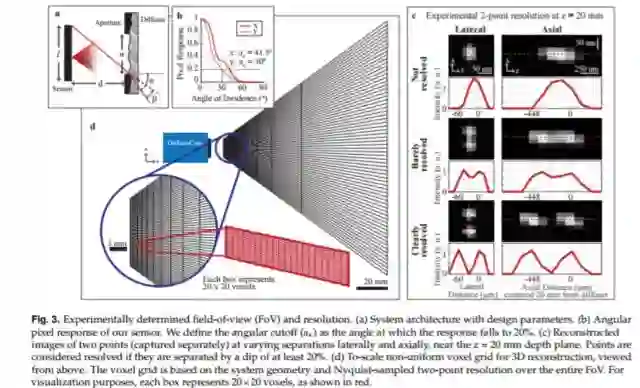

DiffuserCam的结构很简单,由一个普通的图形传感器和扩散器组成,而没有任何的光学透镜。

所谓的扩散器是一种凹凸不平的透明薄膜,当一个非相干光源离传感器足够远的时候,扩散器表面凹凸不平的结构会将光线按照一定方式透射,被传感器捕捉。

扩散器代替的是昂贵的微透镜阵列,通过精心设计的算法,让凹凸不平的塑料薄片发挥出相似的功能。不过由于凹凸不平的排布是随机的,所以在成像之前必须矫正软件。

DiffuserCam的物理结构很简单,容易制作,软件则很复杂,不过也易于复制到不同的设备上,方便使用者自行设计使用。在一次校准之后,使用算法来计算地重建3D图像,3D重构的过程相当于在一定的先验下对线性方程求逆。

DiffuserCam采用相对便宜和廉价的硬件,相当于一种对微透镜阵列相机的简化版,在减小成本的同时也减小了体积,可以在更多微型的环境中使用——比如嵌入生物体内观察神经元的活动。

而在更多方面,DiffuserCam这种简化版的光场相机还会有更多的应用,比如自动驾驶领域,光场相机能够使机器探测到物体有多远,会让机器更好地理解周围的世界。而对AR/VR而言,光场相机提供的深度信息有助于改进对现实世界场景的渲染,以及将现实与虚拟场景之间更好的结合。低成本的光场相机或许能让光场技术造福更多领域。

阅读推荐