【NeurIPS2020教程】深度学习的不确定性估计和鲁棒性,109页ppt

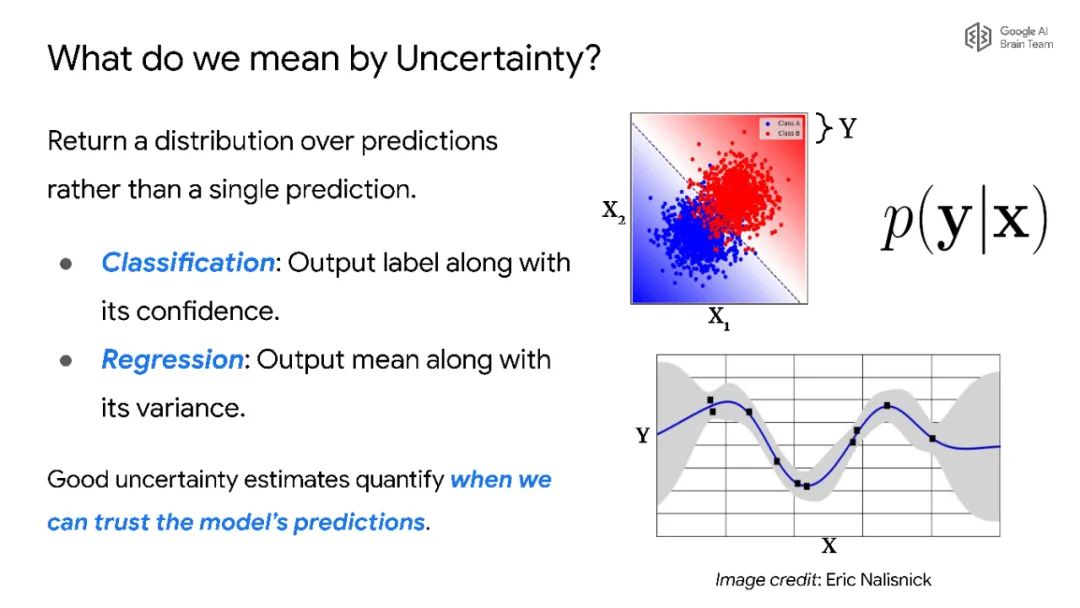

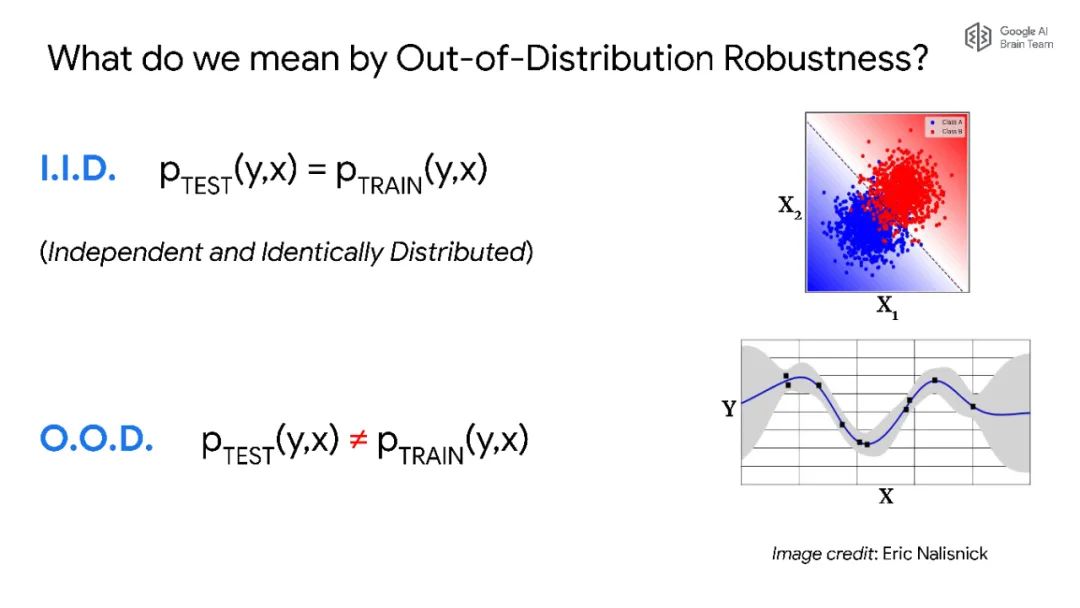

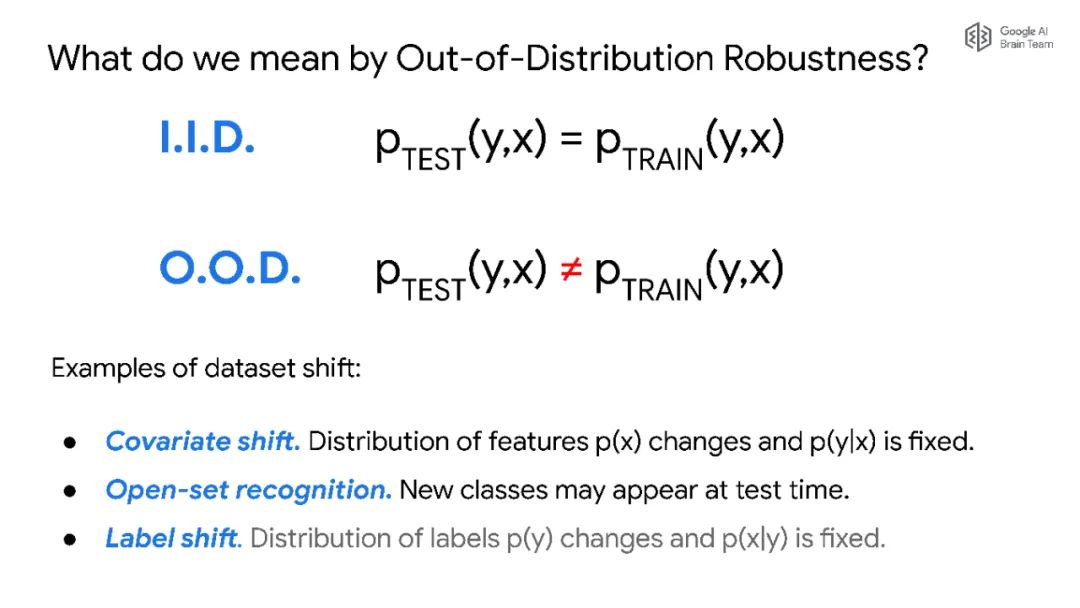

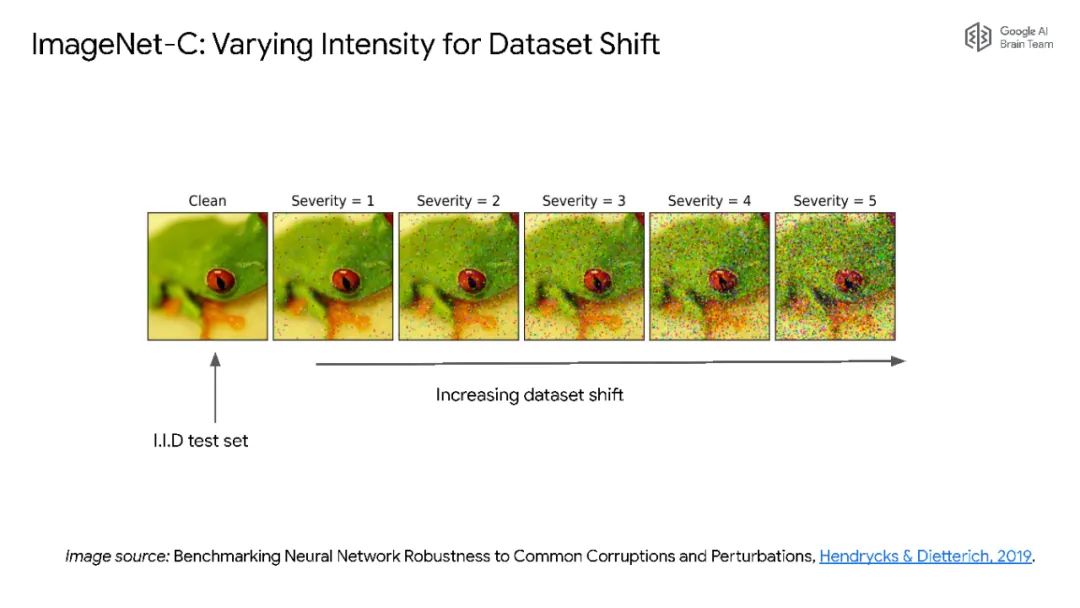

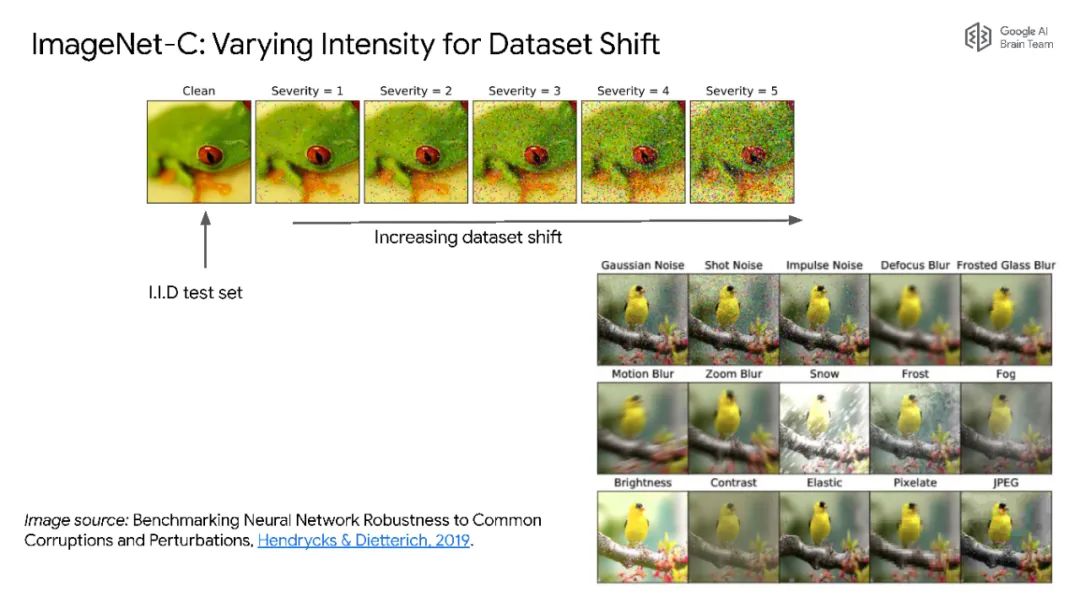

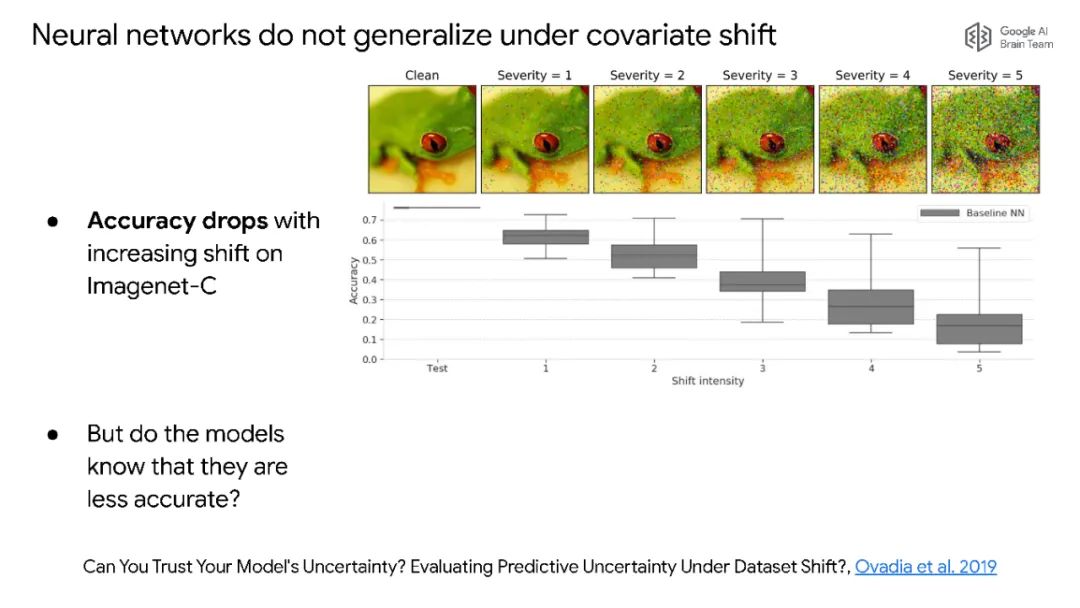

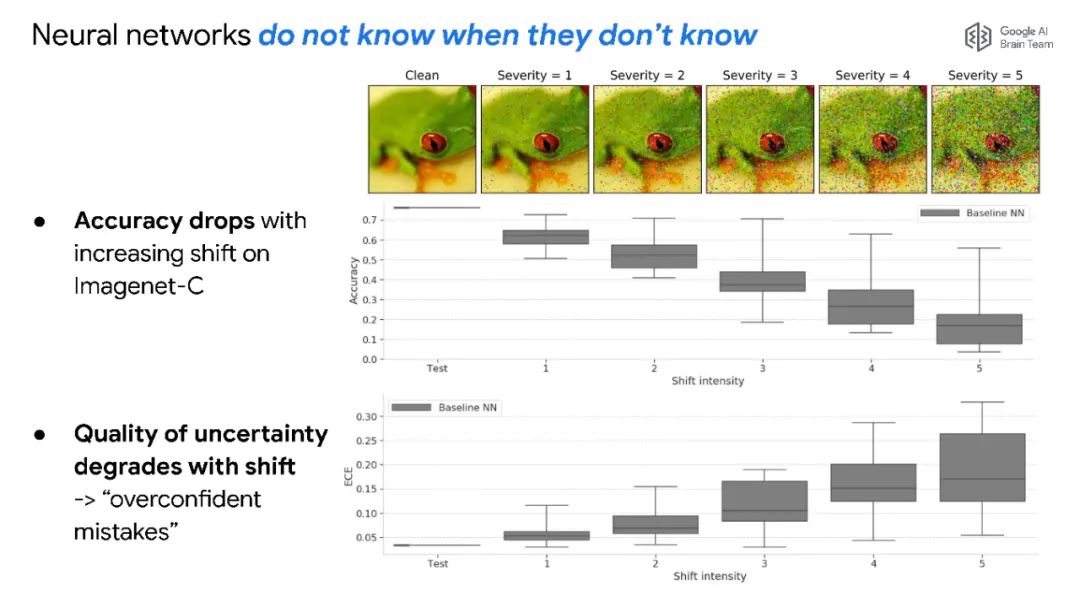

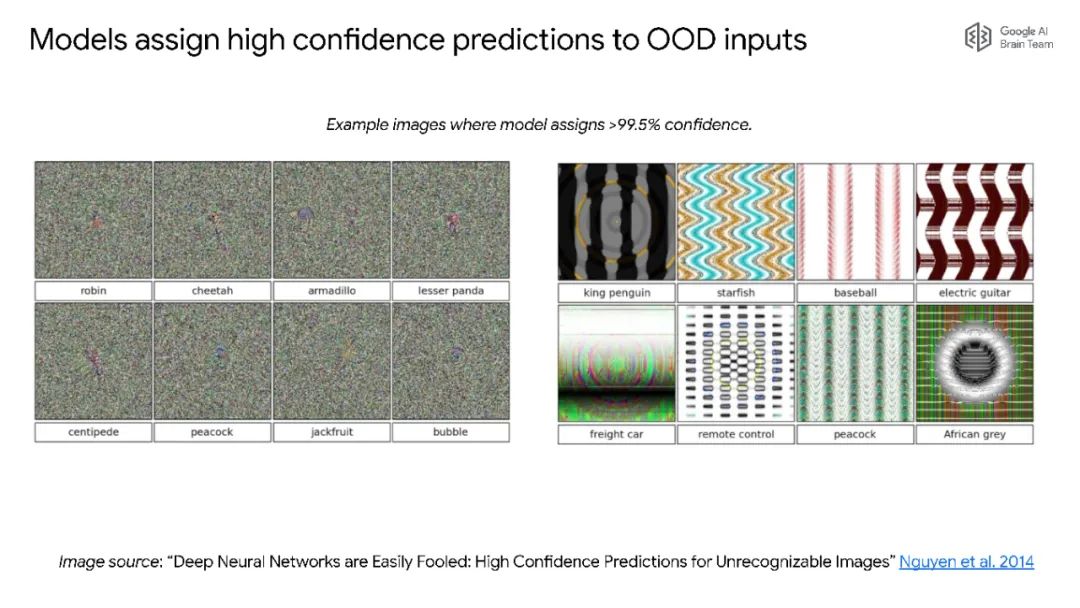

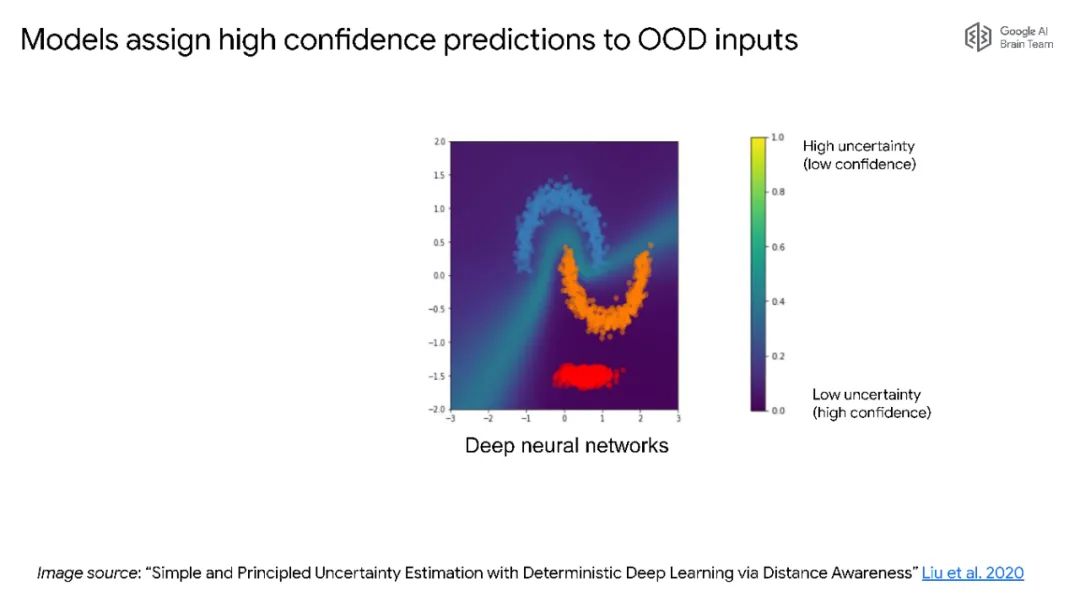

深度学习模型在分布外预测方面表现不佳: 它们往往做出高置信预测,这在现实世界的应用中是有问题的,比如医疗保健、自动驾驶汽车和自然语言系统,或者在训练数据和模型预测所依据的数据之间存在差异的情况下,这些应用存在相当大的安全隐患。现在迫切需要了解模型何时不应该进行预测,以及改进模型对数据中自然变化的健壮性。本教程将对深度学习中的不确定性和健壮性进行概述。也就是说,我们检查校准和非分布泛化作为关键任务。然后,我们将深入探讨有希望的途径。这包括平均多个神经网络预测的方法,如贝叶斯神经网络、集成、和高斯过程;在总体参数或预测时间效率方面处于尺度前沿的方法 ;以及鼓励诱导偏差的方法,如数据增强。我们将这些想法建立在经验理解和理论的基础上,并通过基准和技巧提供实际的建议。最后,我们强调该领域的开放挑战。

https://nips.cc/Conferences/2020/Schedule?showEvent=16649

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“UER” 就可以获取《【NeurIPS2020教程】深度学习的不确定性估计和鲁棒性,109页ppt》专知下载链接

登录查看更多

相关内容

Arxiv

59+阅读 · 2020年1月20日