波士顿动力机器人跑酷揭秘!不用动捕和特效,凭借感知和适应技能完成动作

来源:量子位

本文约658字,建议阅读2分钟

本文

介绍

了9月1日 19:30~20:30举办的沈志强博士主题分享,欢迎扫码观看直播。

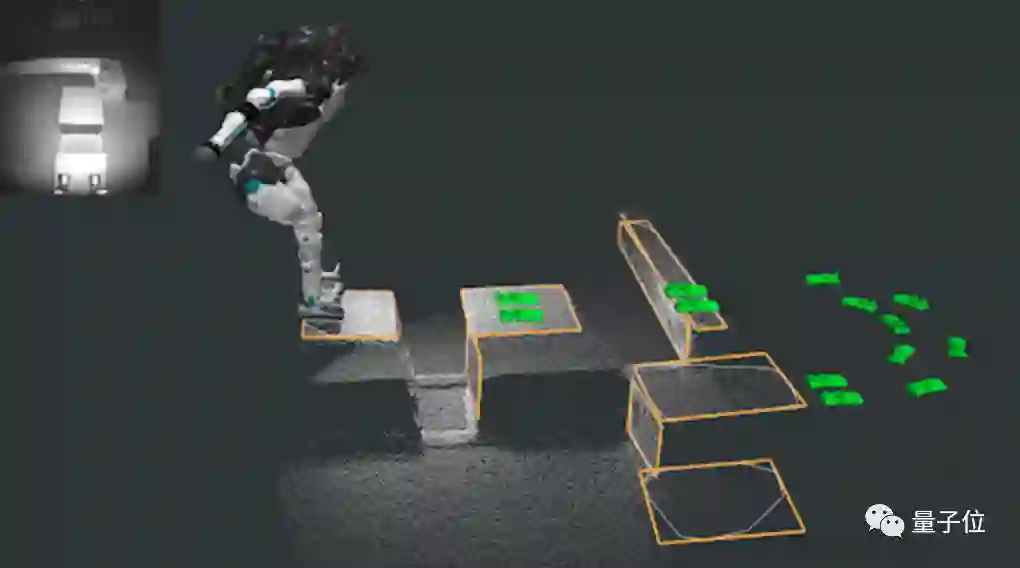

机器人眼中的跑酷世界

“看”不到远处的障碍物

预设动作,但无须预设细节

[1]https://blog.bostondynamics.com/flipping-the-script-with-atlas

[2]https://www.youtube.com/watch?v=EezdinoG4mk

登录查看更多

相关内容

专知会员服务

104+阅读 · 2019年10月22日

Arxiv

0+阅读 · 2022年4月19日

Arxiv

0+阅读 · 2022年4月18日