最优传输理论和生成模型的几何观点

©PaperWeekly 原创 · 作者|尹娟

学校|北京理工大学博士生

研究方向|随机过程、复杂网络

论文标题:A Geometric View of Optimal Transportation and Generative Model

论文链接:https://arxiv.org/abs/1710.05488

引言

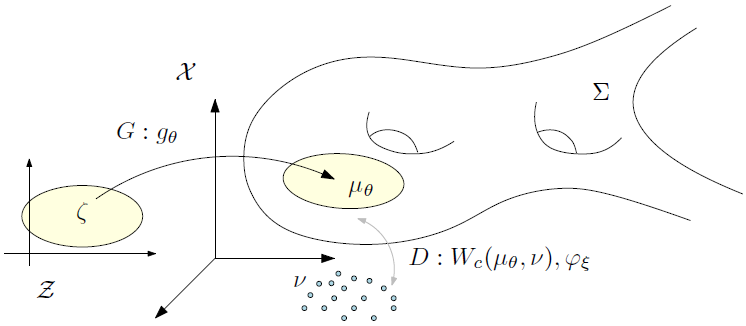

最优传输理论具有数百年的历史,随着人工智能的发展浪潮,特别是深度学习的勃然兴起,最优传输理论再度焕发了新春!根据深度学习的流形分布定律:一类自然数据可以被视作高维背景空间中的低维数据流形上的一个概率分布,深度学习的主要任务包括两个:学习流形结构和表示概率分布。

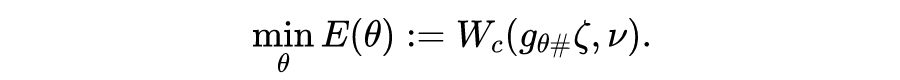

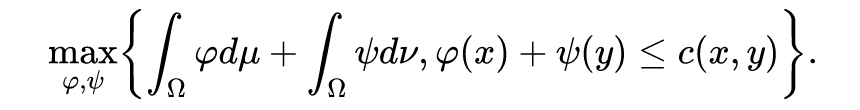

作者在这篇论文中展示了最优传输和凸几何之间的内在关系,特别是解决亚历山大问题的变分方法:构造一个具有规定面法线和体积的凸多面体。这导致了生成模型的几何解释,并导出了生成模型的新框架。

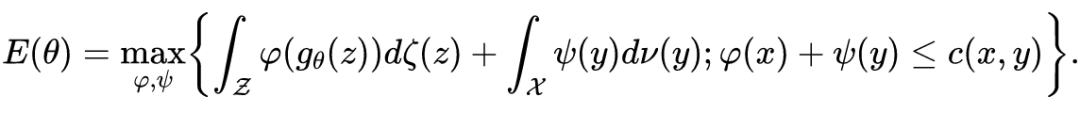

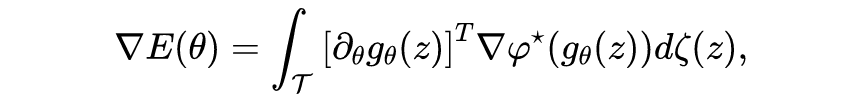

通过使用 GAN 模型的最优运输视图,我们展示了鉴别器计算了康塔洛维奇势能函数,生成器计算了运输图。对于一类较大的运输成本,康塔洛维奇势能函数可以通过一个近似公式给出最优运输图。

-

作者将凸几何与最优运输结合起来,然后使用最优运输分析生成模型。 -

对最优运输图进行明确的几何解释,并将其应用于生成模型。 -

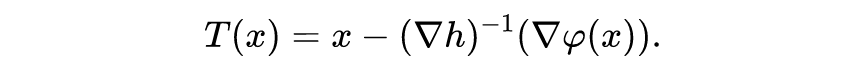

如果代价函数 ,其中 是严格凸函数,则一旦得到最优鉴别器,则生成器器可以用显式表示。 -

提出了一种新的生成模型框架,该模型采用最优运输图的几何构造。

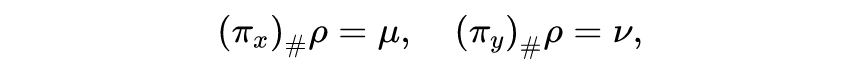

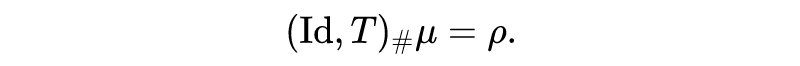

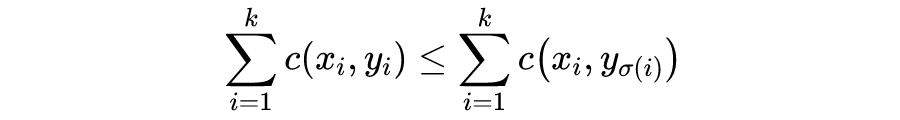

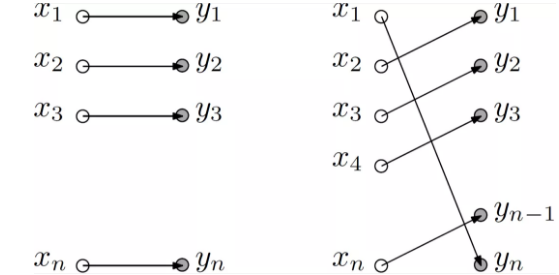

4.2 最优传输理论

定理给出了 Wasserstein distance(康塔洛维奇势能函数)与最优传输图(Brenier 势)之间的内在关系,说明一旦已知最优鉴别器,就自动得到最优生成器。鉴别器和生成器之间的游戏是不必要的。

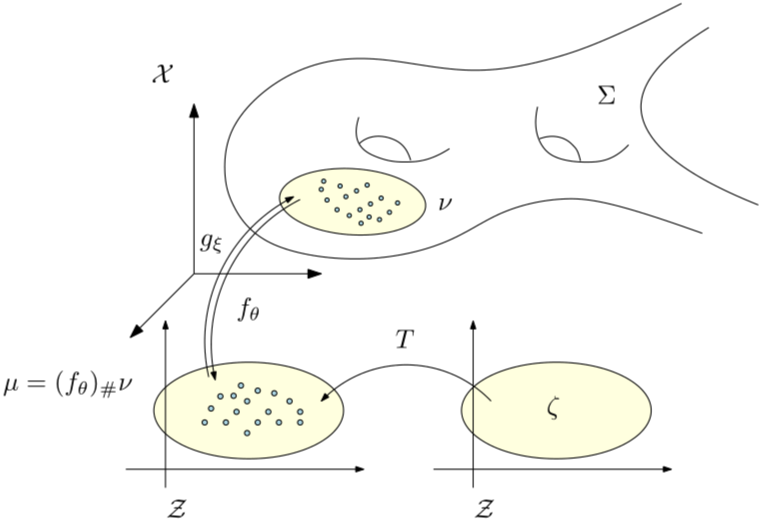

4.3 几何生成模型

-

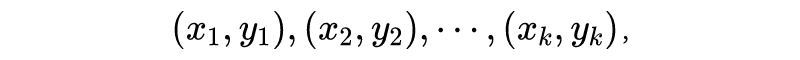

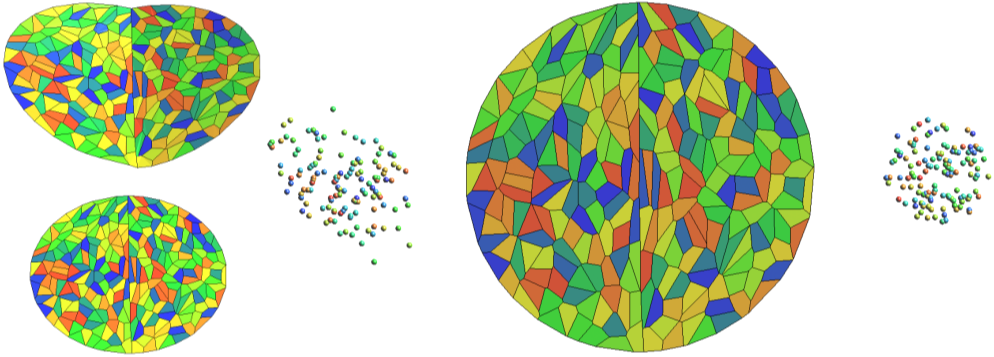

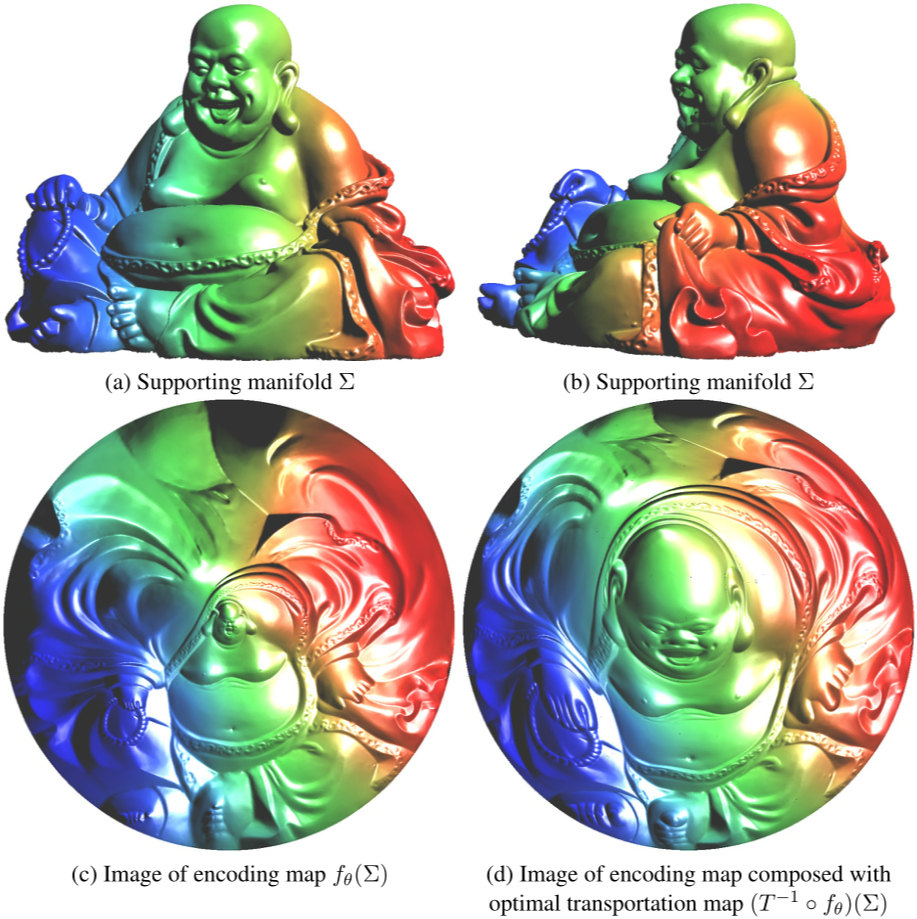

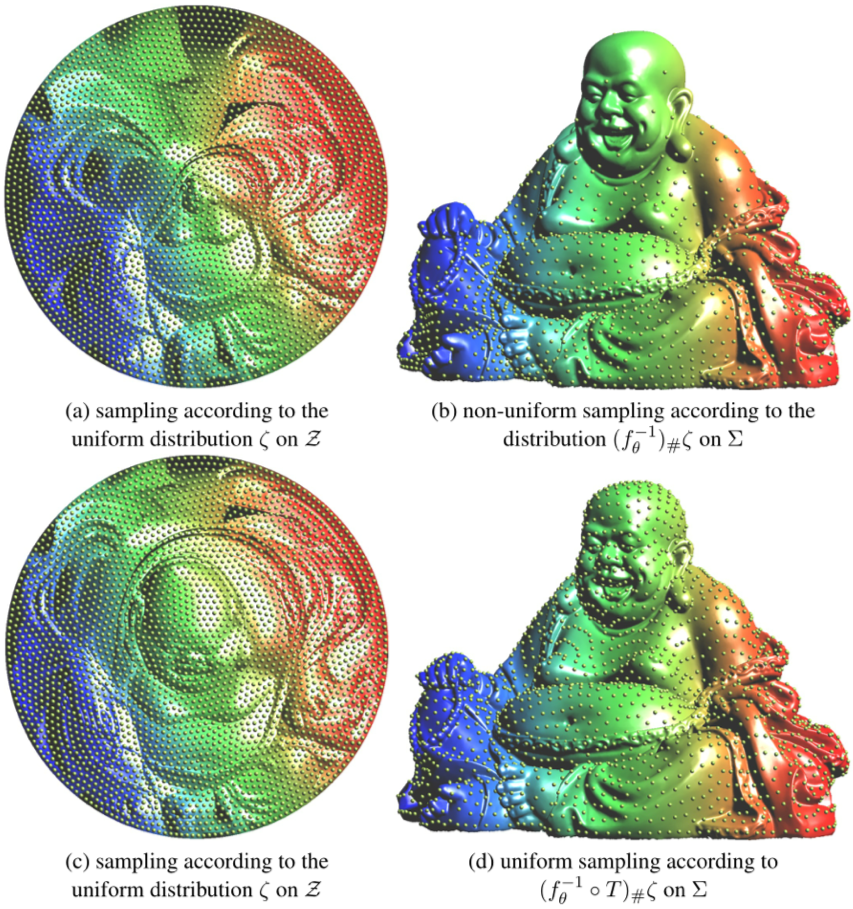

编码/解码过程:这一步地图之间的样本图像空间 和潜在(特性)空间 利用深层神经网络编码映射来标示 ,解码地图 。 -

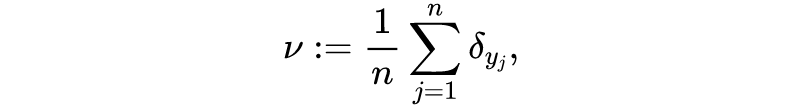

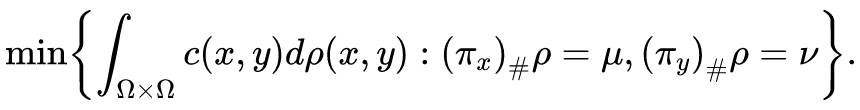

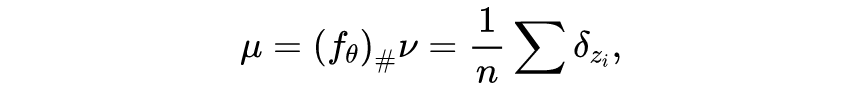

概率测度变换过程:将一个固定分布点 变换为任意给定的分布点 。映射记为: 这一步可以使用传统的深度神经网络或使用显式几何/数值方法。

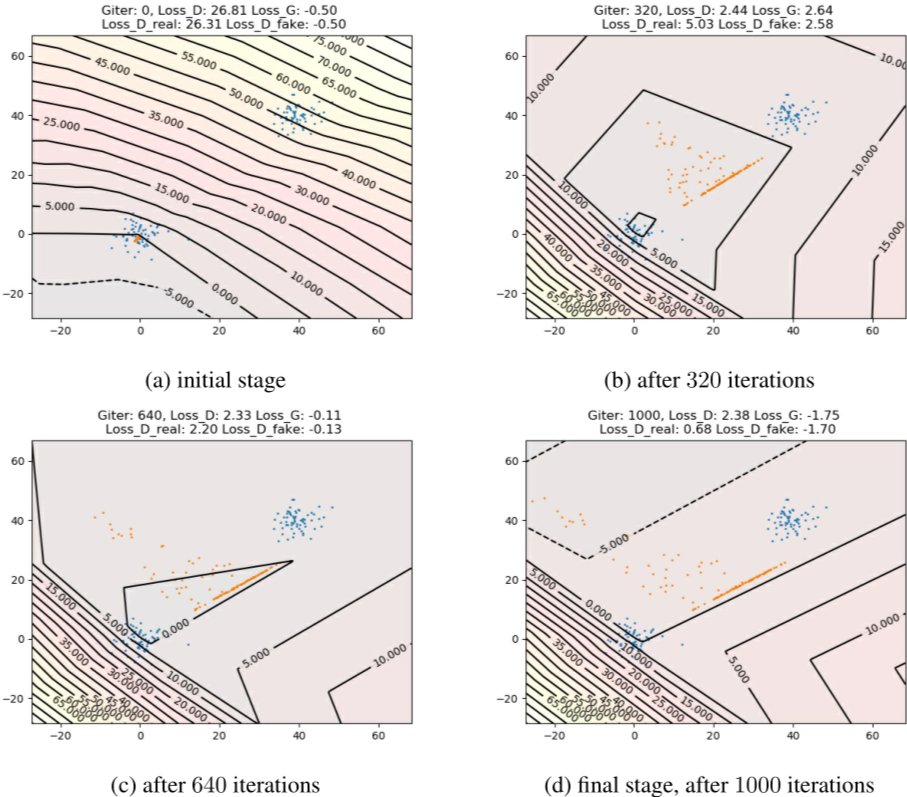

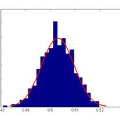

蓝色的点代表真实的数据分布,橙色的点代表生成的分布。左边为初始阶段,右边为迭代 1000 次后的阶段。似乎 WGAN 不能捕捉高斯混合分布。生成的数据往往位于两个高斯函数的中间。

原因之一是 GAN 中众所周知的模式崩溃问题,即如果数据分布有多个簇或分布在多个孤立的流形中,那么生成器很难很好地学习多个模式。

总结讨论

在此工作中,作者将凸几何与最优运输连接起来,然后使用最优运输分析生成模型。对于高维设置,由于维护了复杂的几何数据结构,因此严格的计算几何方法来计算最优传输图是很棘手的。

参考文献

[1] Martin Arjovsky, Soumith Chintala, and Léon Bottou. Wasserstein generative adversarial networks. [*In International Conference on Machine Learning*]{}, pages 214–223, 2017.

更多阅读

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。