Facebook开源PyTorch版本fairseq翻译模型,训练速度提高50%

新智元编译

来源:github

编译:neko

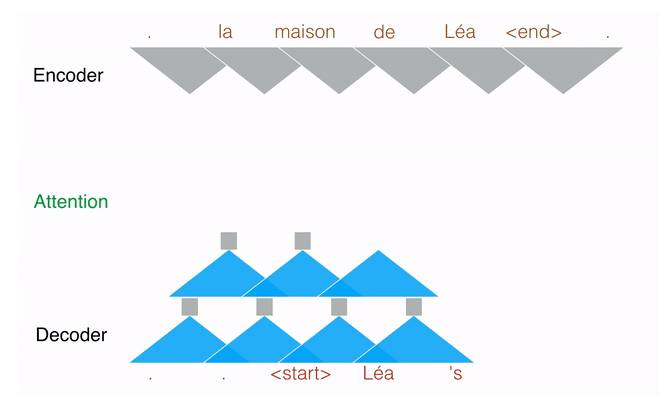

【新智元导读】FAIR的开源序列到序列(sequence-to-sequence)引擎现在可以在PyTorch使用了。FAIR今天发布了fairseq-py,这是一个用PyTorch实现的卷积seq2seq模型。fairseq-py是语言翻译以及其他 seq2seq 的NLP任务的一个很好的模型,新的工具包比以前的更高效率:生成翻译的速度比以前的提高了80%,训练速度提高了50%。

今年5月10日,Facebook AI 研究实验室(FAIR)发布了一项使用创新性的、基于卷积神经网络的方法来进行语言翻译的最新成果。Facebook 称,该研究取得了截止目前最高准确度,并且速度是基于循环神经网络(RNN)系统的9倍(谷歌的机器翻译系统使用的就是这一技术)。

今天开源的是一个PyTorch版本的fairseq。这个重新实现的原作者是Sergey Edunov,Myle Ott和Sam Gross。该工具包实现了 Convolutional Sequence to Sequence Learning(https://arxiv.org/abs/1705.03122)中描述的完全卷积模型(fully convolutional model),在单个机器上实现多GPU训练,并在CPU和GPU上实现快速 beam search 生成。我们提供英语到法语和英语到德语翻译的预训练模型。

引用

如果要在论文中使用这些代码,请按如下格式引用:

@inproceedings{gehring2017convs2s, author = {Gehring, Jonas, and Auli, Michael and Grangier, David and Yarats, Denis and Dauphin, Yann N}, title = "{Convolutional Sequence to Sequence Learning}", booktitle = {Proc. of ICML}, year = 2017, }要求和安装步骤

运行macOS或Linux的计算机

为了训练新模型,你还需要一个NVIDIA GPU和NCCL

Python 3.6

PyTorch安装

目前,Fairseq-py需要GitHub库里的PyTorch。有多种安装方式,我们建议使用Miniconda3并按照说明安装:

从 https://conda.io/miniconda.html 安装 Miniconda3; 创建并激活Python 3环境。

安装PyTorch:

conda install gcc numpy cudnn nccl

conda install magma-cuda80 -c soumith

pip install cmake

pip install cffi

git clone https://github.com/pytorch/pytorch.git

cd pytorch

git reset --hard a03e5cb40938b6b3f3e6dbddf9cff8afdff72d1b

git submodule update --init

pip install -r requirements.txt

NO_DISTRIBUTED=1 python setup.py installClone GitHub 存储库并运行以下命令安装fairseq-py:

pip install -r requirements.txt

python setup.py build

python setup.py develop快速开始

以下命令行工具可用:

python preprocess.py:数据预处理:构建词汇和二进制训练数据

python train.py:在一个或多个GPU上训练新模型

python generate.py:用训练好的模型翻译预处理的数据

python generate.py -i:使用训练好的模型翻译原始文本

python score.py:根据参考翻译对生成的翻译进行BLEU评分

评估预训练的模型

首先,下载一个预训练的模型及其词汇:

$ curl https://s3.amazonaws.com/fairseq-py/models/wmt14.en-fr.fconv-py.tar.bz2 | tar xvjf -该模型使用字节对编码(BPE)词汇表,因此我们必须将该编码应用于源文本才能进行翻译。这可以通过使用wmt14.en-fr.fconv-cuda / bpecodes文件的apply_bpe.py脚本完成。@@ 用作连续标记,用 sed s / @@ // g 或将 --remove-bpe 标志传递给generate.py,原始文本可以很容易地恢复。在BPE之前,输入文本需要使用mosesdecoder中的tokenizer.perl进行标记化。

让我们使用python generate.py -i来生成翻译。在这里,我们使用beam的大小是5:

$ MODEL_DIR=wmt14.en-fr.fconv-py

$ python generate.py -i \

--path $MODEL_DIR/model.pt $MODEL_DIR \

--beam 5

| [en] dictionary: 44206 types

| [fr] dictionary: 44463 types

| model fconv_wmt_en_fr

| loaded checkpoint /private/home/edunov/wmt14.en-fr.fconv-py/model.pt (epoch 37)

> Why is it rare to discover new marine mam@@ mal species ?

S Why is it rare to discover new marine mam@@ mal species ?

O Why is it rare to discover new marine mam@@ mal species ?

H -0.08662842959165573 Pourquoi est-il rare de découvrir de nouvelles espèces de mammifères marins ?

A 0 1 3 3 5 6 6 10 8 8 8 11 12生成脚本产生四种类型的输出:以S为前缀的行显示了应用词汇表后提供的源语句(source sentence); O是原始来源句的副本(original source sentence); H是平均 log-likelihood以外的假设(hypothesis); 而A是假设中每个单词的注意力最大值( attention maxima),包括文本中省略的句末标记。

下面是预训练模型列表。

数据预处理

Fairseq-py源码分发包含了一个用于IWSLT 2014德语 - 英语语料库的预处理脚本示例。预处理和二值化数据如下:

$ cd data/

$ bash prepare-iwslt14.sh

$ cd ..

$ TEXT=data/iwslt14.tokenized.de-en

$ python preprocess.py --source-lang de --target-lang en \

--trainpref $TEXT/train --validpref $TEXT/valid --testpref $TEXT/test \

--thresholdtgt 3 --thresholdsrc 3 --destdir data-bin/iwslt14.tokenized.de-en这将会将可用于模型训练的二值化数据写入 data-bin/iwslt14.tokenized.de-en。

训练

使用python train.py来训练一个新模型。这里有几个适用于IWSLT 2014数据集的示例设置:

$ mkdir -p checkpoints/fconv

$ CUDA_VISIBLE_DEVICES=0 python train.py data-bin/iwslt14.tokenized.de-en \

--lr 0.25 --clip-norm 0.1 --dropout 0.2 --max-tokens 4000 \

--arch fconv_iwslt_de_en --save-dir checkpoints/fconv默认情况下,python train.py将使用机器上的所有可用GPU。使用CUDA_VISIBLE_DEVICES 环境变量选择特定的GPU和/或更改将要使用的GPU设备的数量。

另请注意,batch大小是根据每个batch的最大token数(--max-tokens)来指定的。你可能需要使用较小的值,具体取决于系统上可用的GPU内存。

生成

一旦模型训练好,就可以使用python generate.py(二进制数据)或python generate.py -i(原始文本)生成翻译:

$ python generate.py data-bin/iwslt14.tokenized.de-en \

--path checkpoints/fconv/checkpoint_best.pt \

--batch-size 128 --beam 5

| [de] dictionary: 35475 types

| [en] dictionary: 24739 types

| data-bin/iwslt14.tokenized.de-en test 6750 examples

| model fconv

| loaded checkpoint trainings/fconv/checkpoint_best.pt

S-721 danke .

T-721 thank you .

...如果要仅使用CPU生成翻译,请使用--cpu flag。可以使用--remove-bpe flag 来删除BPE连续标记。

预训练模型

我们提供以下预训练的完全卷积序列到序列模型:

wmt14.en-fr.fconv-py.tar.bz2:用于WMT14英语 - 法语的预训练模型,包括词汇

wmt14.en-de.fconv-py.tar.bz2:用于WMT14英语 - 德语的预训练模型,包括词汇

此外,我们还提供了上述模型的预处理和二值化测试集:

wmt14.en-fr.newstest2014.tar.bz2:WMT14英语 - 法语的newstest2014测试集

wmt14.en-fr.ntst1213.tar.bz2:WMT14英语 - 法语的newstest2012和newstest2013测试集

wmt14.en-de.newstest2014.tar.bz2:WMT14英语 - 德语的newstest2014测试集

生成二值化测试集可以像下面这样以batch的模式运行,例如,在GTX-1080ti的英语-法语:

$ curl https://s3.amazonaws.com/fairseq-py/models/wmt14.en-fr.fconv-py.tar.bz2 | tar xvjf - -C data-bin

$ curl https://s3.amazonaws.com/fairseq-py/data/wmt14.en-fr.newstest2014.tar.bz2 | tar xvjf - -C data-bin

$ python generate.py data-bin/wmt14.en-fr.newstest2014 \

--path data-bin/wmt14.en-fr.fconv-py/model.pt \

--beam 5 --batch-size 128 --remove-bpe | tee /tmp/gen.out

...

| Translated 3003 sentences (95451 tokens) in 81.3s (1174.33 tokens/s)

| Generate test with beam=5: BLEU4 = 40.23, 67.5/46.4/33.8/25.0 (BP=0.997, ratio=1.003, syslen=80963, reflen=81194)

# Scoring with score.py:

$ grep ^H /tmp/gen.out | cut -f3- > /tmp/gen.out.sys

$ grep ^T /tmp/gen.out | cut -f2- > /tmp/gen.out.ref

$ python score.py --sys /tmp/gen.out.sys --ref /tmp/gen.out.ref

BLEU4 = 40.23, 67.5/46.4/33.8/25.0 (BP=0.997, ratio=1.003, syslen=80963, reflen=81194)GitHub地址:https://github.com/facebookresearch/fairseq-py

【号外】新智元正在进行新一轮招聘,飞往智能宇宙的最美飞船,还有N个座位

点击阅读原文可查看职位详情,期待你的加入~