【AAAI2021】面向真实世界的鲁棒视觉信息提取:新的数据集和新颖的解决方案

Towards Robust Visual Information Extraction in Real World: New Dataset and Novel Solution

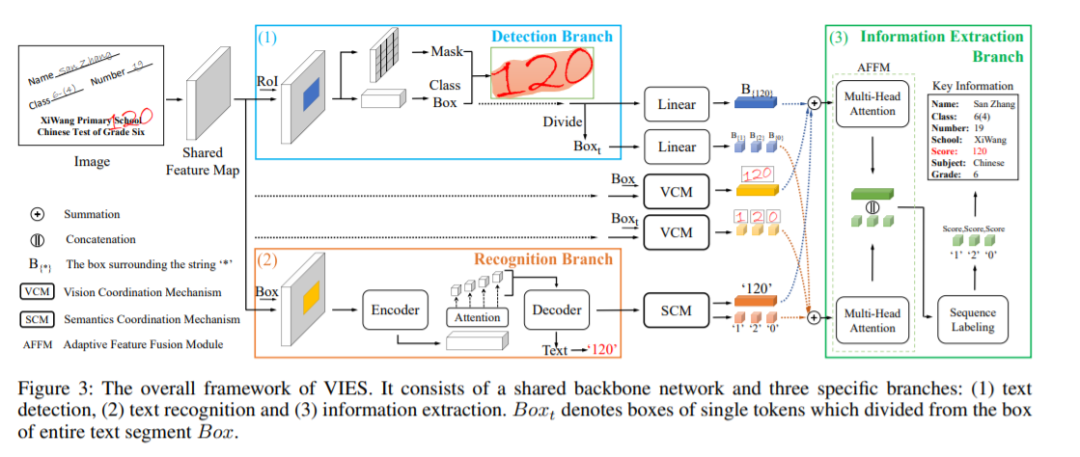

近年来,视觉信息提取技术因其在文档理解、自动标注、智能教育等方面的先进应用而备受关注。现有的研究大多将这一问题解耦为文本点识别(text detection and recognition)和信息提取几个独立的子任务,在优化过程中完全忽略了它们之间的高相关性。在本文中,我们提出了一个面向真实场景的鲁棒视觉信息提取系统(VIES),它是一个统一的端到端可训练的框架,以单个文档图像作为输入和输出结构化信息,同时进行文本检测、识别和信息提取。信息提取分支从文本点识别中收集丰富的视觉和语义表征,进行多模态特征融合,提供更高层次的语义线索,有助于文本点识别的优化。此外,针对公共基准的不足,我们构建了一个全注释数据集EPHOIE (https://github.com/HCIILAB/EPHOIE),该数据集是第一个同时用于文本识别和视觉信息提取的中文基准。EPHOIE包含1,494张复杂布局和背景的试卷头图像,包括15,771个中文手写或打印文本实例。与最先进的方法相比,我们的VIES在EPHOIE数据集中显示了显著的优越性能,并且在端到端场景下,在广泛使用的SROIE数据集上获得9.01%的F-score增益。

https://www.zhuanzhi.ai/paper/621eb7d838c761426bd7337cf6af6f1f

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“VIES” 可以获取《【AAAI2021】面向真实世界的鲁棒视觉信息提取:新的数据集和新颖的解决方案》专知下载链接索引