BAT题库 | 机器学习面试1000题系列(第236~240题)

236.回归模型中存在多重共线性, 你如何解决这个问题?

1. 去除这两个共线性变量

2. 我们可以先去除一个共线性变量

3. 计算VIF(方差膨胀因子), 采取相应措施

4. 为了避免损失信息, 我们可以使用一些正则化方法, 比如, 岭回归和lasso回归.

以下哪些是对的:

A. 1

B. 2

C. 2和3

D. 2, 3和4

答案: D

解决多重公线性, 可以使用相关矩阵去去除相关性高于75%的变量 (有主观成分). 也可以VIF, 如果VIF值<=4说明相关性不是很高, VIF值>=10说明相关性较高.

我们也可以用 岭回归和lasso回归的带有惩罚正则项的方法. 我们也可以在一些变量上加随机噪声, 使得变量之间变得不同, 但是这个方法要小心使用, 可能会影响预测效果。

237.模型的高bias是什么意思, 我们如何降低它 ?

A. 在特征空间中减少特征

B. 在特征空间中增加特征

C. 增加数据点

D. B和C

E. 以上所有

答案: B

bias太高说明模型太简单了, 数据维数不够, 无法准确预测数据, 所以, 升维吧 !

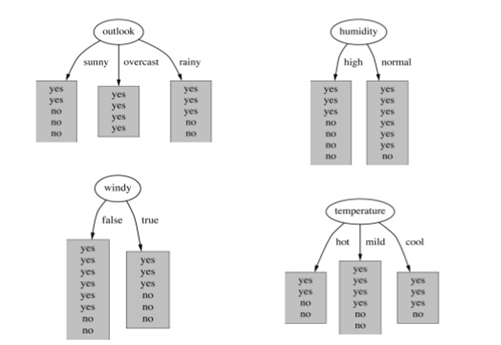

238.训练决策树模型, 属性节点的分裂, 具有最大信息增益的图是下图的哪一个:

A. Outlook

B. Humidity

C. Windy

D. Temperature

答案: A信息增益, 增加平均子集纯度, 详细研究, 请戳下面链接:

A Complete Tutorial on Tree Based Modeling from Scratch (in R & Python)

Lecture 4 Decision Trees (2): Entropy, Information Gain, Gain Ratio

239.对于信息增益, 决策树分裂节点, 下面说法正确的是:

1. 纯度高的节点需要更多的信息去区分

2. 信息增益可以用”1比特-熵”获得

3. 如果选择一个属性具有许多归类值, 那么这个信息增益是有偏差的

A. 1

B. 2

C.2和3

D. 所有以上

答案: C

详细研究, 请戳下面链接:

A Complete Tutorial on Tree Based Modeling from Scratch (in R & Python)

Lecture 4 Decision Trees (2): Entropy, Information Gain, Gain Ratio

240. 如果SVM模型欠拟合, 以下方法哪些可以改进模型 :

A. 增大惩罚参数C的值

B. 减小惩罚参数C的值

C. 减小核系数(gamma参数)

答案: A

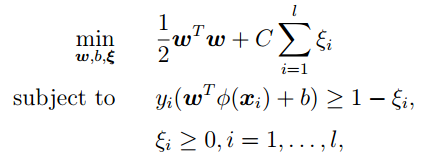

如果SVM模型欠拟合, 我们可以调高参数C的值, 使得模型复杂度上升.LibSVM中,SVM的目标函数是:

而, gamma参数是你选择径向基函数作为kernel后,该函数自带的一个参数.隐含地决定了数据映射到新的特征空间后的分布.

gamma参数与C参数无关. gamma参数越高, 模型越复杂.

往期题目:

课程咨询|微信:julyedukefu

七月热线:010-82712840