Hinton坐阵!斯坦福CS25 Transformer专题讲座更新:多位AI大佬齐聚

新智元报道

新智元报道

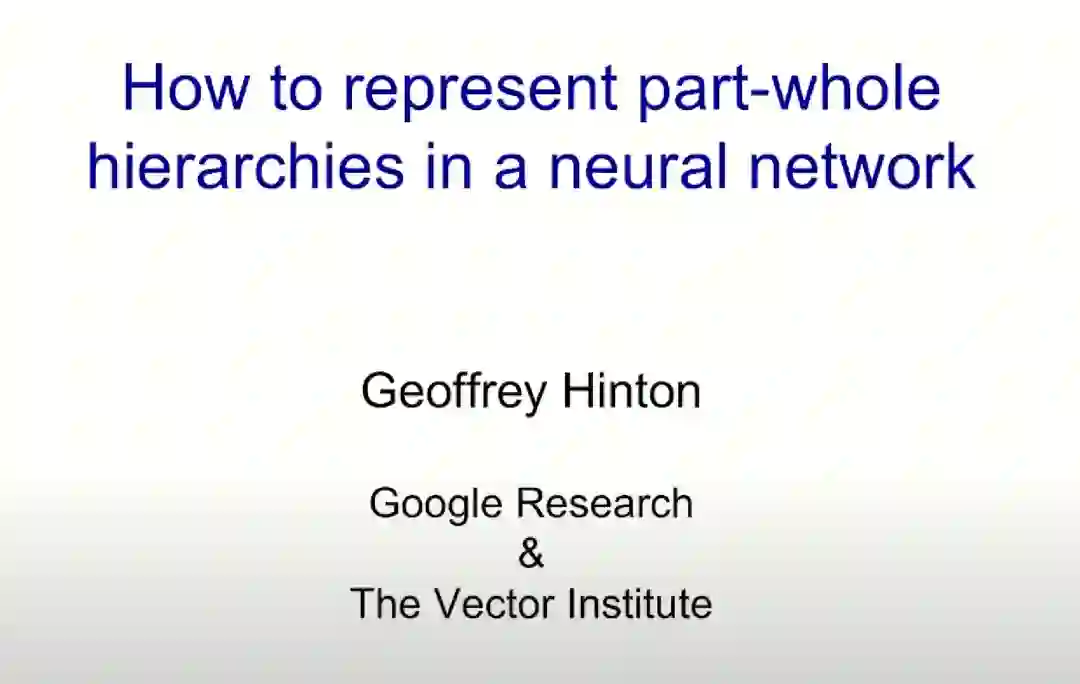

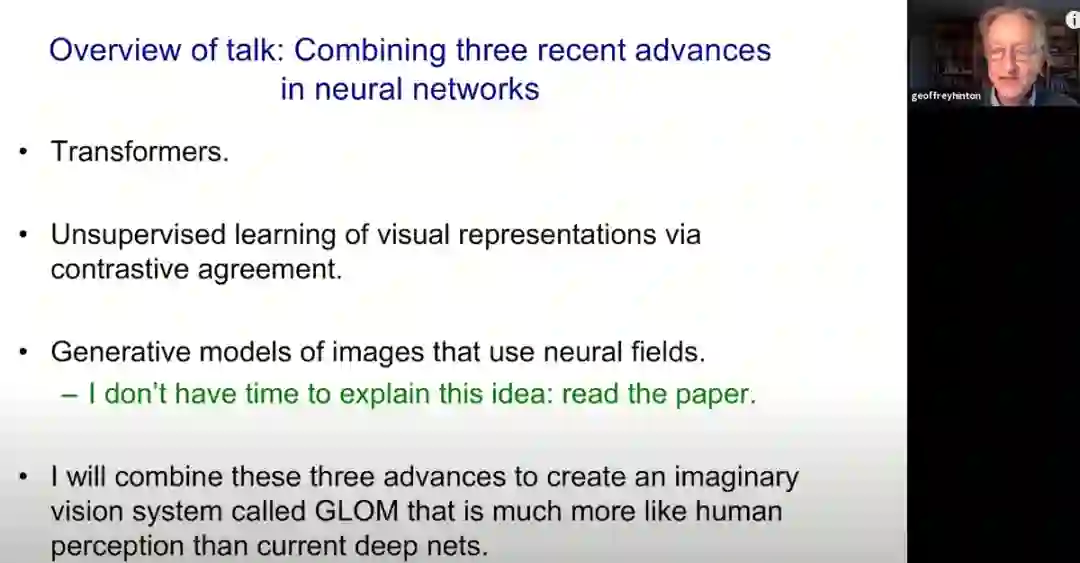

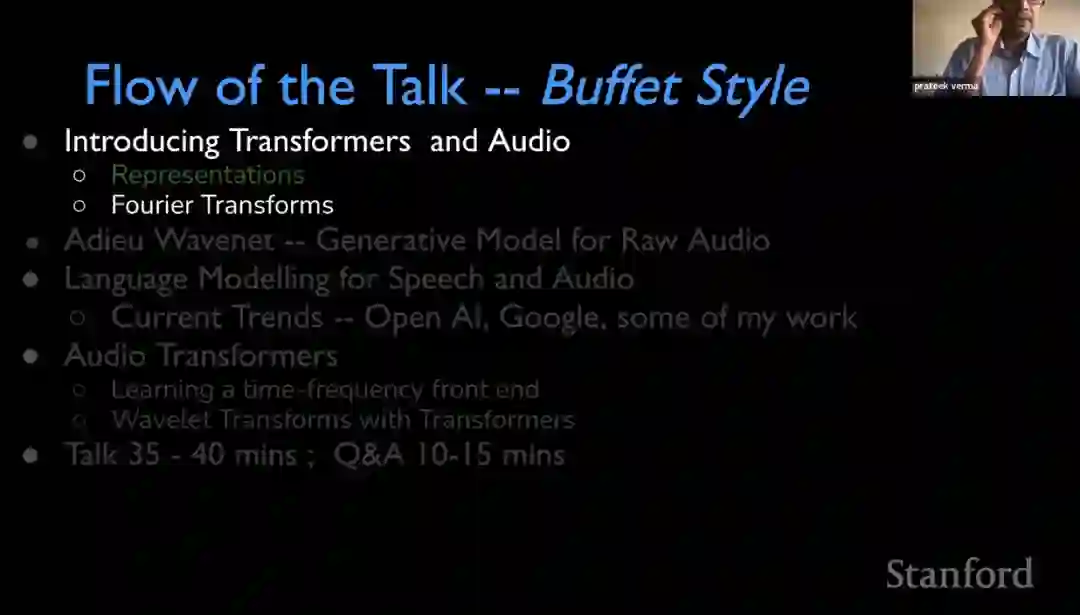

【新智元导读】斯坦福大牛Christopher Manning开设的Transformer联合讲座课程更新啦!这期请来的是Hinton大神。

登录查看更多