论文浅尝 - AAAI2020 | 迈向建立多语言义元知识库:用于 BabelNet Synsets 义元预测

论文笔记整理:潘锐,天津大学硕士。

来源:AAAI 2020

链接:https://arxiv.org/pdf/1912.01795.pdf

摘要

义原被定义为人类语言的最小语义单位。义原知识库(KBs)是一种包含义原标注词汇的知识库,它已成功地应用于许多自然语言处理任务中。然而,现有的义原知识库建立在少数几种语言上,阻碍了它们的广泛应用。为此论文提出在多语种百科全书词典BabelNet的基础上建立一个统一的多语种义原知识库。首先建立一个数据集作为多语种义原知识库的种子知识库。它为超过1.5万个synset,并由人工手动标注若干义原。然后,首次提出并正式定义了BabelNet synset 义原预测任务,旨在将种子数据集扩展为一个可用的知识库。论文还利用了不同的synset信息提出了两个简单有效的模型。最后,进行定量和定性分析,探究任务中的重要因素和难点。

研究背景

人类语言可以划分成不同层次——句子可以划分成短语或词组,再进一步划分成词。词是最小的可以独立运用的单位,也是自然语言处理最常用的语言单位。但从语义层面讲,词还可以进一步细分为义原——也即语言学家定义的最小的语义单位。一些语言学家认为所有语言的所有词语的意思都可以用一个有限的义原集合来表达。并且有语言学家认为义原体系在任何语言中都是适用的,并不与特定语言相关。为了能在自然语言处理实践中应用义原,董振东和董强花费数十年时间构建了最著名的义原知识库——知网(HowNet)。HowNet预定义了两千多个义原,并用其标注了十万多个中/英文词语。每个词语的每个义项都用若干义原标注以表达其语义。

研究动机

然而,HowNet中已标注义原的英文词语数量有限,仅占WordNet英文词数的 32.8%,且中英之外其他语言的词语没有义原标注。这导致义原在自然语言处理领域的应用范围被大大局限——也是此前义原主要被用于中文自然语言处理任务的原因。为了解决这一问题,有人提出跨语言词语的义原预测 ,旨在通过双语词表示对齐的方式为其他语言的词语预测义原。但这种方法一次只能为一种语言的词语预测义原,不是非常高效,并且该方法无法进行义项层面的义原预测。

研究方法

和跨语言词语义原预测的思路不同,本文提出基于BabelNet来构建多语言义原知识库的方案。BabelNet是一个多语言百科词典,由BabelNet synset组成,每个synset包含意义相同的不同语言的词语,下图给出了一个例子——这个synset包含英语、汉语、法语、德语等各种语言表示「丈夫」这个意思的词语。

一个synset中不同语言的词语都应该被标注同样的义原,换言之,直接为BabelNet synset标注义原就可以同时为多个语言的词语标注义原,从而高效地构建一个多语言义原知识库。除了高效之外,基于BabelNet来构建多语言义原知识库的方案还有其他好处:直接将义原标注在义项层面;BabelNet蕴含的丰富的信息都可以为义原预测所用——包括维基百科、WordNet、FrameNet等等。

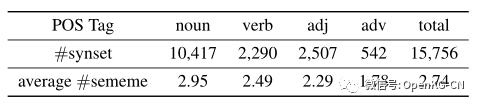

1 BabelSememe 数据集

为了推进大规模多语言义原知识库的构建,本文首先标注了一个种子知识库BabelSememe。它包含约一万五千个synset,每个synset由人工标注了若干义原。由于此前义原的结构鲜少被使用,同时为了节省成本,BabelSememe的标注暂时忽略了义原的结构。下图给出了BabelSememe数据集的分词性统计。

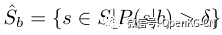

2 BabelNet synset义原预测形式化定义

有了种子知识库,下一步就是基于有义原标注的synset,为无标注的synset标注义原,进而将种子知识库不断扩充成最终的大规模义原知识库。本文首次提出并正式定义了BabelNet synset义原预测任务。BabelNet synset义原预测形式化如下:

定义为对BabelNet的某个Synset “b” 的预测义原集合,P(s|b)为给定b时,义原s的预测分数,为义原预测分数阈值。即为某个synset预测义原时,首先使用某种方法计算所有义原被预测给当前synset的分数,然后选取预测分数高于某个阈值的义原作为最终预测结果。

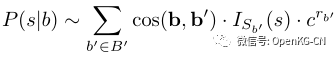

3 方法一:基于语义表示的Synset义原预测

这种方法的思路非常直观,即意思相近的synset其所标注义原也应该相似——这和推荐系统中常用的协同过滤方法非常类似。其中synset之间的相似性利用了BabelNet提供的NASARI synset embedding的余弦相似度衡量。

这种方法的公式如下图 所示,

4 方法二:基于关系表示的Synset义原预测

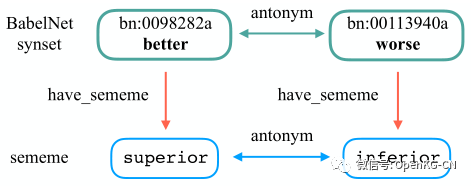

BabelNet包含很多synset之间的关系,例如同义、反义、上下位等。与此同时,HowNet也定义了若干种义原之间的关系,那么自然地,synset之间的关系和synset所标注的义原之间的关系应该是对应的,利用这种性质便可以进行义原预测。例如,

上图中better和worse这两个synset存在反义的关系,他们分别被标注了superior和inferior这两个同样存在反义关系的义原。那么,在已知better和worse、superior 和 inferior这两对反义关系,以及better有superior这个义原,很容易推测出中worse含有inferior这个义原。

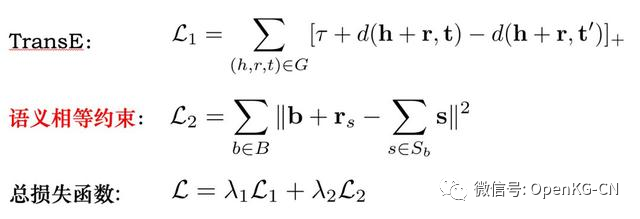

基于此,本文建立了一个语义图,节点有synset和义原两种,关系有三种:synset之间的关系、义原之间的关系以及synset和义原之间被标注的关系(hava_sememe)。synset义原预测也就转化为了知识图谱中实体预测的任务,即给定头实体——待义原预测的synset,给定关系have semem,预测尾实体义原。这篇论文利用了知识图谱任务中经典的TransE模型来学习这些实体和关系的表示以进行预测。

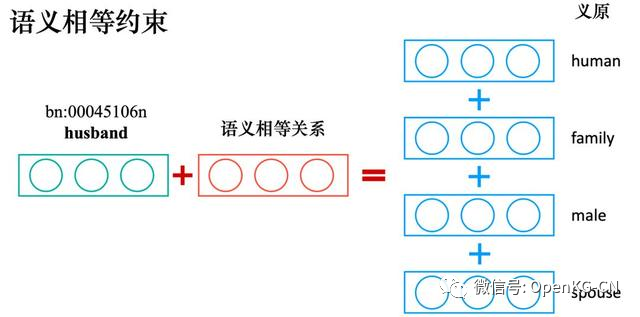

此外,考虑到synset义原预测任务的特殊性,文中还额外引入了一个语义相等约束。词的语义可以由其义原组合而成,synset也有类似的性质,因此文中提出synset与其义原之和有一个语义等价的关系,并且在模型训练时额外引入语义相等约束。例如:

上图中husband这个synset加上语义相等关系等于义原embedding的和。因此方法二训练时的总损失函数为两者之和,如下图所示。

此外,文中还通过简单的顺序倒数加权相加的方式将两种方法进行了集成。

实验

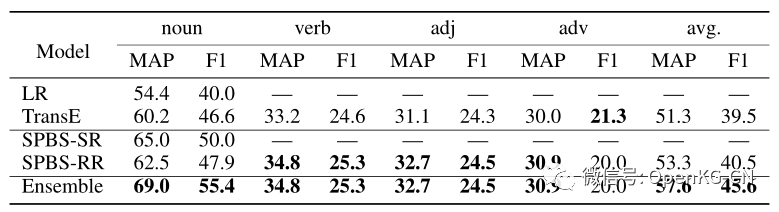

该文利用自己构建的BabelSememe数据集对提出的synset义原预测模型进行了评测。其中为了对比,设置了两个基线方法:(1)同样使用了synset的语义表示(NASARI embedding)的逻辑回归(LR)和(2)基于关系表示的TransE。

通过实验结果发现,文中提出的方法一和方法二分别好于两个基线模型,而且集成模型Ensemble获得了最好的结果。

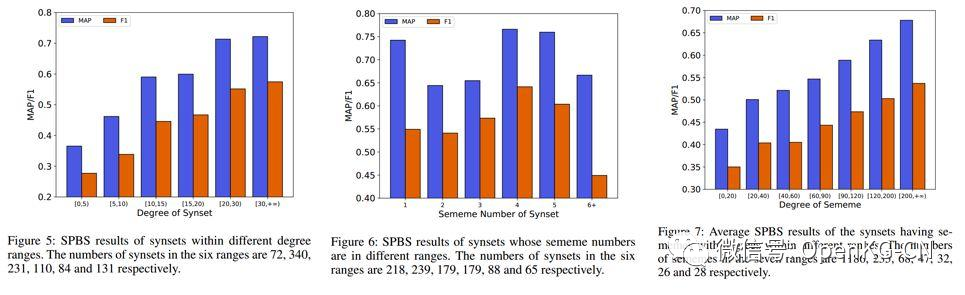

此外,论文还进行了一系列的定量分析,以探讨影响synset义原预测结果的因素。发现义原预测结果和synset以及义原度数(即方法二的语义图中节点度数)都成正相关,随着sysnet义原数量的增加先增加后减小。

OpenKG

开放知识图谱(简称 OpenKG)旨在促进中文知识图谱数据的开放与互联,促进知识图谱和语义技术的普及和广泛应用。

点击阅读原文,进入 OpenKG 博客。