ICML2020 | 南大周志华教授组:一个高效安全的深度半监督学习模型

新智元报道

新智元报道

来源:ICML

编辑:舒婷、白峰

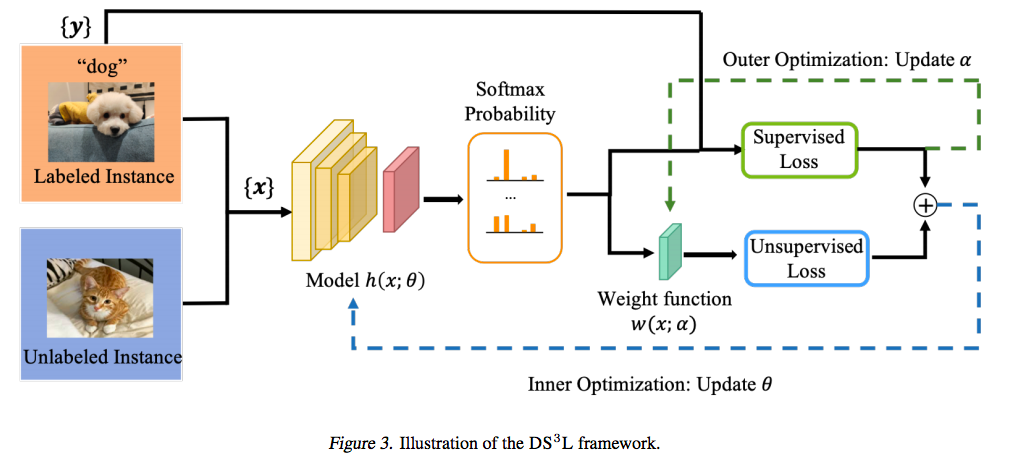

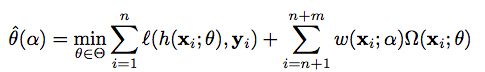

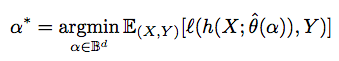

【新智元导读】最近,ICML 2020上周志华教授组发表的一篇有关深度半监督学习的论文引发热议,文章介绍了一种叫做DS3L的半监督模型,在未知分类无标签数据集中的表现抢眼,有些条件下甚至超过了监督学习的基线模型。

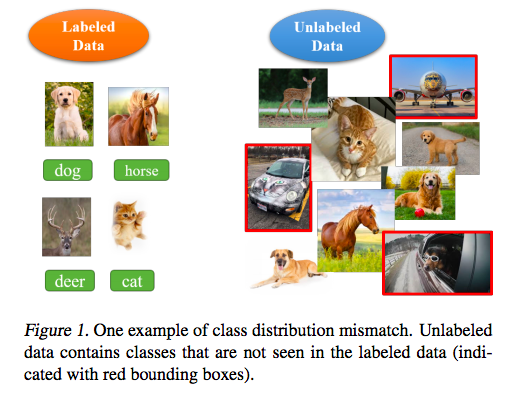

为什么要研究这个新的方法?

为什么要研究这个新的方法?

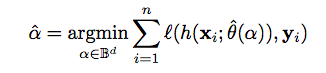

DS3L:一个高效安全的深度半监督学习模型

DS3L:一个高效安全的深度半监督学习模型

的时候接近最优,甚至比带有大量参数的监督学习的收敛速度还要快。

的时候接近最优,甚至比带有大量参数的监督学习的收敛速度还要快。

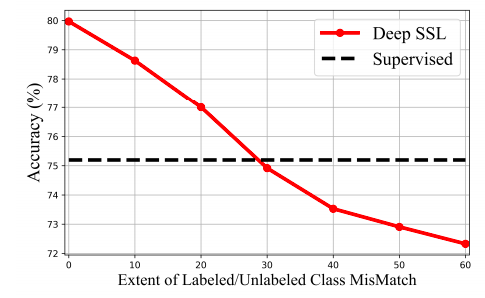

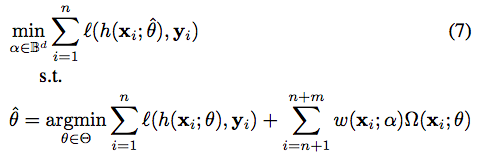

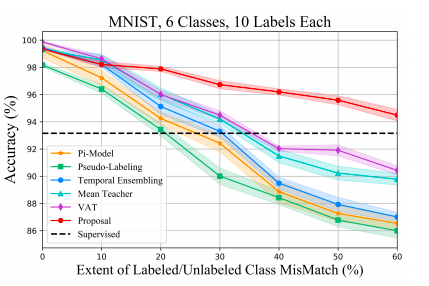

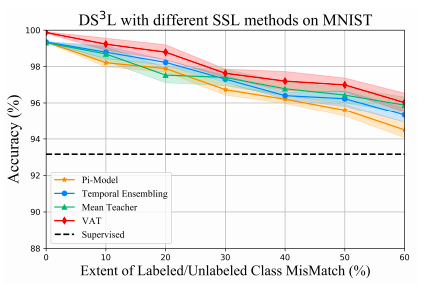

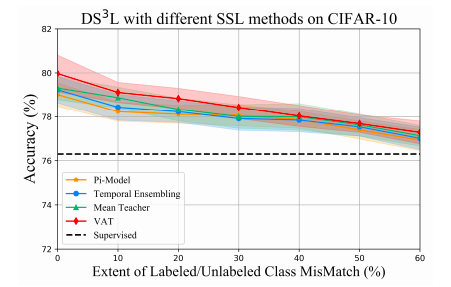

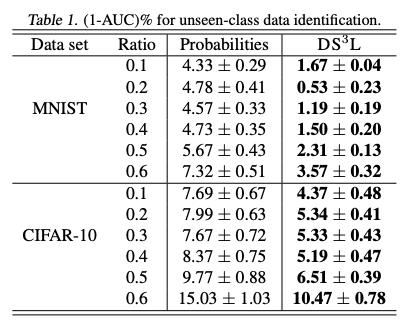

性能测试:类分布不匹配时表现依旧亮眼

登录查看更多