来自AI专家的13篇必读论文

作者:Luke Kenworthy

编译:ronghuaiyang

一位老外找了8位AI大神推荐了13篇必读文章,可以收藏一下。

在“顶尖人工智能书籍”阅读榜单大受欢迎之后,我们联系了一些社区人士,找出他们认为每个人都应该阅读的论文!

以下所有的论文都可以免费访问并涵盖从Hypergradients到CNNs的模型响应等一系列主题。每位专家还包括了论文被选中的原因,以及一段简短的个人简介。

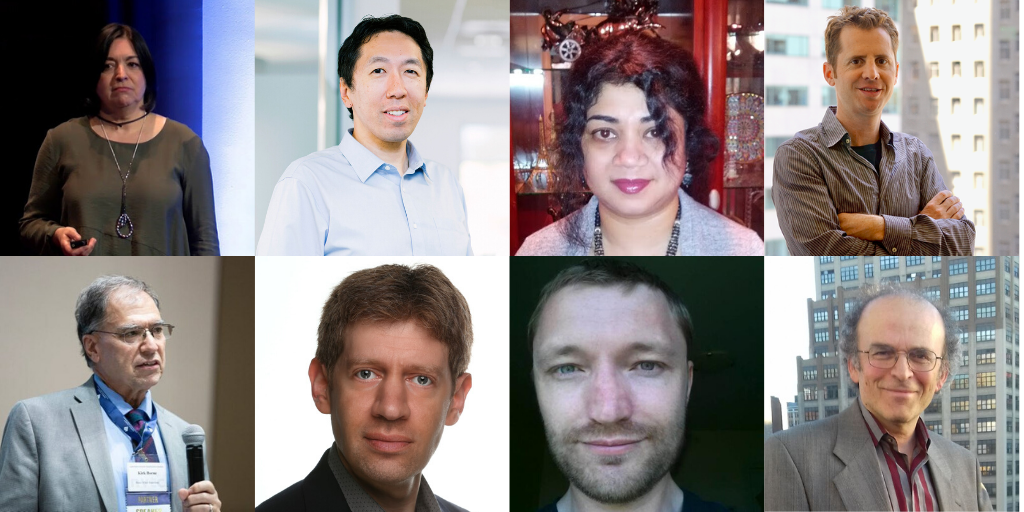

Jeff Clune, OpenAI的研究团队主管

一月份我们和杰夫谈过,那时他不能只选一篇作为必读的文章,所以我们让他选两篇。两篇论文如下:

Learning to Reinforcement Learn (2016) - Jane X Wang et al

本文提出了两个关键问题:稀疏训练数据的局限性,以及循环网络是否能在完全监督的环境下支持元学习。这些观点在7个概念验证实验中得到了阐述,每一个实验都考察了deep meta-RL的一个关键方面。我们考虑扩展和扩大该方法的前景,并指出一些潜在的重要意义,神经科学。

论文地址:https://arxiv.org/pdf/1611.05763.pdf。

Gradient-based Hyperparameter Optimization through Reversible Learning (2015) - Dougal Maclaurin, David Duvenaud, and Ryan P. Adams.

Jeff推荐的第二篇论文通过在整个训练过程中反向链接导数来计算所有超参数交叉验证性能的精确梯度。这些梯度允许数千个超参数的优化,包括步长和动量计划、权重初始化分布、丰富的参数化正则化方案和神经网络架构。

论文地址:https://arxiv.org/pdf/1502.03492.pdf。

Shalini Ghosh, 三星美国研究院智能电视部门首席科学家(全球)和机器学习研究团队负责人

Long Short-Term Memory (1997) - Sepp Hochreiter and Jürgen Schmidhuber

这篇论文是1997年发表的一篇开创性的论文,有一些超前的想法。只是在最近(例如,最近6年左右),硬件加速器才能够运行LSTMs的训练/服务操作,这使得LSTMs成功地用于许多应用程序(例如,语言建模、手势预测、用户建模)。LSTMs的基于内存的序列建模架构非常有影响力 —— 它激发了许多最近的改进,例如transformer。这篇论文对我的工作影响很大。

论文地址:https://www.mitpressjournals.org/doi/abs/10.1162/neco.1997.9.8.1735

Efficient Incremental Learning for Mobile Object Detection (2019) - Dawei Li et al

本文讨论了流行的目标检测模型RetinaNet的一种新变体,并介绍了一种增量学习的范例,这对多模态学习的这一应用和其他应用都很有用。本文中使用的关键思想和增量学习公式对任何从事计算机视觉工作的人都是有用的,并且可以为将来在移动设备上使用的高效增量算法的创新铺平道路。论文地址:https://arxiv.org/abs/1904.00781

Kenneth Stanley, Charles Millican的教授以及Uber高级研究经理

Emergent Tool Use From Multi-Agent Autocurricula (2019) - Bowen Baker et al

Ken选择了这篇文章,因为它提供了一个关于紧急行为的独特例子,暗示了开放的开端。论文本身发现了明显的证据表明,在我们的环境中,agent策略出现了六个紧急阶段,每一个阶段都会给对方团队带来新的适应压力,例如,代理学习使用可移动的盒子构建多个物体的保护伞,这反过来导致代理发现他们可以使用坡道克服障碍。论文地址:https://arxiv.org/abs/1909.07528

Open-endedness: The last grand challenge you’ve never heard of (2017) - Kenneth Stanley et al

我们允许Ken推荐他自己和他的同事的一篇论文,他的建议是“A non-technical introduction to the challenge of open-endedness”。这篇文章解释了这个挑战是什么,它的含义,如果我们已经激发了你的兴趣,如何加入这个探索。论文地址:https://www.oreilly.com/radar/open-endednthelast-grand-challengegeve-youve-never-heard-of/。

Andriy Burkov, Gartner公司数据科学总监

Attention Is All You Need (2017) - Ashish Vaswani et al

Andriy推荐这篇2017年的论文,用他自己的话来说,“它把NLP带到了一个全新的水平,用的是像BERT这样的预先训练过的变压器模型”。本文提出了一种新的简单的网络结构 —— 基于注意机制的Transformer,完全省去了递归和卷积。在两个机器翻译任务上的实验表明,这些模型在质量上更优,同时具有更大的并行性,并且需要更少的训练时间。论文地址:https://arxiv.org/abs/1706.03762

Andrew NG, Landing AI的创始人和CEO,deeplearning.ai的创始人

当我们联系到Andrew时,并没有具体的论文出现在我们的脑海中,然而,我们被引导到他最近的一篇文章中,其中突出了他认为可能感兴趣的两篇论文。这两篇论文被引用如下。

Modeling yield response to crop management using convolutional neural networks (2020) - Andre Barbosa et al.

在这项工作中,Andre等人提出了卷积神经网络来捕捉不同属性的相关空间结构,并将其结合起来对养分和种子率管理的产量响应进行建模。通过9个玉米田的田间实验,构建合适的数据集,对CNN模型进行训练和测试。对网络中不同阶段组合输入属性的四种体系结构进行了评估,并与最常用的预测模型进行了比较。

论文地址:https://www.sciencedirect.com/science/article/pii/S0168169919308543

A comparison of deep learning performance against health-care professionals in detecting diseases from medical imaging: a systematic review and meta-analysis (2019) - Xiaoxuan Liu et al

本文评估了深度学习算法与医疗专业人员在使用医学成像对疾病进行分类时的诊断准确性。采用统一的层次模型进行外部样本外验证的研究被纳入元分析。

论文地址:https://www.thelancet.com/journals/landig/article/PIIS2589-7500(19)30123-2/fulltext#seccestitle10

Gregory Piatetsky-Shapiro, 数据科学家,KDnuggets总裁

当我们联系到Gregory时,他表示他的论文选择是基于试图理解AI和ML的大趋势,最近的两篇论文确实让他脱颖而出。“我最近读的两篇重要论文是来自Gary & Francois,我也建议看蒙特利尔的Yoshua Bengio和Gary Marcus之间的辩论。”

The Next Decade in AI: Four Steps Towards Robust Artificial Intelligence (2020) - Gary Marcus

本文介绍了近年来人工智能和机器学习方面的研究成果,着重介绍了通用学习和越来越大的训练集以及越来越多的计算。与此相反,Gary提出了一种混合的、知识驱动的、基于推理的方法,以认知模型为中心,可以为一个比目前可能的更丰富、更健壮的人工智能提供基础。

论文地址:https://arxiv.org/abs/2002.06177

On the Measure of Intelligence (2019) - François Chollet

Gregory的第二个建议是François Chollet的"On The Measure of Intelligence"。本文对衡量智能的定义和评价方法进行了总结和批判性评价,同时明确了隐含在其中的两个历史的智能概念。然后,Francois基于算法信息论阐述了一个新的正式的智能的定义,将智能描述为技能获取效率,并强调了范围、泛化困难、先验和经验等概念。

论文地址:https://arxiv.org/abs/1911.01547。

Myriam Cote, 顾问

Tackling climate change with Machine Learning (2019) - David Rolnick, Priya L Donti, Yoshua Bengio et al.

Myriam的建议涵盖了机器学习及其对环境的影响。气候变化是人类面临的最大挑战之一,机器学习专家们正在思考如何帮助解决这个问题。在这篇文章中,作者描述了机器学习如何成为减少温室气体排放和帮助社会适应气候变化的有力工具。从智能电网到灾害管理,他们发现了与其他领域合作的机器学习可以填补现有缺口的高影响问题。

论文地址:https://arxiv.org/pdf/1906.05433.pdf?utm_campaign=nathan.ai_newsletter&utm_medium=email&utm_source=Revue_newsletter

Kirk Borne, 他是首席数据科学家和数据科学研究员,也是博思艾伦咨询公司的执行顾问

The Netflix Recommender System: Algorithms, Business Value, and Innovation (2015) - Carlos Gomez-Uribe & Neil Hunt.

“这篇文章是几年前写的,不是特别技术性的,但它涵盖了很多基本问题,包括商业决策点、算法特征、度量标准和数据特征,在将AI算法部署到操作环境之前、期间和之后,必须考虑、测试和验证这些问题。我也喜欢这篇文章,因为推荐引擎很受欢迎,在许多不同的行业中都有使用,并且得到了每个人(甚至非专家)的认可 —— 因此,这篇文章可以很快地让学生(和其他人)对算法及其乐趣和利润的机会有更深入、更丰富的理解。

论文地址:https://dl.acm.org/doi/10.1145/2843948。

英文原文:https://blog.re-work.co/ai-papers-suggested-by-experts/

推荐阅读

斯坦福大学NLP组Python深度学习自然语言处理工具Stanza试用

太赞了!Springer面向公众开放电子书籍,附65本数学、编程、机器学习、深度学习、数据挖掘、数据科学等书籍链接及打包下载

数学之美中盛赞的 Michael Collins 教授,他的NLP课程要不要收藏?

模型压缩实践系列之——bert-of-theseus,一个非常亲民的bert压缩方法

关于AINLP

AINLP 是一个有趣有AI的自然语言处理社区,专注于 AI、NLP、机器学习、深度学习、推荐算法等相关技术的分享,主题包括文本摘要、智能问答、聊天机器人、机器翻译、自动生成、知识图谱、预训练模型、推荐系统、计算广告、招聘信息、求职经验分享等,欢迎关注!加技术交流群请添加AINLPer(id:ainlper),备注工作/研究方向+加群目的。