【速览】IJCV 2022 | 自适应干扰解耦学习的人脸表情识别方法(ADDL)

学会“成果速览”系列文章旨在将图像图形领域会议期刊重要成果进行传播,通过短篇文章让读者用母语快速了解相关学术动态,欢迎关注和投稿~

◆ ◆ ◆ ◆

自适应干扰解耦学习的人脸表情识别方法(ADDL)

*通讯作者:严严(yanyan@xmu.edu.cn)

◆ ◆ ◆ ◆

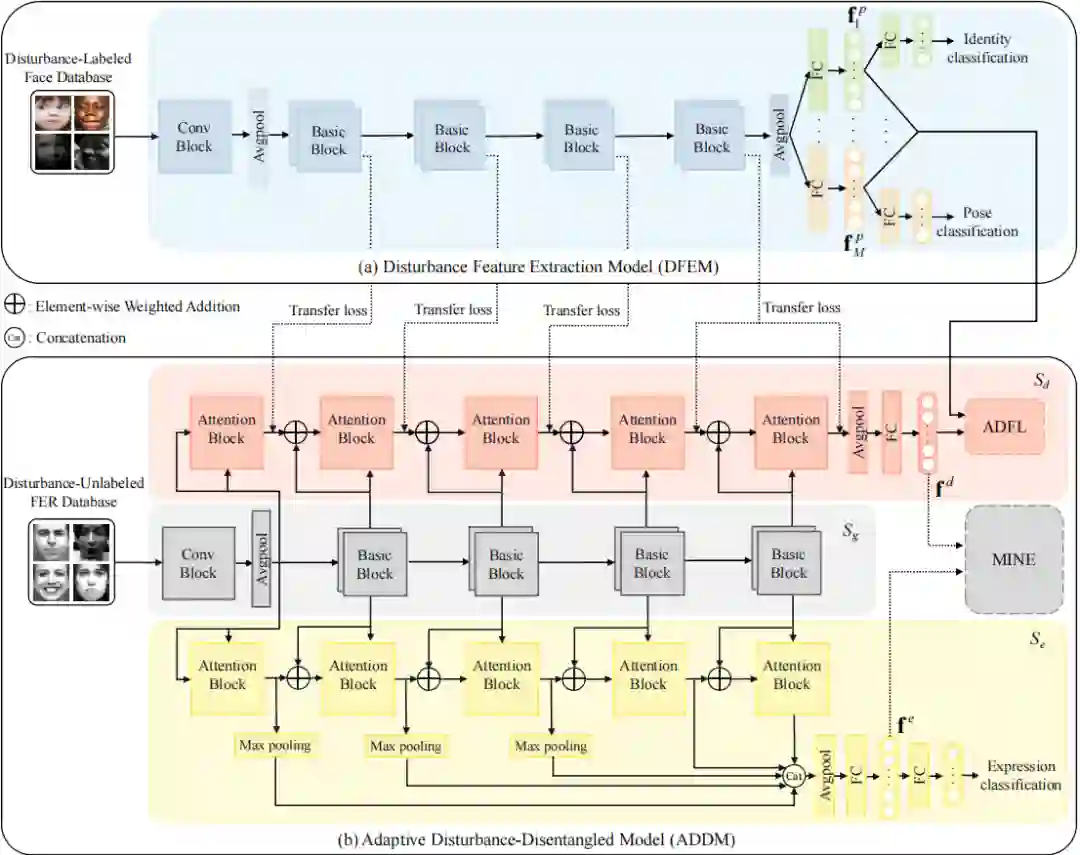

人脸表情图像中存在多种干扰因素,如性别、年龄、种族、身份、光照、姿势等引起的变化。这些干扰因素导致面部表情图像呈现较大的类间相似性和类内差异性。并且,不同的人脸表情数据集可能受到不同类型、不同影响程度的干扰。为了解决上述问题,在本文中,我们提出了一种新的自适应干扰解耦学习方法(ADDL),用于人脸表情识别。如图1所示,ADDL包含两阶段训练:首先,利用含干扰标签的大型人脸数据集训练一个干扰特征提取模型DFEM,可以识别多种干扰因素;其次,设计并学习了一个自适应干扰解耦模型ADDM,该模型包含共享子网络

本文的主要贡献如下:

(1)本文提出了一种新的表情识别算法ADDL。该算法由DFEM和ADDM两个模型组成,可以利用大规模人脸数据集中的干扰标签信息作为辅助,有效抑制无干扰标签的人脸表情数据集中的干扰信息。

(2)本文提出的自适应干扰特征学习模块,能够考虑不同表情数据集的干扰特性,通过对抗迁移学习来自适应地提取干扰特征。

(3)本文发现网络不同层级的输出特征都包含了表情相关的信息,在表情子网络中利用多级注意力机制,提取到更加丰富的表情特征。

近年来,为了隐式地减少干扰因素的影响,基于深度学习的表情识别算法[1-3]依赖于现有的有标签数据进行训练,可以提高算法对干扰的鲁棒性。但是有限的训练数据导致算法的性能提升也有限。一些基于干扰解耦的表情识别算法[4-6]利用人脸表情数据集自带的身份或姿态的标签进行训练,但是它们只能解决一到两种干扰因素,导致模型的性能不佳。区别于之前的方法,ADDL在ADDM中设计了一个干扰子网络

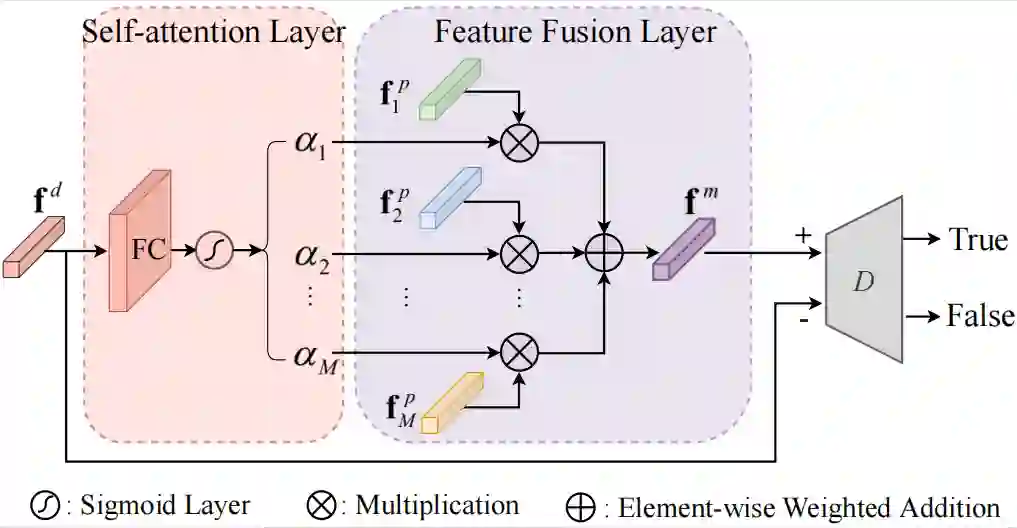

如图2所示,ADFL的网络结构由自注意力(SA)层、特征融合层和判别器组成。假设将一张无干扰标签的人脸表情图像输入到ADDM和DFEM中,此时,

接着,通过判别器

图 2 ADFL网络结构示意图

表情子网络

其中,

常规情况下,对干扰特征和表情特征计算Kullback-Leibler(K-L)散度并最小化,可以减小两类特征分布之间的差异性。但是,这种方式不能保证干扰特征和表情特征的分布是不相关的。为了显式地解耦干扰特征

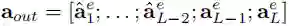

具体来说,文中引入了互信息神经估计器(MINE)[7],可以估计

其中,

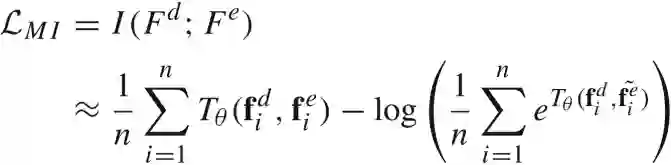

本文在三个室内数据集和四个室外数据集上对ADDL与当前流行的人脸表情识别方法进对比实验。

表 1 在三个室内数据集上的表情识别性能比较

如表1所示,ADDL在三个室内的表情数据集CK+、MMI和Oulu-CASIA上,识别性能优于其他算法。

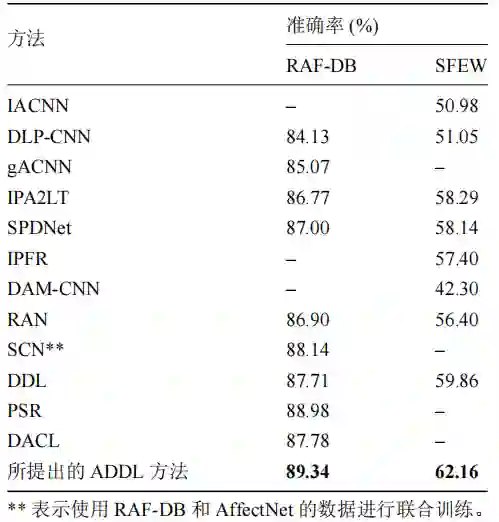

如表2所示,ADDL在室外的表情数据集RAF-DB和SFEW上,也具有较高的识别准确率。

表 2 在RAF-DB和SFEW数据集上的表情识别性能比较

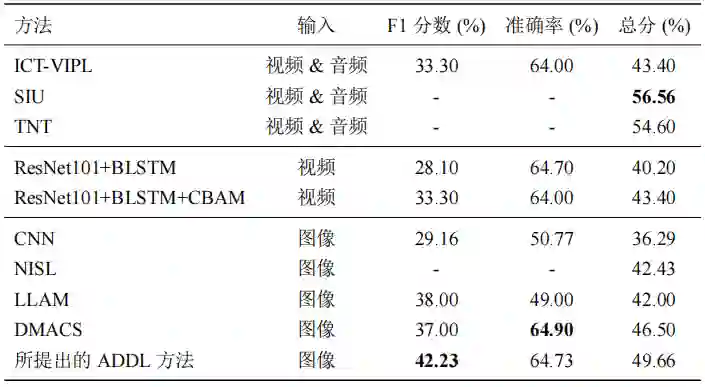

如表3所示,在大规模人脸表情数据集Aff-Wild2上,ADDL的性能优于其他基于图像输入的算法。

表 3 在Aff-Wild2数据集上的表情识别性能比较

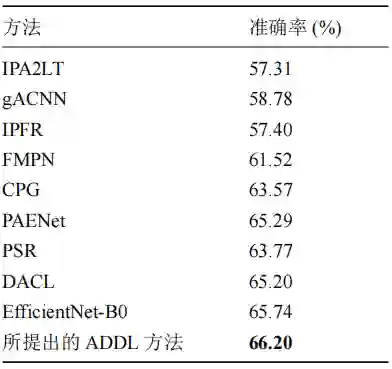

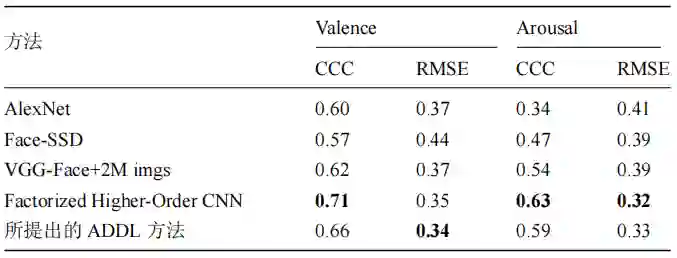

本文在AffectNet数据集上进行了表情识别和Valence-Arousal估计的实验,结果分别如表4和表5所示。ADDL在AffectNet数据集上的表情识别性能明显由于其他算法,Valence-Arousal估计任务的性能也比较优良。由此证明ADDL具有较强的泛化能力。

表 4 在AffectNet数据集上的表情识别性能比较

表 5 在AffectNet数据集上的Valence-Arousal估计性能比较

本文提出的自适应干扰解耦学习方法ADDL在利用大规模人脸数据集的干扰先验信息的同时考虑了目标人脸表情数据集的干扰特性,自适应地学习干扰特征,并且实现干扰特征和表情特征之间的显式分离,在表情识别任务上具有优越的性能表现。

[1] Mollahosseini A, Chan D, Mahoor M H. Going deeper in facial expression recognition using deep neural networks[C]//In Proceedings of the IEEE Winter Conference on Applications of Computer Vision, 2016: 1-10.

[2] Liu Y, Zeng J, Shan S, et al. Multi-channel pose-aware convolution neural networks for multi- view facial expression recognition[C]//In Proceedings of the IEEE International Conference on Automatic Face & Gesture Recognition, 2018: 458-465.

[3] Wang K, Peng X, Yang J, et al. Region attention networks for pose and occlusion robust facial expression recognition[J]. IEEE Transactions on Image Processing, 2020, 29(1): 4057-4069.

[4] Meng Z, Liu P, Cai J, et al. Identity-aware convolutional neural network for facial expression recognition[C]//In Proceedings of the IEEE International Conference on Automatic Face & Gesture Recognition, 2017: 558-565.

[5] Zhang F, Zhang T, Mao Q, et al. Joint pose and expression modeling for facial expression recognition[C]//In Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2018: 3359-3368.

[6] Yang H, Zhang Z, Yin L. Identity-adaptive facial expression recognition through expression regeneration using conditional generative adversarial networks[C]//In Proceedings of the IEEE International Conference on Automatic Face & Gesture Recognition, 2018: 294-301.

[7] Belghazi M I, Baratin A, Rajeshwar S, et al. Mutual information neural estimation[C]//In Proceedings of the International Conference on Machine Learning. 2018: 531-540.