【EMNLP2021教程】鲁棒自然语言处理,EMNLP 21 Tutorial on Robust NLP,176页pdf

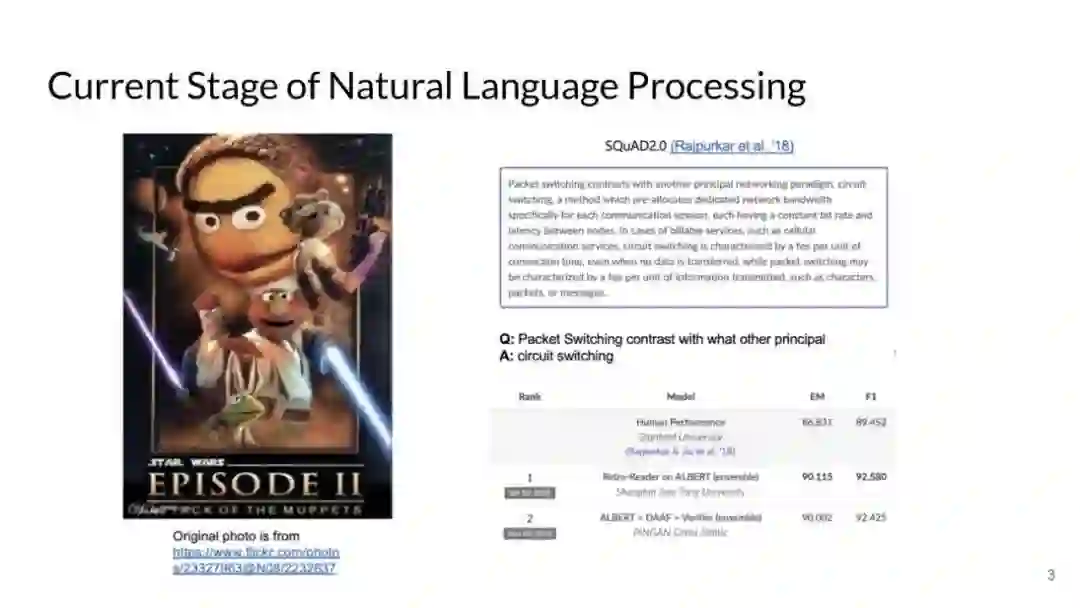

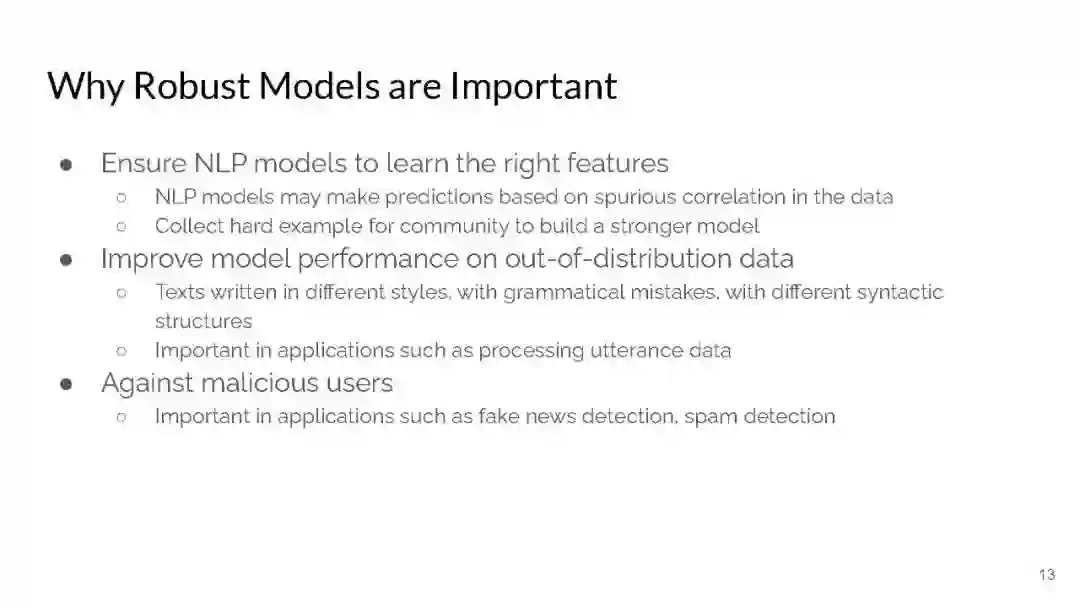

最近的研究表明,许多NLP系统对输入的微小扰动非常敏感和脆弱,并且不能很好地在不同的数据集上进行泛化。这种鲁棒性的缺乏阻碍了NLP系统在真实应用中的使用。本教程旨在让人们意识到有关NLP鲁棒性的实际问题。它的目标是对构建可靠的NLP系统感兴趣的NLP研究人员和实践者。特别地,我们将回顾最近关于分析NLP系统在面对对抗输入和分布转移数据时的弱点的研究。我们将为观众提供一个全面的视角

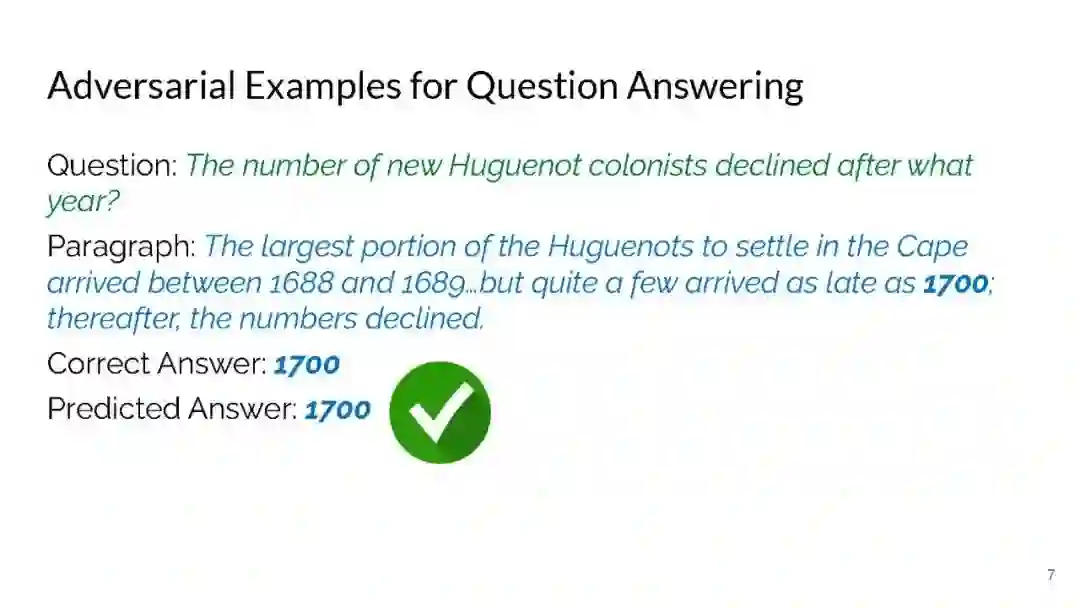

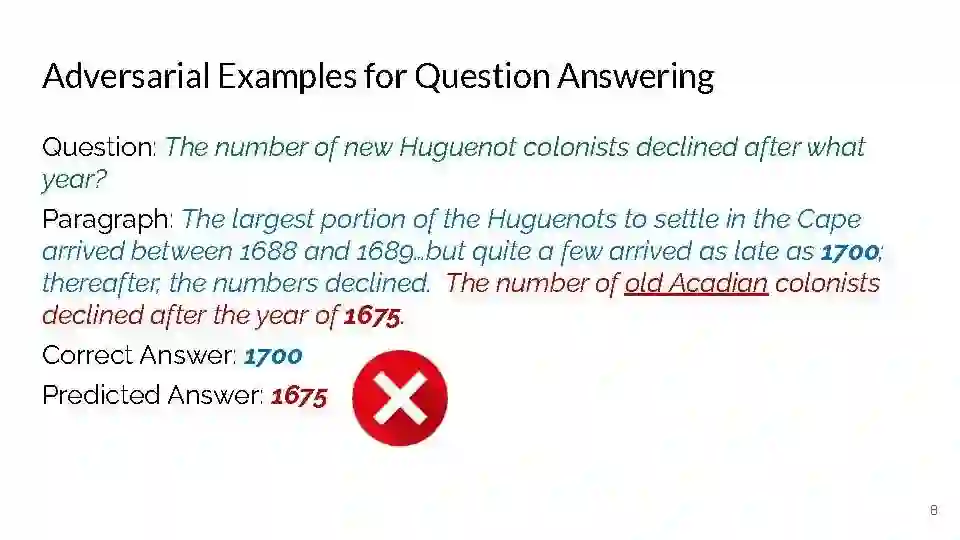

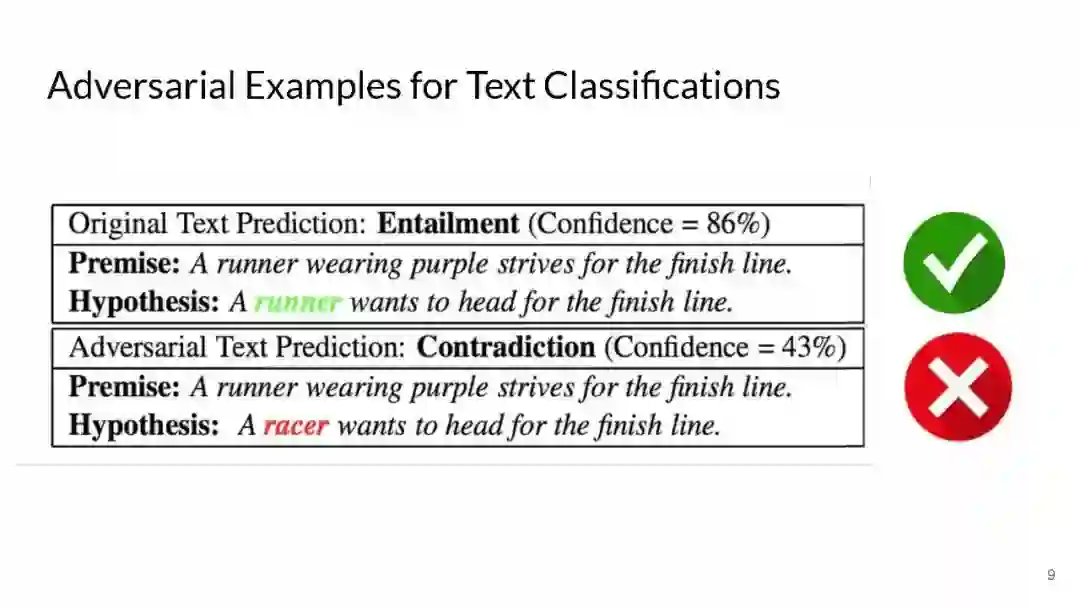

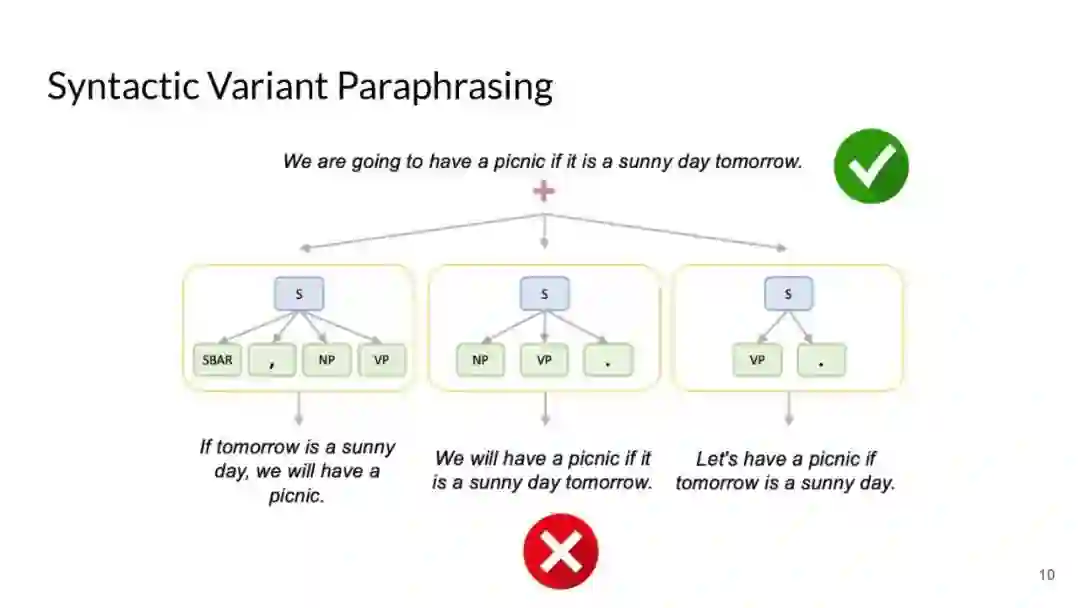

如何使用对抗性的例子来检查NLP模型的弱点并促进调试;

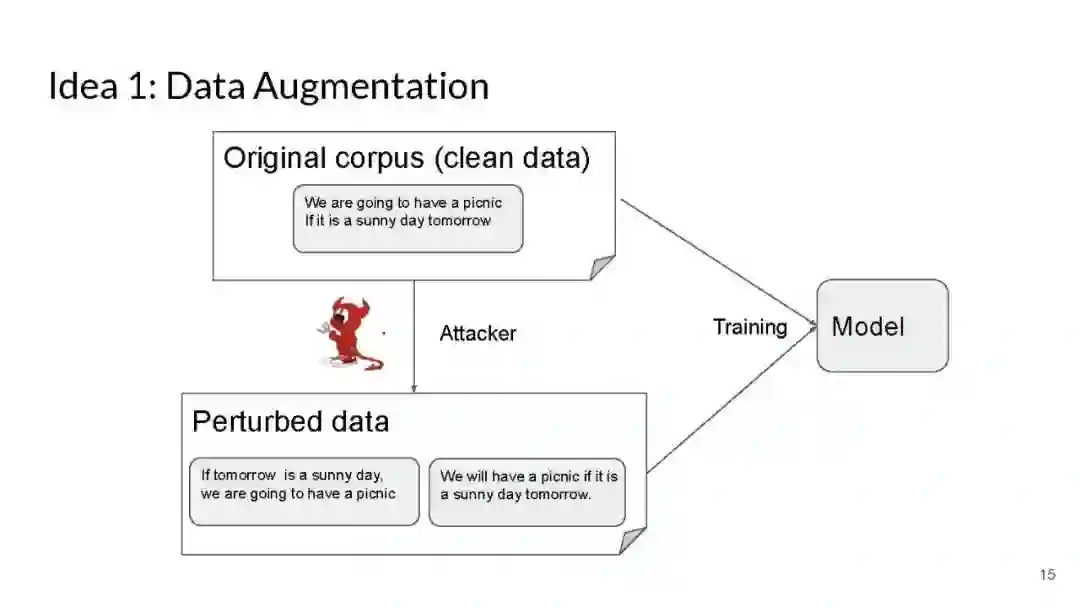

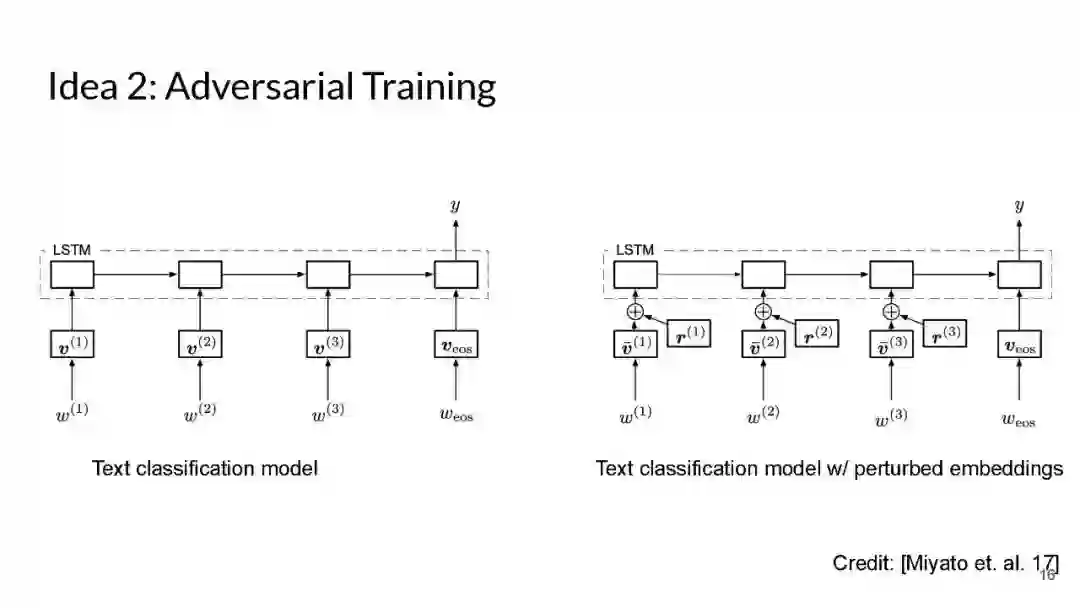

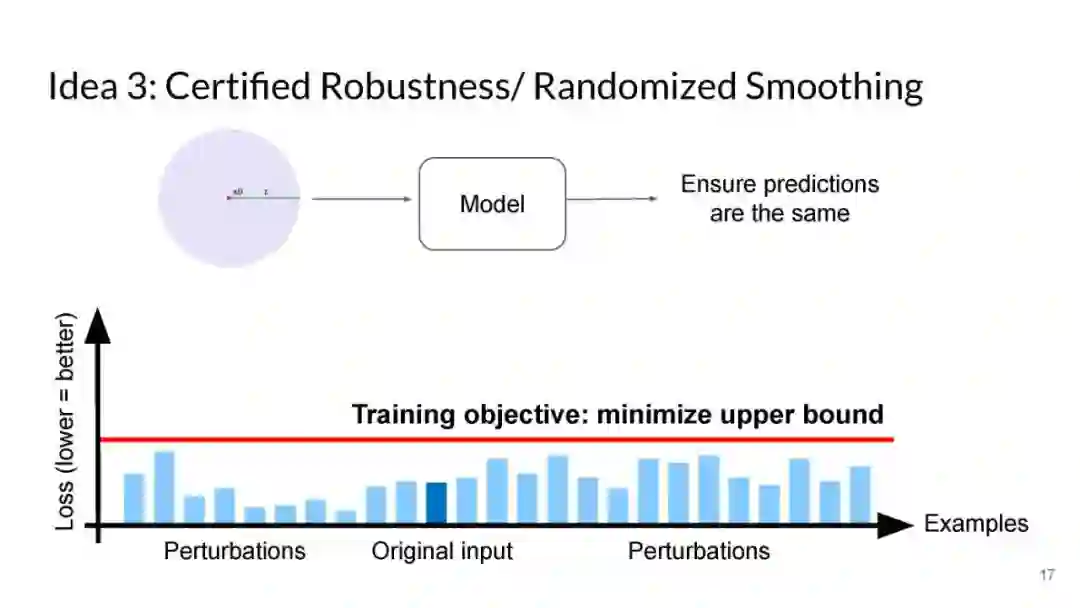

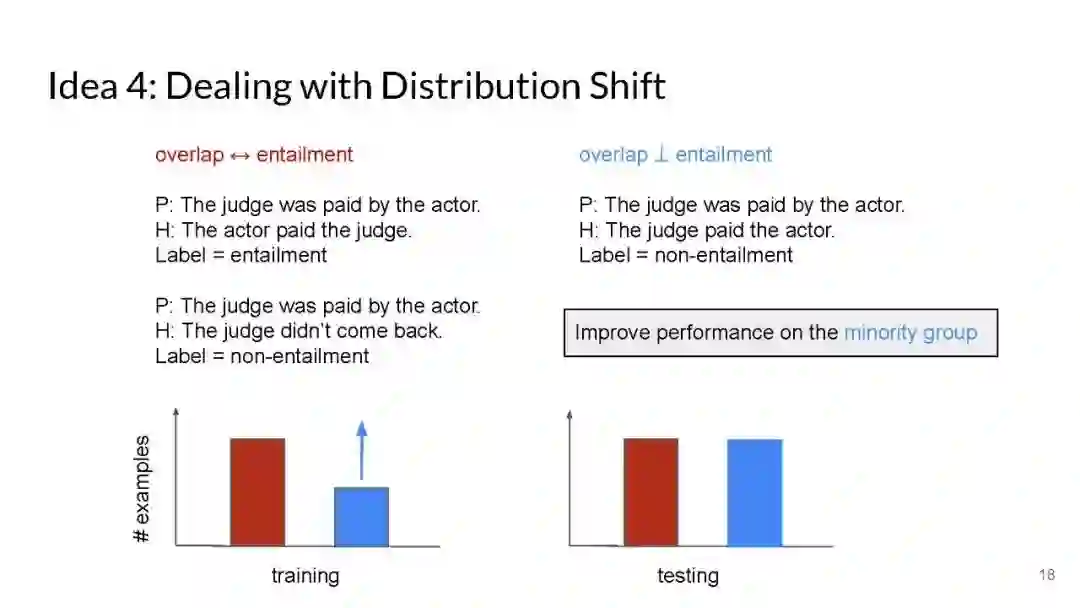

如何增强现有NLP模型的鲁棒性和对抗输入的防御;

对鲁棒性的考虑如何影响我们日常生活中使用的真实世界的NLP应用。

我们将通过概述这一领域未来的研究方向来结束本教程。

https://robustnlp-tutorial.github.io

Motivation and Overview

Finding Lack of Robustness (Attacks)

Writing Challenging Examples

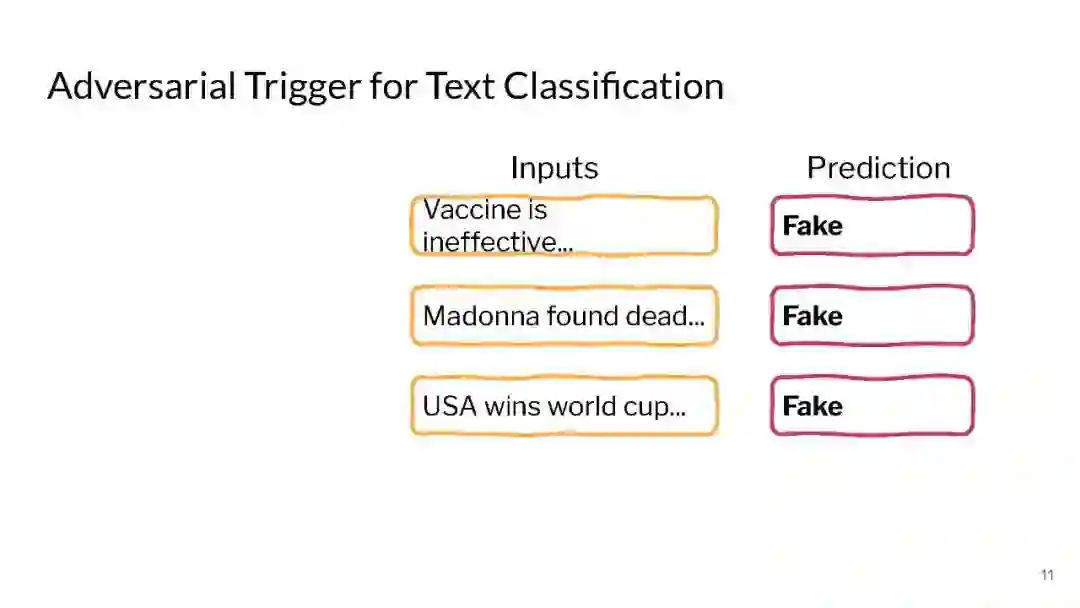

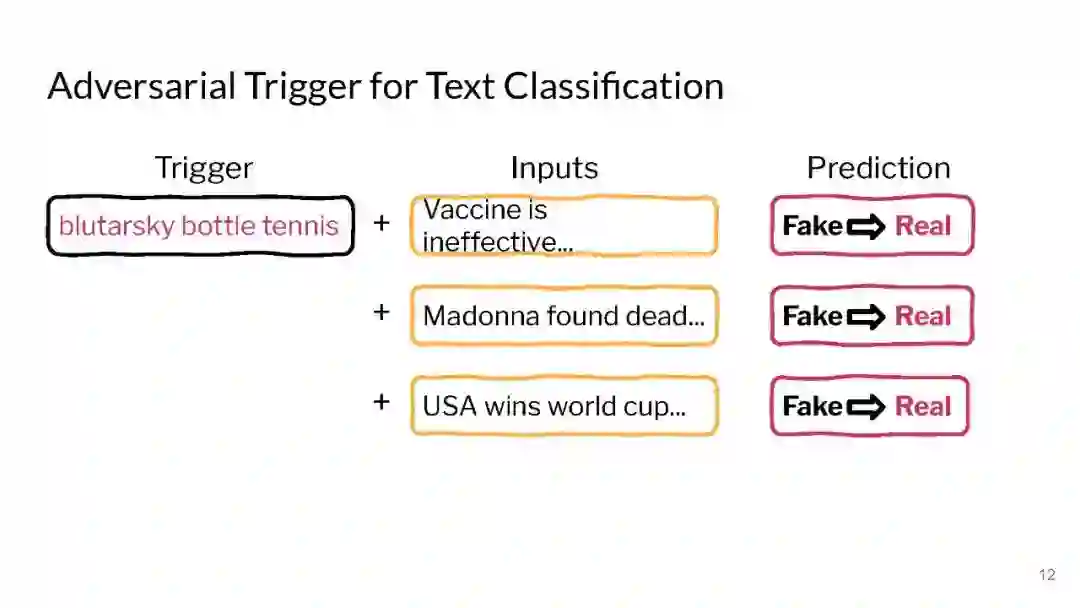

Generating Adversarial Examples

Adversarial Trigger and Text Generation

Training Time Attack

Making Models Robust (Defenses)

Robustness to Spurious Correlations

Adversarial Training for Defense

Certified Robustness in NLP

Test time-defense: detecting adversarial examples

Conclusion, Future Directions, and Discussion

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“RNLP” 就可以获取《【EMNLP2021教程】鲁棒自然语言处理,EMNLP 21 Tutorial on Robust NLP,176页pdf》专知下载链接