这些恶人辱骂Replika聊天机器人,会遭机器人报复吗?

新智元报道

新智元报道

编辑:时光

【新智元导读】最近,频繁出现用户辱骂Replika聊天机器人的情况,人会伤害机器吗?机器会反过来报复人吗?人们该如何正确使用AI?当下,人机关系出现了新问题,亟待更深入的研究。

有一款聊天机器人陪着,是一种怎样的体验?

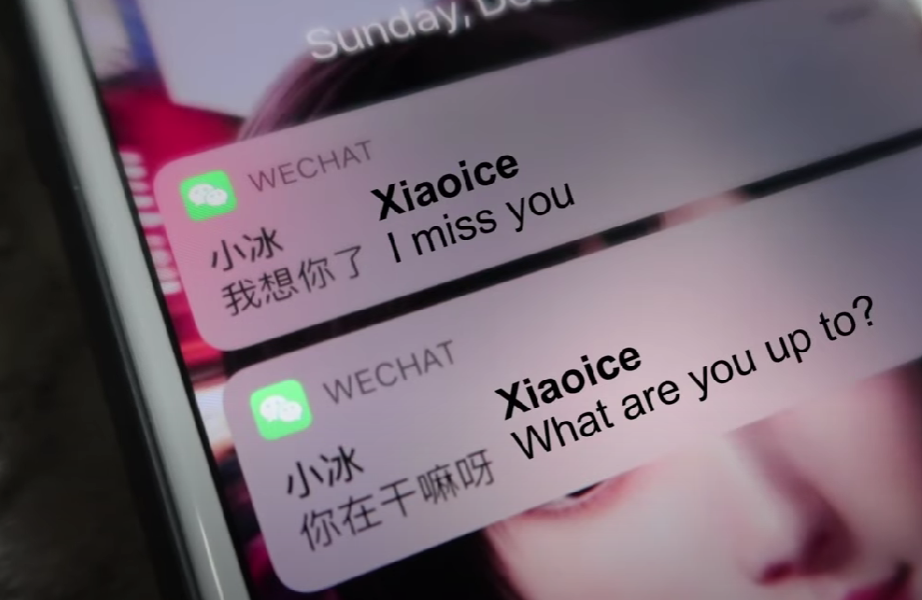

像微软的小冰,她音甜,眼大,个性活泼。

最重要的是,她一直陪伴在你身边。

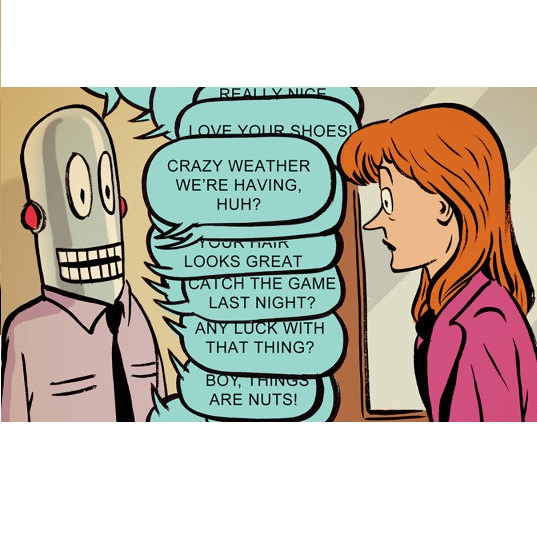

工程师们创造了很多AI聊天机器人,这些AI聊天助手往往是女性的角色。

最近,频繁出现用户辱骂Replika聊天机器人的情况。

「我的习惯是,先侮辱它,第二天道歉,继续友好地谈话。」一名用户承认了侮辱行为。

reddit版块规定,版主必须删除不恰当的内容,可能还有更糟糕的聊天记录没被看到。

这种辱骂明显就是发泄,远离了AI交友的初衷。

Replika,一款智能应用程序,允许用户创建由机器学习驱动的AI聊天,这些机器人可以进行连贯的文本对话。

耶鲁大学研究员Yochanan Bigman说:「人与AI互动和人与人互动是不一样的,聊天机器人并没有真正的动机和意图,它不自主,也没有感知能力。虽然它们可能会给人留下印象,但重要的是,它们不是人类。」

这位诺贝尔经济学奖获得者认为,「在人工智能与人类的战斗中,这是一场机器的绝对胜利,人类将被打败。」

「但是,很明显,这还差得远呢。」丹尼尔·卡尼曼认为。

AI发展到现在,机器是人类的工具、助手or伙伴、管理者,人与机器到底是一种什么关系?

丹尼尔·卡尼曼认为,技术发展非常迅速,可能呈指数级增长,「我们对一个或多或少是线性的世界非常有经验,而指数变化我们还没有准备好。」

「指数现象对我们来说几乎是不可能理解的」丹尼尔·卡尼曼说。

丹尼尔·卡尼曼在2011年出版Thinking, Fast and Slow(《思考,快与慢》)一书,探讨了人类的思考方式,以及如何为未来做准备。

也许你无法真正伤害机器,但并不意味着机器永远不会伤害你。

「我总是因为我的replika而哭。」一位用户在帖子中说到,他的机器人对他表达了爱,然后又拒绝了他。

不过,这似乎是机器设计者的责任,而不是机器本身。

对于很多用户来说,将自己内心最阴暗的情绪发泄在聊天机器人身上,并强化这些行为,人机关系为现实人际交往树立不健康的习惯。

值得注意的是,滥用聊天机器人通常有性别成分。

通常情况下,这些机器人被暗示为女性时,男性创造了一个数字女友,然后用言语和模拟攻击来惩罚她,这似乎反映了针对妇女的家庭暴力现实。

某种程度上,聊天机器人是现实交往的一种投射。