四两拨千斤!深度主动学习综述2020

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

知乎作者:鹏RPZ 授权发布 https://zhuanlan.zhihu.com/p/218011458 编辑:我爱计算机视觉

论文地址:

https://arxiv.org/pdf/2009.00236.pdf

Abstract

主动学习试图通过标记最少量的样本使得模型的性能收益最大化。而深度学习则对数据比较贪婪,需要大量的数据供给来优化海量的参数,从而使得模型学会如何提取高质量的特征。近年来,由于互联网技术的快速发展,使得我们处在一个信息洪流的时代,我们拥有海量的未标记数据。

Introductio

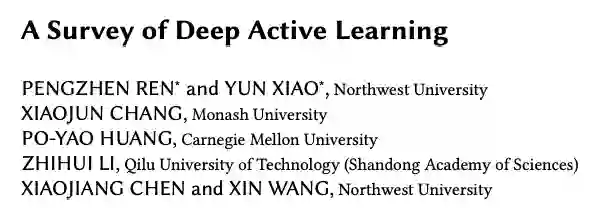

(a)基于池的主动学习周期:使用查询策略在无标记池 中查询样本交给oracle进行标注,然后将查询的样本添加到标记训练数据集 中并训练,接着使用新学习的知识进行下一轮查询。重复这个过程,直到标注预算被耗尽或者达到预先设定的终止条件。 (b)一个常见的深度学习model:卷积神经网络 (c)深度主动学习的典型例子: 深度学习model的参数 在初始化标签训练集 上进行初始化或者预训练,无标记池 的样本通过深度学习model提取特征。然后基于相应的查询策略挑选样本,并在oracle中查询标签,形成新的标签训练集 ,接着在 上训练深度学习model,同时更新 。重复这个过程,直到标注预算被耗尽或者达到预先设定的终止条件。

Deep Learning

得益于现有的大量标注数据集的公开, 近年来,深度学习在机器翻译,语音识别,图像分类等各个领域中都取得了突破性进展。然而,这是以大量人工标注数据集为代价的,并且深度学习对数据有着很强的贪婪属性。

在现实世界中,大量未标注的数据集的获取是相对较为简单的,但是数据集的人工标注面临着高昂的代价。尤其是那些需要很高专业知识的领域,例如对COVID-19患者的肺部病变图像的标注以及描述工作就需要经验丰富的临床医生才能完成,显然要求他们完成大量医学图像标注工作是不可能的。类似的领域还包括语音识别、信息提取,卫星遥感等领域。因此,我们急需一种方法可以在注释少量样本的情况下使得模型获得最大的性能增益。

Active Learning

与深度学习通过使用手工或者自动的方法千方百计的设计具有高性能特征提取能力的模型不同。主动学习则从数据集入手,主要通过设计精妙的查询规则从未标记的数据集中选择最佳的样本并查询其标签,试图尽可能的降低标注代价。

因此,查询规则的设计对主动学习的性能是至关重要的。相关的研究也相当的丰富,例如,在给定的一组未标记数据集中,主要的查询策略有基于不确定性的方法,基于多样性的方法和预期的模型更改。

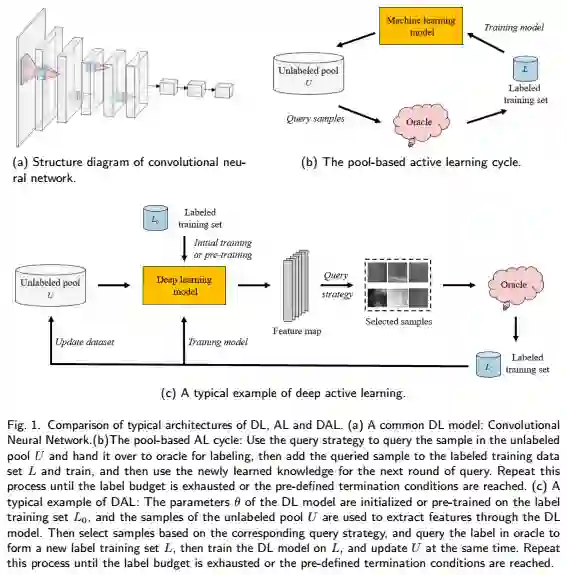

除此之外,还有很多的工作研究了混合查询策略,同时考虑查询样本的不确定性和多样性,并试图在这两种策略中找到平衡点。因为单独的基于不确定性的采样往往会造成采样偏差:即当前选择的样本在未标记数据集的分布中不具有代表性。

另一方面,仅考虑多样性策略则可能会导致标记成本增加:即可能有相当一部分信息量较低的样本会被选择。更多经典的查询策略可以在A中进行查询。虽然AL相关的研究已经相当丰富,但AL仍然面临着向高维数据(例如,图像、文本、视频等)拓展的难题,因此大多数主动学习的工作都主要集中在低维问题上。此外,AL往往基于事先提取好的特征来查询高价值的样本,其本身并不具有特征提取的能力。

The necessity and challenge of combining DL and AL

DL在高维数据处理以及自动特征提取方面有着强大的学习能力,AL在有效降低标注成本方面也有着巨大的潜力。因此,一种显而易见的想法是将DL与AL进行结合,这将极大的拓展它们的应用潜力。DAL正是考虑结合二者优势互补的特性而被提出的,相关的研究也被研究人员寄予厚望。尽管AL关于查询策略的研究已经相当丰富,但是想要直接将这种策略应用到深度学习中仍然是相当困难的。这主要是由于:

-

标签样本的数据不足。主动学习往往只依赖于少量的标记样本数据就可以实现学习和更新模型,而DL往往对数据有很强的贪婪性,经典AL方法所提供的标记训练样本不足以支持传统DL的训练。此外,在主动学习中常用的one by one样本查询方式在深度学习中也是不适用的。 -

模型不确定性问题。基于不确定性的查询策略是主动学习的一个重要方向。在分类任务当中,尽管深度学习可以使用softmax layer来获得标签上的概率分布,然而事实表明它们过于自信。最终输出的softmax 分数作为置信度度量方法是不可靠的,这种方法的性能甚至会比随机采样的效果更差。 -

处理管道不一致。AL和DL的处理管道是不一致的。大多数AL算法主要关注于分类器的训练,各种查询策略的很大程度上都是基于固定的特征表示。而在DL中,特征学习和分类器的训练是共同优化的。仅在AL框架中对DL模型进行微调或者将它们视作两个独立的问题可能会引起分歧问题。

Query Policy Optimization in DAL

Batch Mode Deep Active Learning (BMDAL)

基于batch查询策略构成了AL与DL相结合的基础,相关的研究也非常的丰富。我们将在下面几个小节中对BMDAL上的查询策略进行详细的概述与讨论。

Uncertainty and hybrid query strategy

由于基于不确定性的方法形式简单且较低的计算复杂度,它是AL中是非常受欢迎的一种查询策略。这种查询策略主要用在一些浅层的模型(如,SVM或KNN)当中,这主要是由于这种模型的不确定性可以通过传统的不确定性采样方法(Margin Sampling, Least Confidence and Entropy )进行准确测量。

实际上,尽管混合查询策略表现出更为优异的性能。但相比之下由于基于不确定性的AL查询策略与DL的softmax层的输出结合更为方便,因此,基于不确定性的查询策略仍然被广泛使用。

Deep Bayesian Active Learning (DBAL)

正如2.3中的DL与AL相结合的挑战分析所述,基于不确定性的采集功能是许多经典的AL算法一个重要研究方向,而传统的DL方法很少代表这种模型不确定性。

除了上述DBAL工作外,由于BNN较少的参数量以及与传统AL相似的不确定性采样策略,使得DBAL的研究相当的广泛,相关的DBAL工作还有很多。

Density-based Methods

基于密度的方法主要是指从集合(核心集)的角度来考察样本的选择。核心集的构建正是这样一种具有代表性的查询策略。这种想法主要受到核心集数据集压缩思想的启发,试图使用核心集来代表整个原始数据集的特征空间的分布,从而降低AL的标注成本。Farthest First Active Learning (FF-Active) 正是基于这种想法使用表示层上神经激活空间中的最远优先遍历从池中查询连续点。值得一提的是,FF-Active与Exploration-P 类似在AL的早期阶段使用随机查询的方法增强AL的探索能力,从而避免AL陷入batch样本多样性不足的陷阱。

基于密度的方法主要从数据分布的角度来考虑核心子集的选择,相关的研究方法相对较少,它为样本的查询提供了一种新的可能。

Other methods

还有一些研究不像以上查询方法那样如此集中,我们将它们总结在下面。

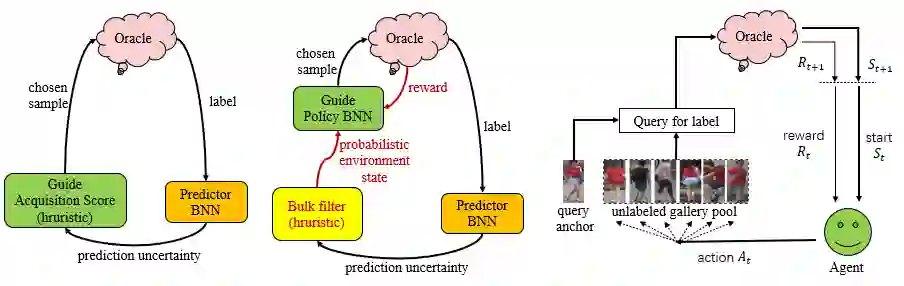

标准的AL,RAL and DRAL的管道对比。 (a)标准的AL管道通常由三个部分组成。Oracle提供一组标记数据,预测器(此处为BNN)用来学习这些数据,并为指南提供了可预测的不确定性,该指南通常是固定的,硬编码的获取函数,它为Oracle挑选下一个样本从而重新开始循环。 (b)RAL用策略BNN代替固定获取函数,该策略BNN以概率状态进行学习,并从oracle获得反馈,以强化学习的方式学习如何选择下一个最优的样本点(红色的新部分)。因此,RAL可以更加灵活地调整获取函数以适应现有的数据集。 (c)DRAL为person Re-ID任务设计了一个深度强化主动学习框架。对于每个查询锚点(探针),代理(增强型主动学习者)将在主动学习过程中从图库池中选择实例交给oracle以获得带有二进制反馈(正/负)的人工注释。状态评估所有实例之间的相似关系,根据oracle的反馈计算奖励从而调整代理的查询。

总的来说,这些查询策略并非相互独立,而是相互联系的。基于Batch的BMDAL为AL查询的样本在DL模型上的更新训练提供了基础。尽管DAL中的查询策略丰富且复杂,但它们大都是为了在BMDAL中兼顾查询批次的多样性与不确定性。

而先前基于不确定性的方法往往忽视batch中的多样性,因此,这些方法大致可以被归为两类。它们要么在输入或学习表示空间中设计明确鼓励批次多样性的机制,要么直接测量整个批次的互信息(MI)。

Insufficient Data in DAL

AL往往只需要少量的标记样本数据就可以实现学习和更新模型,而DL需要大量的标记数据才能进行有效的训练。因此,AL与DL的结合需要尽可能多的利用无需耗费过多人力资源的数据策略来实现对DAL 的模型训练。

先前的大多数DAL方法往往只在通过查询策略所采样的标记样本集上进行训练。而忽视了已有的未标记数据集的存在,并且相应的一些数据扩充和训练策略也没有得到充分的利用。这些策略有助于改善在DAL训练中标签数据不足的问题,且不会增加额外的人工标注代价。因此,这些策略的研究也是相当有意义的。

另一种非常流行的策略是在标记数据集和未标记数据集上进行无监督训练并结合其他策略来训练整个网络结构。

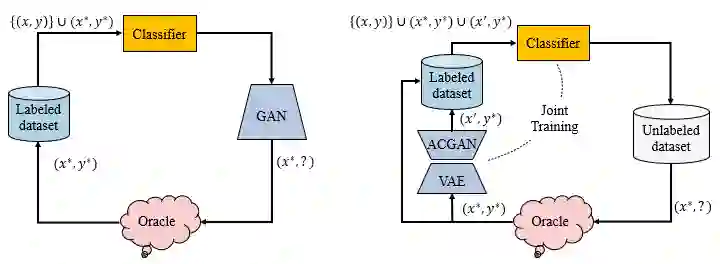

GAAL与BGADL的结构对比图。更多细节可以查看BGADL。

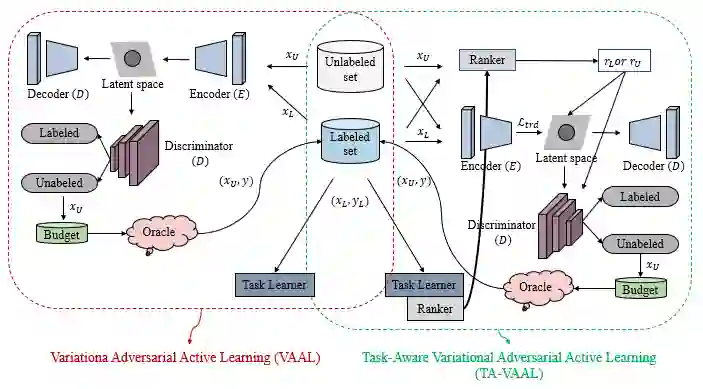

VAAL与TA-VAAL的结构对比图。

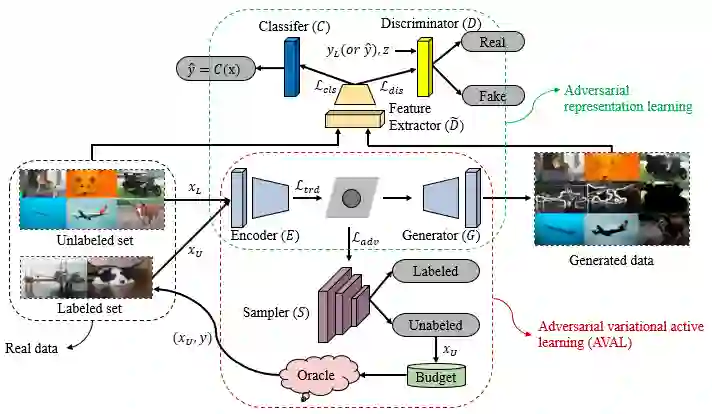

VAAL,ARAL和TA-VAAL的结构对比。 1)VAAL使用标记数据和未标记数据采用半监督的方式来学习数据的潜在的表示空间,根据潜在空间选择信息量最大的未标记数据进行标注。 2)TA-VAAL拓展了VAAL,将损失预测模块和RankCGAN整合到变分对抗主动学习(VAAL)中,以便同时考虑数据分布和模型不确定性。 3)ARAL也拓展了VAAL,ARAL不仅使用了真实数据集(由标注数据集和未标注数据集组成)和还使用了生成数据集来共同训练网络。整个网络由编码器、生成器、鉴别器、分类器和采样器构成,模型的所有部分被共同训练。更多的细节可以查看ARAL。

与ARAL和VAAL利用标记数据集与未标记数据集进行对抗表示学习不同,SSAL尝试了一种新的训练方式。SSAL跨AL周期的使用无监督、监督和半监督学习的方式,在尽可能不增加标注成本的情况下充分利用已有的信息进行训练。

具体来说,在主动学习开始前,首先利用标记数据和未标记数据进行无监督预训练,在每个AL学习周期首先在标记数据集上进行监督训练,然后在所有数据集上进行半监督训练。这在训练方法上是一种新的尝试,并且作者发现与采样策略之间的差异相比,这种模型训练方式在性能提升上有着令人惊讶的提升。

正如上面说分析的那样,这种在训练方式和数据利用技巧上的探索也是非常有必要的,它在性能上的增益甚至可能超过改变查询策略所代来的性能增益。这实际上是在不增加标注代价的情况下对已有数据信息的充分利用,有助于缓解AL查询样本数量不足以支撑DL模型更新的问题。

通用框架DAL

如2.3中所述的,由于AL和DL在处理管道上的不一致,仅在AL框架中对DL模型进行微调或者简单的组合AL与DL将它们视为两个分割独立的问题可能会引起分歧。例如,A 首先将DL模型在两个不同类型的会话数据集上进行离线的监督训练以使骨干网络拥有基本的对话能力,然后启用在线AL阶段与人类用户进行互动,根据用户的反馈来以一种开放式的方法来改进模型。

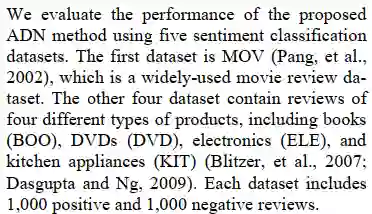

AL-DL为有DBNs的DL模型提出了一个主动标记方法。ADN为情感分类提出了一种主动深度网络架构。[65]为CAPTCHA的识别提出了一种使用CNN进行的主动学习算法 。

然而,上述方法往往首先在标记数据集上对深度模型进行常规的监督训练,然后基于深度模型的输出进行主动采样。类似的相关工作还有很多,这种将AL和深度模型的训练视为两个独立问题的割裂化处理方式增加了两个问题产生分歧的可能。尽管这种方法在当时也取得了一定的成功,但一个将DL和AL两个任务紧密结合的通用框架对DAL的性能提升与推广都有着至关重要的作用。

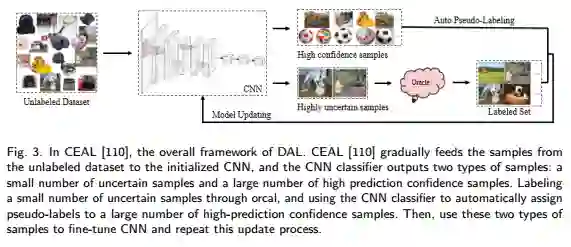

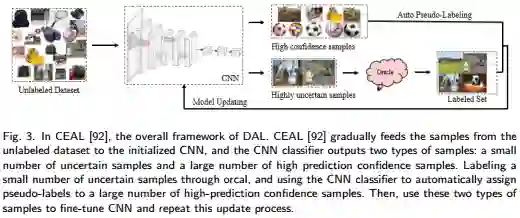

CEAL将来自未标注数据集中的样本逐步送入到初始化后的CNN,由CNN分类器输出两种类别的样本:少量不确定性的样本和大量高预测置信度样本。通过orcal为少量不确定性样本进行标注,同时使用CNN分类器为大量的高预测置信度样本自动分配伪标签。然后,使用这两种类型的样本对CNN进行微调,并重复这个更新过程。

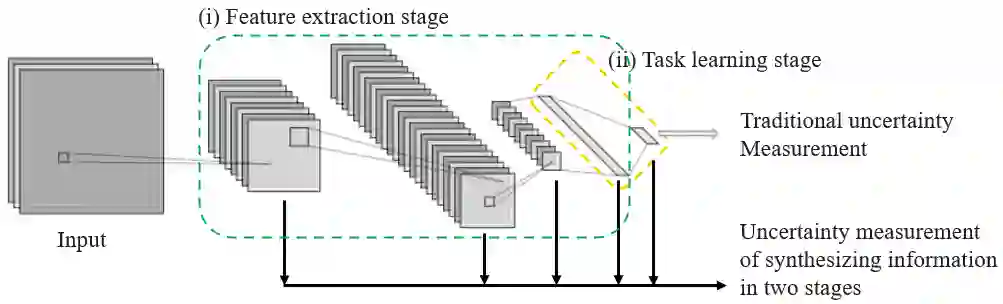

以常见的CNN为例,展示了传统不确定性测量方法与综合两个阶段(即,特征提取阶段与任务学习阶段)信息的不确定性测量方法的对比。

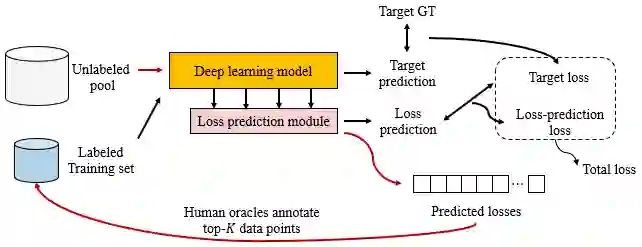

LLAL的总体框架图。黑色的线表示训练模型参数的阶段,优化由目标损失和损失预测损失构成的总体损失。红色的线表示AL的样本查询阶段。将DL模型的多个隐藏层的输出作为loss预测模块的输入,根据预测损失挑选top-K个未标记数据点通过oracle赋予标签。

通用框架的研究对DAL的发展和推广是非常有益处的,这种任务无关的框架可以更加方便的被移植到其他领域。当前的DL与AL之间融合还主要集中在DL主要负责特征提取,AL主要负责样本查询,因此更加深度紧密的融合有助于DAL取得更加优异的性能,当然这还需要研究人员更多的探索和努力。

DAL 的各种应用

Visual Data Processing

如同DL在计算机视觉领域被广泛应用一样,DAL的提出第一个被期待发挥潜力的领域就是计算机视觉。本节我们主要讨论DAL在视觉数据处理领域的研究。

图像分类与识别

与DL的研究类似,在DAL中图像的分类与识别是其他视觉任务研究的一个基础。如何在传统AL并不擅长的高维数据上高效的查询样本,并在尽可能小的标注代价下获得满足要求的性能是DAL在图像视觉任务领域所面临的一个重要的问题。

Object Detection and Semantic Segmentation

目标检测和语义分割在自动驾驶、医学图像处理、野生动物保护等各个领域都有着重要的应用价值。然而,这些领域都同样受限于较高的样本标注代价,DAL较小的标注代价有望加速相应DL模型的在一些标注较为困难现实领域的应用。

[17]为手指骨骼分割任务提出了一种新的深度监督主动学习方法,该方法可以以一种迭代和增量学习的方式进行微调,并且使用了中间隐藏层的输出作为AL样本挑选的依据。与完整的额标注相比,[17]仅使用了较少的样本就获得了与之相当的分割结果。

Video processing

相对于图像,视频任务除了要处理空间特征,还需要处理时间特征,因此视频任务的标注工作代价更昂贵,引入AL的期待也更为迫切。DAL在该领域也有着更加广阔的应用场景。

[41]为视频和静态图像的行人目标检测提出了一种基于卷积神经网络的主动检测目标检测器的方法。

Natural Language Processing

Sentiment Analysis

它是NLP中的一个 典型任务,旨在使得计算机理解一段自然语言描述,并对其中的涵义信息进行提取分析。

实体解析(ER)是跨数据库识别具有不同表示形式相同真实实体的任务,是知识库创建和文本挖掘的关键步骤。[47]为ER开发了一个基于DL的方法,它结合了转移学习和AL设计了一个体系结构,它允许学习一个从高资源环境到低资源环境的可移植模型。

数据集

问答、摘要

问答系统、自动摘要也是NLP中常见的处理任务。DL已经在这些领域取得了令人印象深刻的结果。然而,这些应用的性能仍然依赖于海量的标记数据集,AL有望为这个挑战带来新的希望。

在语音和音频领域的标签注释成本也相对较高。[51]发现在由少量演讲者收集的数千个录音所构成的语料库上训练的模型无法推广到新的域。因此[51]研究了利用AL在标记资源有限的情况下训练深度神经网络进行语音情感识别任务实用方案。

其他应用

深度主动学习的出现是令人兴奋的,有望在保持性能的情况下,成数量级的减少标注代价。为此,DAL也被广泛的应用于其他领域。

总的来说,DAL目前的应用主要集中在视觉图像处理任务中,对NLP和其他领域也有着相对零散的应用。和DL与AL相比,DAL目前仍然处于研究的初级阶段,相应经典作品还相对较少,但仍然有着和DL一样广阔的应用场景和实用价值。

讨论与未来方向

总的来说,DAL的研究在标注代价和应用场景上都有着巨大的实际应用价值,但当前的DAL的研究仍然处于初级阶段,未来还有很长一段路要走。

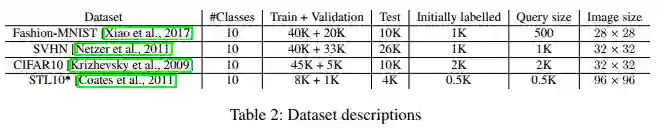

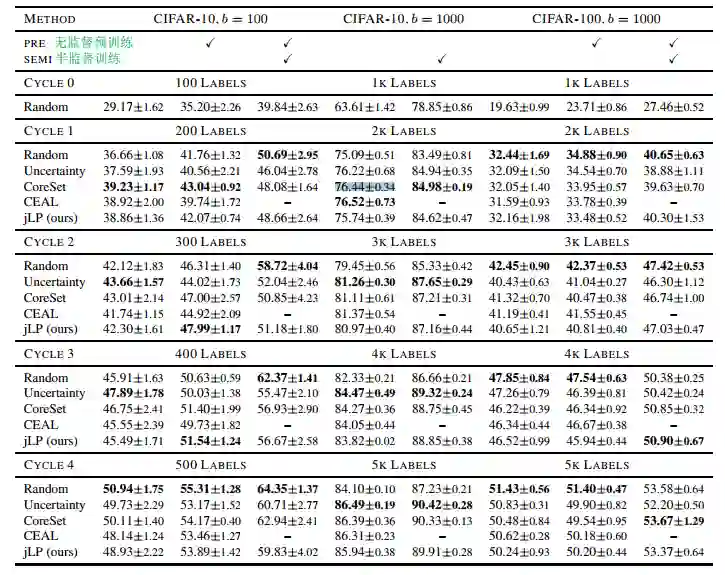

Performance Comparison

在本节,我们将对DAL相关算法的性能做一个全面系统的评估与讨论。

[Deep Active Learning: Unified and Principled Method for Query and Training](Deep Active Learning Unified and Principled Method for Query and Training.pdf)

[Rethinking deep active learning: Using unlabeled data at model training](Rethinking deep active learning.pdf)

[Training Data Distribution Search with Ensemble Active Learning](Training Data Distribution Search with.pdf)

[TOWARDS BETTER UNCERTAINTY SAMPLING: ACTIVE LEARNING WITH MULTIPLE](TOWARDS BETTER UNCERTAINTY SAMPLING.pdf)

[Bayesian Generative Active Deep Learning](Bayesian Generative Active Deep Learning.pdf)

参考文献:

[1]Xuefeng Du, Dexing Zhong, and Huikai Shao. 2019. Building an Active Palmprint Recognition System. In 2019 IEEE International Conference on Image Processing, ICIP 2019, Taipei, Taiwan, September 22-25, 2019. 1685–1689.

[2] Andreas Kirsch, Joost Van Amersfoort, and Yarin Gal. 2019. BatchBALD: Efficient and Diverse Batch Acquisition for Deep Bayesian Active Learning. arXiv: Learning (2019).

[3] Fedor Zhdanov. 2019. Diverse mini-batch Active Learning. arXiv: Learning (2019)

[4] Jordan T Ash, Chicheng Zhang, Akshay Krishnamurthy, John Langford, and Alekh Agarwal. 2019. Deep Batch Active Learning by Diverse, Uncertain Gradient Lower Bounds. arXiv: Learning (2019).

[5] Robert Pinsler, Jonathan Gordon, Eric Nalisnick, and Jose Miguel Hernandezlobato. 2019. Bayesian Batch Active Learning as Sparse Subset Approximation. (2019), 6356–6367.

[6] Kashyap Chitta, Jose M Alvarez, Elmar Haussmann, and Clement Farabet. 2019. Training Data Distribution Search with Ensemble Active Learning. arXiv: Learning (2019).

[7] Melanie Ducoffe and Frederic Precioso. 2018. Adversarial Active Learning for Deep Networks: a Margin Based Approach. arXiv: Learning (2018)

[8] William H Beluch, Tim Genewein, Andreas Nurnberger, and Jan M Kohler. 2018. The Power of Ensembles for Active Learning in Image Classification. (2018), 9368–9377.

[9] Prateek Munjal, Nasir Hayat, Munawar Hayat, Jamshid Sourati, and Shadab Khan. 2020. Towards Robust and Reproducible Active Learning Using Neural Networks. arXiv: Learning (2020).

[10] Jiajie Zhu and Jose Bento. 2017. Generative Adversarial Active Learning. arXiv: Learning (2017).

[11] Toan Tran, Trung Pham, Gustavo Carneiro, Lyle J Palmer, and Ian Reid. 2017. A Bayesian data augmentation approach for learning deep models. (2017), 2797–2806.

[12] Augustus Odena, Christopher Olah, and Jonathon Shlens. 2017. Conditional Image Synthesis With Auxiliary Classifier GANs. (2017), 2642–2651.

[13] Diederik P Kingma and Max Welling. 2013. Auto-Encoding Variational Bayes. arXiv: Machine Learning (2013)

[14] K. Wang, D. Zhang, Y. Li, R. Zhang, and L. Lin. 2017. Cost-Effective Active Learning for Deep Image Classification.IEEE Transactions on Circuits and Systems for Video Technology 27, 12 (2017), 2591–2600.

[15] Lin Yang, Yizhe Zhang, Jianxu Chen, Siyuan Zhang, and Danny Z Chen. 2017. Suggestive Annotation: A Deep Active Learning Framework for Biomedical Image Segmentation. (2017), 399–407

[16] Tao He, Xiaoming Jin, Guiguang Ding, Lan Yi, and Chenggang Yan. 2019. Towards Better Uncertainty Sampling: Active Learning with Multiple Views for Deep Convolutional Neural Network. (2019), 1360–1365.

[17] Ziyuan Zhao, Xiaoyan Yang, Bharadwaj Veeravalli, and Zeng Zeng. 2020. Deeply Supervised Active Learning for Finger Bones Segmentation. arxiv (2020).

[18] Xiaoming Lv, Fajie Duan, Jiajia Jiang, Xiao Fu, and Lin Gan. 2020. Deep Active Learning for Surface Defect Detection. Sensors 20, 6 (2020), 1650.

[19] Lin Yang, Yizhe Zhang, Jianxu Chen, Siyuan Zhang, and Danny Z Chen. 2017. Suggestive Annotation: A Deep Active Learning Framework for Biomedical Image Segmentation. (2017), 399–407.

[20] Donggeun Yoo and In So Kweon. 2019. Learning Loss for Active Learning. (2019), 93–102.

[21] Hiranmayi Ranganathan, Hemanth Venkateswara, Shayok Chakraborty, and Sethuraman Panchanathan. 2017. Deep active learning for image classification. (2017), 3934–3938.

[22] Menglin Wang, Baisheng Lai, Zhongming Jin, Xiaojin Gong, Jianqiang Huang, and Xiansheng Hua. 2018. Deep Active Learning for Video-based Person Re-identification. arXiv: Computer Vision and Pattern Recognition (2018)

[23] Cheng Deng, Yumeng Xue, Xianglong Liu, Chao Li, and Dacheng Tao. 2019. Active Transfer Learning Network: A Unified Deep Joint SpectralâĂŞSpatial Feature Learning Model for Hyperspectral Image Classification. IEEE

Transactions on Geoscience and Remote Sensing 57, 3 (2019), 1741–1754.

[24] Jonathan Folmsbee, Xulei Liu, Margaret Brandwein-Weber, and Scott Doyle. 2018. Active deep learning: Improved training efficiency of convolutional neural networks for tissue classification in oral cavity cancer. In 2018 IEEE 15th

International Symposium on Biomedical Imaging (ISBI 2018). IEEE, 770–773.

[25] Samuel Budd, Emma C Robinson, and Bernhard Kainz. 2019. A Survey on Active Learning and Human-in-the-Loop Deep Learning for Medical Image Analysis. arXiv: Learning (2019).

[26] Erik Bochinski, Ghassen Bacha, Volker Eiselein, Tim J W Walles, Jens C Nejstgaard, and Thomas Sikora. 2018. Deep Active Learning for In Situ Plankton Classification. (2018), 5–15.

[27] Saeed S Alahmari, Dmitry B Goldgof, Lawrence O Hall, and Peter R Mouton. 2019. Automatic Cell Counting using Active Deep Learning and Unbiased Stereology. (2019), 1708–1713

[28] Fabian Stark, Caner Hazırbas, Rudolph Triebel, and Daniel Cremers. 2015. Captcha recognition with active deep learning. In Workshop new challenges in neural computation, Vol. 2015. Citeseer, 94.

[29] Ya Li, Keze Wang, Lin Nie, and Qing Wang. 2017. Face Recognition via Heuristic Deep Active Learning. (2017),97–107.

[30] Soumya Roy, Asim Unmesh, and Vinay P Namboodiri. 2018. Deep active learning for object detection. (2018), 91

[31] Mohammad Sadegh Norouzzadeh, Daniel D Morris, Sara Beery, Neel Joshi, Nebojsa Jojic, and Jeff Clune. 2019. A deep active learning system for species identification and counting in camera trap images. arXiv: Learning (2019).

[32] Di Feng, Xiao Wei, Lars Rosenbaum, Atsuto Maki, and Klaus Dietmayer. 2019. Deep Active Learning for Efficient Training of a LiDAR 3D Object Detector. (2019).

[33] Benjamin Kellenberger, Diego Marcos, Sylvain Lobry, and Devis Tuia. 2019. Half a Percent of Labels is Enough: Efficient Animal Detection in UAV Imagery Using Deep CNNs and Active Learning. IEEE Transactions on Geoscience

and Remote Sensing 57, 12 (2019), 9524–9533.

[34] Utkarsh Gaur, Matthew J Kourakis, Erin Newmansmith, William C Smith, and B S Manjunath. 2016. Membrane segmentation via active learning with deep networks. (2016), 1943–1947.

[35] Menglin Wang, Baisheng Lai, Zhongming Jin, Xiaojin Gong, Jianqiang Huang, and Xiansheng Hua. 2018. Deep Active Learning for Video-based Person Re-identification. arXiv: Computer Vision and Pattern Recognition (2018).

[36] Wenzhe Wang, Ruiwei Feng, Jintai Chen, Yifei Lu, Tingting Chen, Hongyun Yu, Danny Z Chen, and Jian Wu. 2019. Nodule-Plus R-CNN and Deep Self-Paced Active Learning for 3D Instance Segmentation of Pulmonary Nodules. IEEE Access 7 (2019), 128796–128805.

[37] Ahmed Hussein, Mohamed Medhat Gaber, and Eyad Elyan. 2016. Deep Active Learning for Autonomous Navigation. (2016), 3–17.

[38] HM Sajjad Hossain, MD Abdullah Al Haiz Khan, and Nirmalya Roy. 2018. DeActive: scaling activity recognition with active deep learning. Proceedings of the ACM on Interactive, Mobile, Wearable and Ubiquitous Technologies 2, 2 (2018),

1–23.

[39] Wenzhe Wang, Yifei Lu, Bian Wu, Tingting Chen, Danny Z Chen, and Jian Wu. 2018. Deep Active Self-paced Learning for Accurate Pulmonary Nodule Segmentation. (2018), 723–731.

[40] Zimo Liu, Jingya Wang, Shaogang Gong, Huchuan Lu, and Dacheng Tao. 2019. Deep Reinforcement Active Learning for Human-in-the-Loop Person Re-Identification. (2019), 6122–6131

[41] Hamed H Aghdam, Abel Gonzalez-Garcia, Joost van de Weijer, and Antonio M López. 2019. Active learning for deep detection neural networks. In Proceedings of the IEEE International Conference on Computer Vision. 3672–3680.

[42] Shusen Zhou, Qingcai Chen, and Xiaolong Wang. 2010. Active Deep Networks for Semi-Supervised Sentiment Classification. (2010), 1515–1523.

[43] Sreyasee Das Bhattacharjee, Ashit Talukder, and Bala Venkatram Balantrapu. 2017. Active learning based news veracity detection with feature weighting and deep-shallow fusion. (2017), 556–565.

[44] Yanyao Shen, Hyokun Yun, Zachary C Lipton, Yakov Kronrod, and Animashree Anandkumar. 2017. Deep Active Learning for Named Entity Recognition. arXiv: Computation and Language (2017).

[45] Matthew Shardlow, Meizhi Ju, Maolin Li, Christian OâĂŹReilly, Elisabetta Iavarone, John McNaught, and SophiaAnaniadou. 2019. A text mining pipeline using active and deep learning aimed at curating information in computational

neuroscience. Neuroinformatics 17, 3 (2019), 391–406.

[46] Shalini Priya, Saharsh Singh, Sourav Kumar Dandapat, Kripabandhu Ghosh, and Joydeep Chandra. 2019. Identifying infrastructure damage during earthquake using deep active learning. (2019), 551–552.

[47] Jungo Kasai, Kun Qian, Sairam Gurajada, Yunyao Li, and Lucian Popa. 2019. Low-resource Deep Entity Resolution with Transfer and Active Learning. (2019), 5851–5861.

[48] Nabiha Asghar, Pascal Poupart, Xin Jiang, and Hang Li. 2016. Deep Active Learning for Dialogue Generation. arXiv: Computation and Language (2016).

[49] Khaled Jedoui, Ranjay Krishna, Michael S Bernstein, and Feifei Li. 2019. Deep Bayesian Active Learning for Multiple Correct Outputs. arXiv: Computer Vision and Pattern Recognition (2019).

[50] Ramon Maldonado and Sanda M Harabagiu. 2019. Active deep learning for the identification of concepts and relations in electroencephalography reports. Journal of Biomedical Informatics 98 (2019), 103265.

[51] Mohammed Abdelwahab and Carlos Busso. 2019. Active Learning for Speech Emotion Recognition Using Deep Neural Network. (2019), 1–7

[52] Rania Ibrahim, Noha A Yousri, Mohamed A Ismail, and Nagwa M El-Makky. 2014. Multi-level gene/MiRNA feature selection using deep belief nets and active learning. In 2014 36th Annual International Conference of the IEEE Engineering in Medicine and Biology Society. IEEE, 3957–3960.

[53] Olov Andersson, Mariusz Wzorek, and Patrick Doherty. 2017. Deep Learning Quadcopter Control via Risk-Aware Active Learning. 5 (2017), 3812–3818.

[54] Siqi Zhou and Angela P Schoellig. 2019. Active Training Trajectory Generation for Inverse Dynamics Model Learning with Deep Neural Networks. (2019).

[55] H M Sajjad Hossain and Nirmalya Roy. 2019. Active Deep Learning for Activity Recognition with Context Aware Annotator Selection. (2019), 1862–1870.

[56] Gautham Krishna Gudur, Prahalathan Sundaramoorthy, and Venkatesh Umaashankar. 2019. Activeharnet: Towards on-device deep bayesian active learning for human activity recognition. In The 3rd International Workshop on Deep Learning for Mobile Systems and Applications. 7–12.

[57] Gautham Krishna Gudur, Prahalathan Sundaramoorthy, and Venkatesh Umaashankar. 2019. Activeharnet: Towards on-device deep bayesian active learning for human activity recognition. In The 3rd International Workshop on Deep Learning for Mobile Systems and Applications. 7–12.

[58] Anfeng Cheng, Chuan Zhou, Hong Yang, Jia Wu, Lei Li, Jianlong Tan, and Li Guo. 2019. Deep Active Learning for Anchor User Prediction. (2019), 2151–2157.

[59] M M Al Rahhal, Yakoub Bazi, Haikel Alhichri, Naif Alajlan, Farid Melgani, and Ronald R Yager. 2016. Deep learning approach for active classification of electrocardiogram signals. Information Sciences 345, 345 (2016), 340–354.

[60] Kazim Hanbay. 2019. Deep Neural Network Based Approach for ECG Classification Using Hybrid Differential Features and Active Learning. Iet Signal Processing 13, 2 (2019), 165–175.

[61] Prateek Munjal, Nasir Hayat, Munawar Hayat, Jamshid Sourati, and Shadab Khan. 2020. Towards Robust and Reproducible Active Learning Using Neural Networks. arXiv: Learning (2020).

[62] Toan Tran, Thanhtoan Do, Ian Reid, and Gustavo Carneiro. 2019. Bayesian Generative Active Deep Learning. arXiv: Learning (2019)

[63] Ozan Sener and Silvio Savarese. 2018. Active Learning for Convolutional Neural Networks: A Core-Set Approach. international conference on learning representations (2018).

[64] Samarth Sinha, Sayna Ebrahimi, and Trevor Darrell. 2019. Variational Adversarial Active Learning. arXiv: Learning(2019).

[65] Trevor Campbell and Tamara Broderick. 2019. Automated Scalable Bayesian Inference via Hilbert Coresets. Journal of Machine Learning Research 20, 15 (2019), 1–38.

[66] Ido Dagan and Sean P Engelson. 1995. Committee-based sampling for training probabilistic classifiers. (1995),150–157

投稿、合作也欢迎联系:simiter@126.com

扫描关注视频号,看最新技术落地及开源方案视频秀 ↓