实验室学生参加 IJCAI 2019会议并做报告

点击蓝字

关注我们

会议资讯

IJCAI 2019(the 28th International Joint Conference on Artificial Intelligence)是人工智能领域的顶级国际会议,于2019年8月10日至16日在中国澳门举行。本次会议收到有效投稿4752篇,最终录用850篇,录用率17.8%。

此次会议中,实验室硕士研究生郑万山、陈子泰、刘阳的三篇论文被录用,并以口头报告的形式受邀参会。

论文介绍

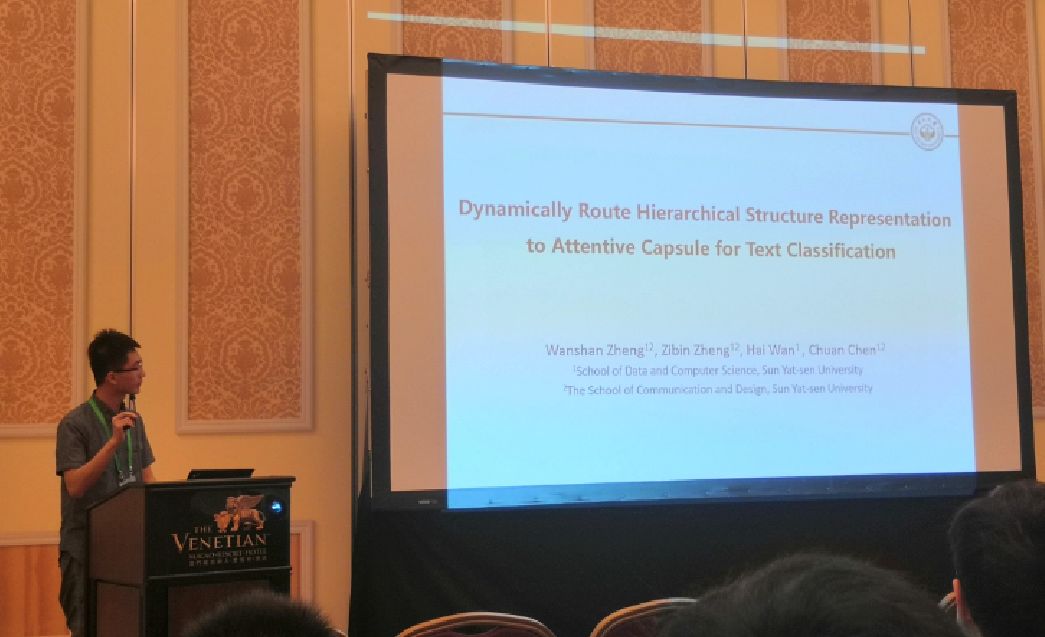

郑万山同学参会的论文题目为 “ Dynamically Route Hierarchical Structure Representation to Attentive Capsule for Text Classification ” 。

文本分类是NLP的基础任务,深度神经网络在该任务上表现出色,但是已有工作难以通过表示学习自动学习合适的结构特征,并且在特征聚合上缺少能够有效利用这些特征的方式。针对这两方面局限,论文提出了一种新颖的文本分类框架HAC,将分层的结构化表示动态路由至基于注意力的胶囊网络。作者首次利用深度空洞卷积网络中的中间层信息,构造层次化结构表示,不同等级的结构表示对应特定的语言单元。此外,作者设计了融合注意力机制的胶囊网络模块,该聚合策略能够高效地进行特征选择和聚类。在大量的公开数据集实验中,论文提出的HAC模型超过目前先进基线模型,消融实验和可视化等进一步验证了本模型的有效性。

获取论文原文,请访问

https://www.ijcai.org/proceedings/2019/0759.pdf

陈子泰同学参会的论文题目为 “ Variational Graph Embedding and Clustering with Laplacian Eigenmaps ”。

图聚类或者社区发现的目的是挖掘网络组成相对紧密的节点集合,用以分析节点的群体特征和发现社群信息。在这个问题上有几大难点:对于大规模网络,节点的原始表征是稀疏高维的,在聚类问题上会造成维度灾难,而在低维表征中往往会丢失节点间的关系信息,最重要的是在图中的节点是相互关联和影响的,每个节点都暗含不同的不稳定性,仅用一个向量学习表征是不鲁棒的。论文主要是提出一种结合类似拉普拉斯特征图约束的概率节点表征和聚类算法。

本文中我们为了分离节点表征中的不稳定性,将节点表征成为一个高斯分布,均值和方差分别代表中心表征和不稳定性,利用带高斯混合先验的变分自编码器完成表征和聚类任务,同时在随机梯度下降优化场景下提出教师-学生机制保留节点间关系信息。

获取论文原文,请访问

https://www.ijcai.org/proceedings/2019/0297.pdf

刘阳同学参会的论文题目为 “ Matching User With Item Set: Collaborative Bundle Recommendation with Deep Attention Network ” 。

与传统推荐系统为用户推荐单个商品的场景不同,该论文旨在解决为用户推荐一组商品的问题。基于这个场景,本文提出了一种深度神经网络模型 (DAM) 。DAM主要由两部分组成:

(1) 通过分解注意力机制学习一组商品的向量表示;

(2) 通过同时学习用户对单个商品以及一组商品的交互信息来缓解历史记录的稀疏性。在大量真实数据集上的实验结果证实了我们的模型的有效性。

获取论文原文,请访问

https://www.ijcai.org/proceedings/2019/0290.pdf

参会感想

在报告当天,我详细地介绍了我们的工作,并对听众的提问进行了针对性的解答,与参会的其他学者进行了深入的交流,在交流和讨论中为我的进一步工作带来了新的启发,同时也感受到其他学者们对科研的追求与热情。

——郑万山

参会的过程中,我最大的感触是好的工作不仅需要新颖的想法,更需要扎实的理论分析。在我们提出一个想法的时候,实验效果上的提升固然重要,在理论上分析和保证效果的提升才是更加出色,也更能让大家信服的工作。通过这次会议的交流,我认识到算法层面上的创新才具有更大的普适性和价值,能够真正解决一大类的问题和提供的启发解决其他类型的问题。

——陈子泰

IJCAI是人工智能的综合性会议,在会议上可以遇到做不同方向研究的人,或是跟我环境不同在企业做研究的人。因此他们看待论文的角度会跟我有很大的不同。与他们交流有助于我跳出目前自己工作的思维定势,产生新的想法,实际上也有了新的想法。这是我参加会议的一个最大的感受。

——刘阳

更多精彩内容,请持续关注我们