【NeurIPS 2021】如何使用 Transformer 模型在图表示任务中胜过 GNN

如何使用 Transformer 模型在图表示任务中胜过 GNN

Do Transformer Really Perform Bad for Graph Representation?

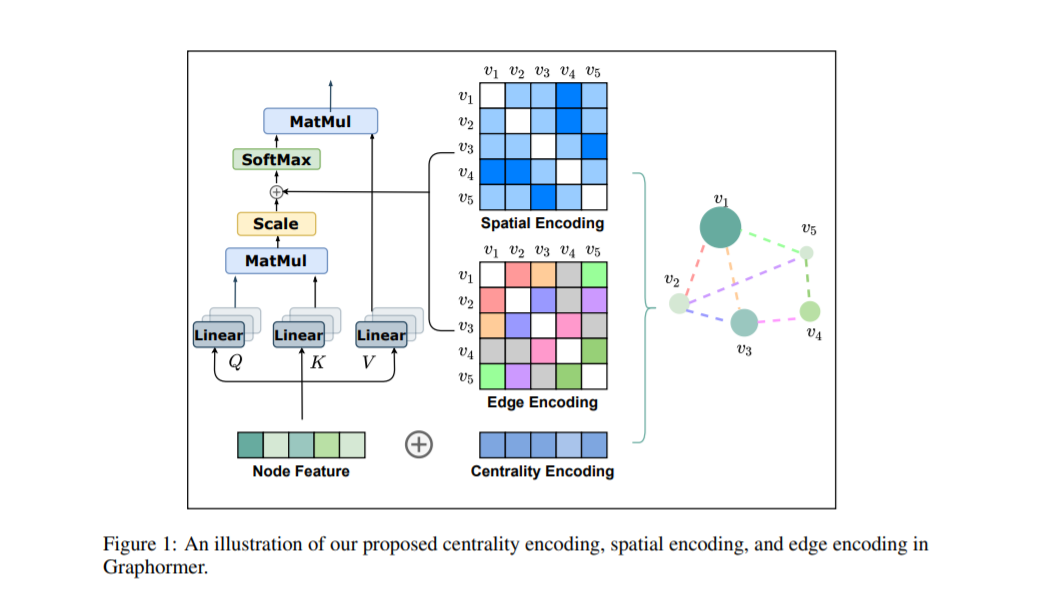

论文摘要:Transformer 模型具有强大的表达能力,并且已经在机器学习的诸多应用领域成为最主要的选择,如自然语言处理与计算机视觉等。然而,其在图表示学习中仍未获得相较 GNN 及其变种更有竞争力的性能,尽管 GNN 的表示能力远弱于 Transformer 模型。因此, Transformer 模型是否适合图学习任务仍然是一个开放问题。本文通过提出 Graphormer 模型对此问题给予肯定回答。Graphormer 模型建立在标准的 Transformer 模型之上,并且在广泛的图表示学习任务上取得了非常优异的结果,如其在 KDD Cup 2021 – 大规模图学习挑战赛中夺冠,并在多个流行的图学习公开排行榜上位列第一。Graphormer 模型兼具强大的表达能力和高效地捕捉图结构信息的能力,可以证明主流的 GNN 及其变种均为Graphormer 模型的特例。Graphormer 模型的提出证明了 Transformer 模型将有潜力成为图学习任务上即 GNN 后又一主要模型结构。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“GRFM” 就可以获取《【NeurIPS 2021】如何使用 Transformer 模型在图表示任务中胜过 GNN》专知下载链接

登录查看更多

相关内容

Arxiv

1+阅读 · 2022年4月20日

Arxiv

15+阅读 · 2021年5月19日