视频 | NeurIPS 2019分享:清华大学孙富春组提出全新模仿学习理论

在 NeurIPS 2019正式召开以前,机器之心精心策划了 NeurIPS 2019 专题,包括线上分享、论文解读、现场报道等内容。11月14日,第一期分享已经圆满结束。本文介绍的是「全 新 智能体观测模仿学习」,这是清华计算机系类脑计算与认知团队最新提出的一种学习理论,也是学界首 次将生 成式对抗方法推广到观测模仿学习中。

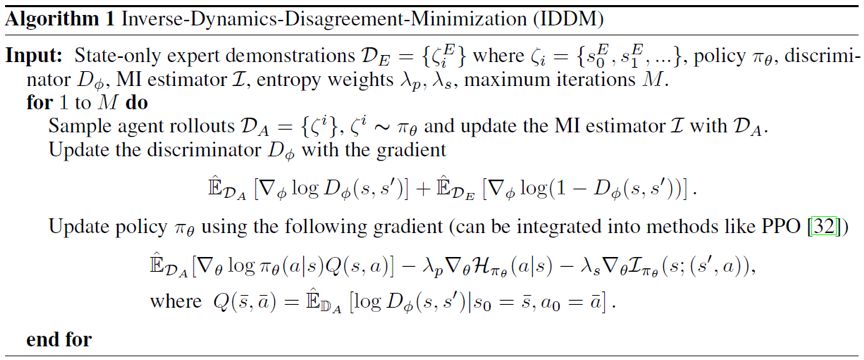

在上周四的第一期线上分享中,清华计算机系博士后黄文炳为大家详细解读了大会接收的这篇 Spotlight 论文《Imitation Learning from Observations by Minimizing Inverse Dynamics Disagreement》。

PPT下载:https://pan.baidu.com/s/1Zj59PAe4hYhDDh5zd4gWZg

论文链接:https://arxiv.org/pdf/1910.04417.pdf

Website:https://sites.google.com/view/neurips19-iddm/home

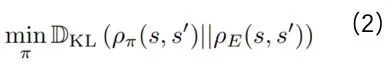

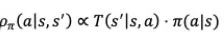

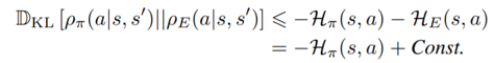

,其优化

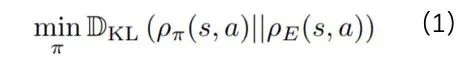

目标可以表示为:

,其优化

目标可以表示为:

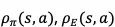

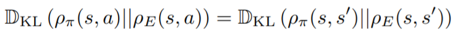

分别表示智能体与专家的状态 (s)-动作 (a) 的占用率度量(State-Action Occupancy Measure),是刻画控制策略对应表现行为的数学统计量,对于平稳随机过程,该占用率度量为唯一确定的统计量,

分别表示智能体与专家的状态 (s)-动作 (a) 的占用率度量(State-Action Occupancy Measure),是刻画控制策略对应表现行为的数学统计量,对于平稳随机过程,该占用率度量为唯一确定的统计量, 为计算 Kullback-Leibler (KL) 散度(文章附录部分进一步推导了 Jensen-Shannon (JS) 散度下的占用率度量逼近过程)。在 GAIL 论文中证明了最小化专家与学习者的占用率度量的 Jensen-Shannon (JS) 散度,可以有效解决模仿专家策略问题。

为计算 Kullback-Leibler (KL) 散度(文章附录部分进一步推导了 Jensen-Shannon (JS) 散度下的占用率度量逼近过程)。在 GAIL 论文中证明了最小化专家与学习者的占用率度量的 Jensen-Shannon (JS) 散度,可以有效解决模仿专家策略问题。

,

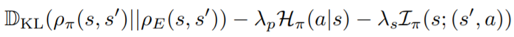

观测模仿学习的一种直观地改进优化方法 GAIfO [2] 为:

,

观测模仿学习的一种直观地改进优化方法 GAIfO [2] 为:

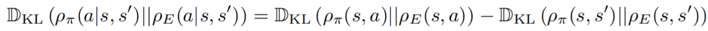

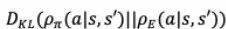

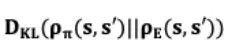

为专家与智能体的逆动力学系统概率分布的 KL 测度,这里称之为 Inverse dynamics disagreement(IDD), 描述二者间的逆动力学系统差异程度,根据贝叶斯公式

为专家与智能体的逆动力学系统概率分布的 KL 测度,这里称之为 Inverse dynamics disagreement(IDD), 描述二者间的逆动力学系统差异程度,根据贝叶斯公式 ,可以知道智能体的逆动力学系统

,可以知道智能体的逆动力学系统  是与控制策略

是与控制策略 有关的,因此逆动力学系统的差异也一定程度上刻画了专家与智能体的控制策略的差异,进一步分析,当智能体动力学系统的单射变换时,可以证明:

有关的,因此逆动力学系统的差异也一定程度上刻画了专家与智能体的控制策略的差异,进一步分析,当智能体动力学系统的单射变换时,可以证明:

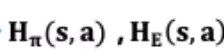

分别代表智能体与专家的状态-动作占用率度量的信息熵,当

分别代表智能体与专家的状态-动作占用率度量的信息熵,当 最小化的时候:

最小化的时候:

可以

转换成最大化策略熵

可以

转换成最大化策略熵 与互信息

与互信息  之和,具体推导可以查看论文公式(8-9)。

之和,具体推导可以查看论文公式(8-9)。

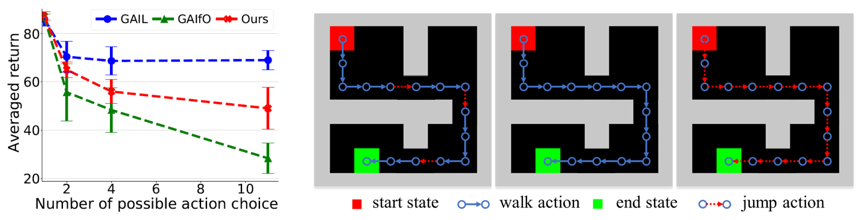

一样

),可能出现不同的动作方式

一样

),可能出现不同的动作方式 。

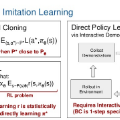

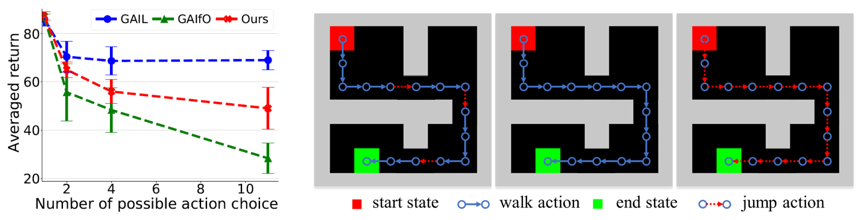

(左图)三种方法在随着转移动作种类逐渐增多过程中,表现效果的变化趋势。注:GAIL 方法中是常规的模仿学习问题,示教样本中包含动作信息,属于 GAIfO 和本方法的理论上限。

。

(左图)三种方法在随着转移动作种类逐渐增多过程中,表现效果的变化趋势。注:GAIL 方法中是常规的模仿学习问题,示教样本中包含动作信息,属于 GAIfO 和本方法的理论上限。

替换

为状态占用率度量

替换

为状态占用率度量 的

朴素观测模仿学习方法。

的

朴素观测模仿学习方法。

登录查看更多

相关内容

模仿学习是学习尝试模仿专家行为从而获取最佳性能的一系列任务。目前主流方法包括监督式模仿学习、随机混合迭代学习和数据聚合模拟学习等方法。模仿学习(Imitation Learning)背后的原理是是通过隐含地给学习器关于这个世界的先验信息,比如执行、学习人类行为。在模仿学习任务中,智能体(agent)为了学习到策略从而尽可能像人类专家那样执行一种行为,它会寻找一种最佳的方式来使用由该专家示范的训练集(输入-输出对)。当智能体学习人类行为时,虽然我们也需要使用模仿学习,但实时的行为模拟成本会非常高。与之相反,吴恩达提出的学徒学习(Apprenticeship learning)执行的是存粹的贪婪/利用(exploitative)策略,并使用强化学习方法遍历所有的(状态和行为)轨迹(trajectories)来学习近优化策略。它需要极难的计略(maneuvers),而且几乎不可能从未观察到的状态还原。模仿学习能够处理这些未探索到的状态,所以可为自动驾驶这样的许多任务提供更可靠的通用框架。

专知会员服务

24+阅读 · 2019年11月11日

Arxiv

11+阅读 · 2018年7月12日