ICML2018 模仿学习教程

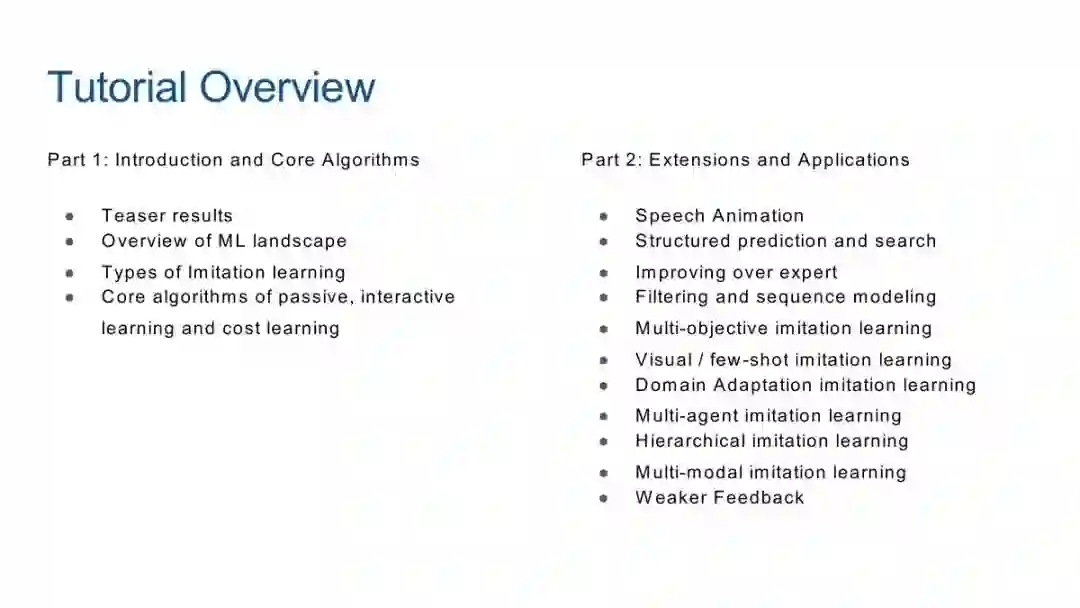

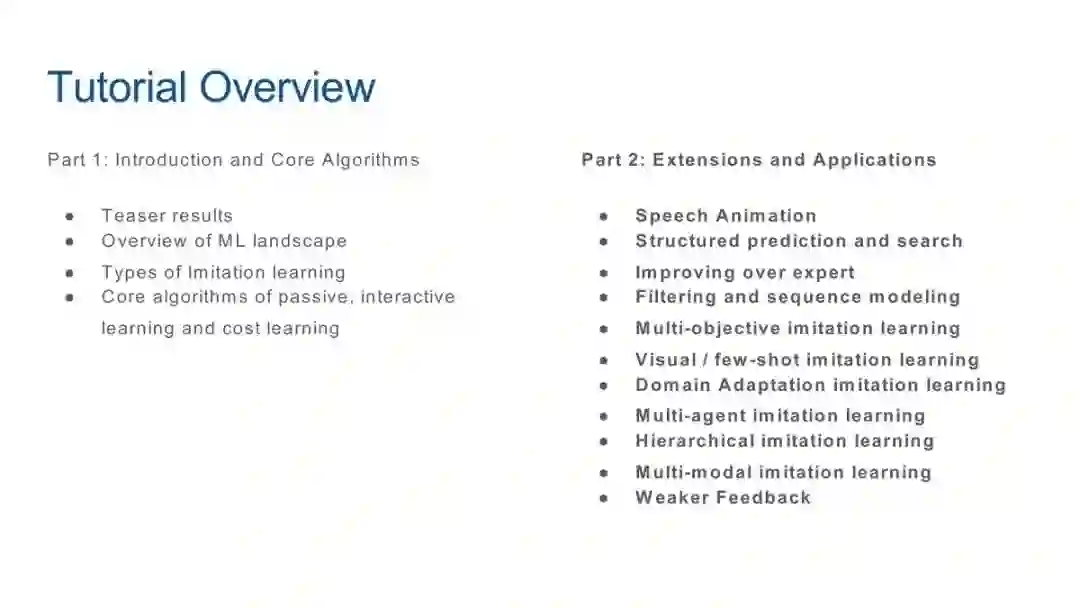

【导读】机器学习领域最具影响力的学术会议之一的ICML于2018年7月10日-15日在瑞典斯德哥尔摩举行。ICML是机器学习领域顶级会议,由国际机器学习协会(International Machine Learning Society)主办。本文介绍ICML2018中《Imitation Learning 》所配的一套149页的PPT,这套PPT由浅入深地介绍了模仿学习。

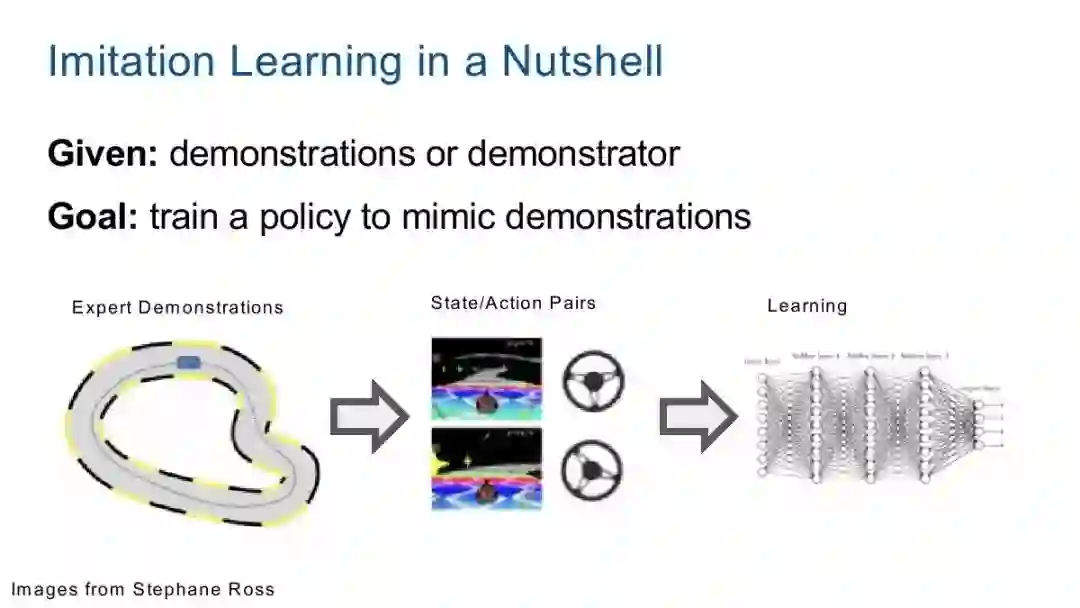

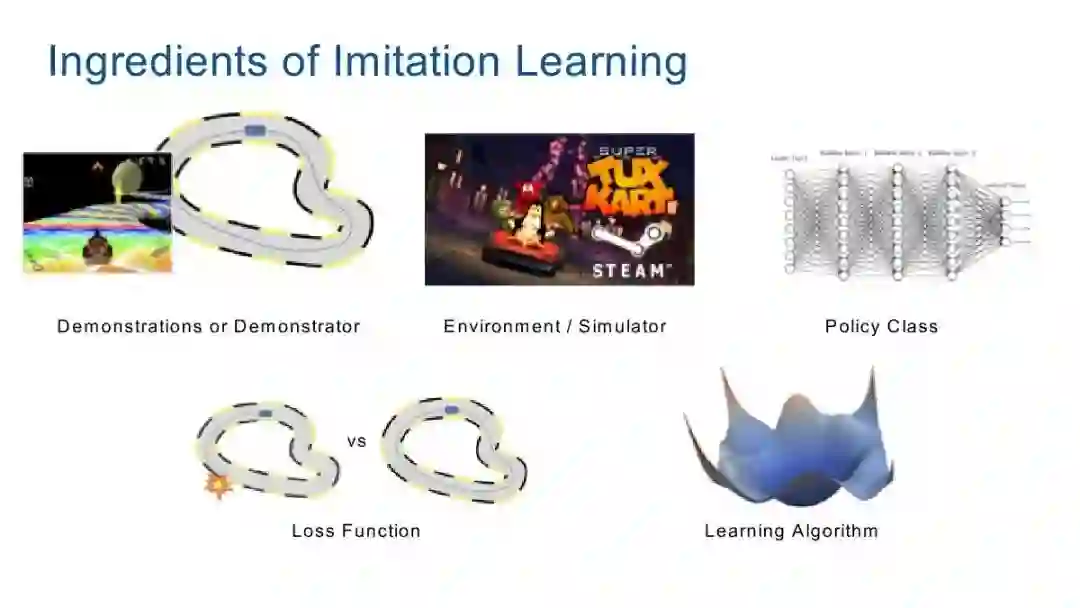

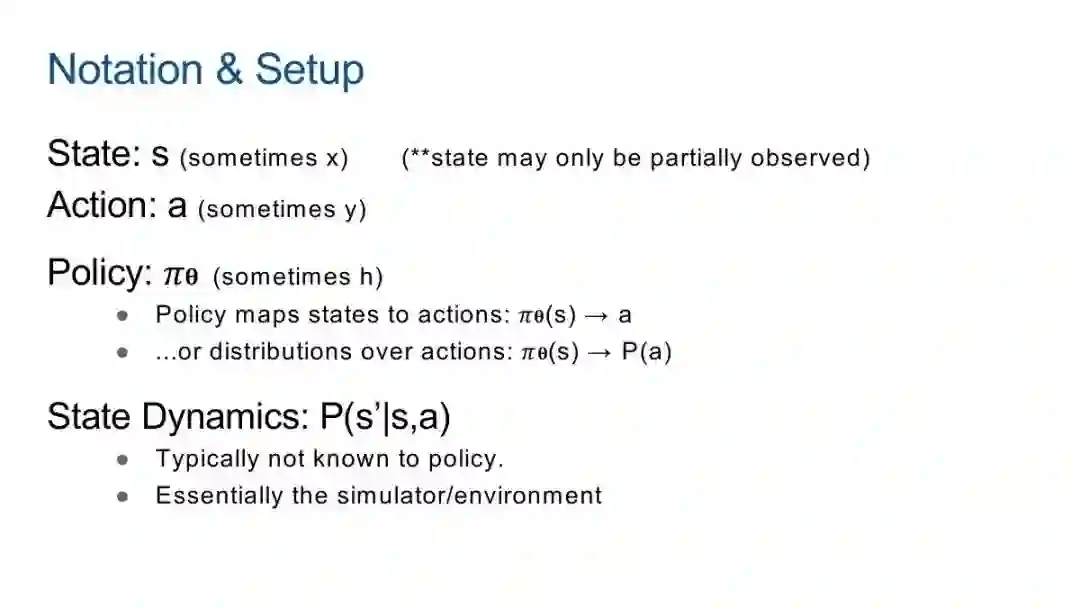

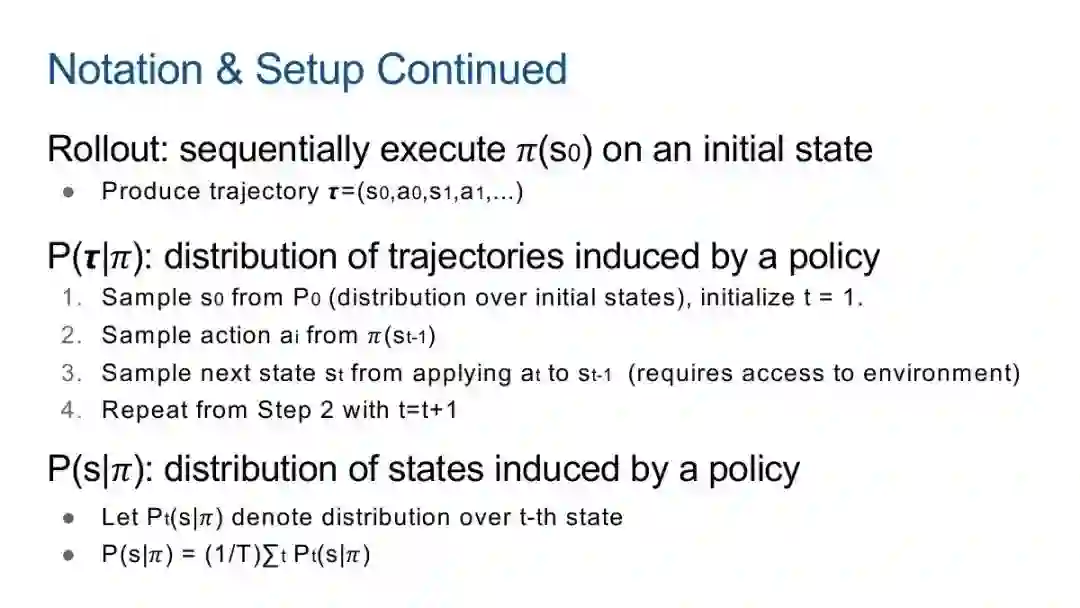

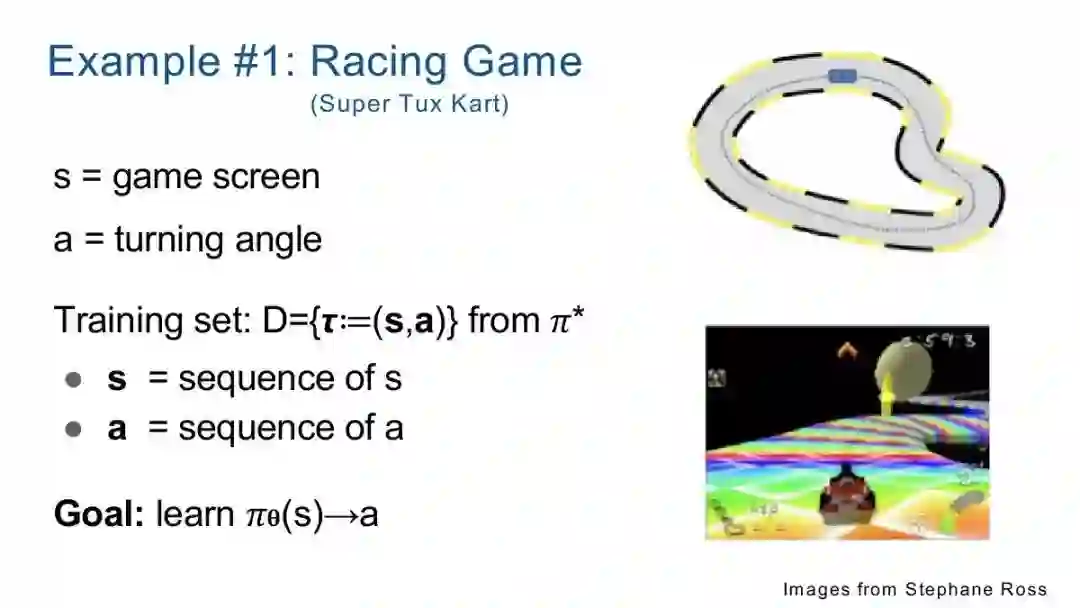

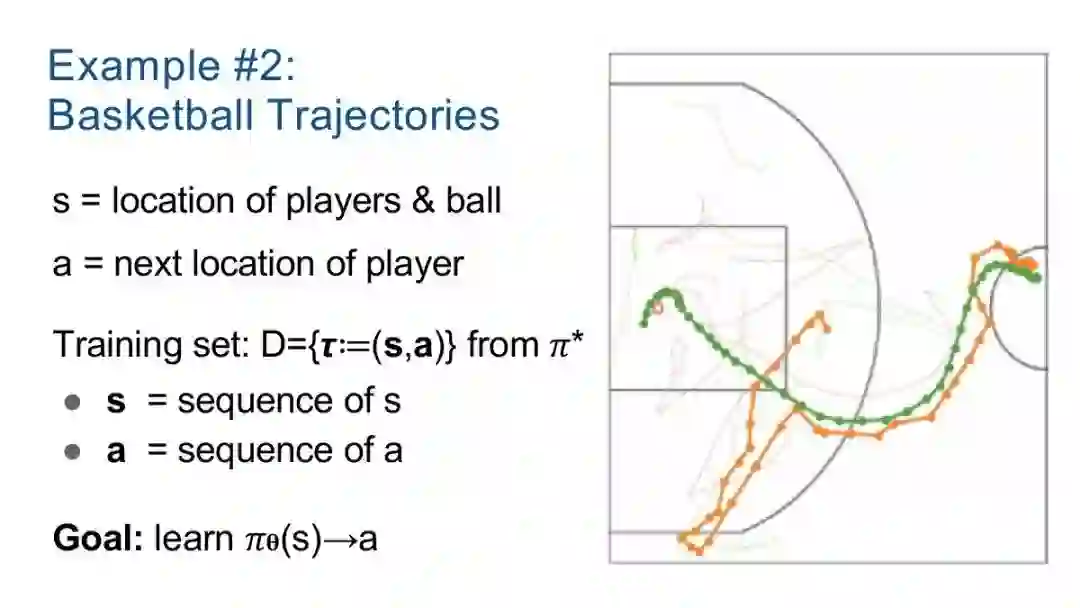

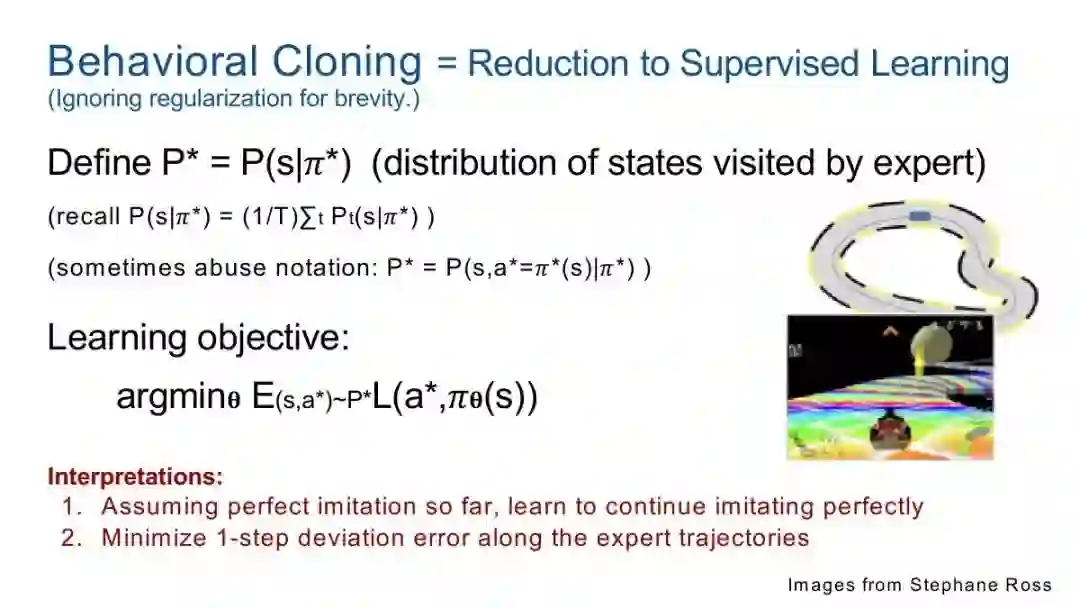

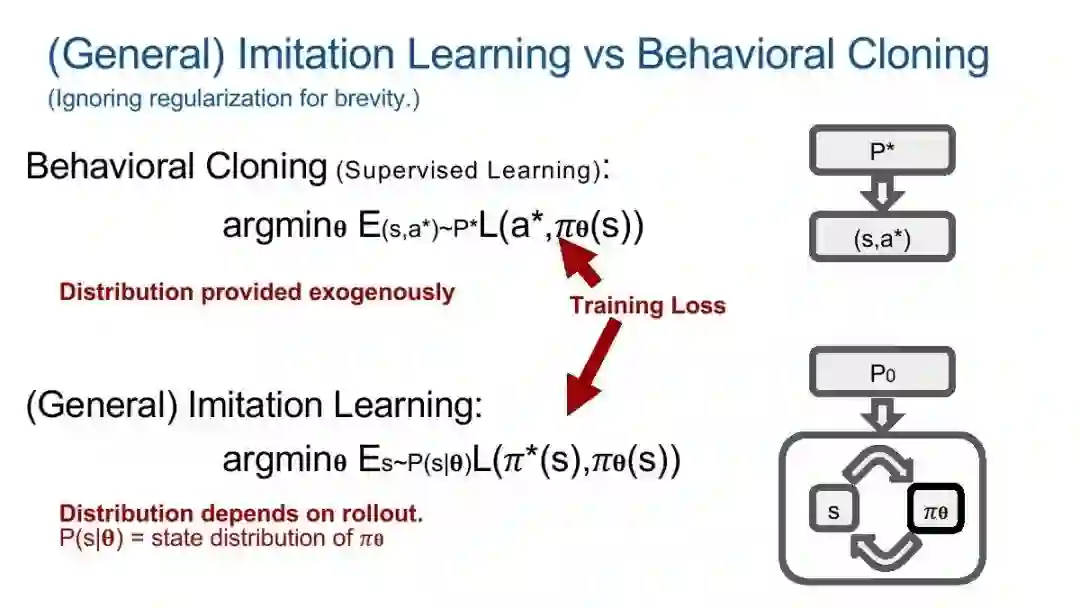

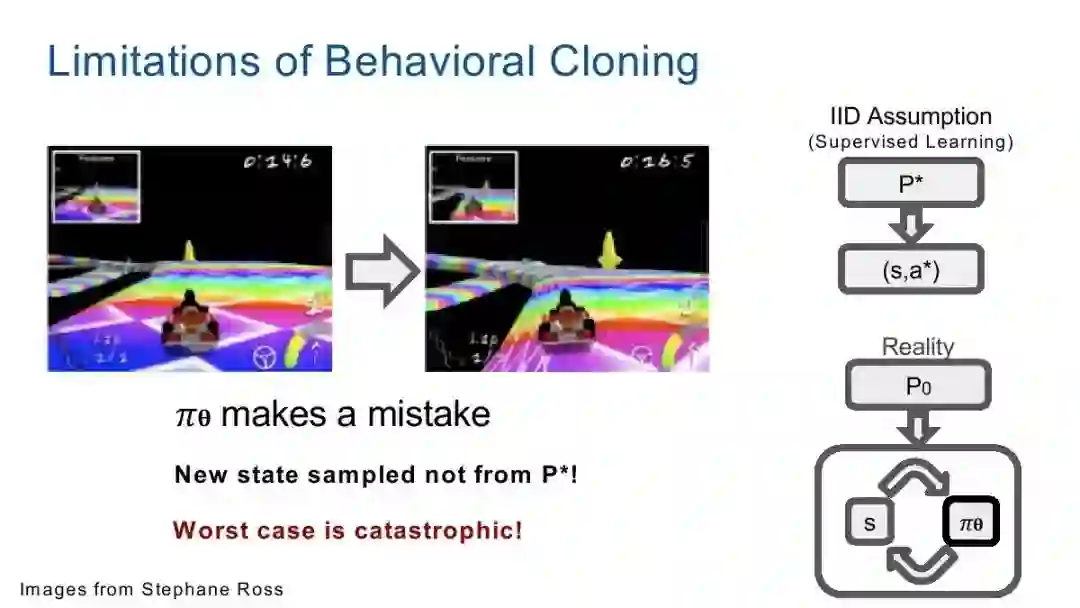

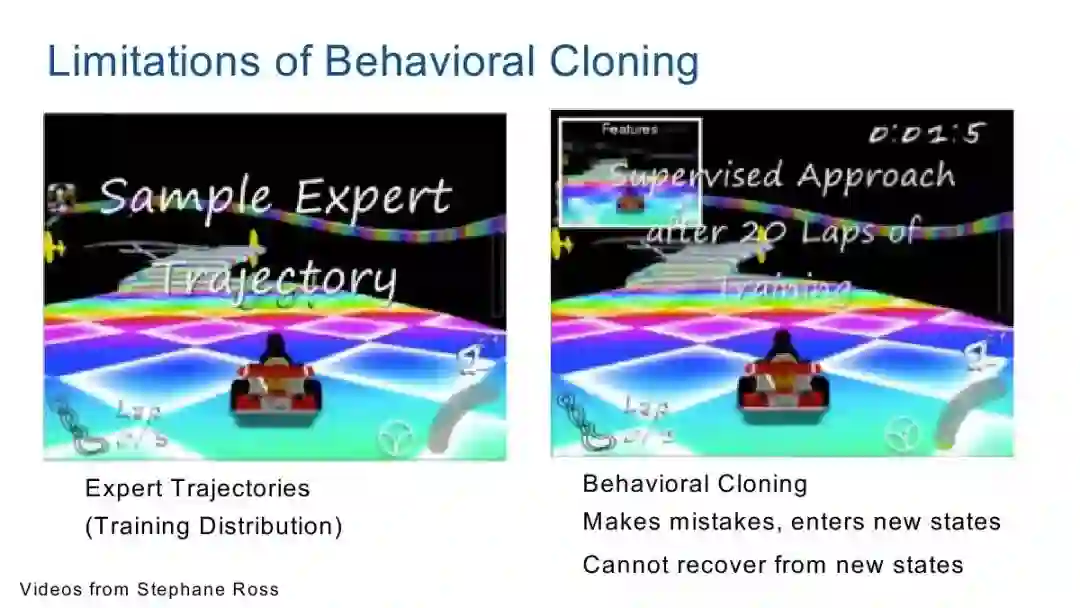

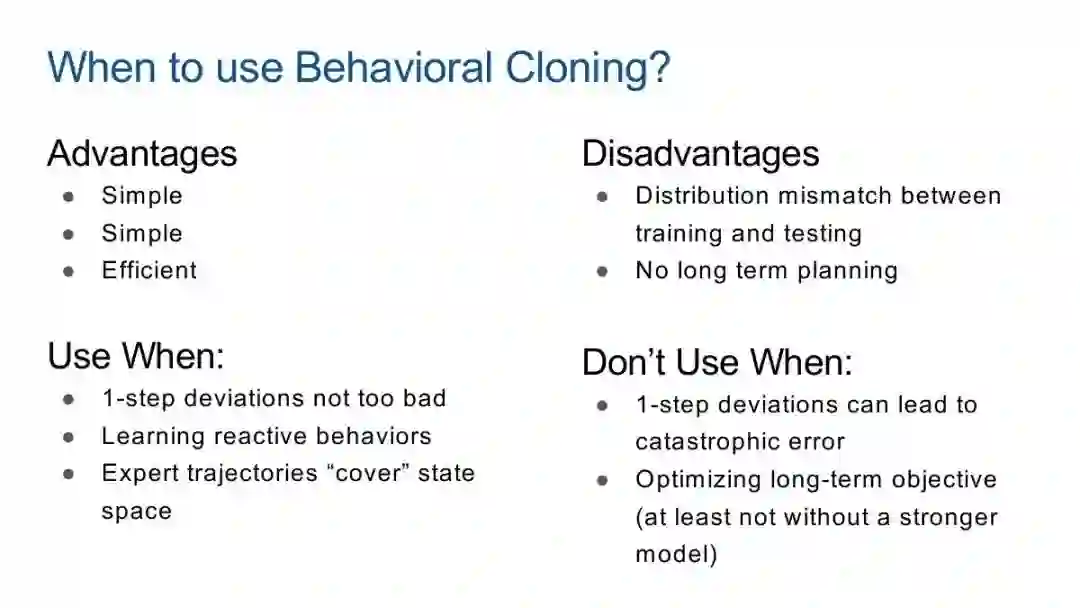

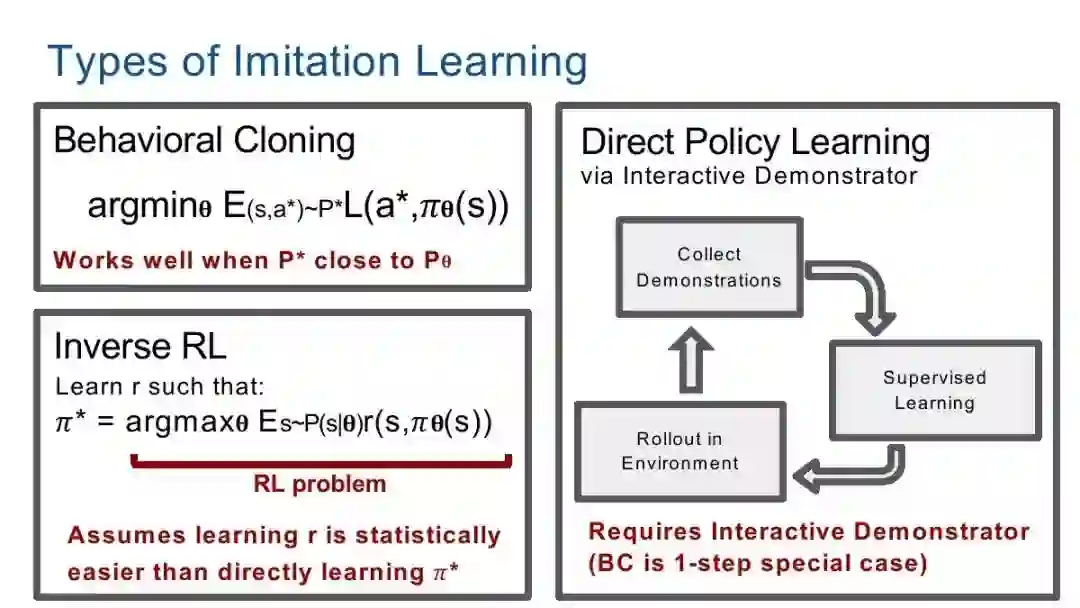

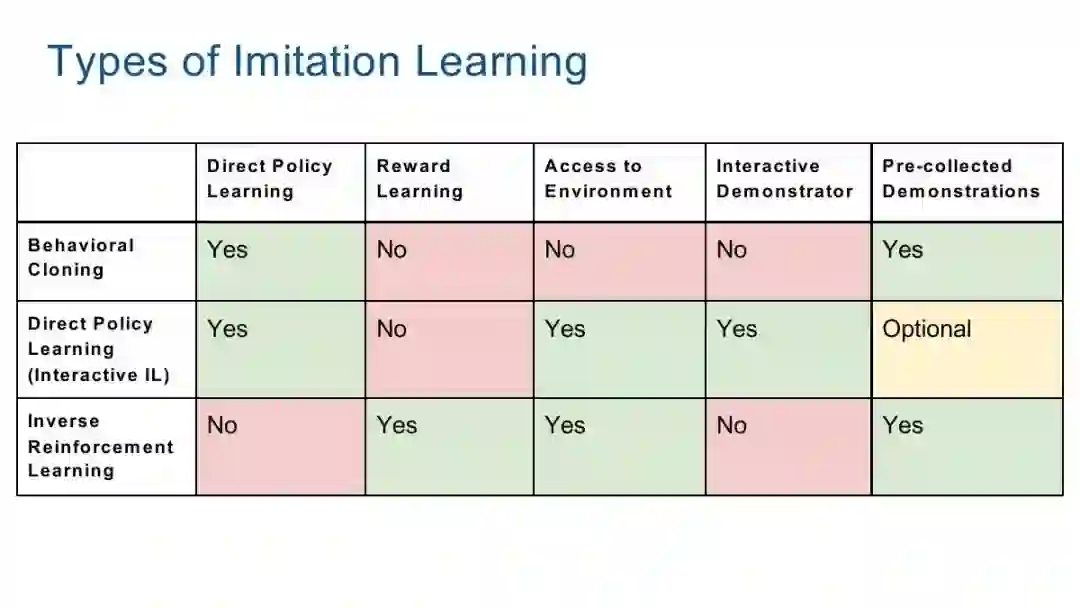

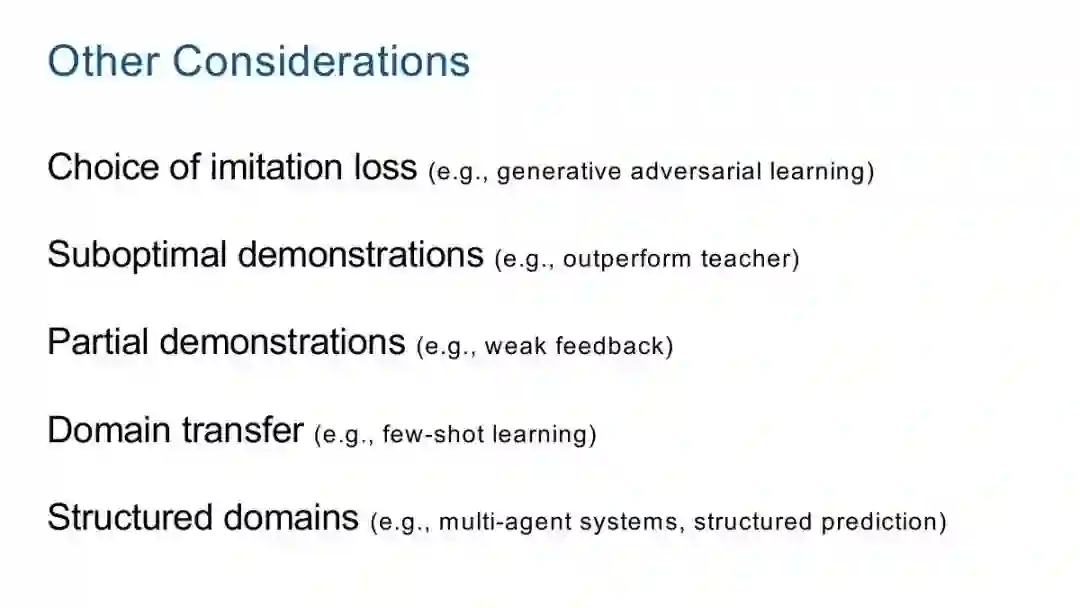

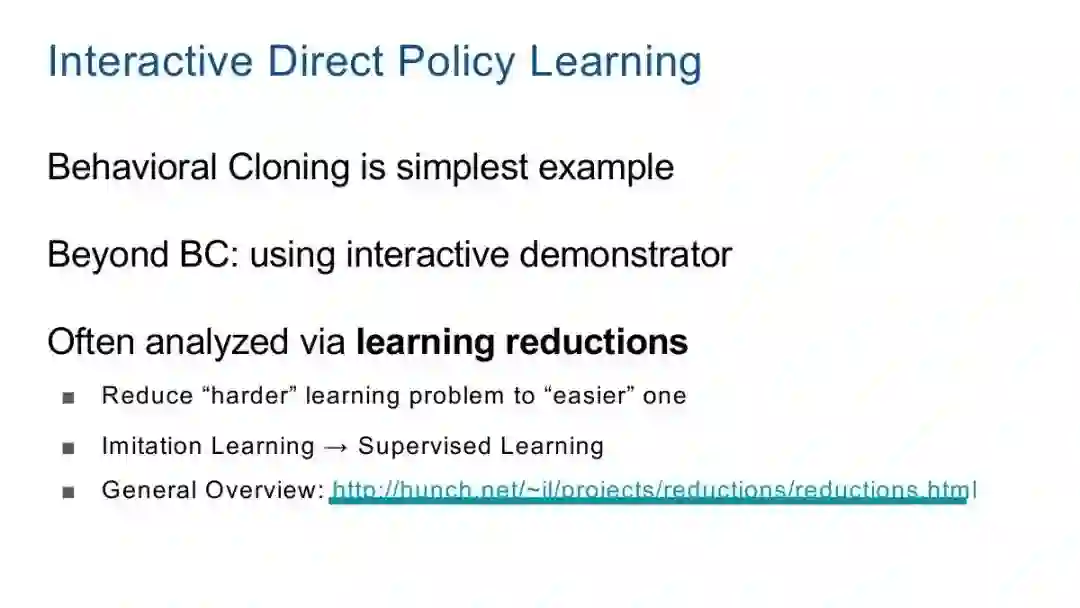

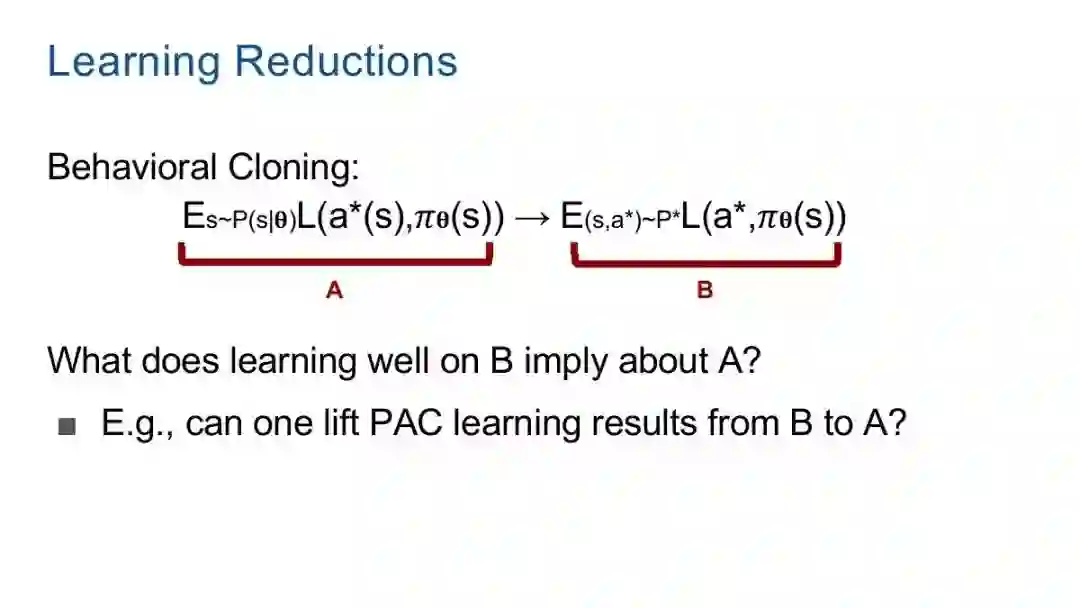

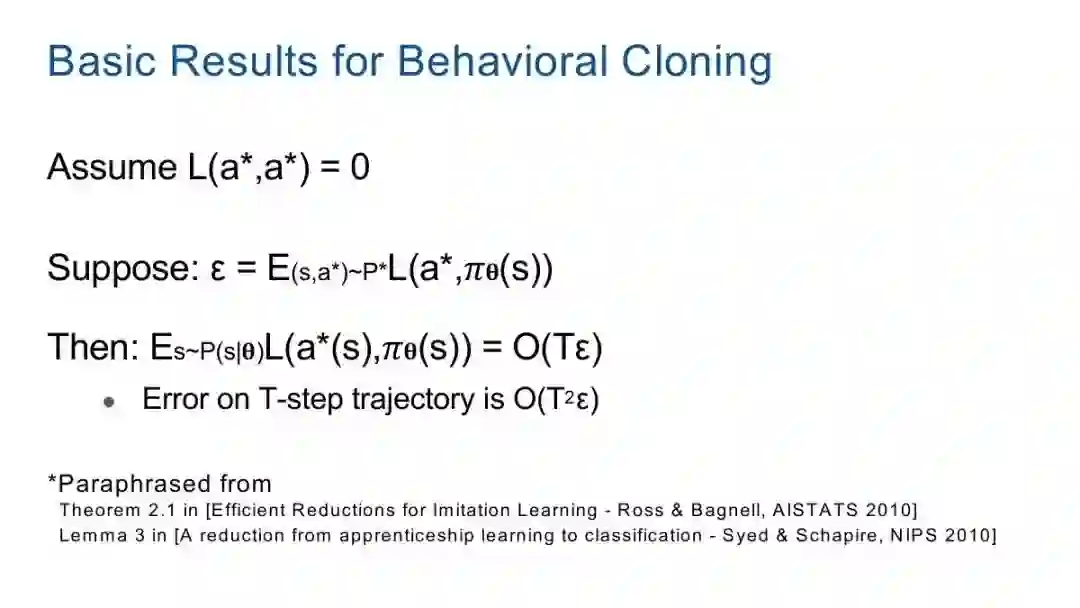

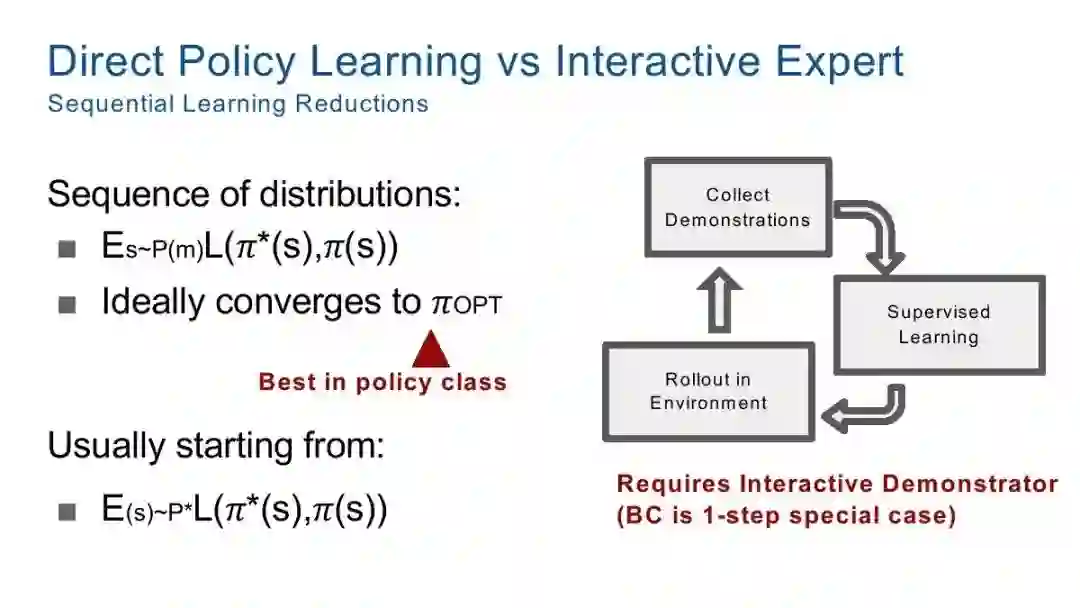

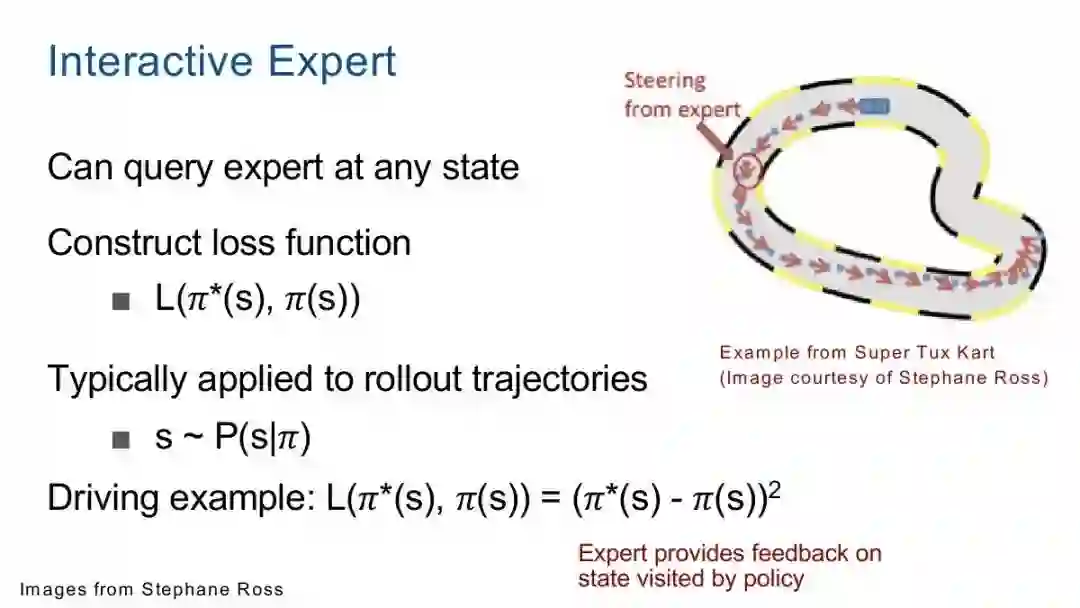

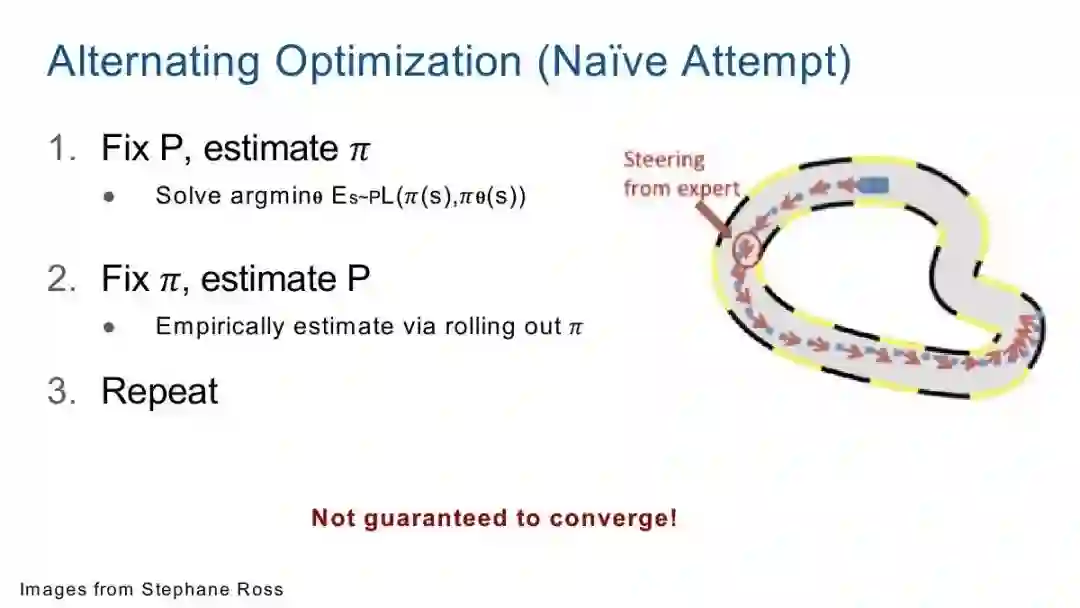

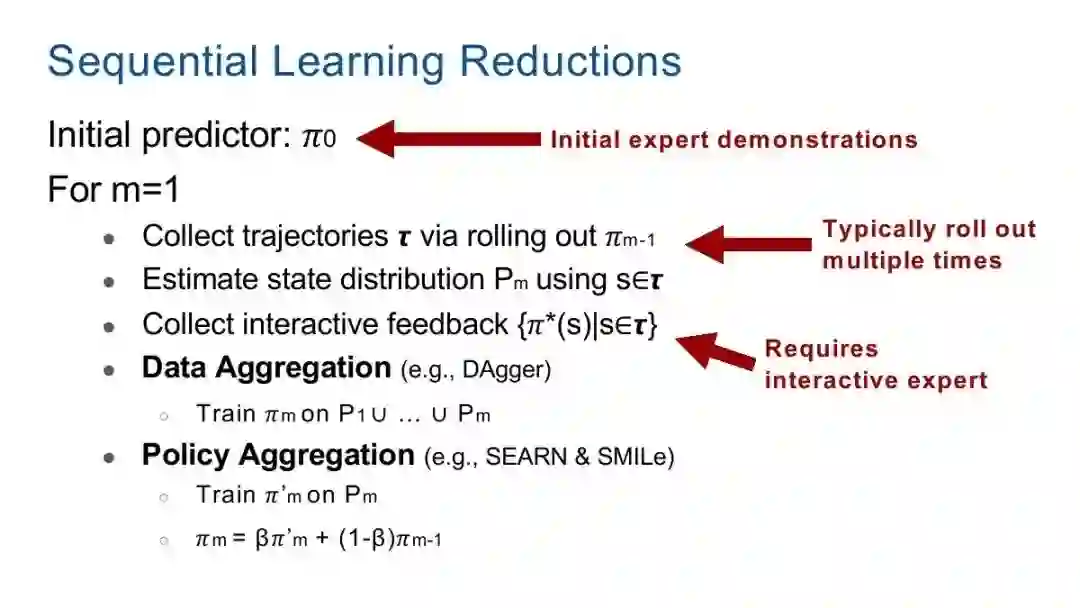

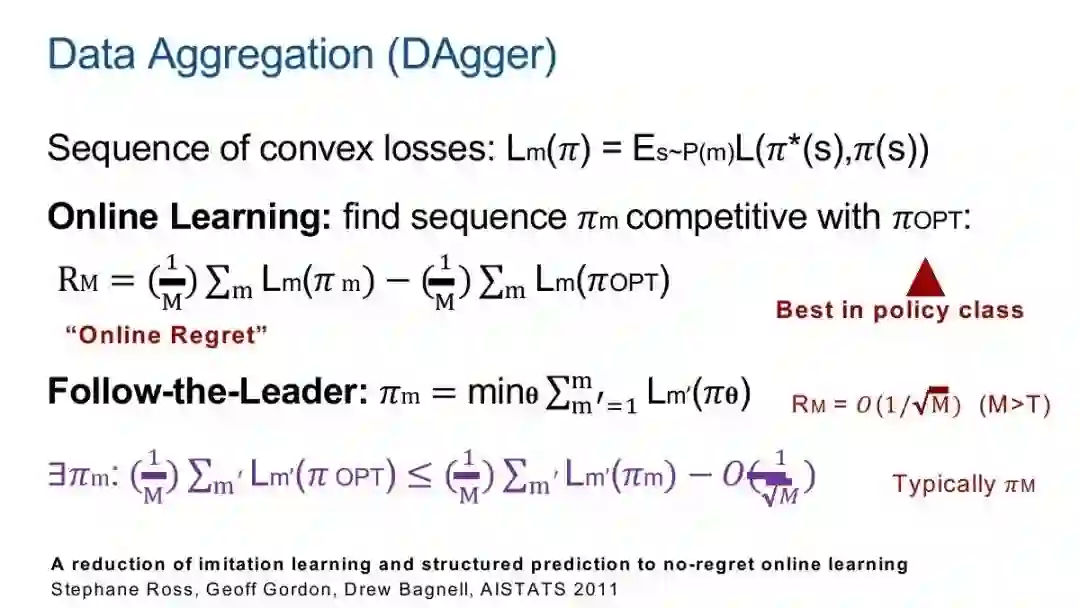

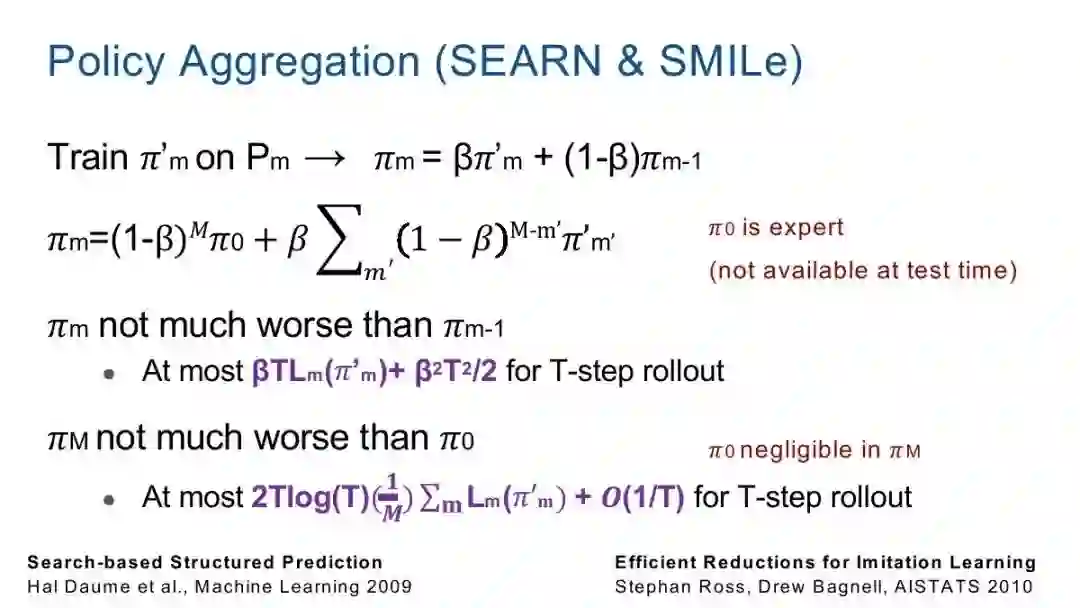

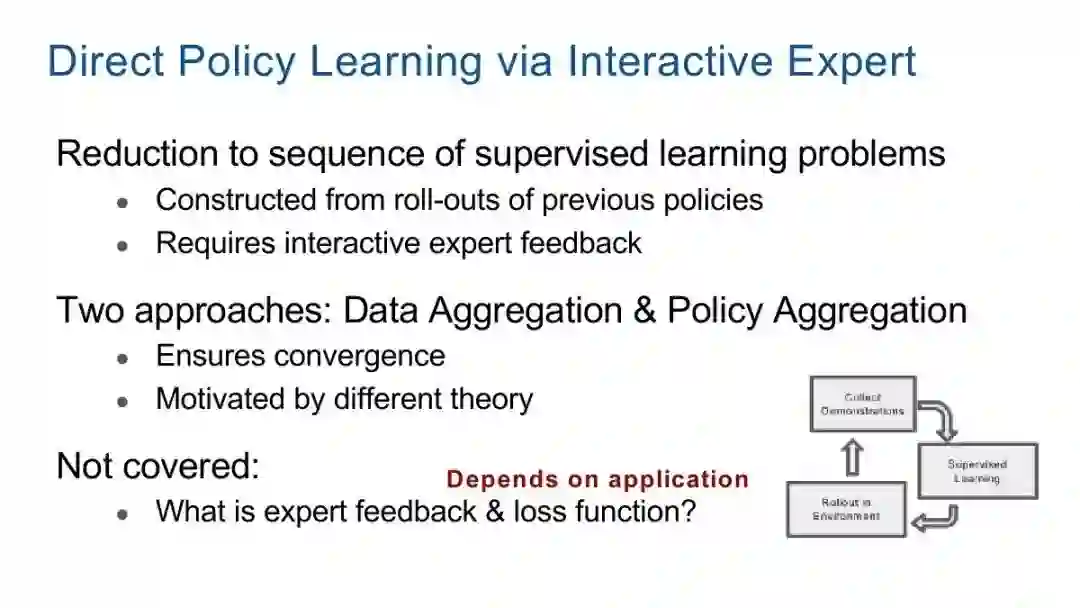

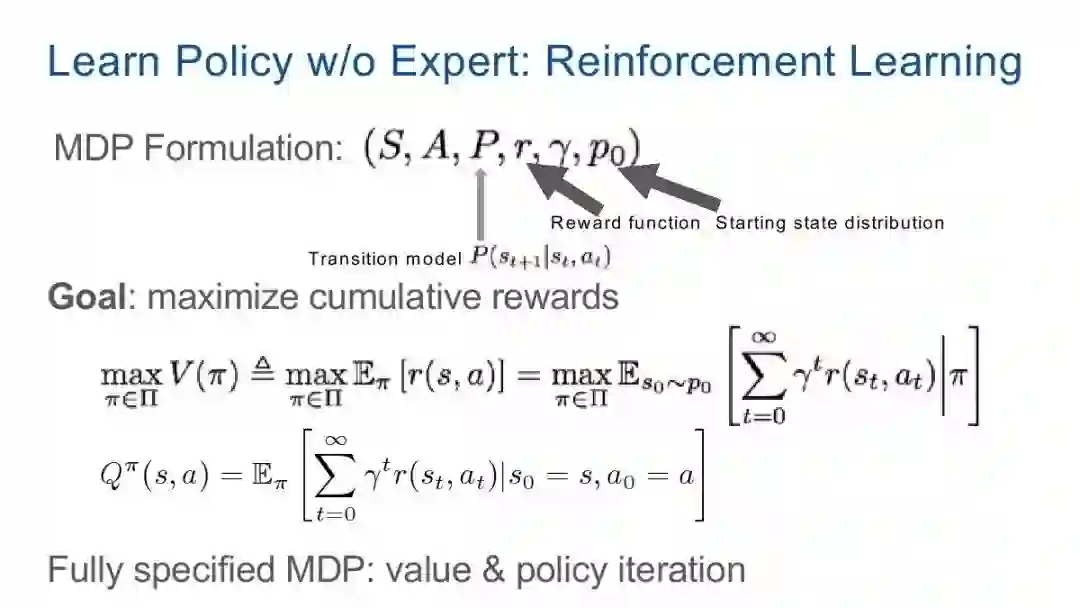

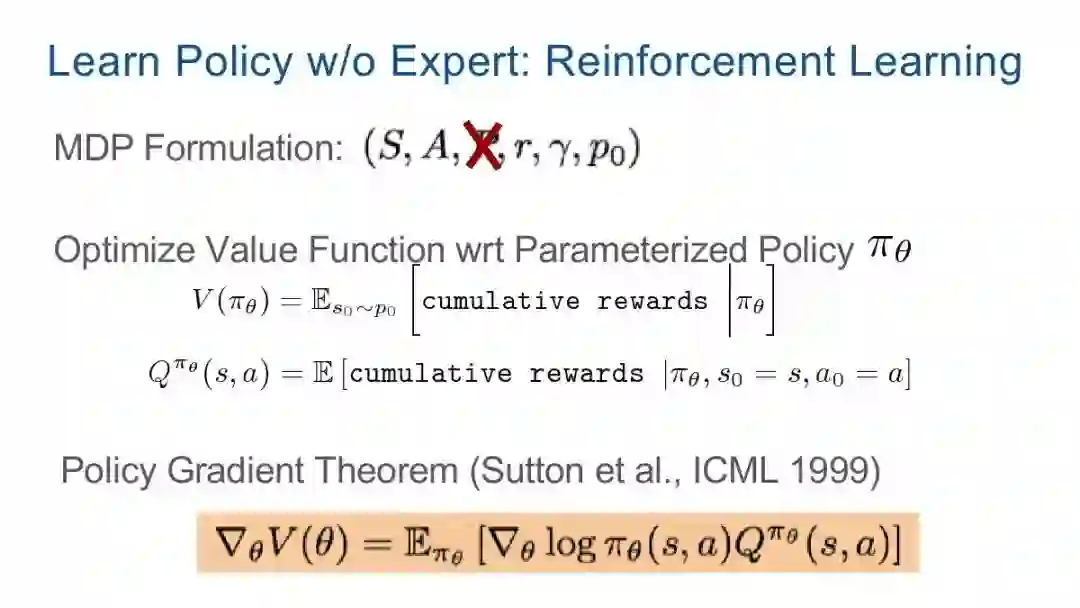

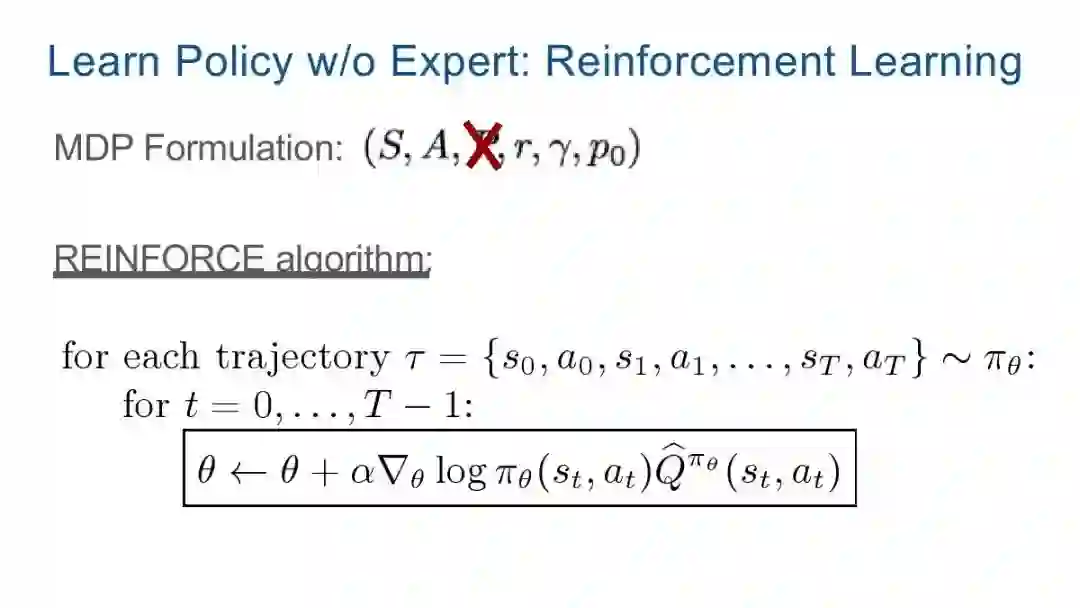

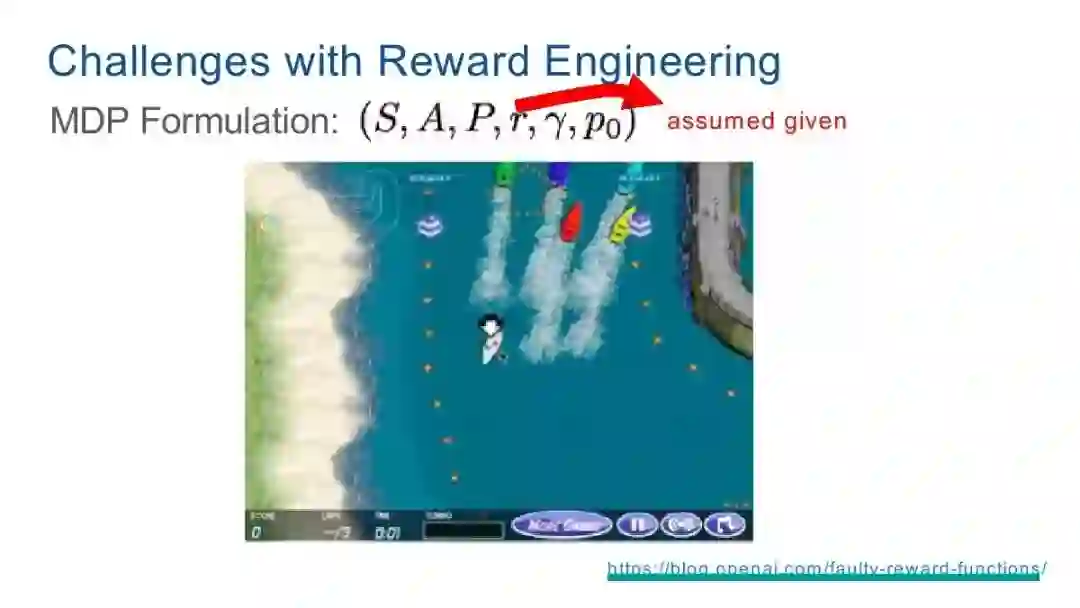

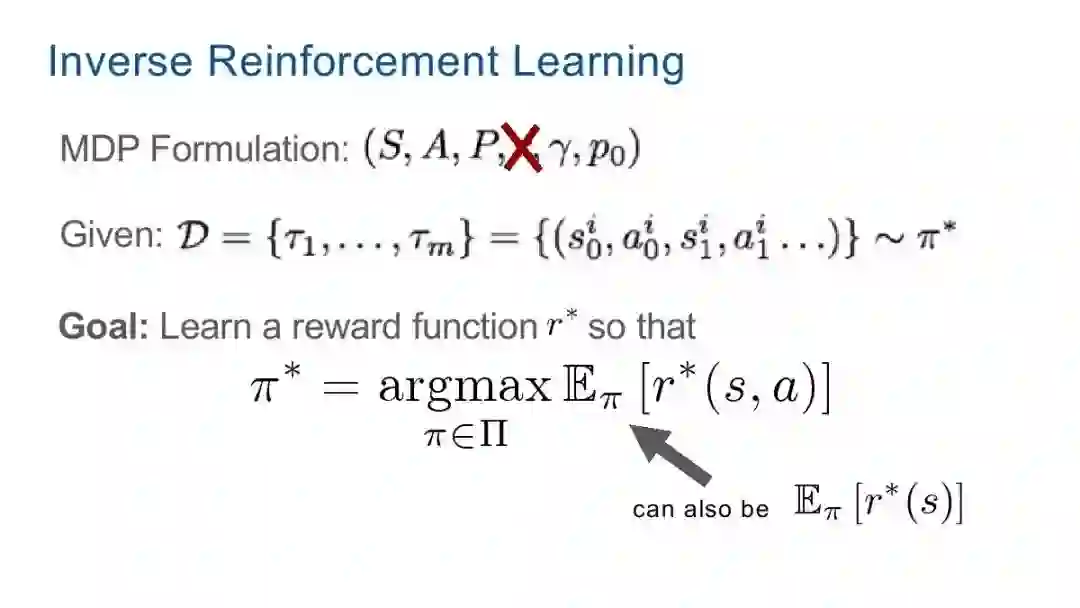

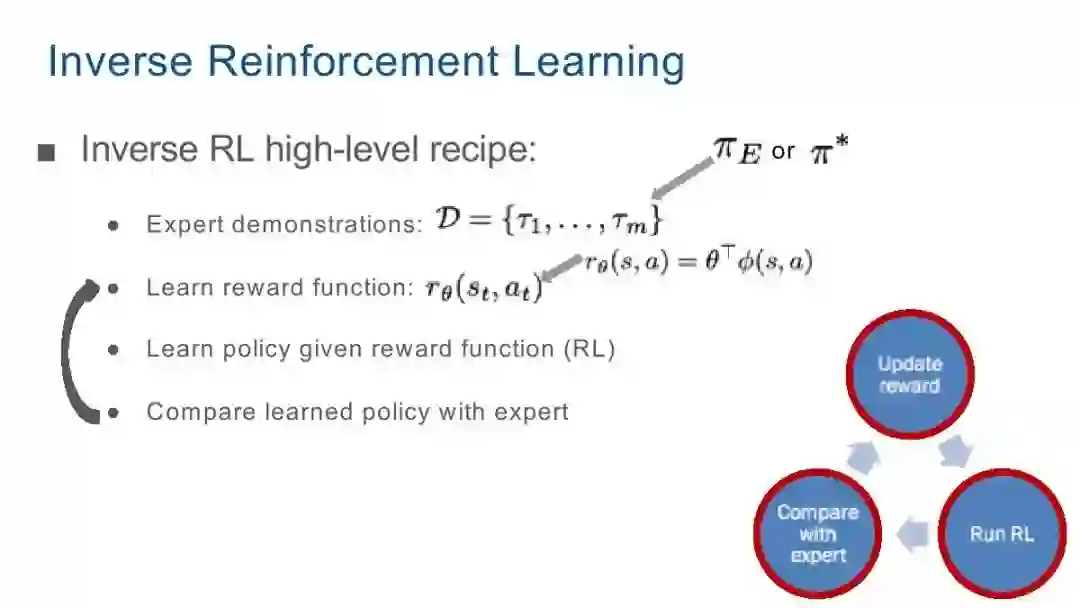

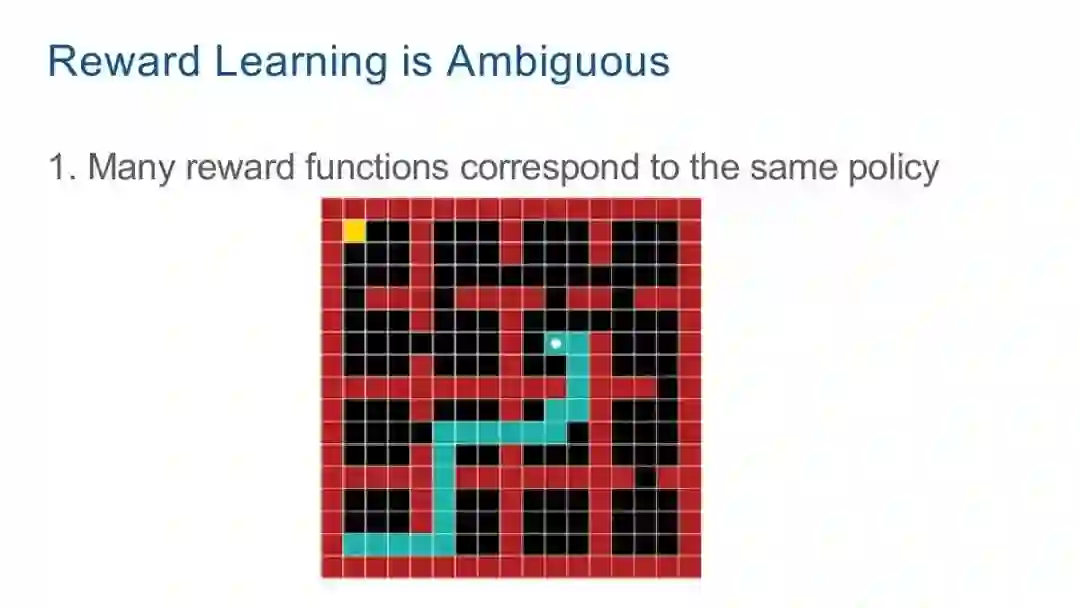

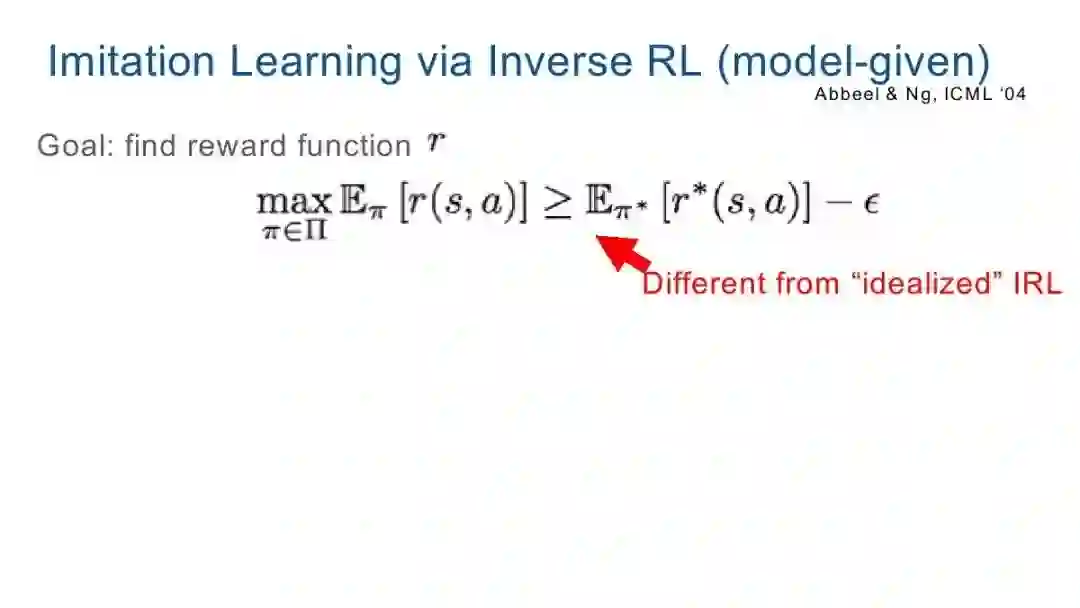

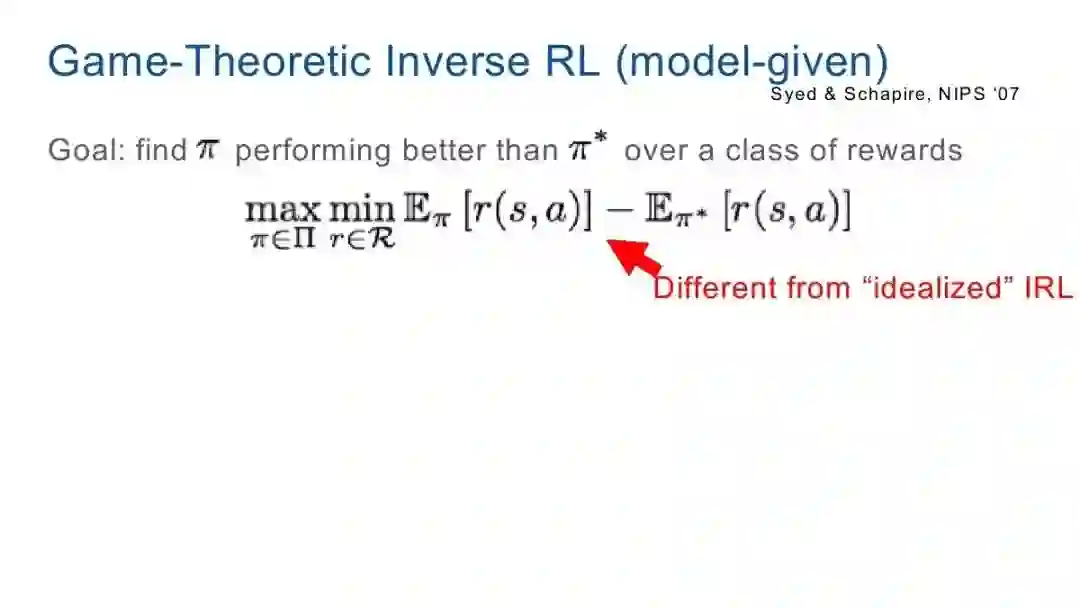

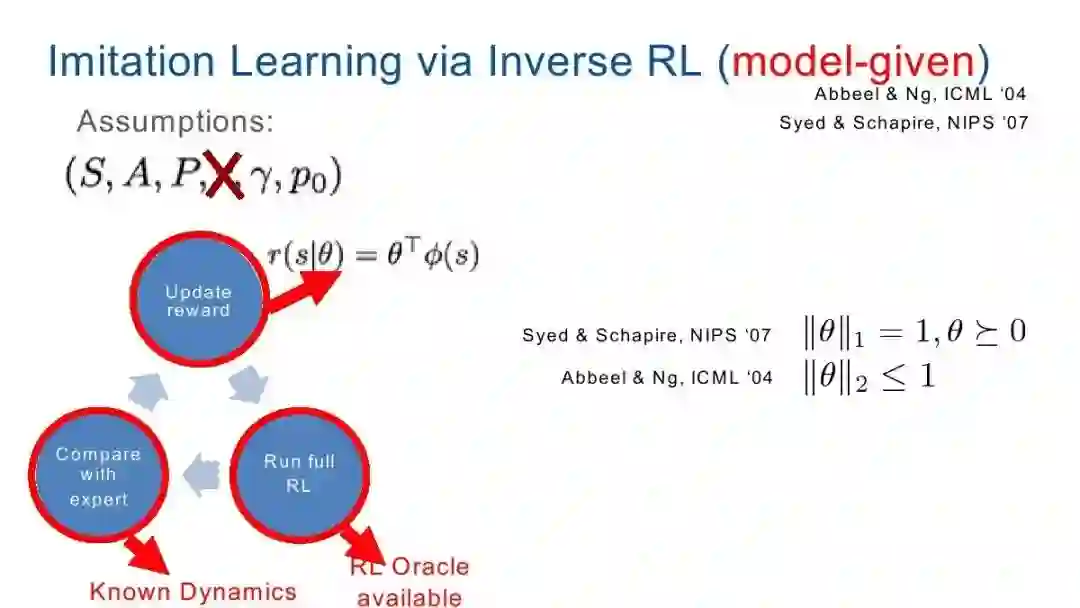

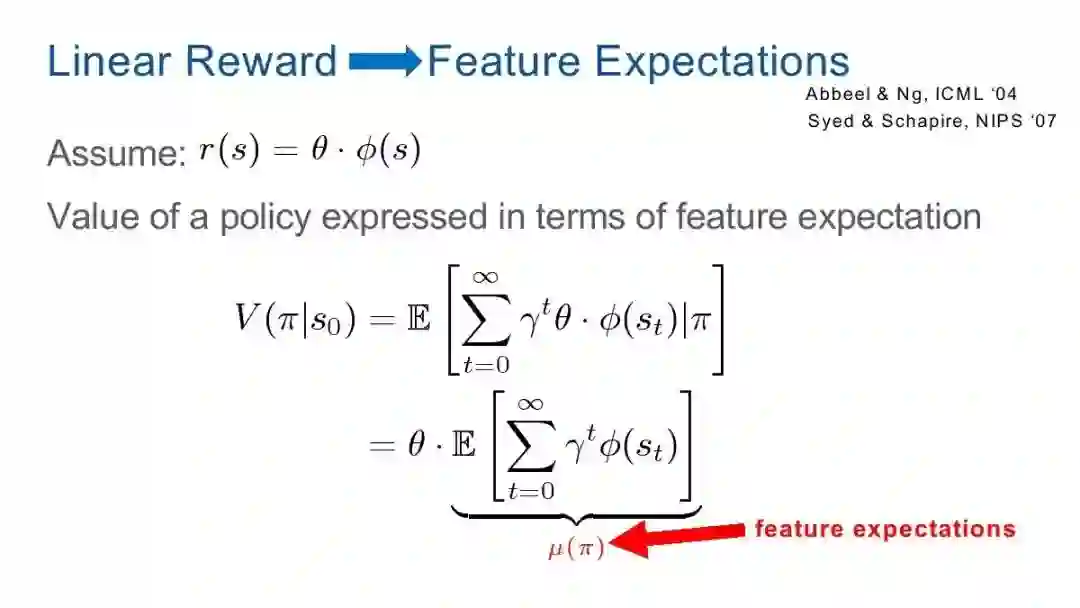

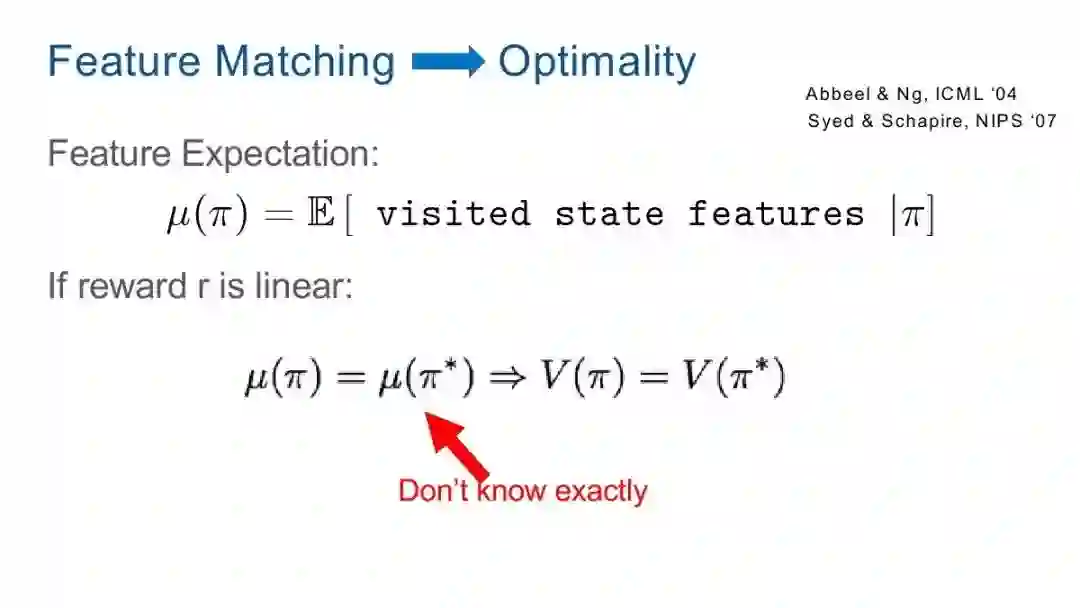

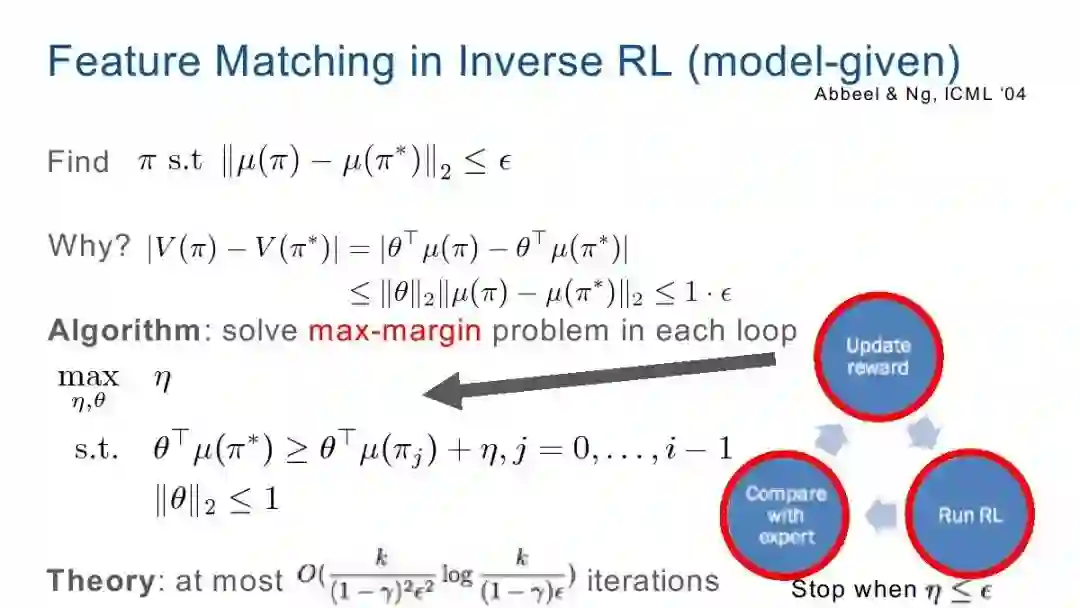

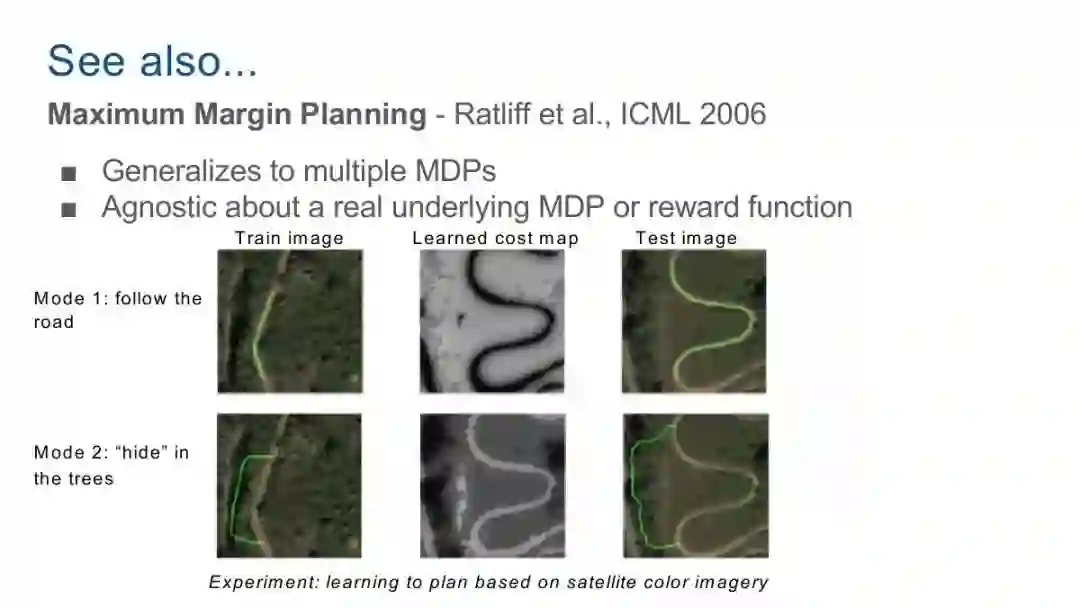

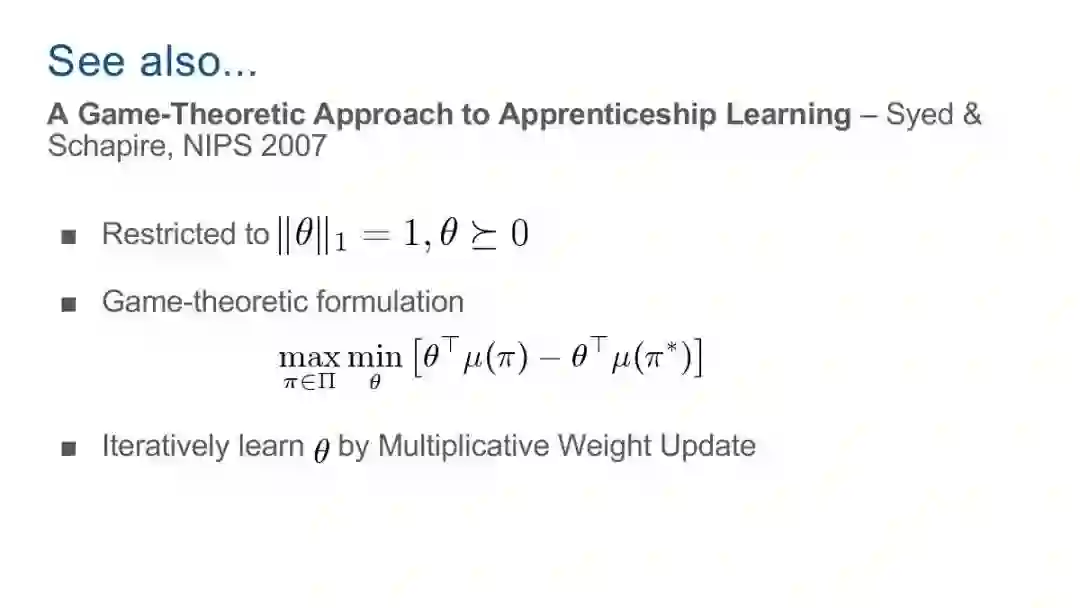

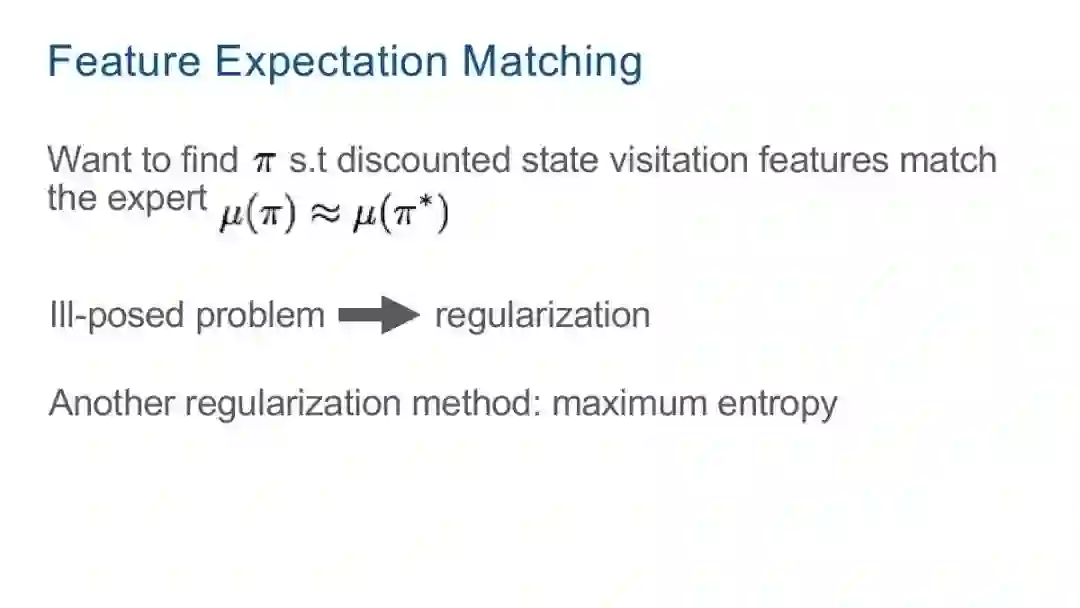

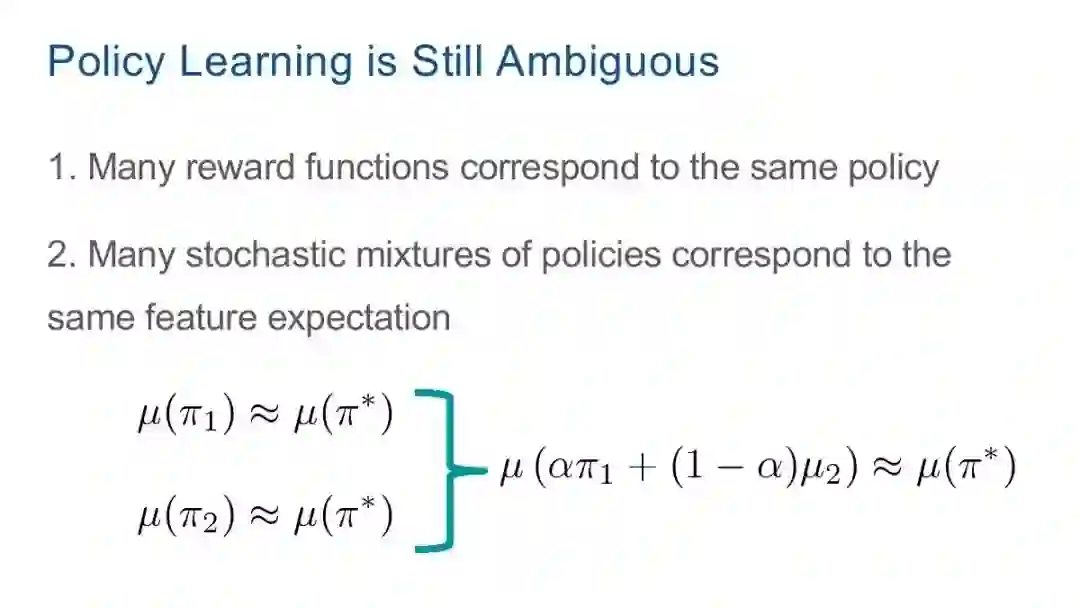

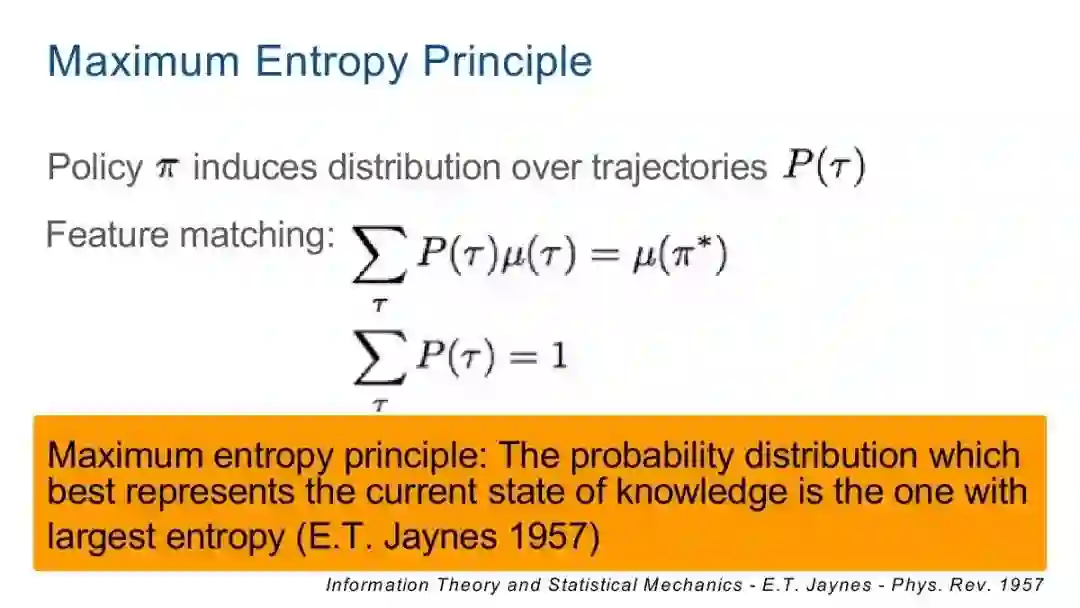

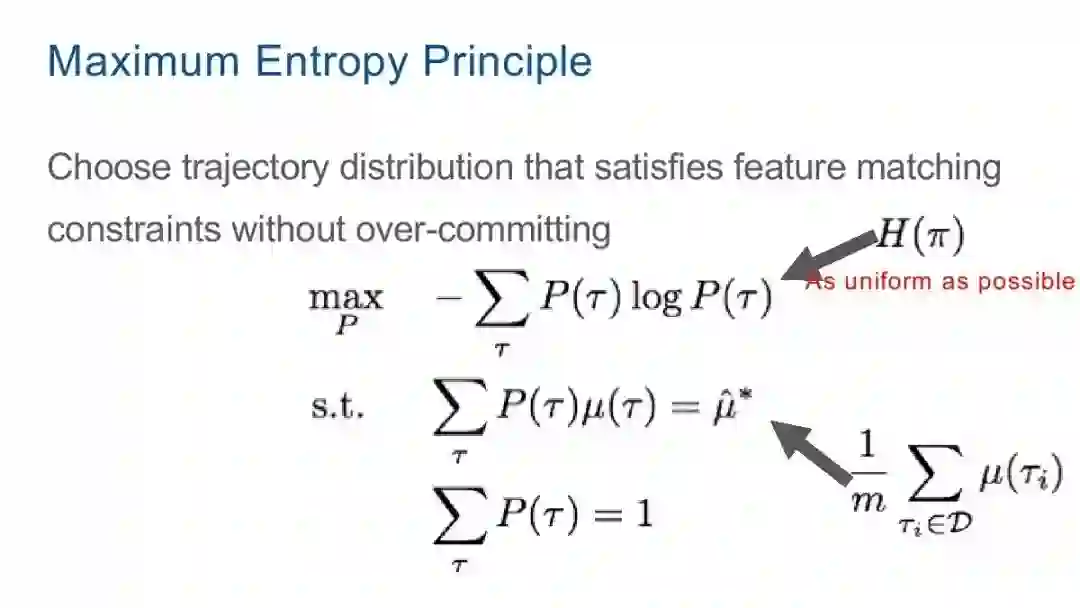

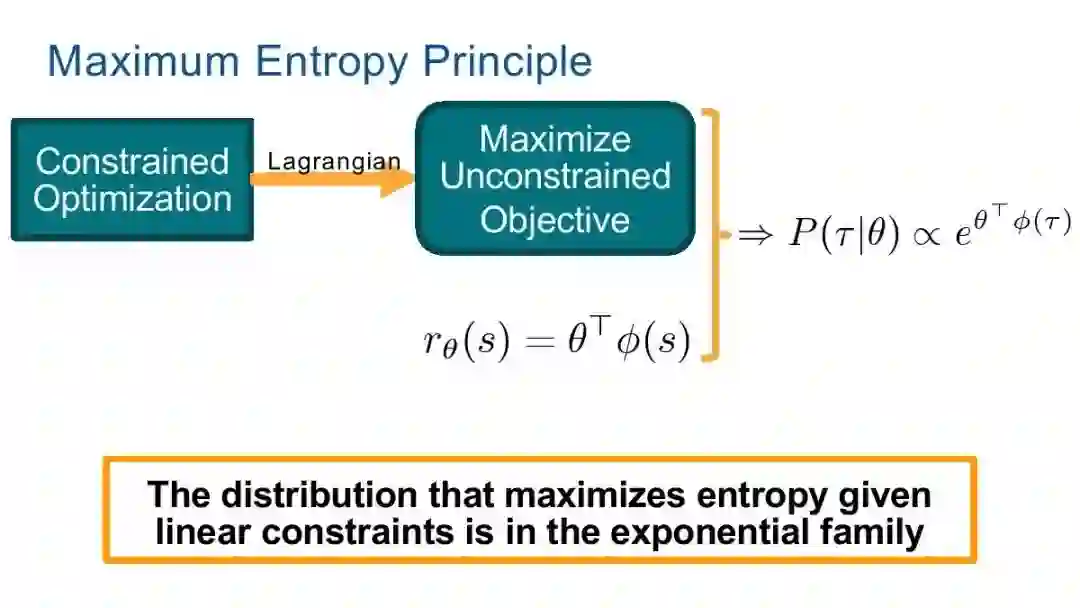

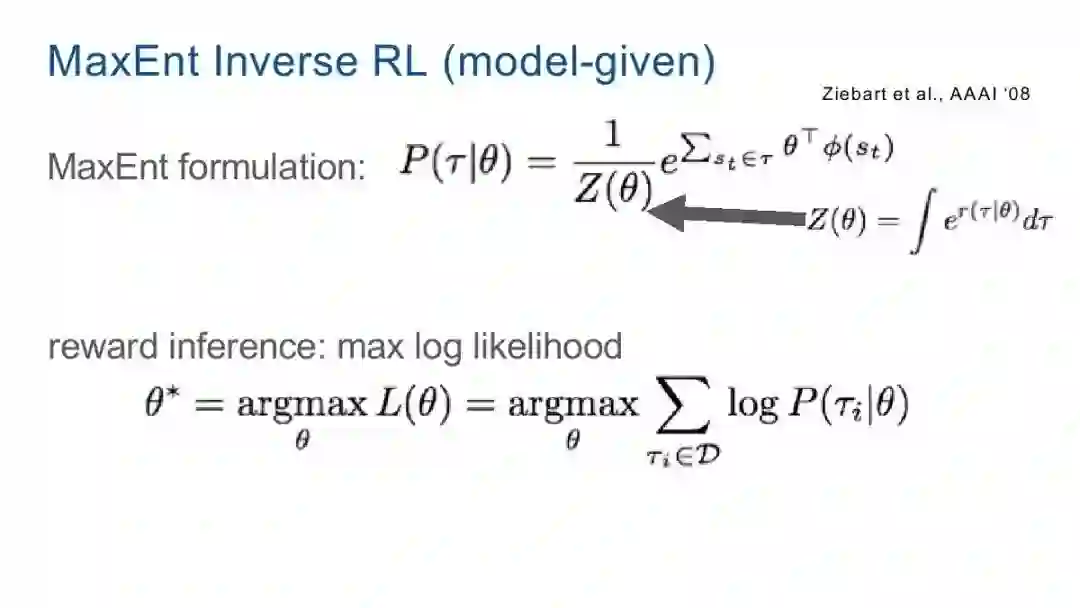

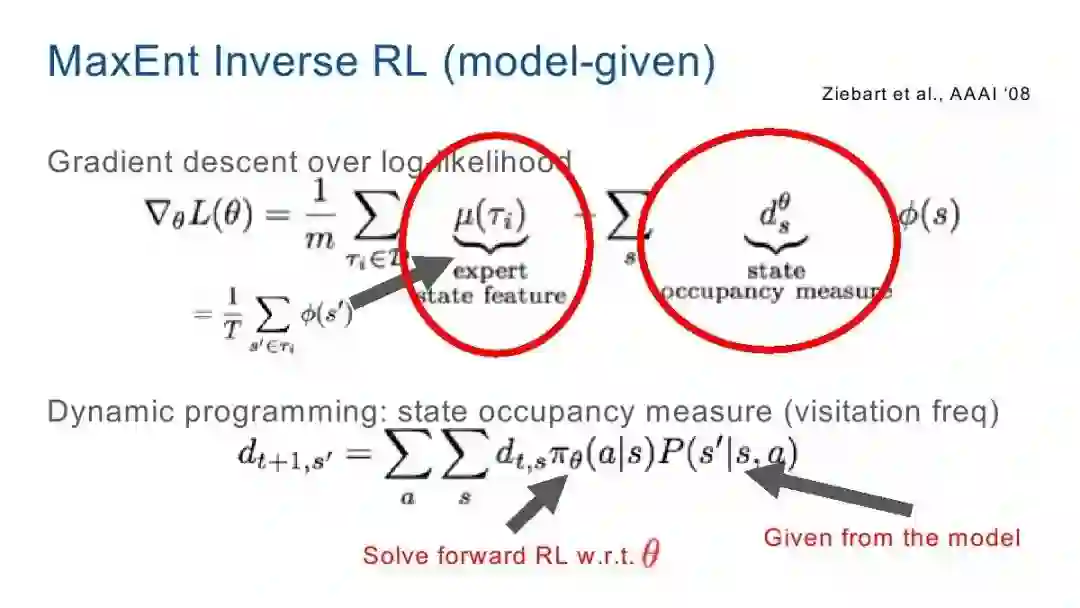

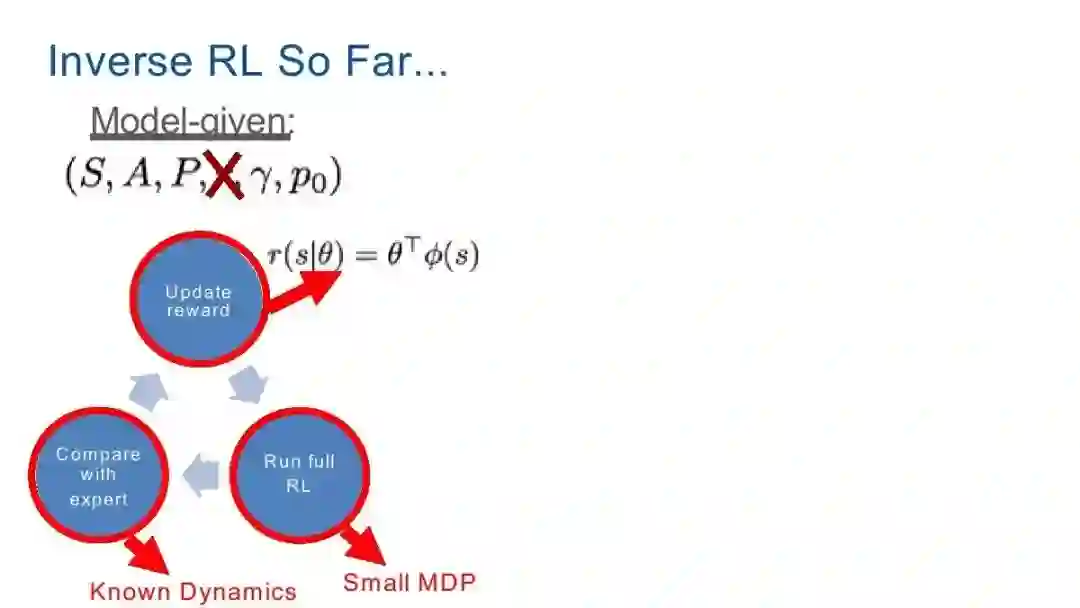

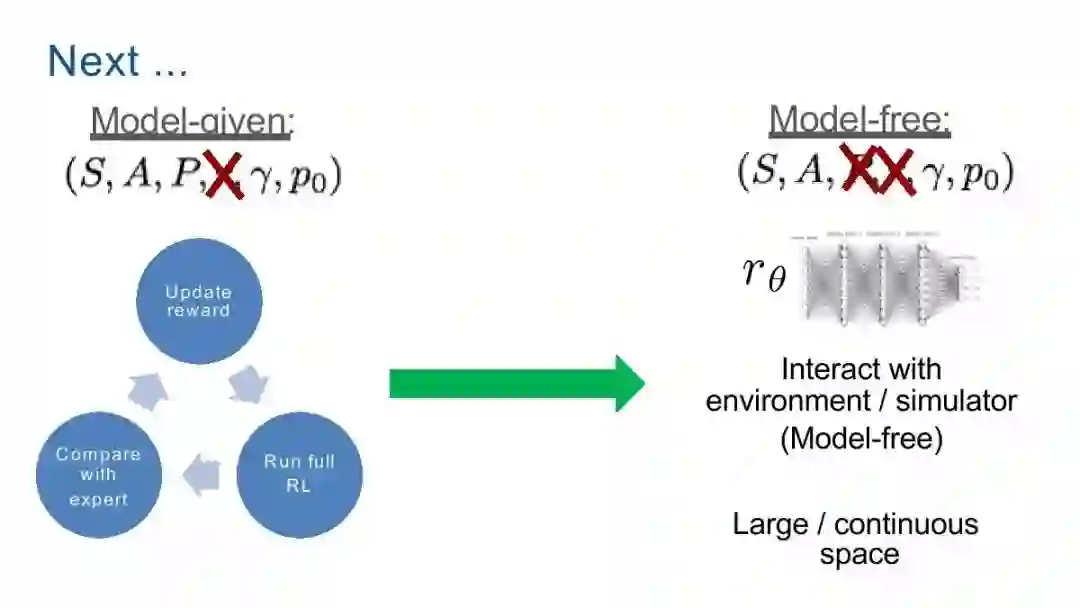

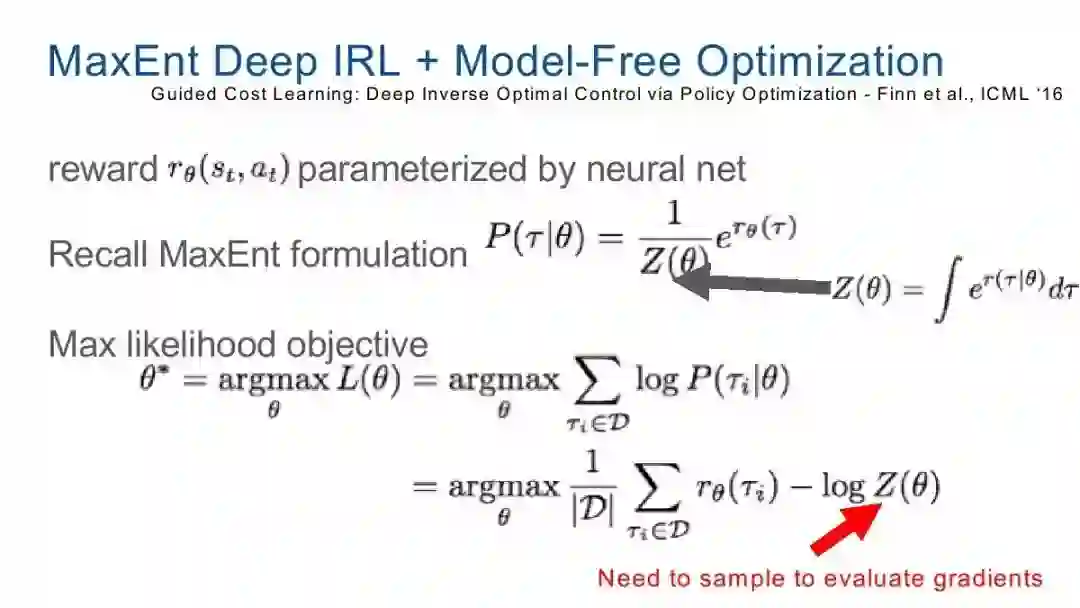

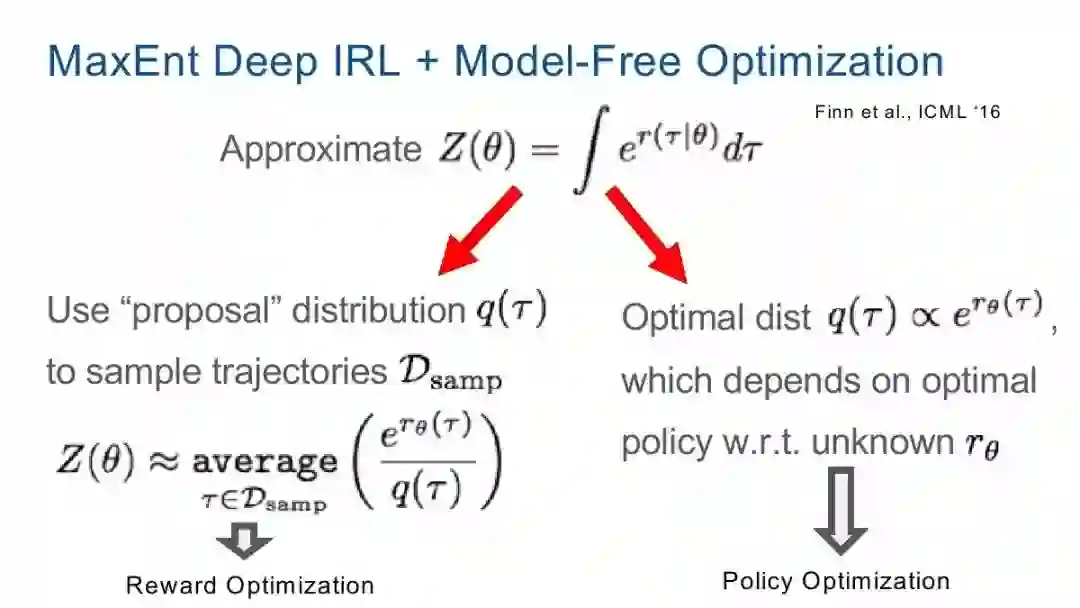

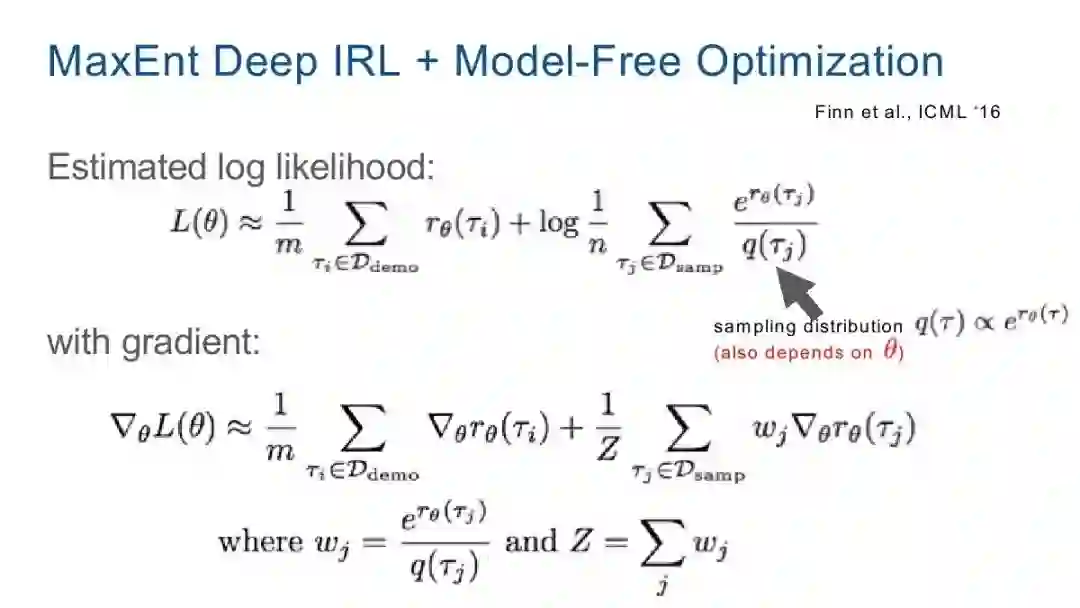

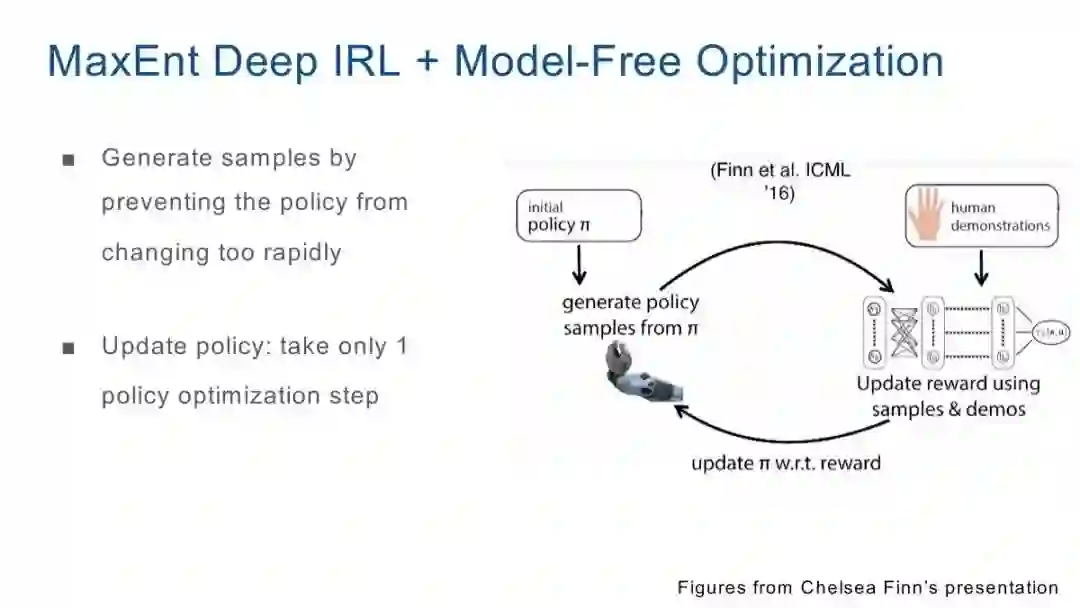

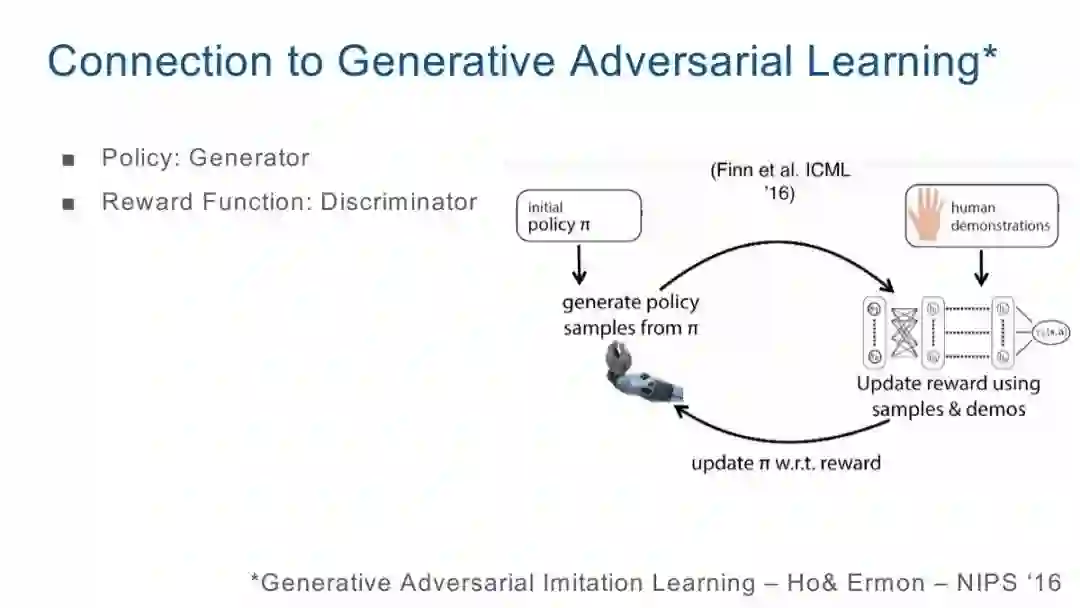

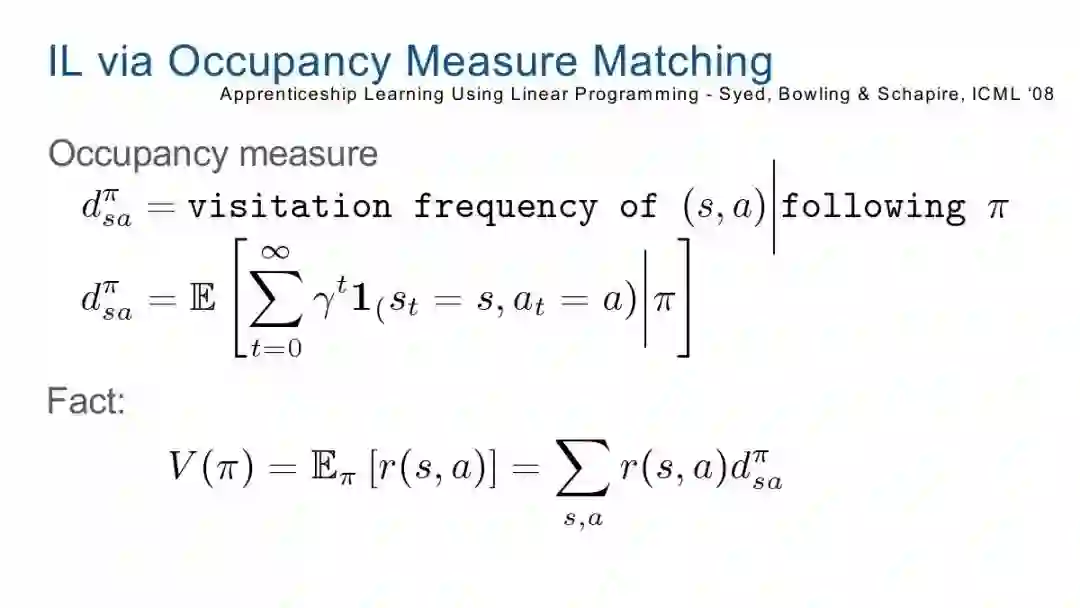

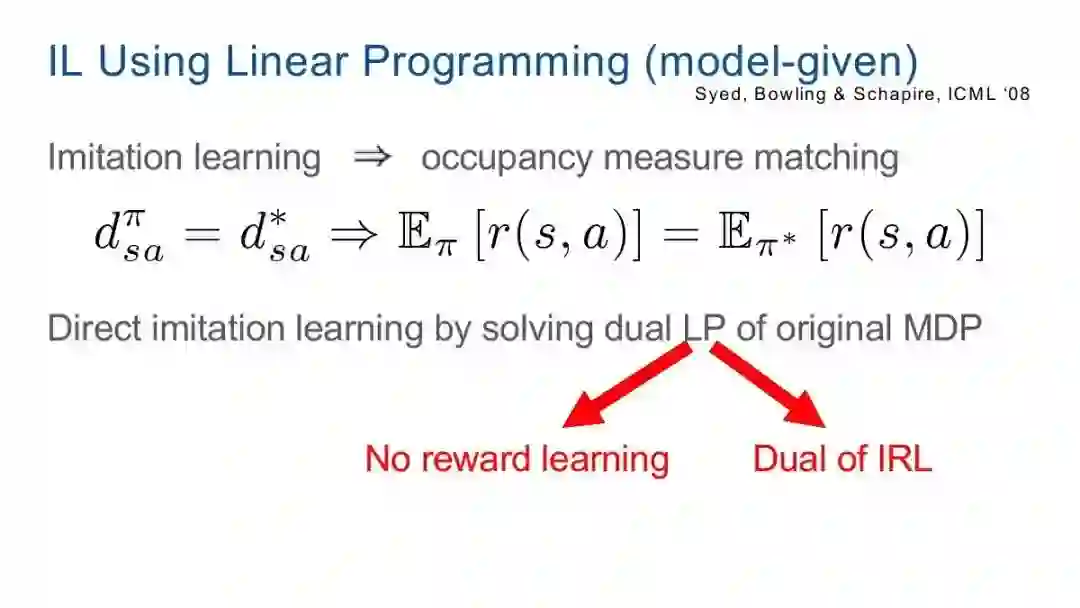

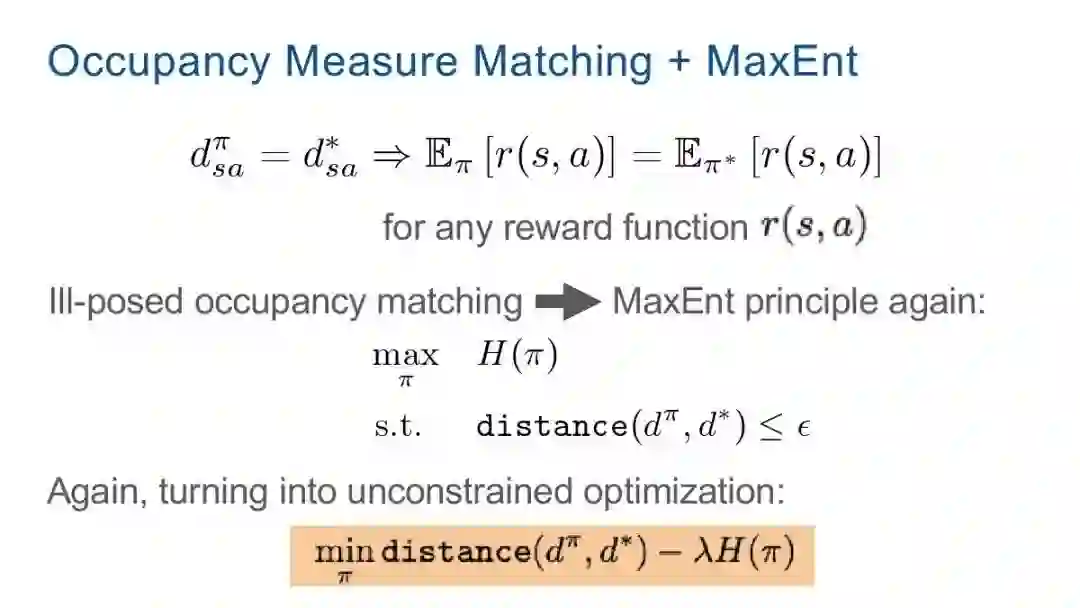

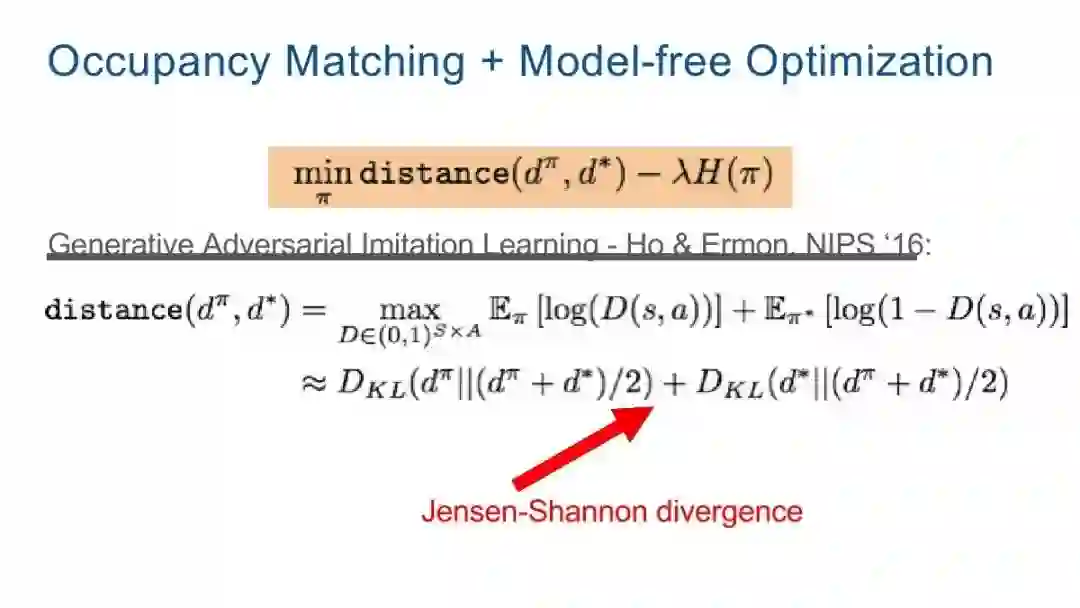

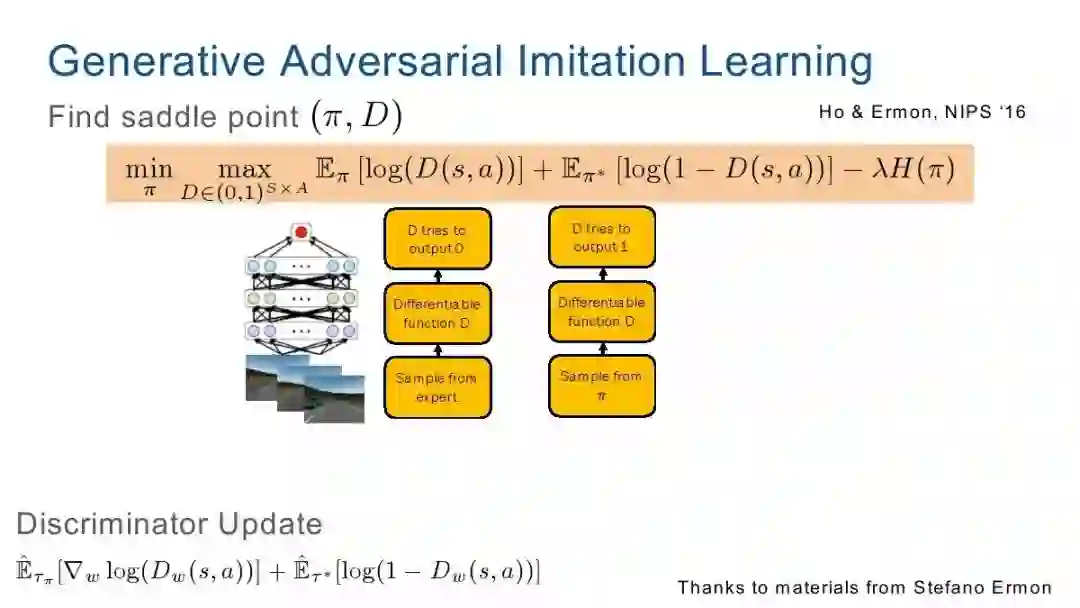

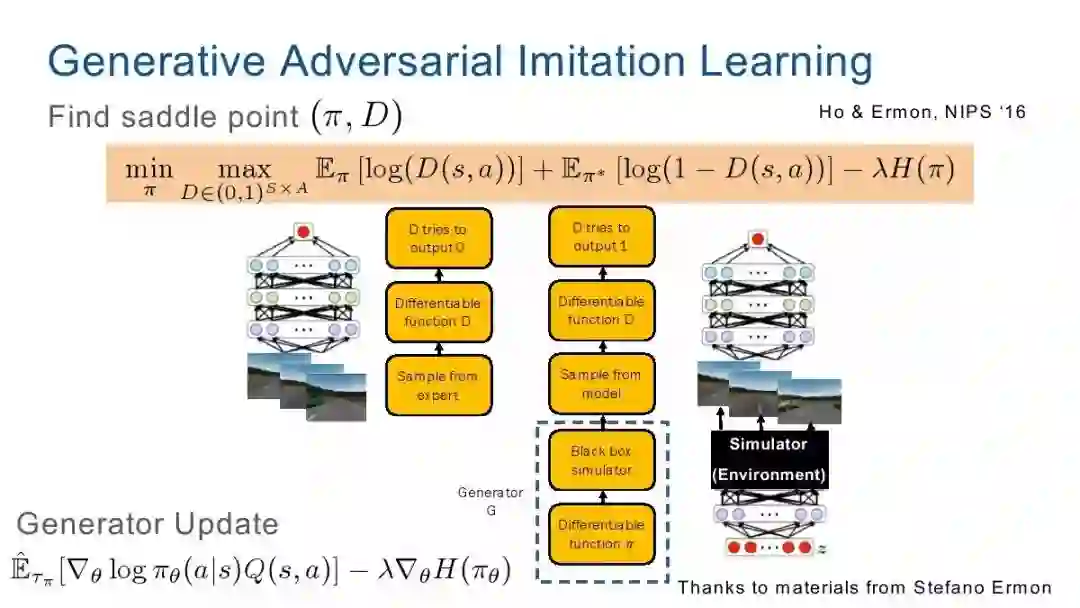

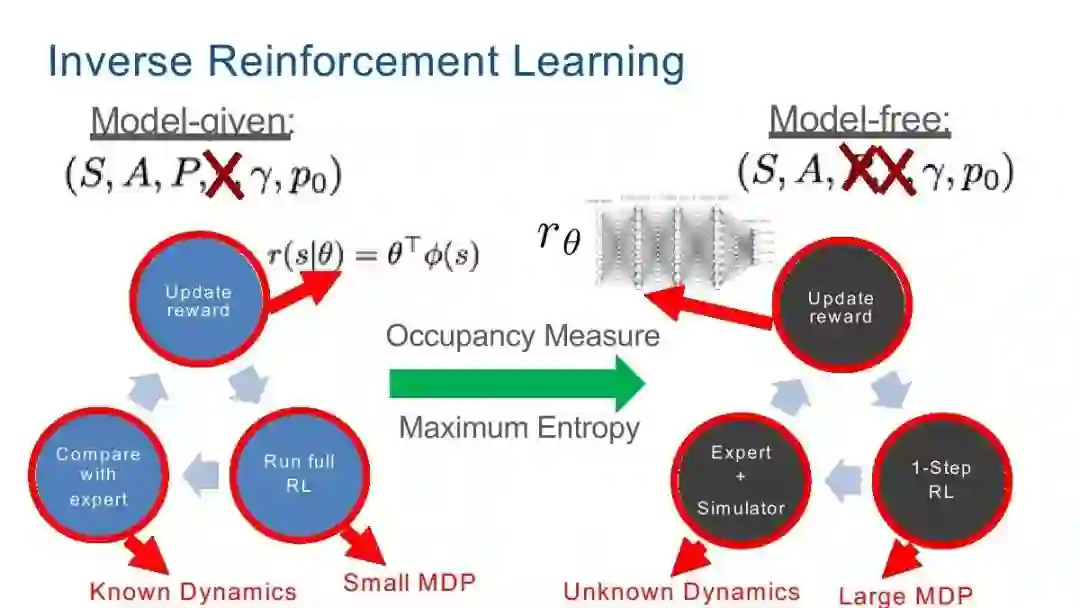

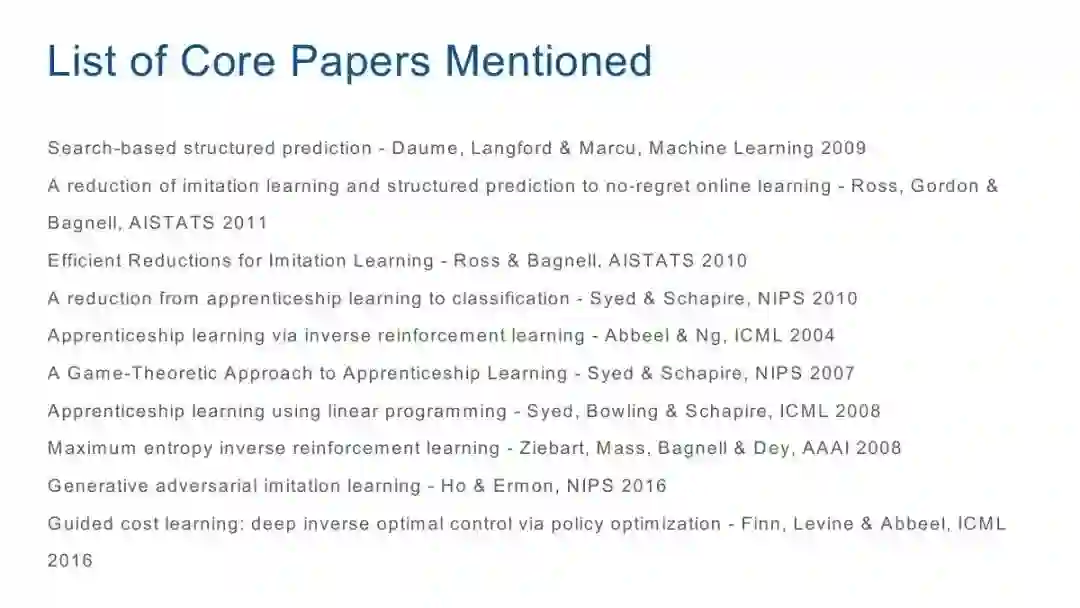

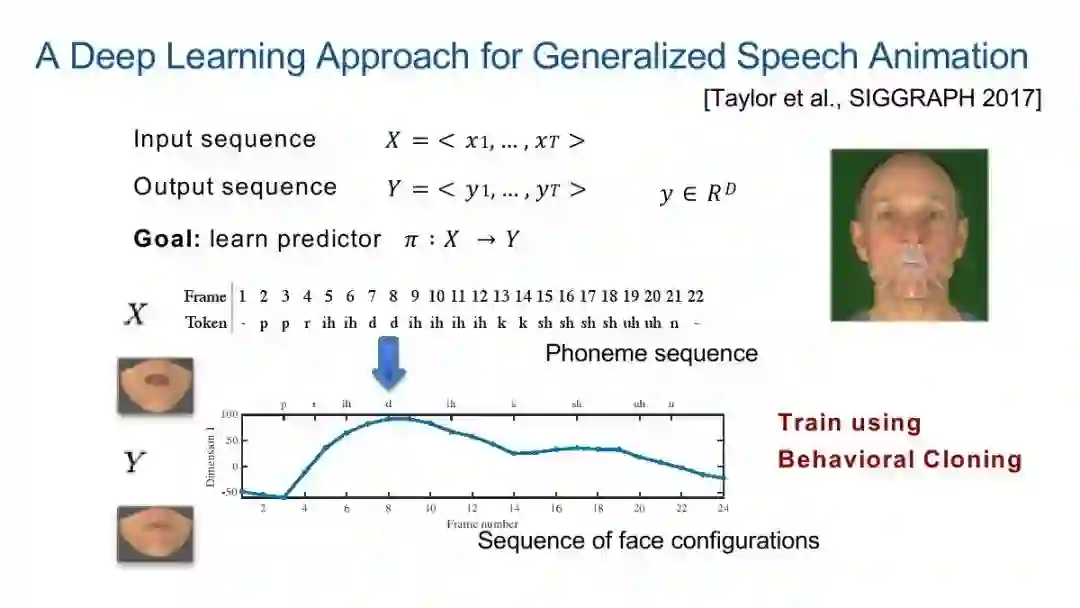

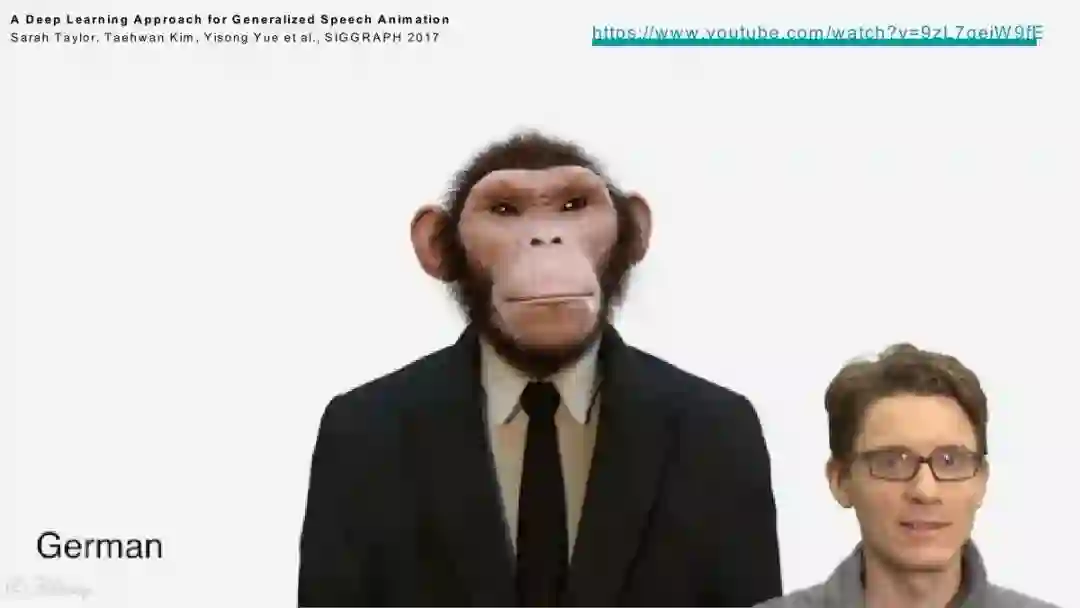

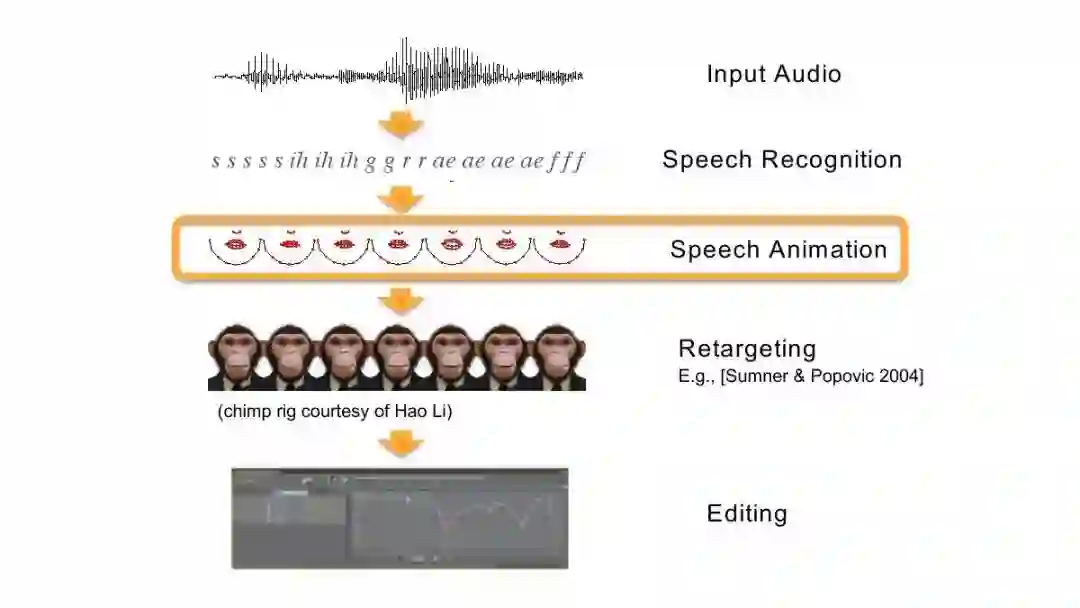

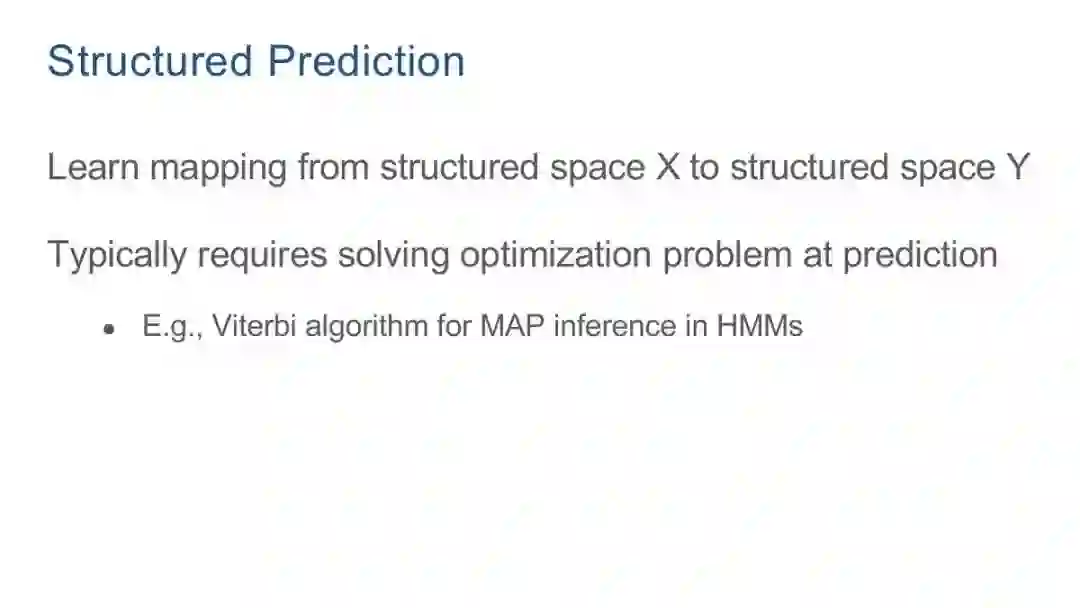

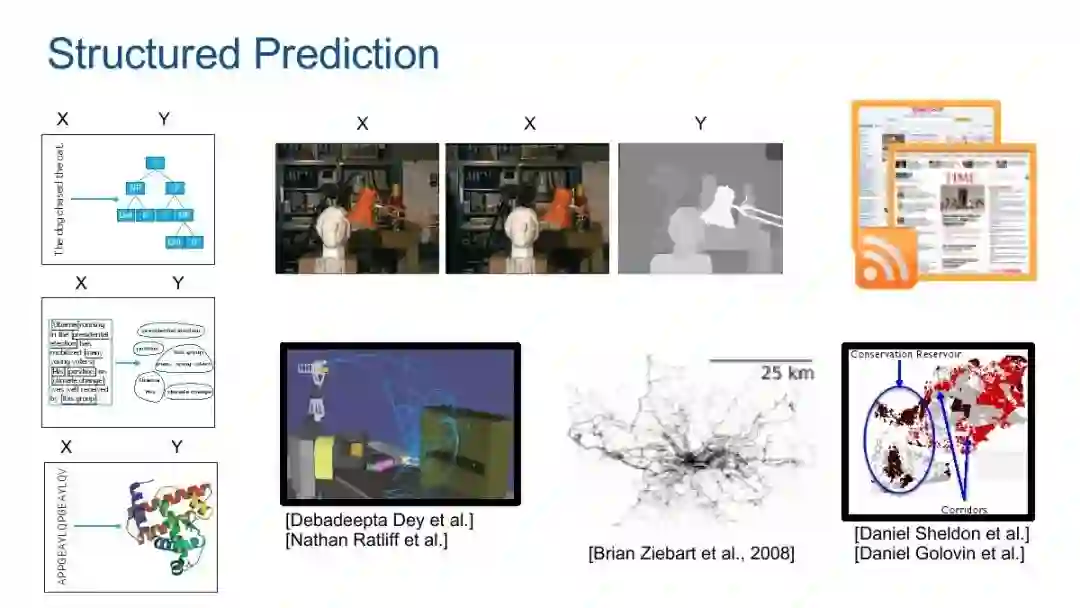

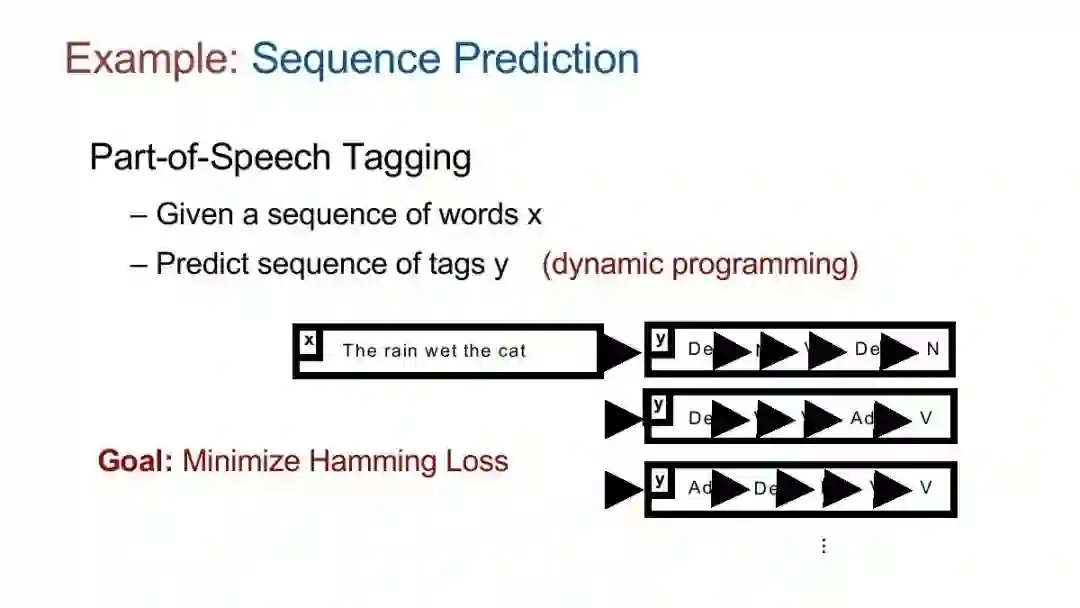

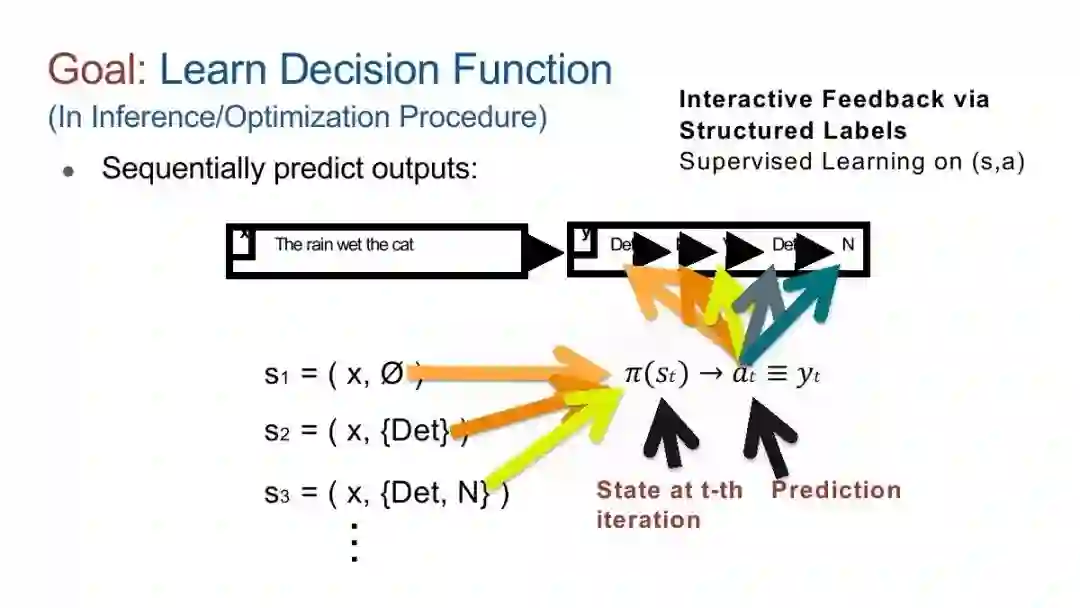

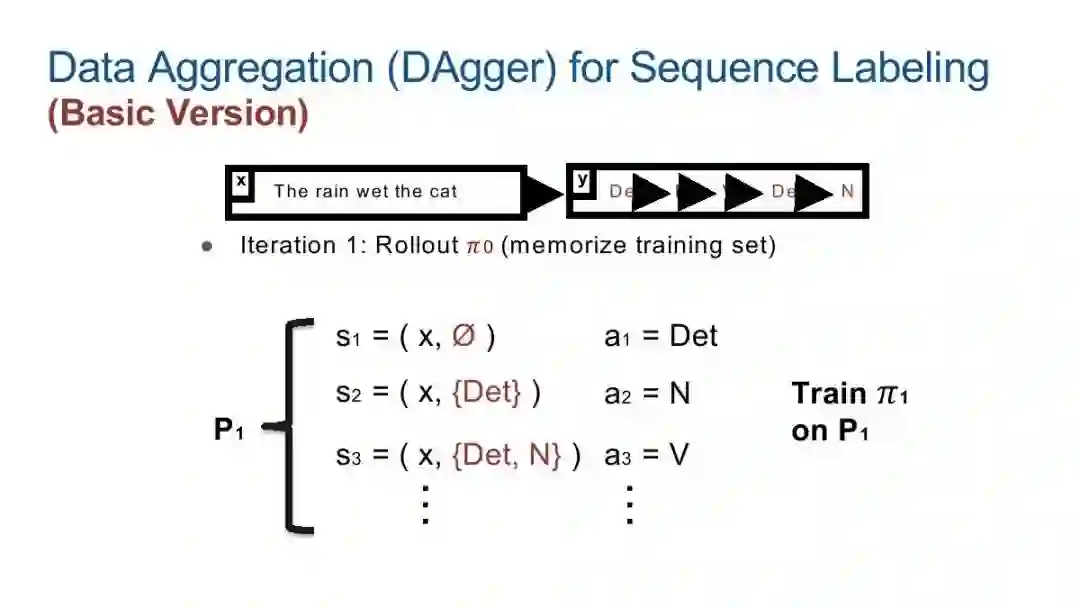

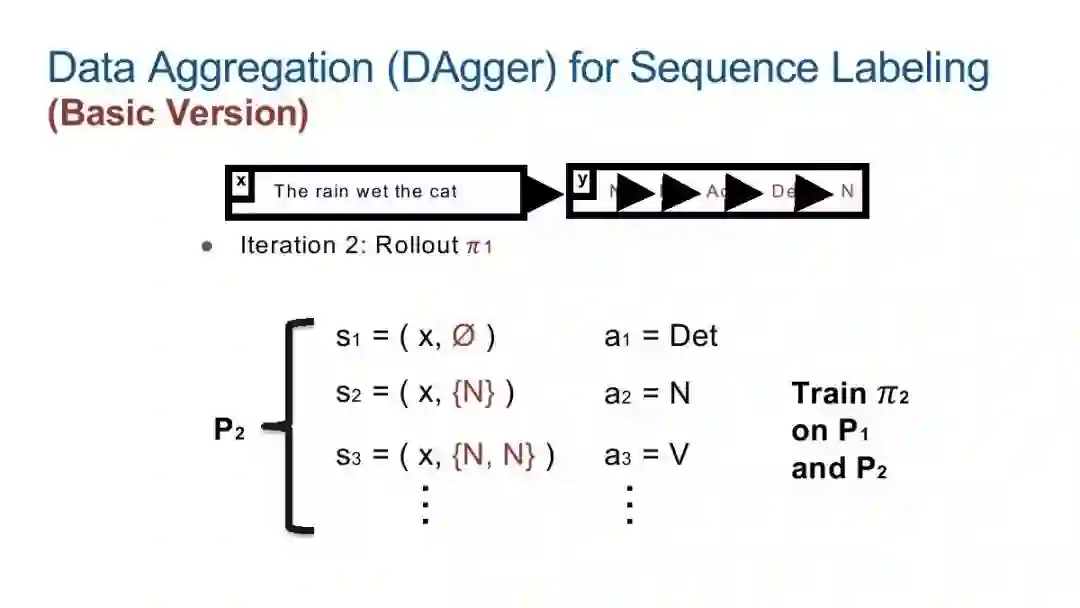

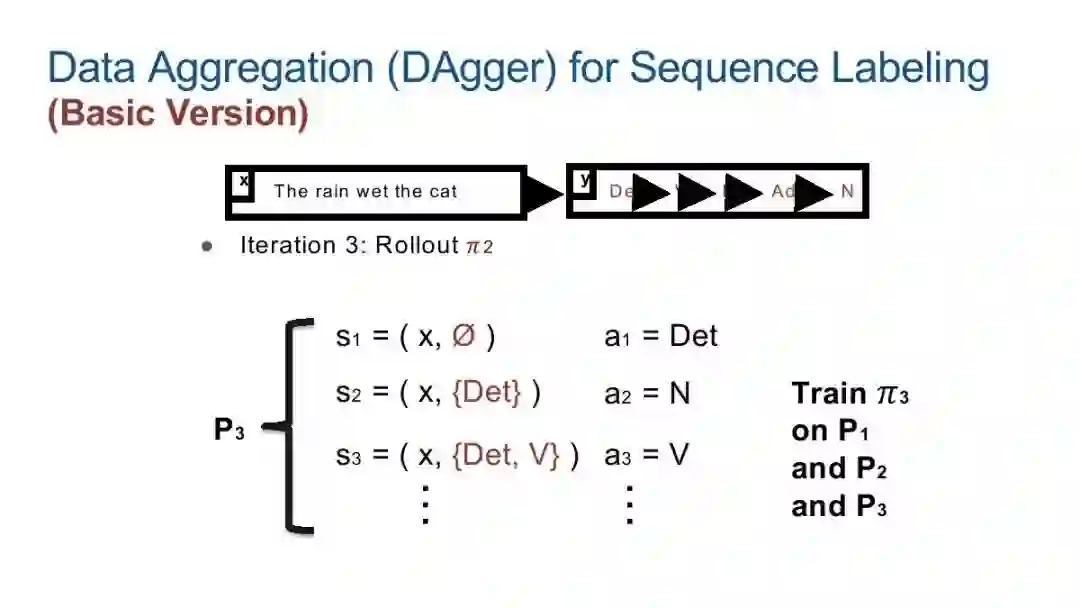

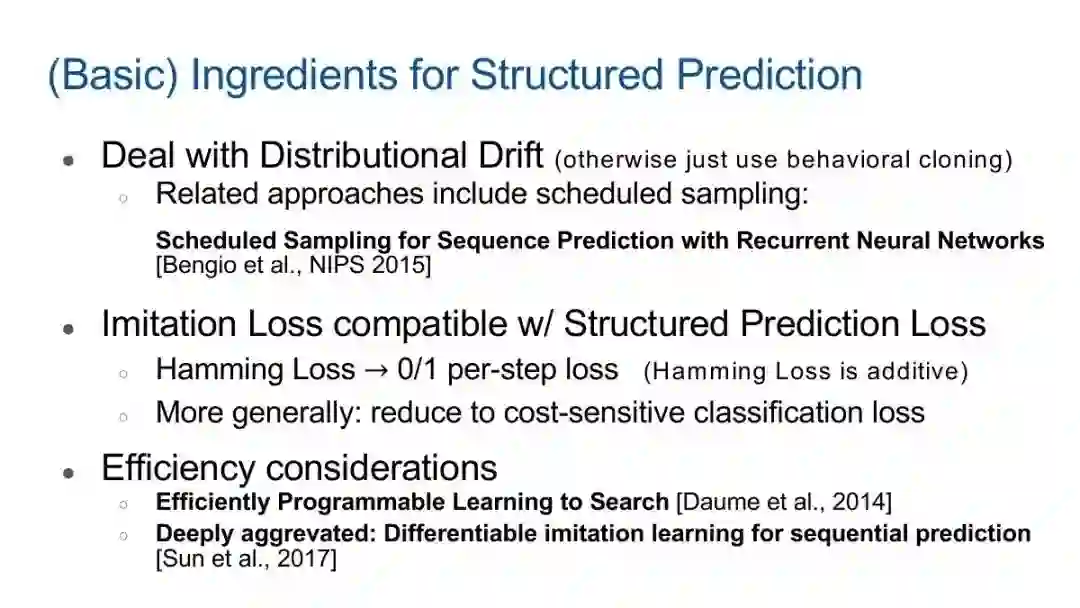

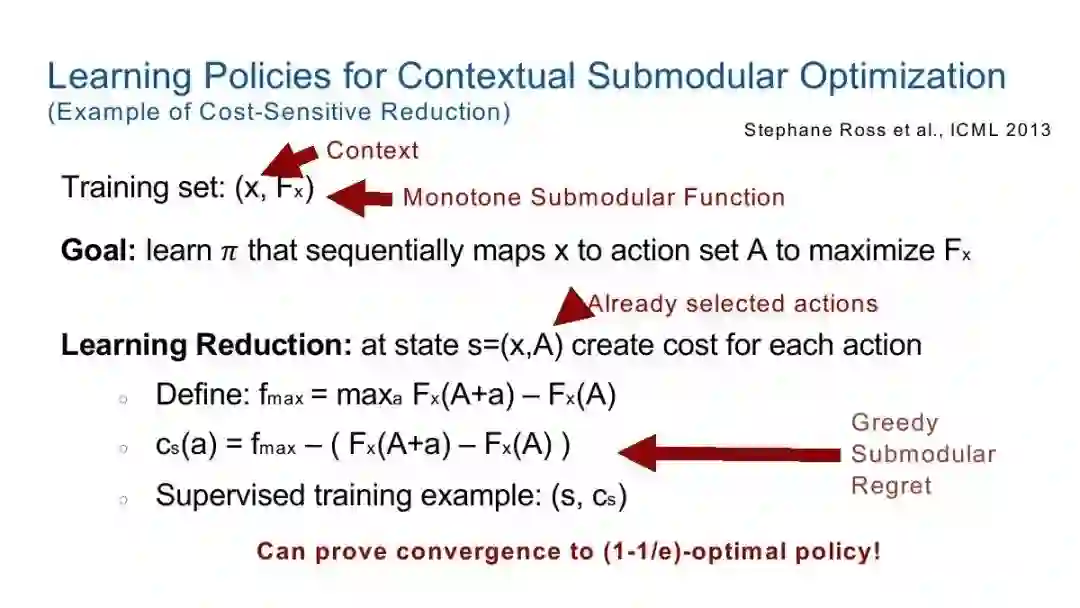

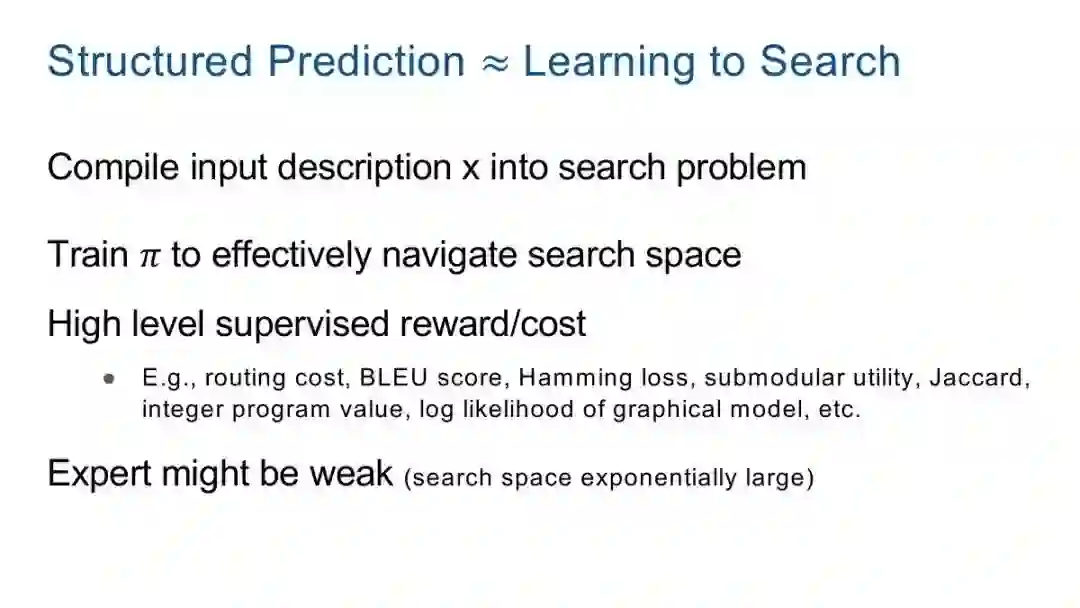

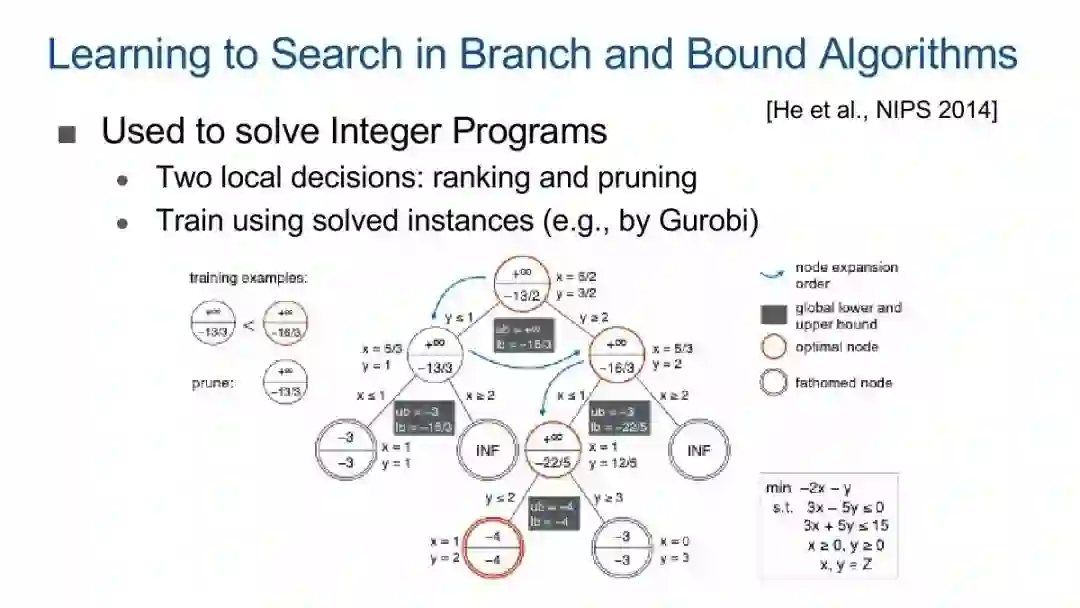

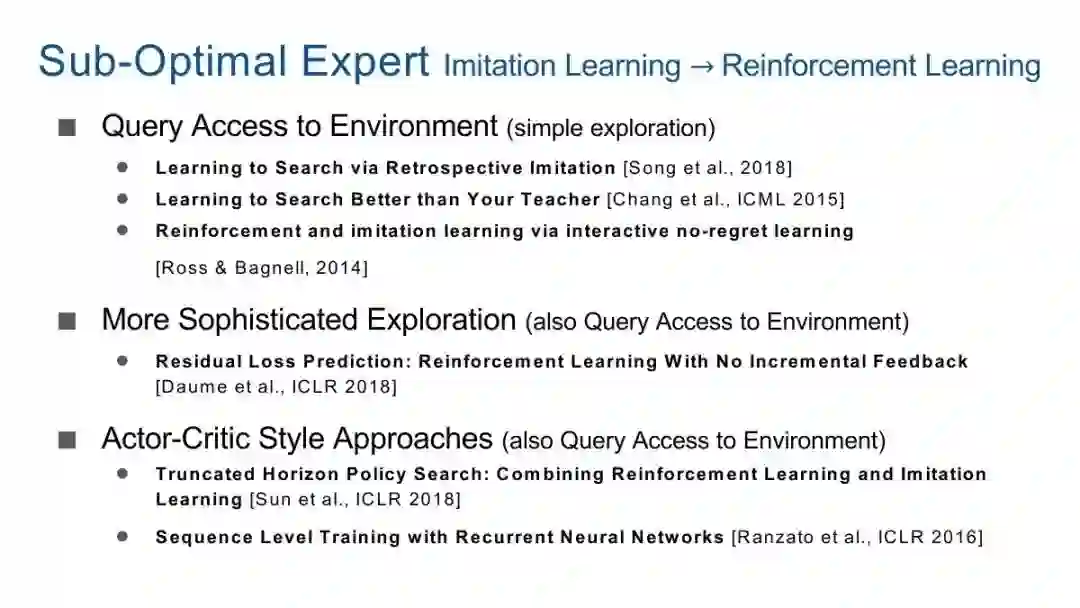

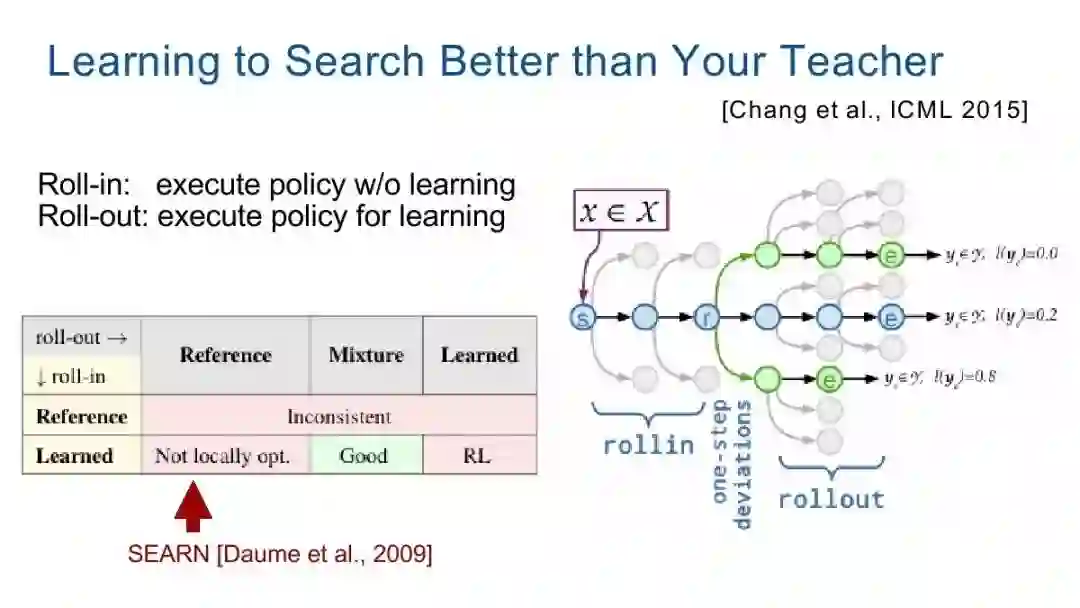

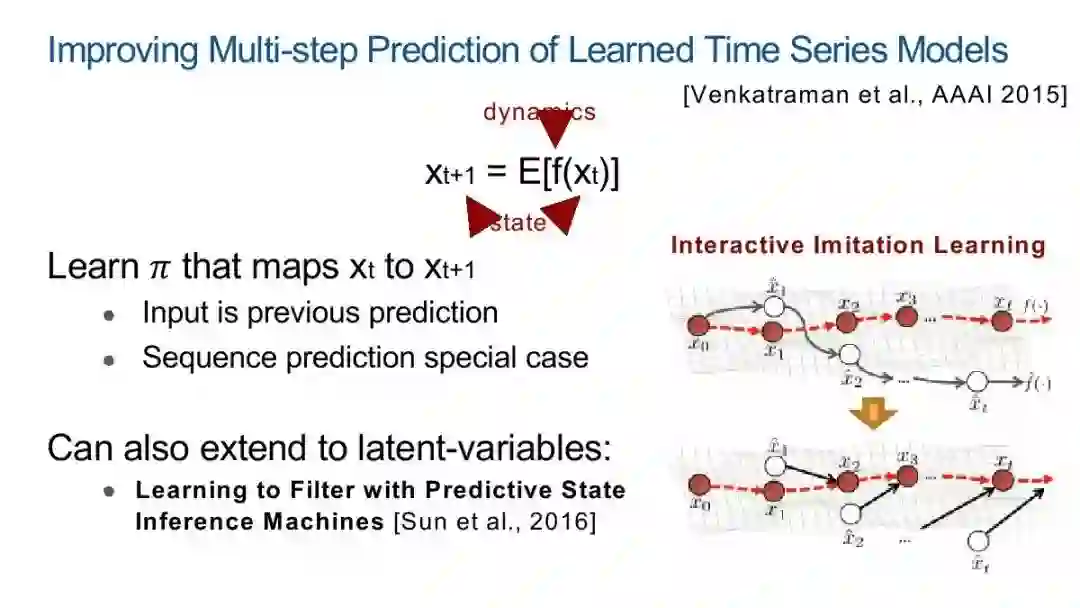

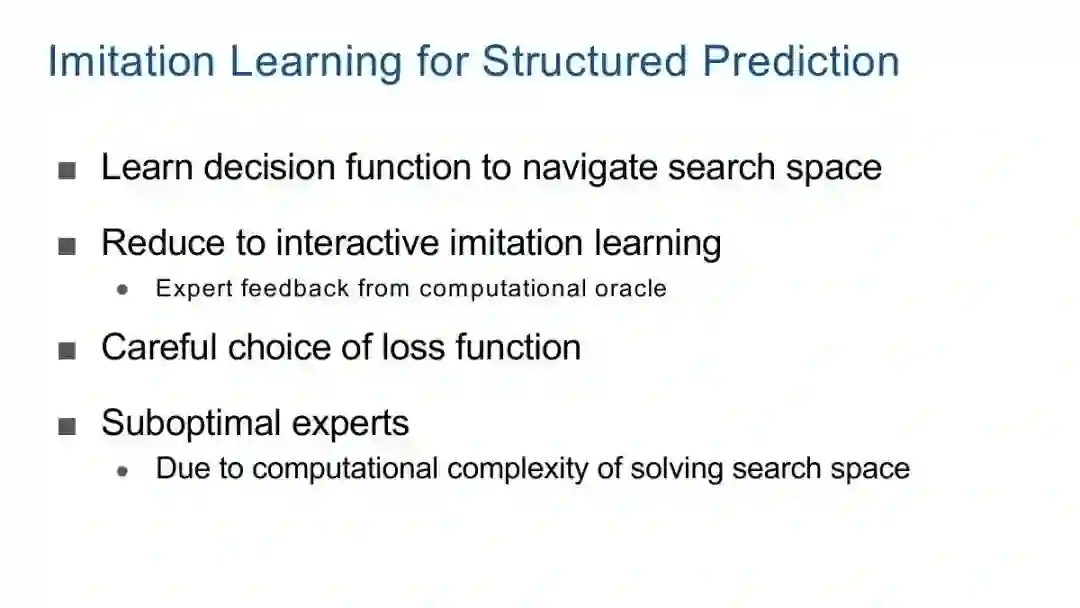

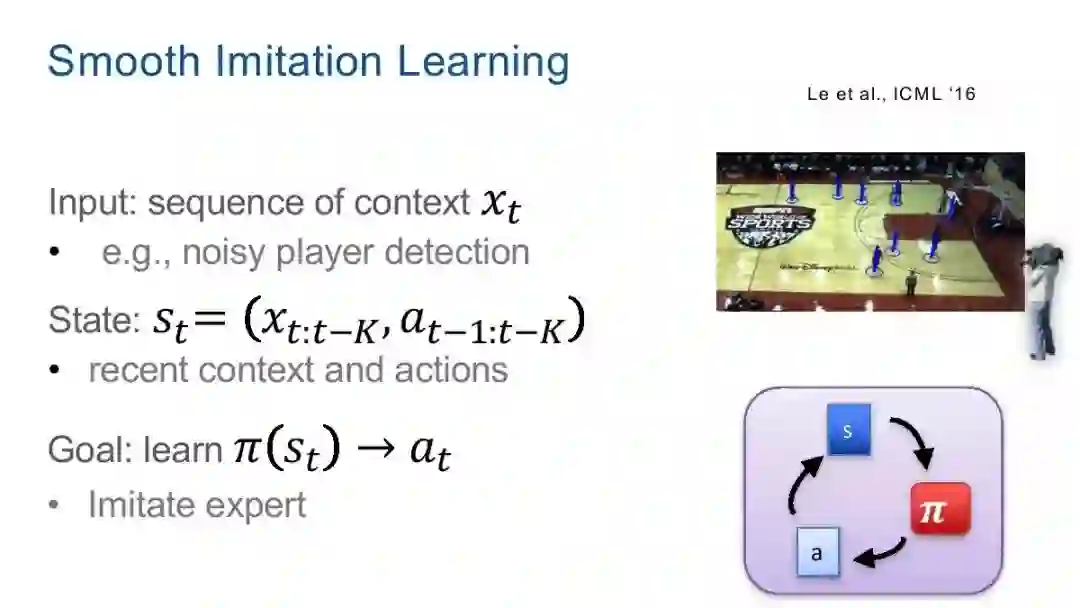

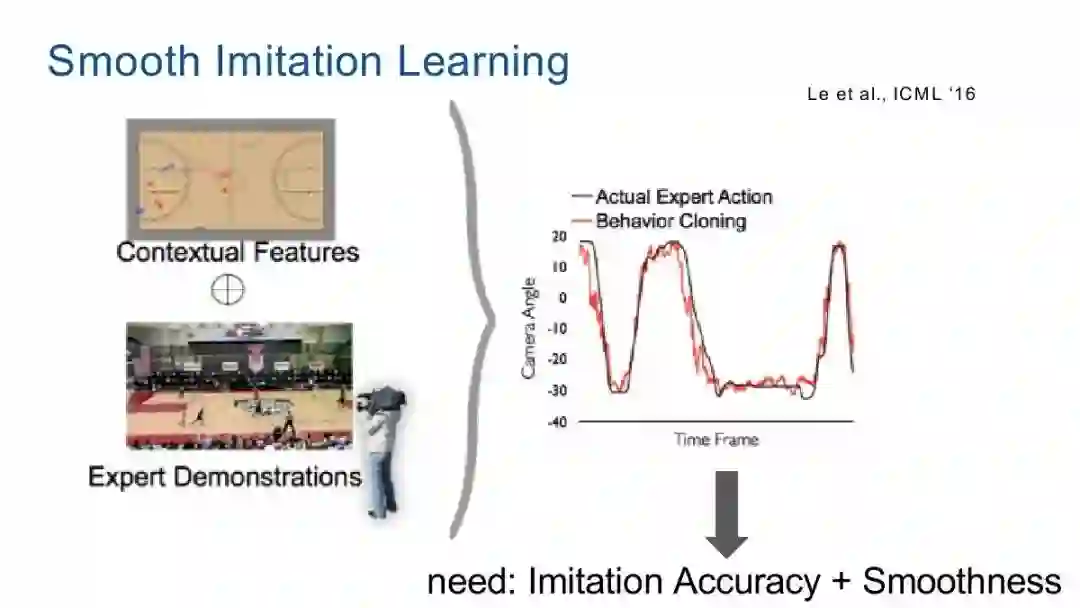

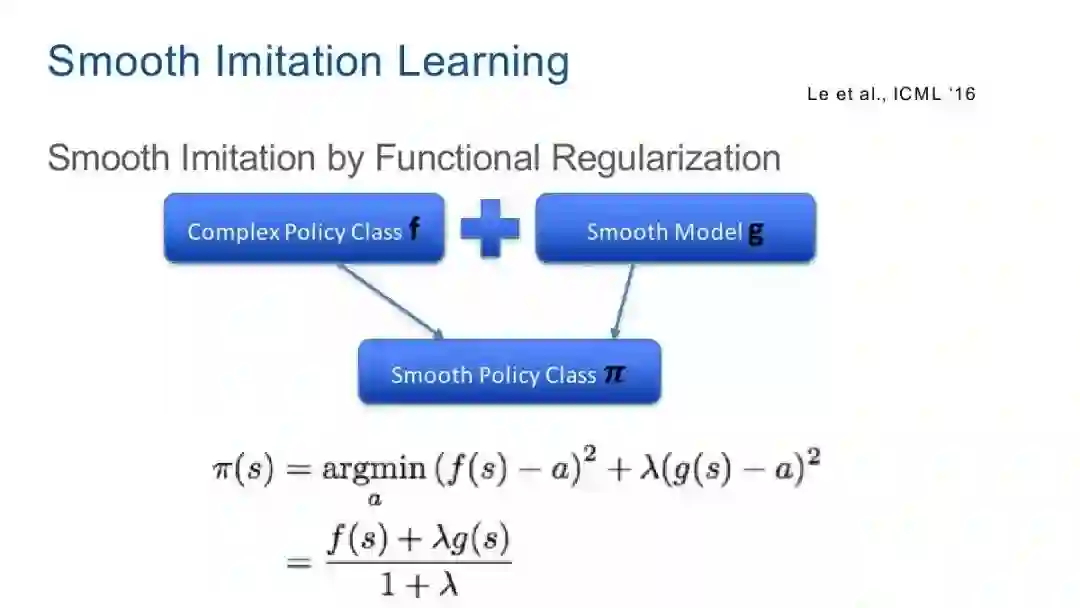

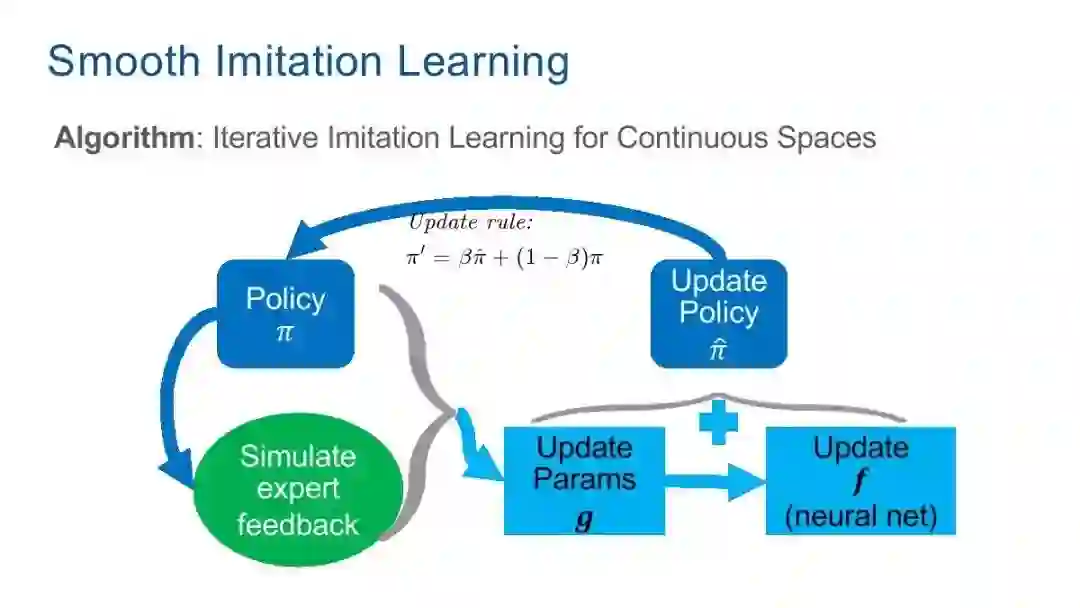

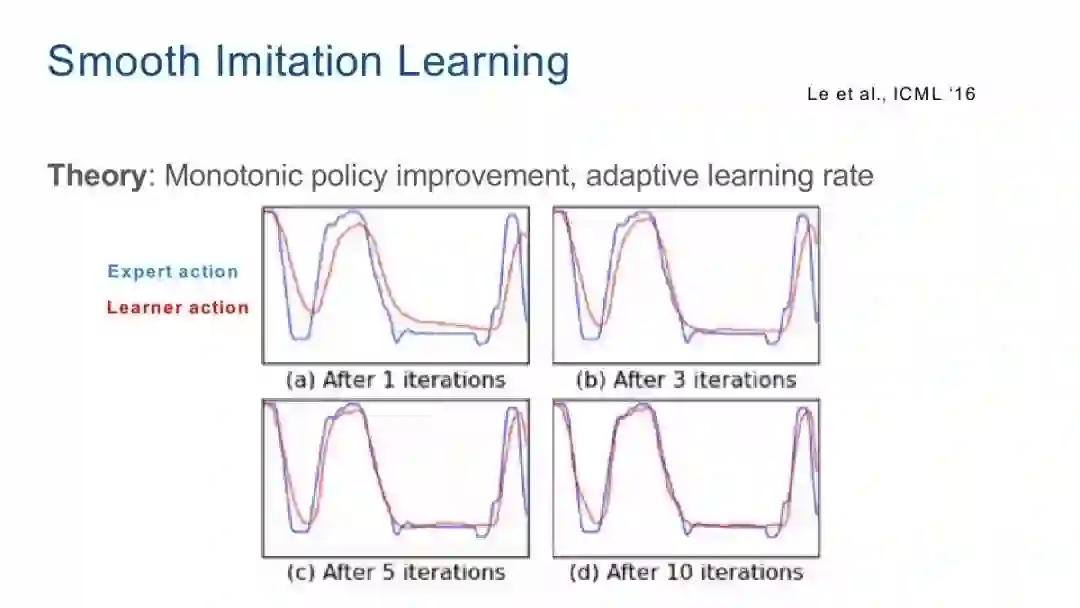

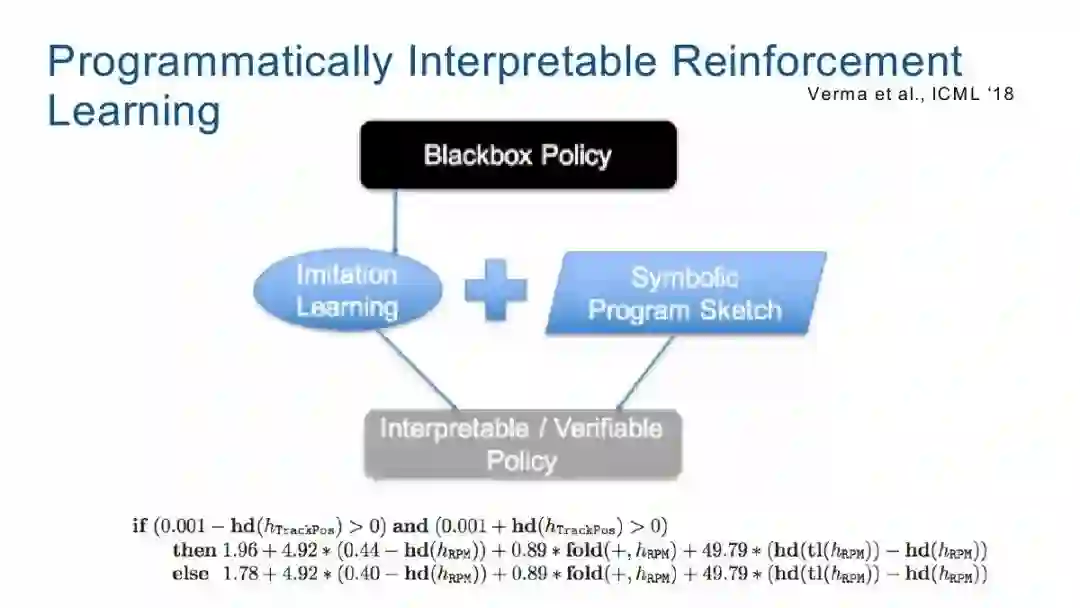

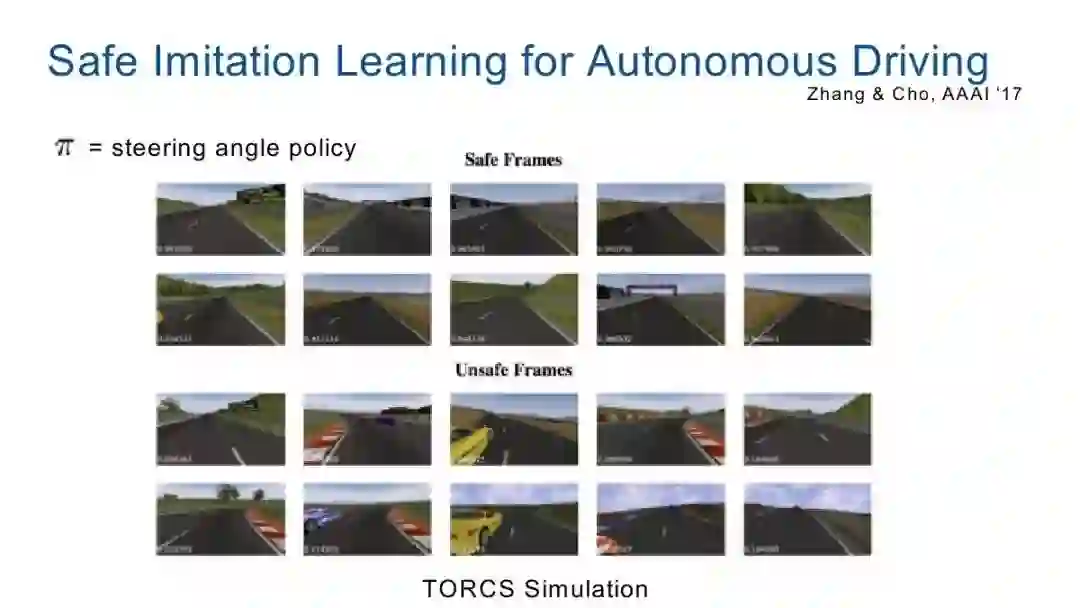

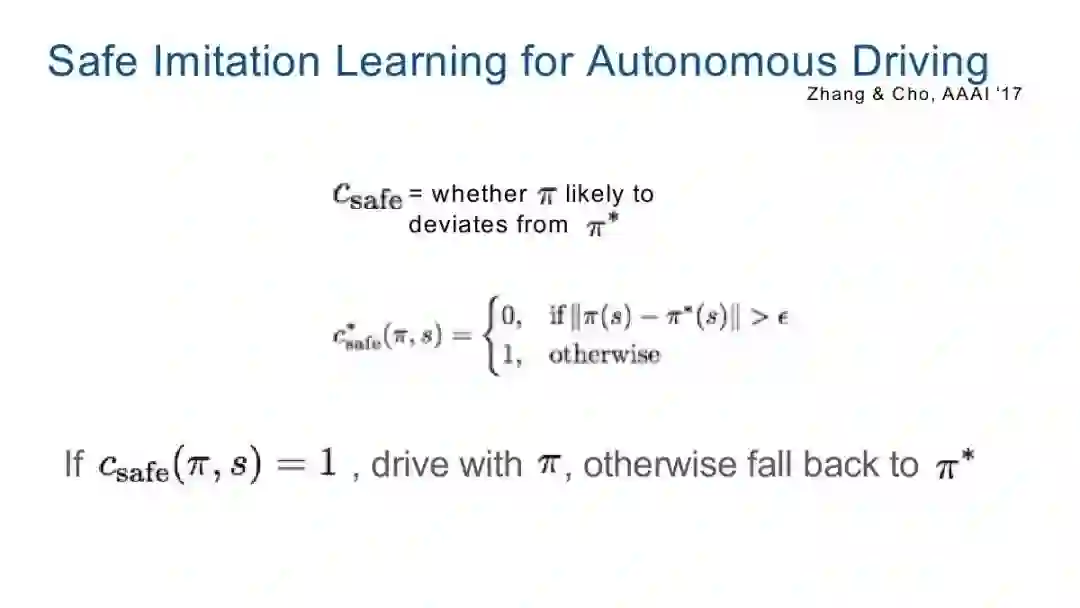

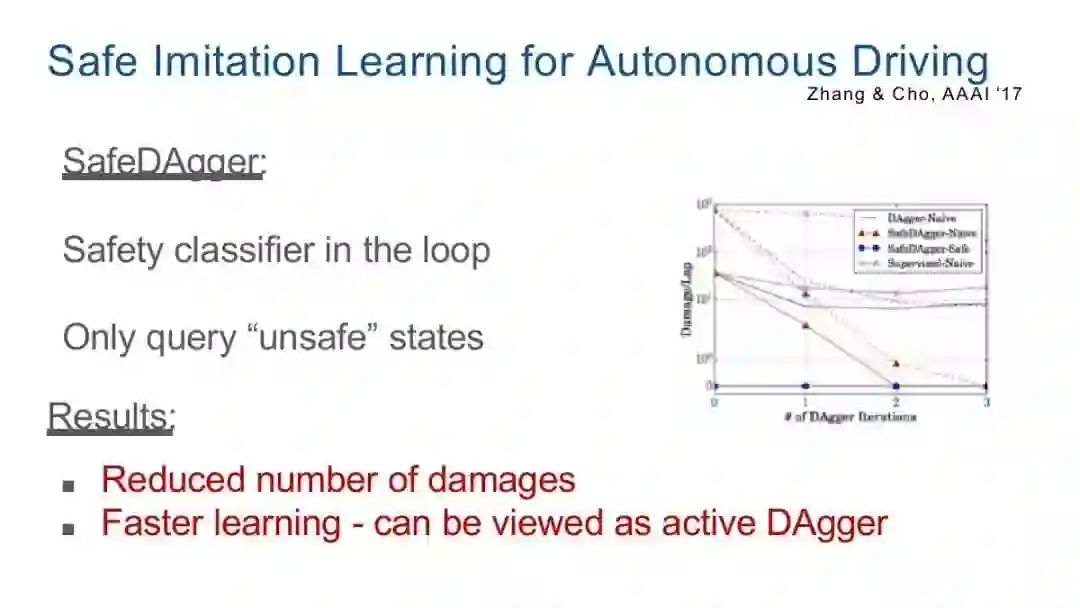

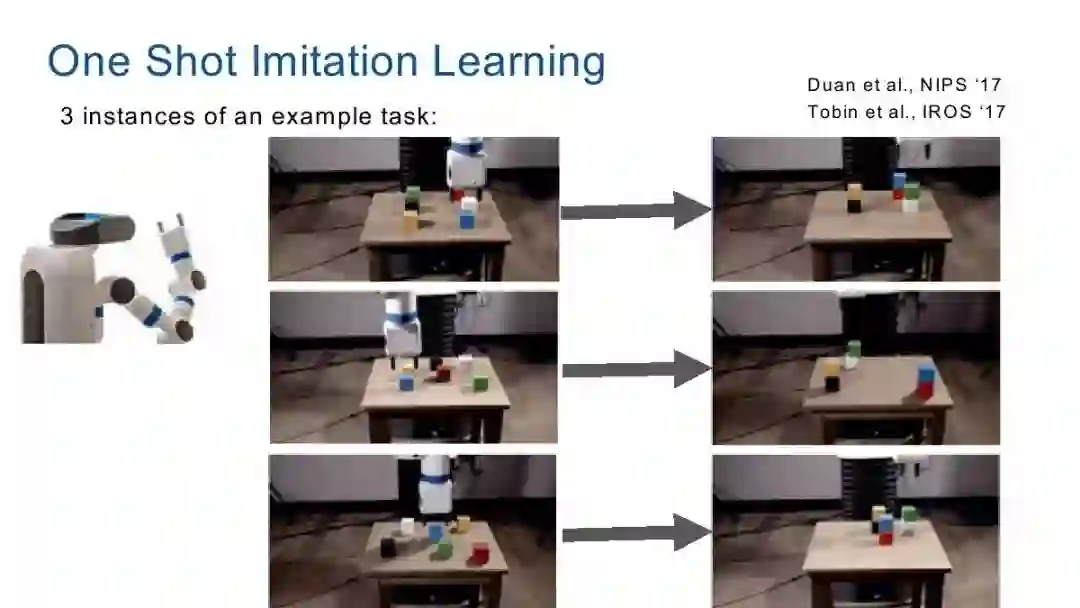

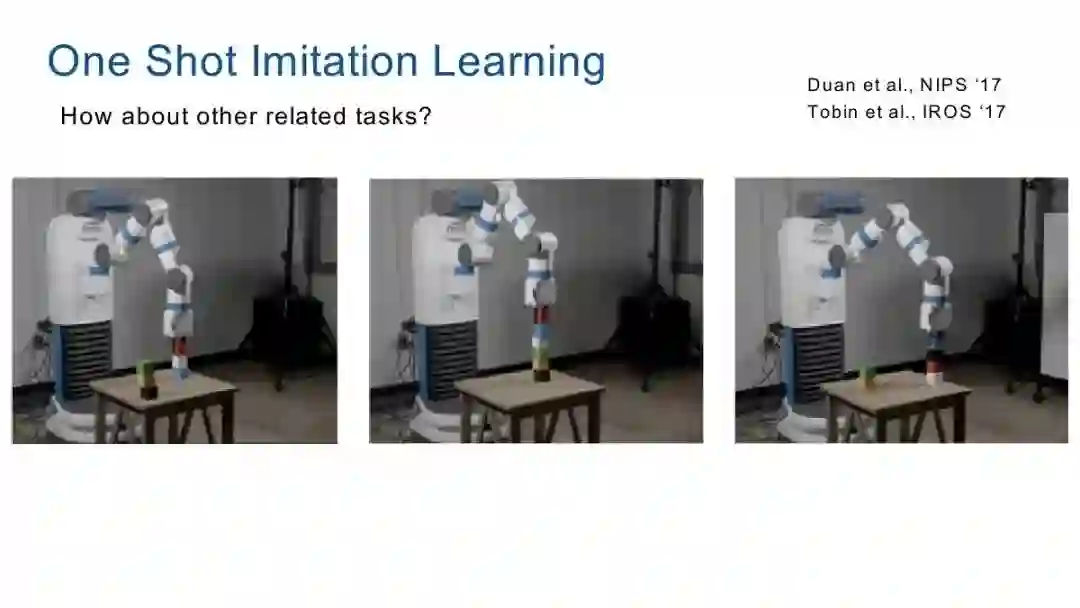

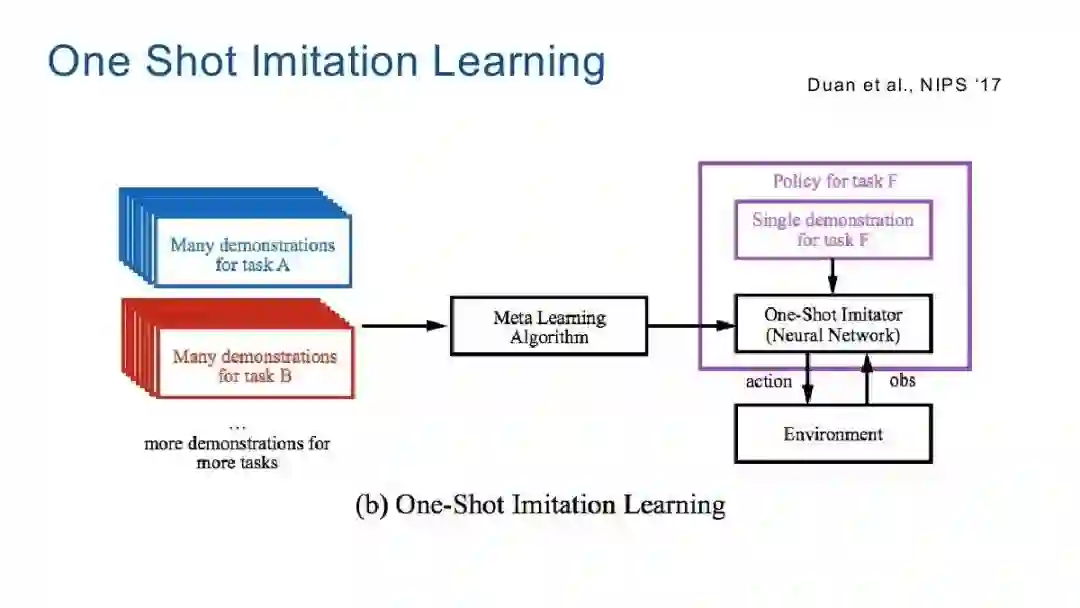

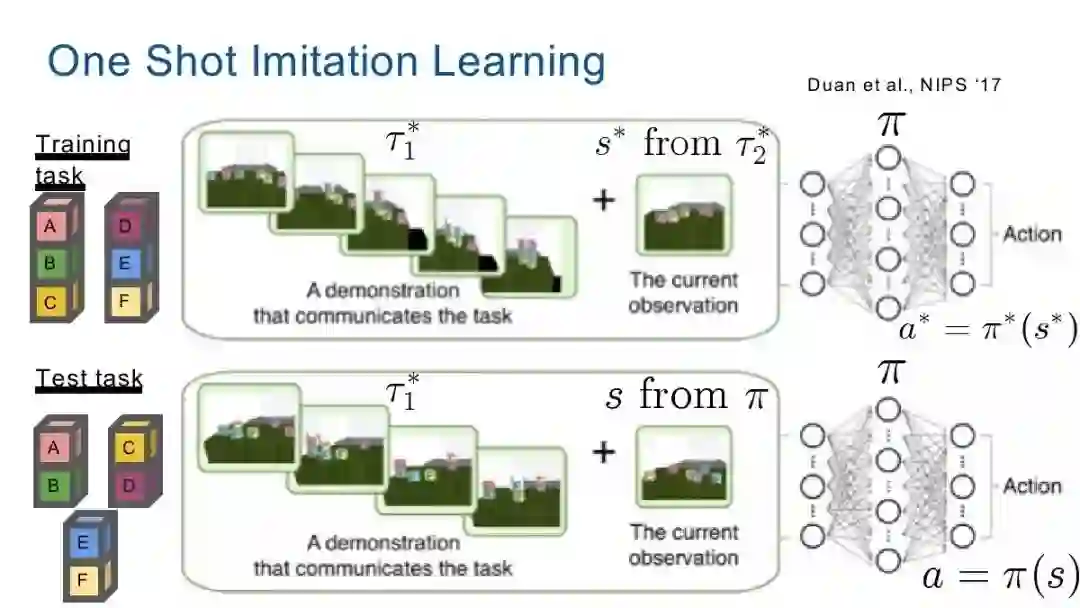

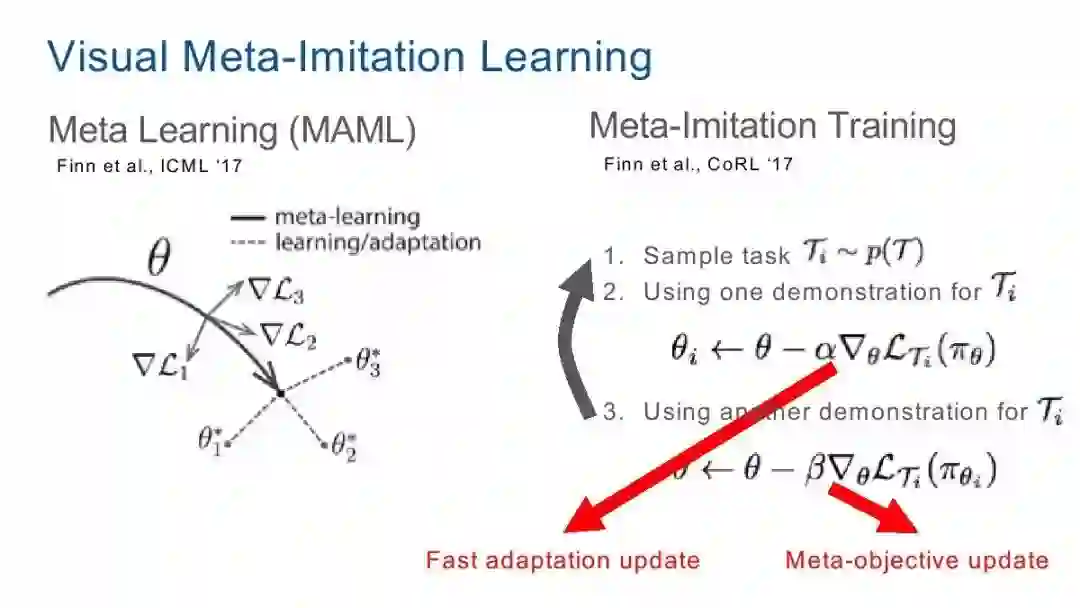

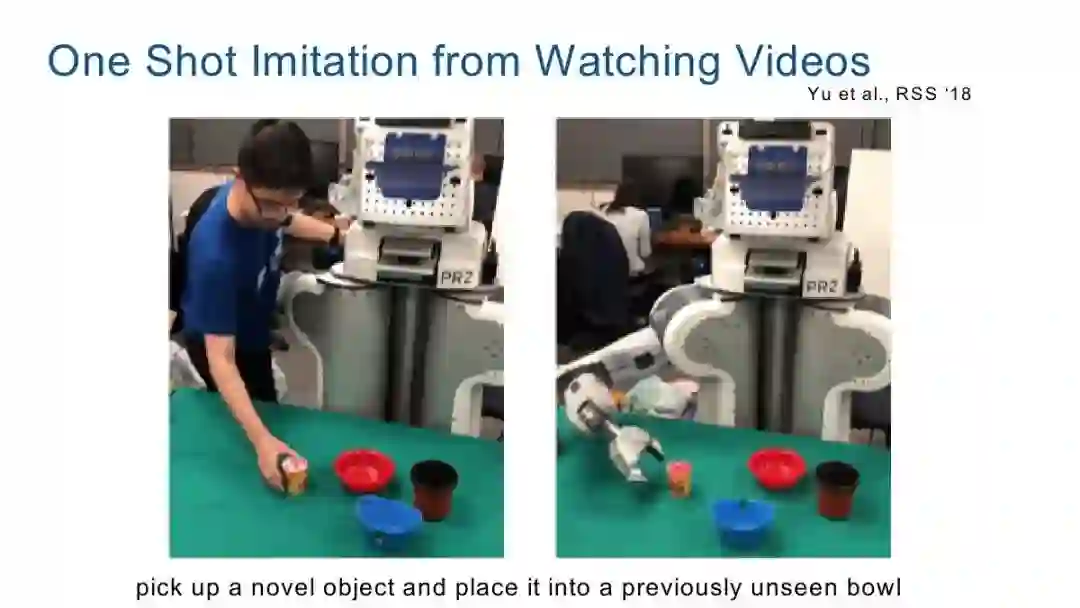

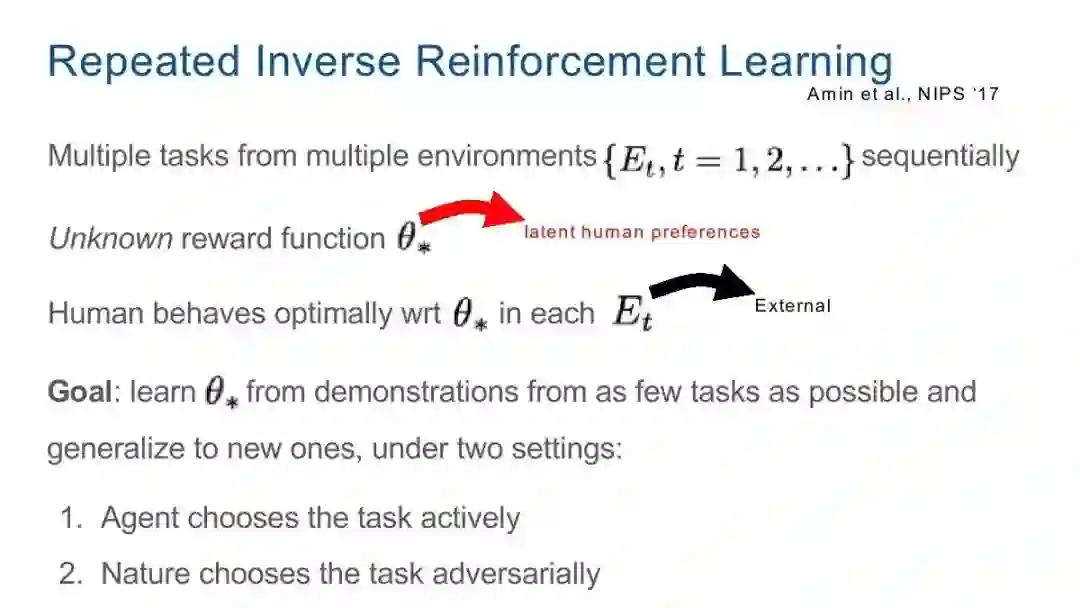

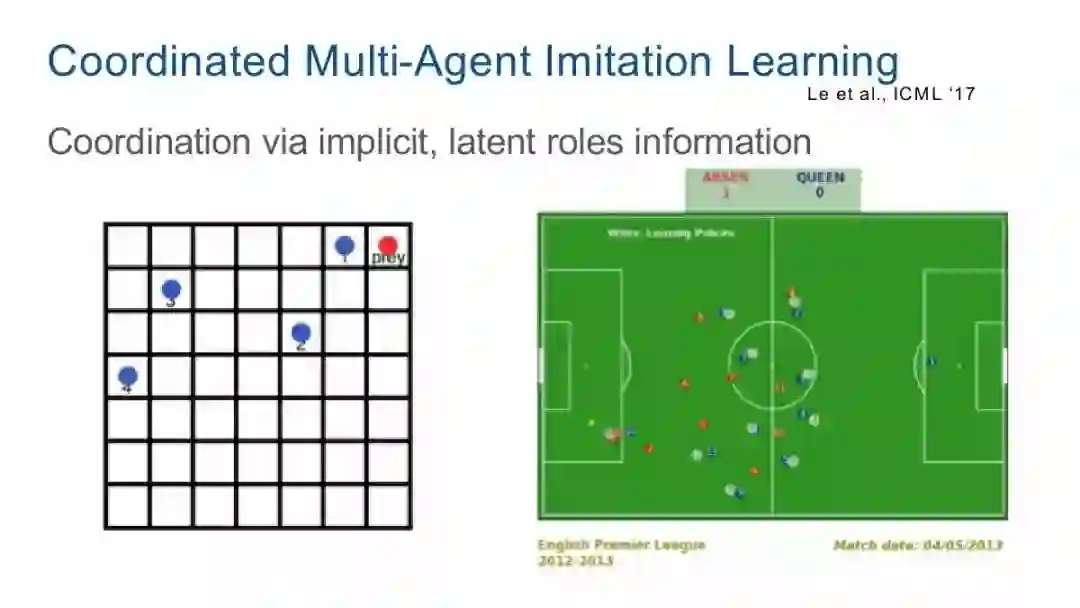

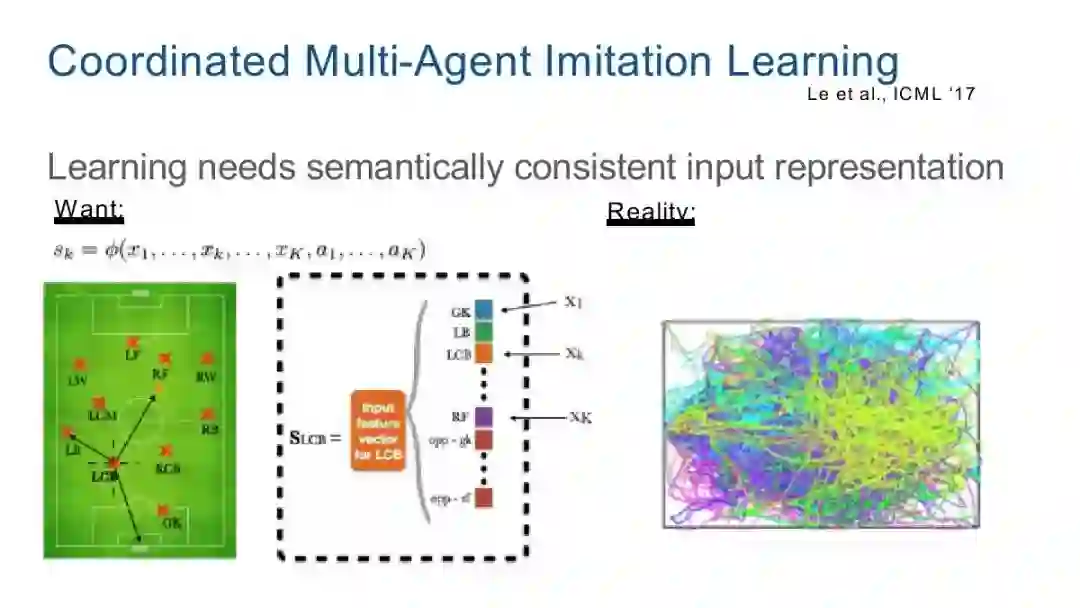

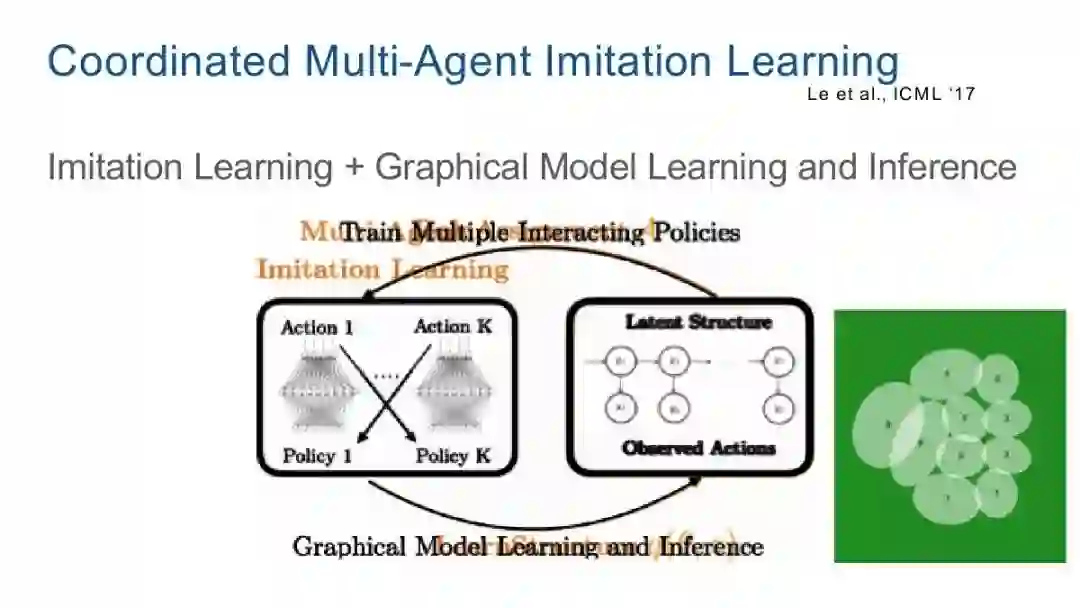

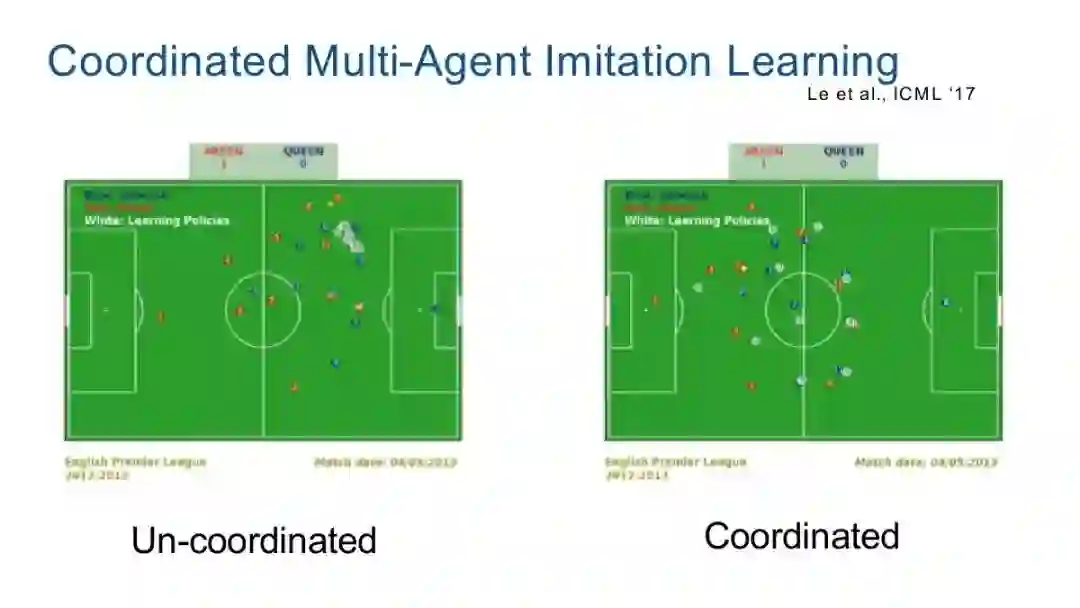

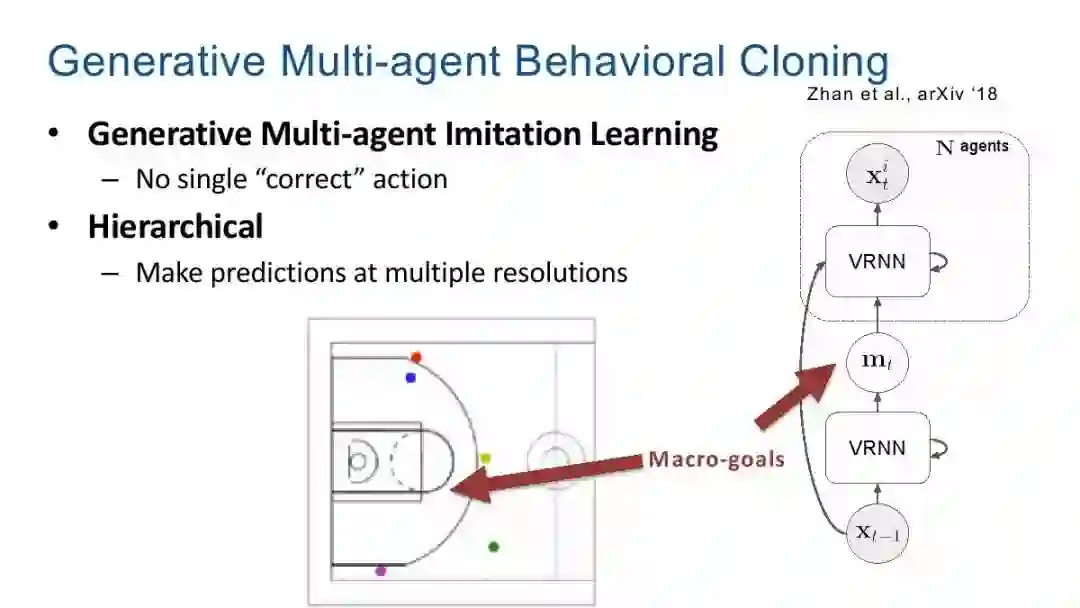

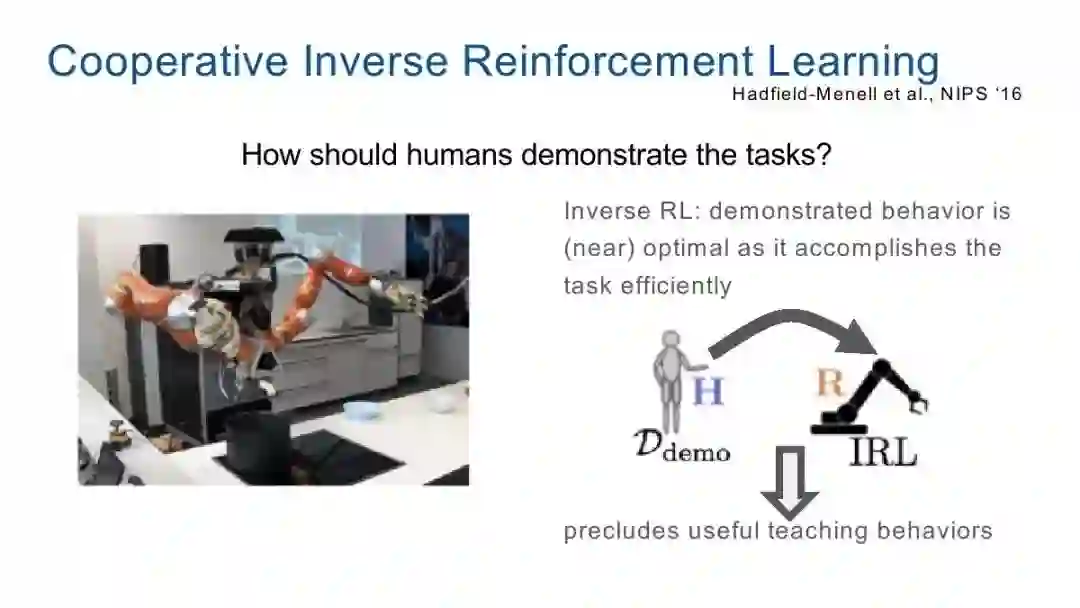

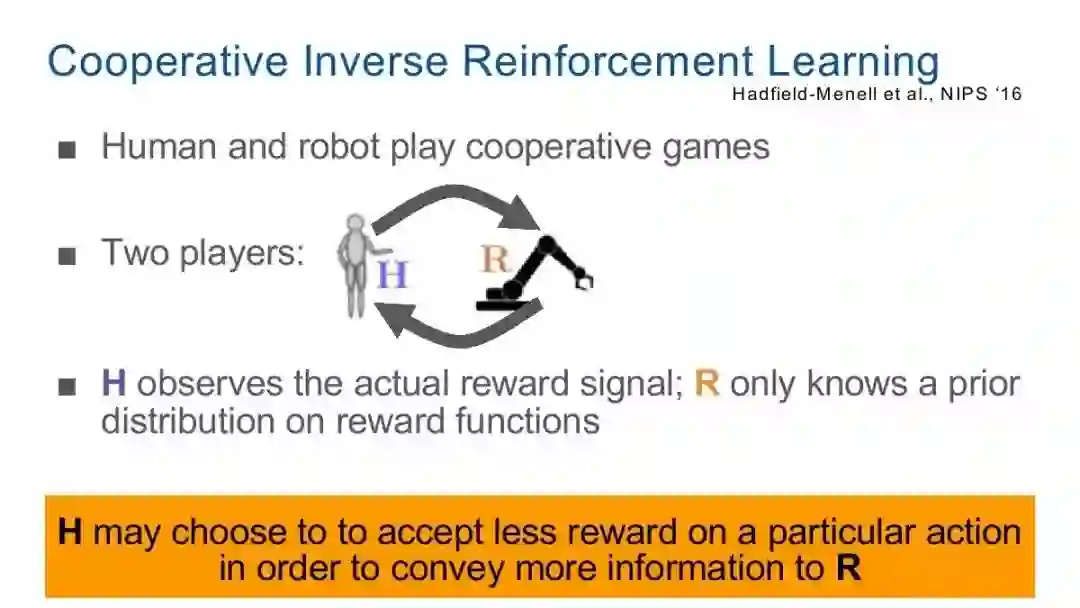

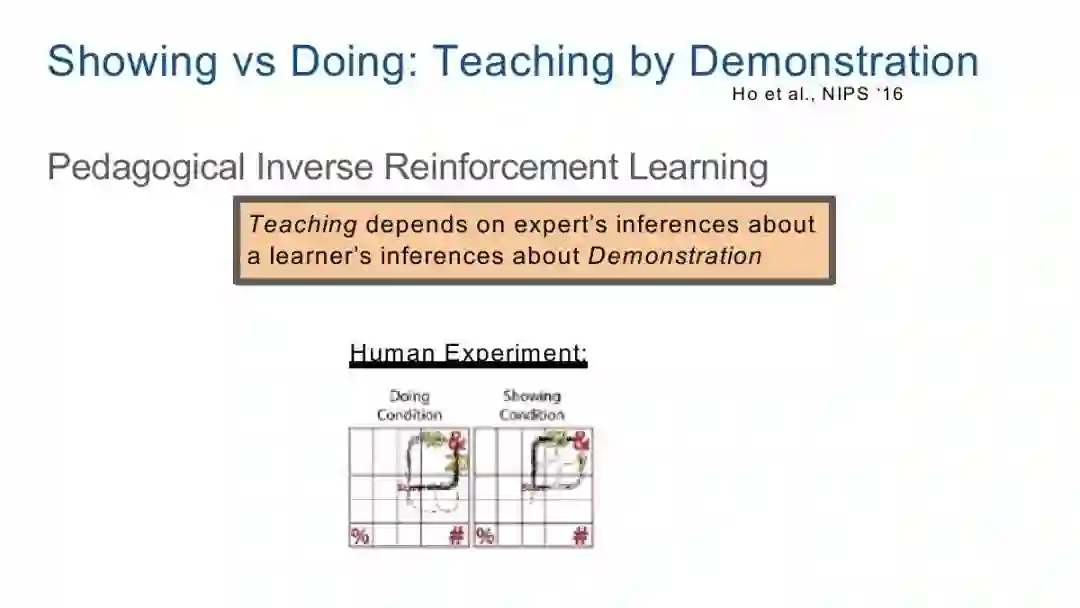

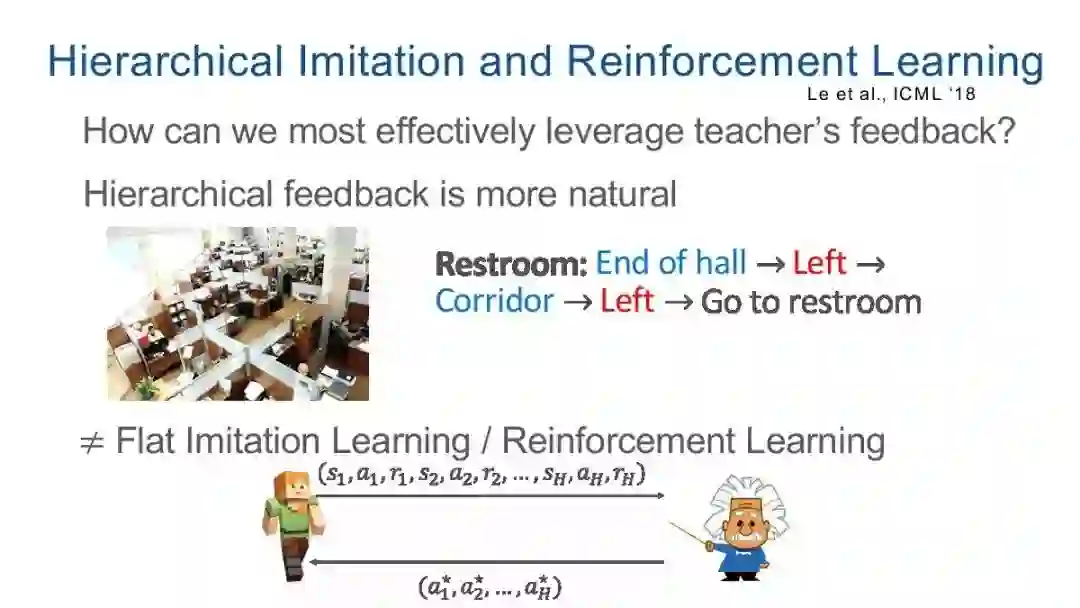

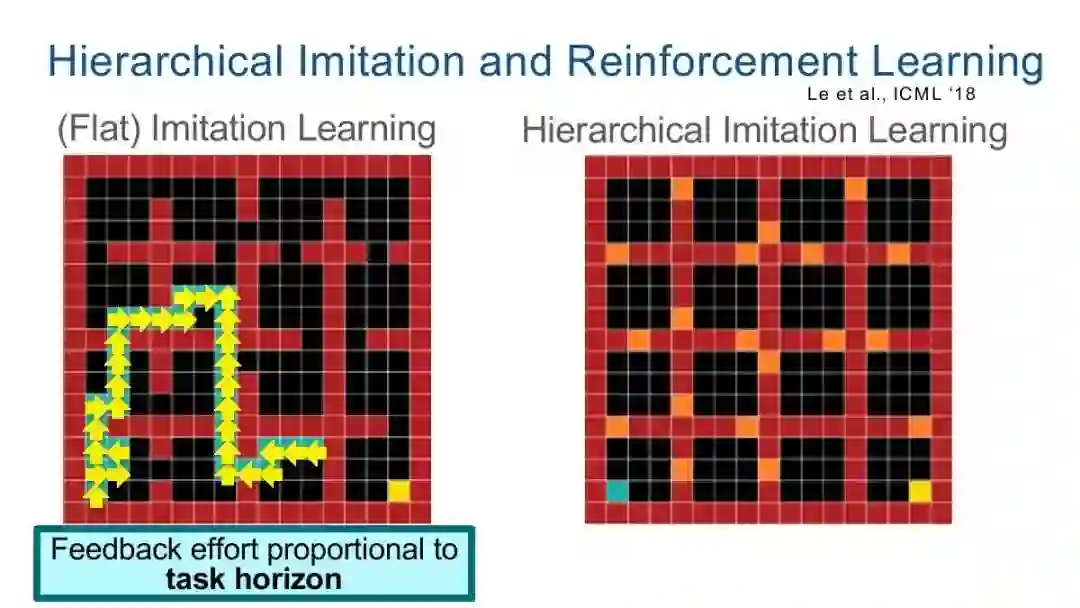

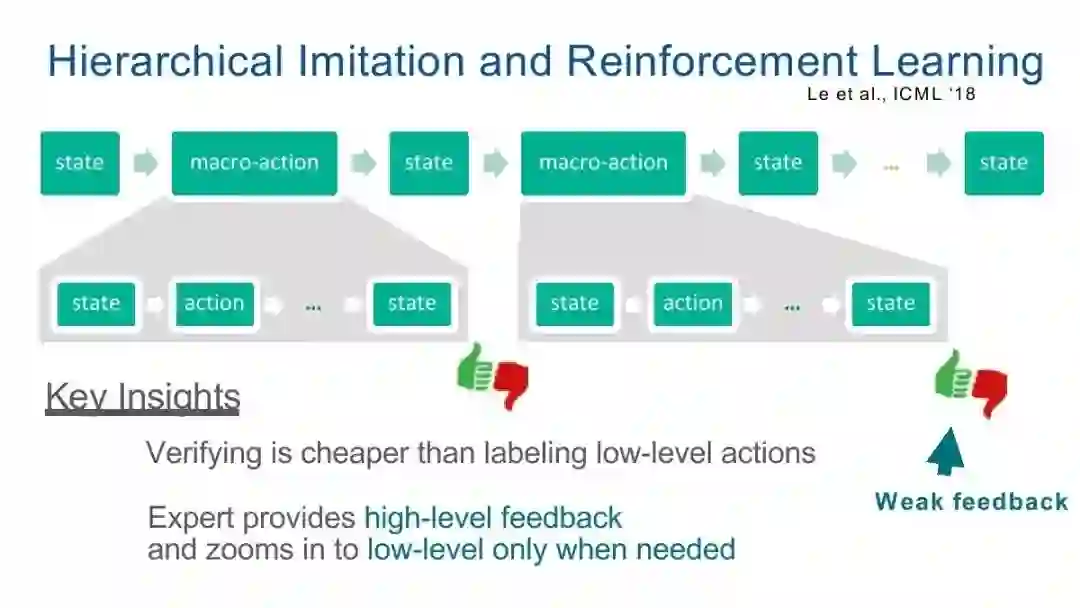

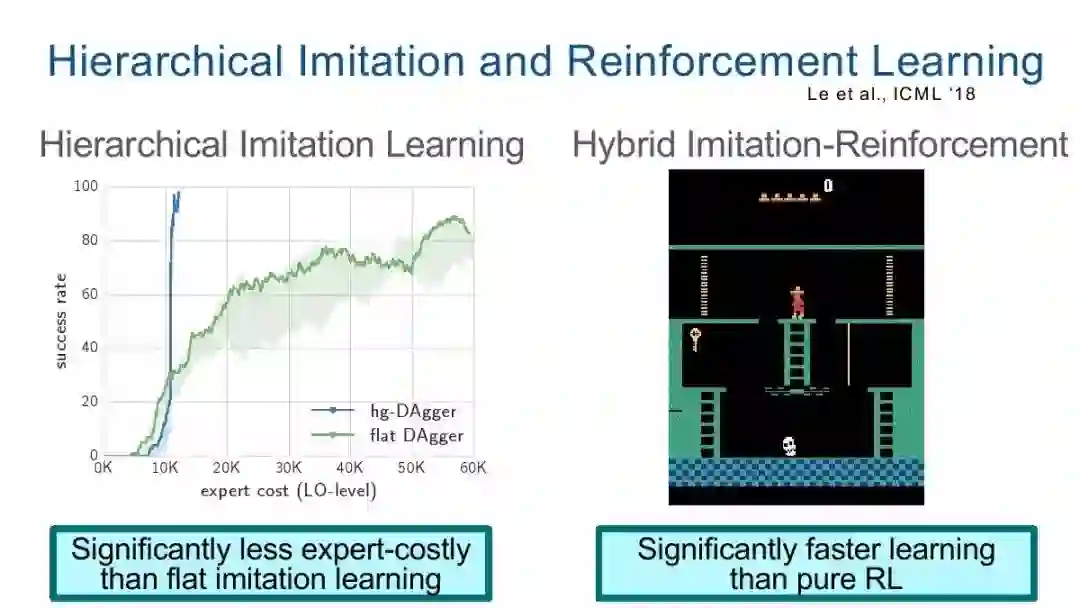

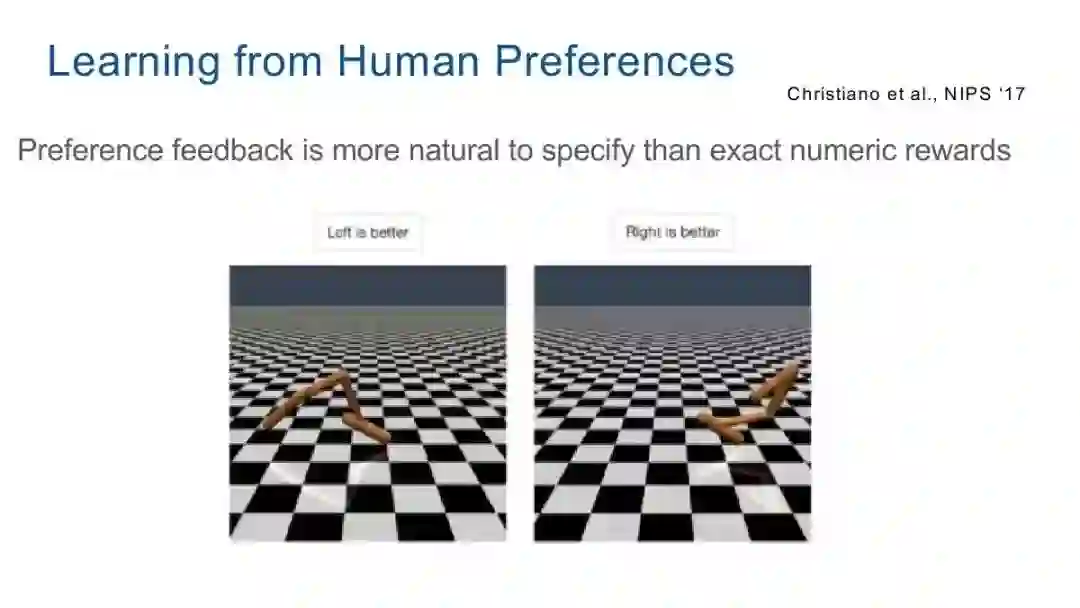

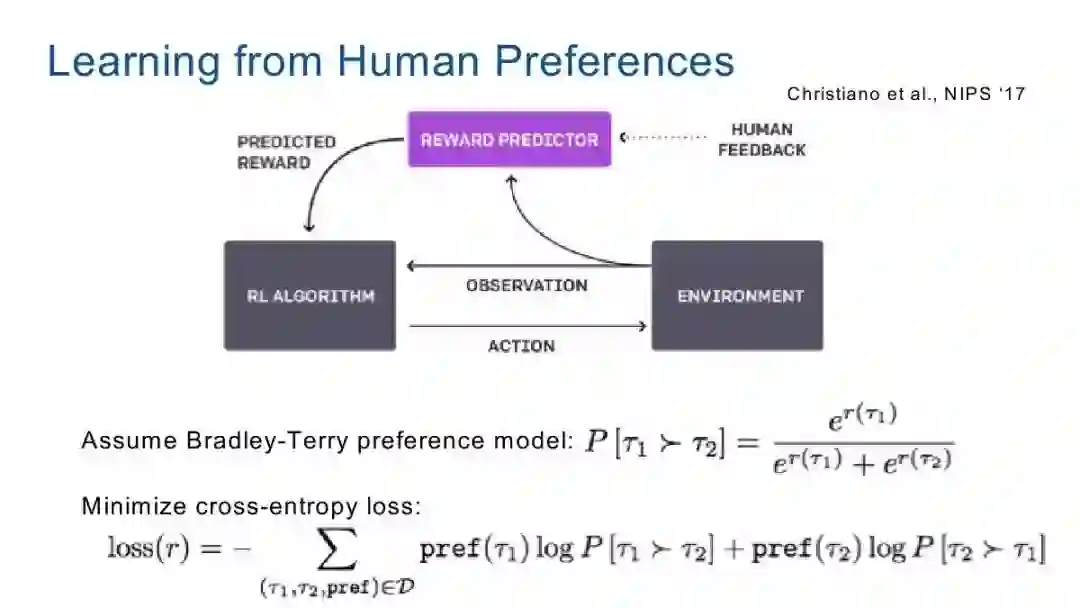

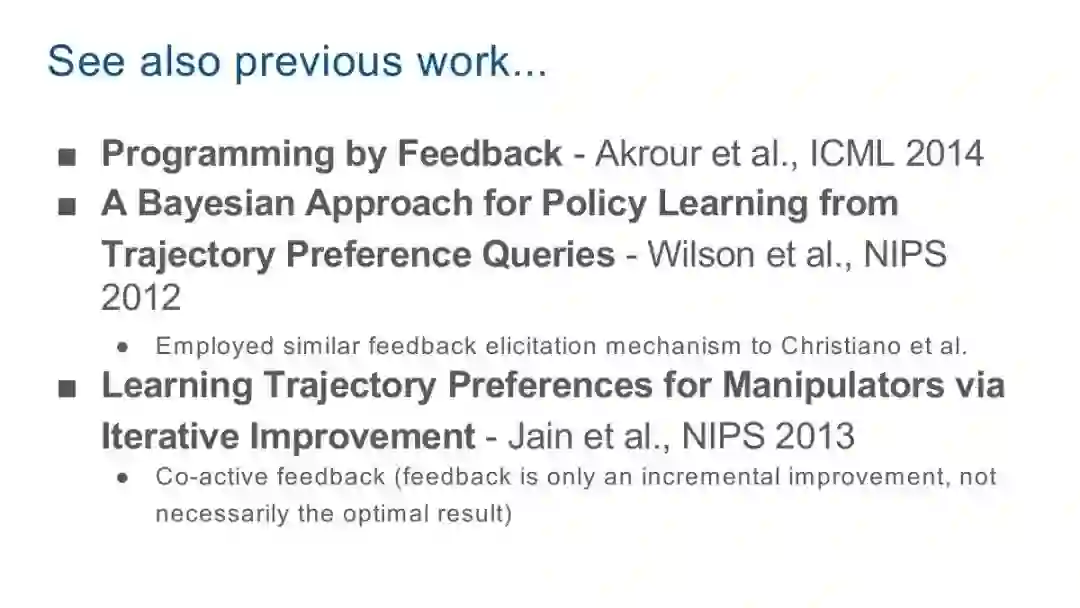

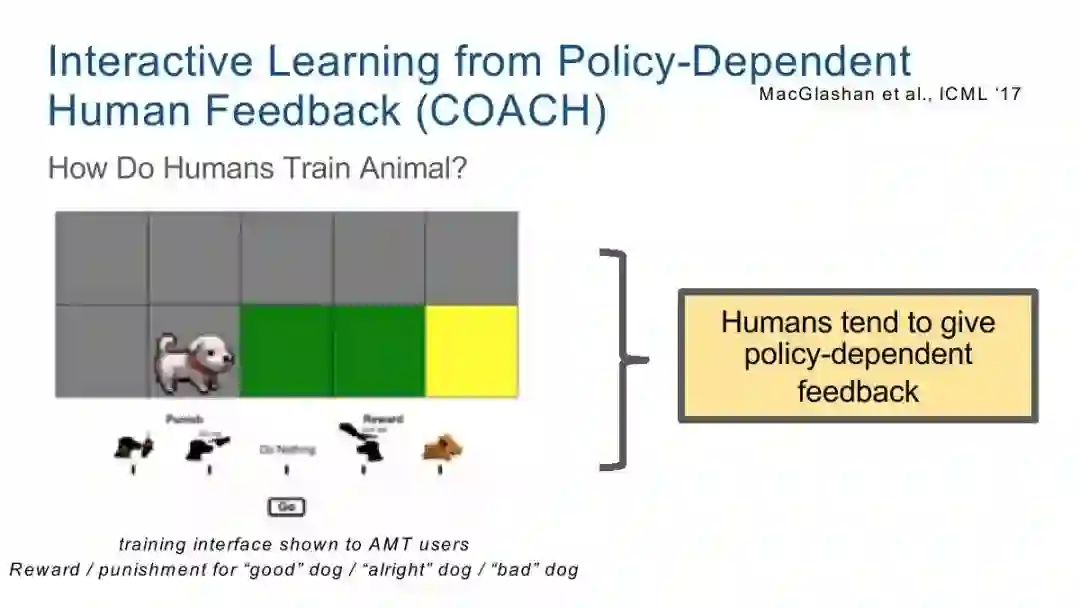

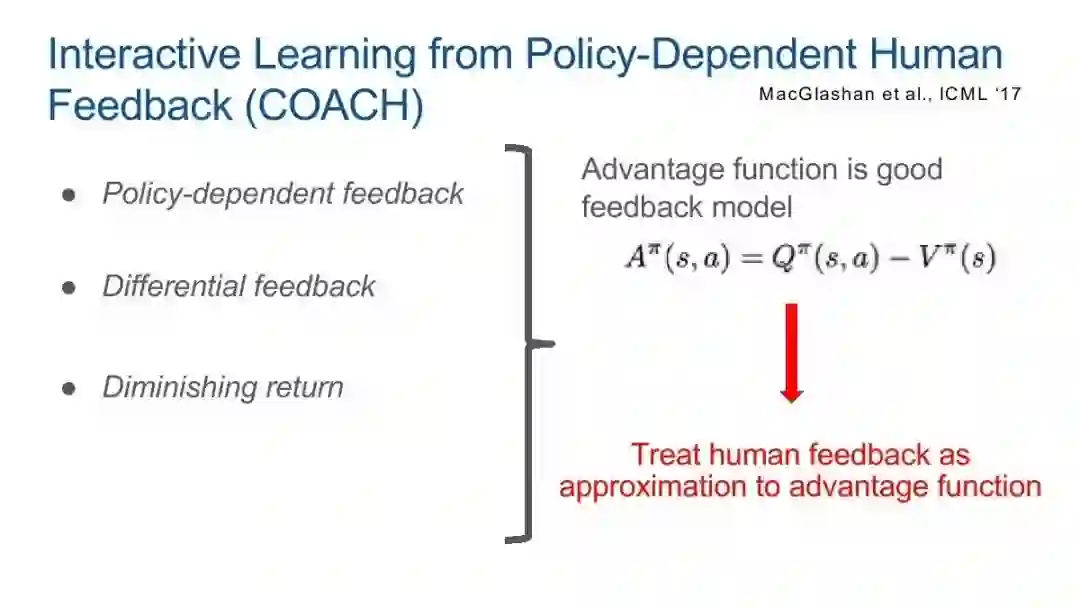

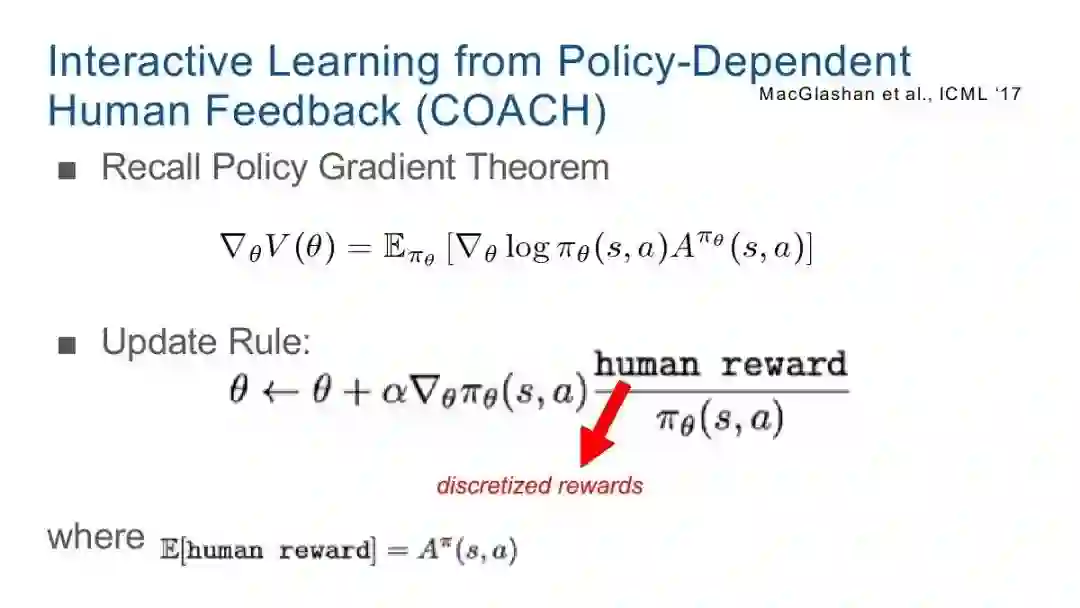

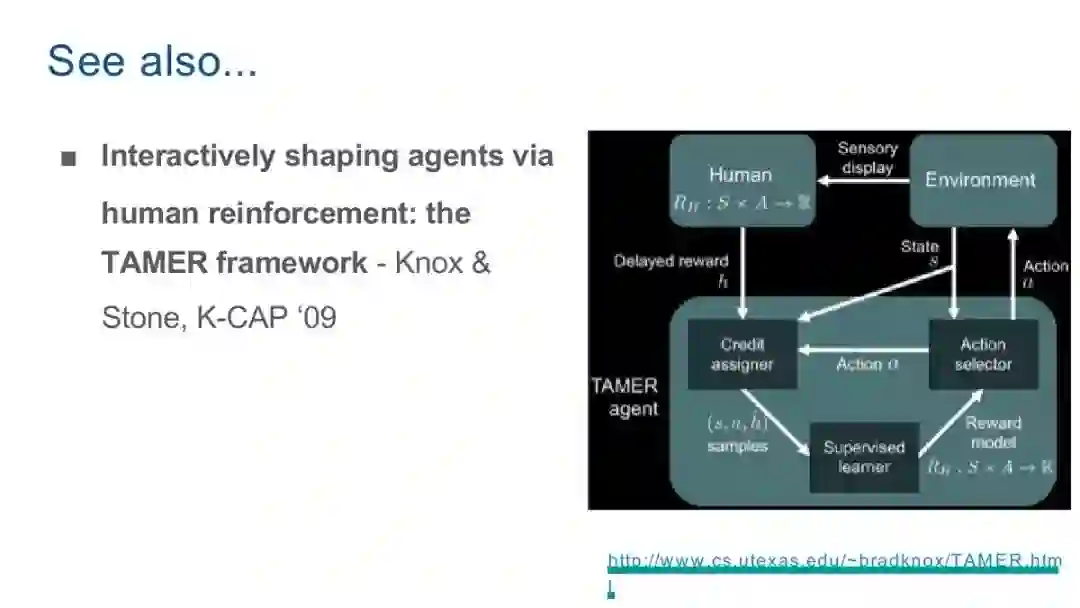

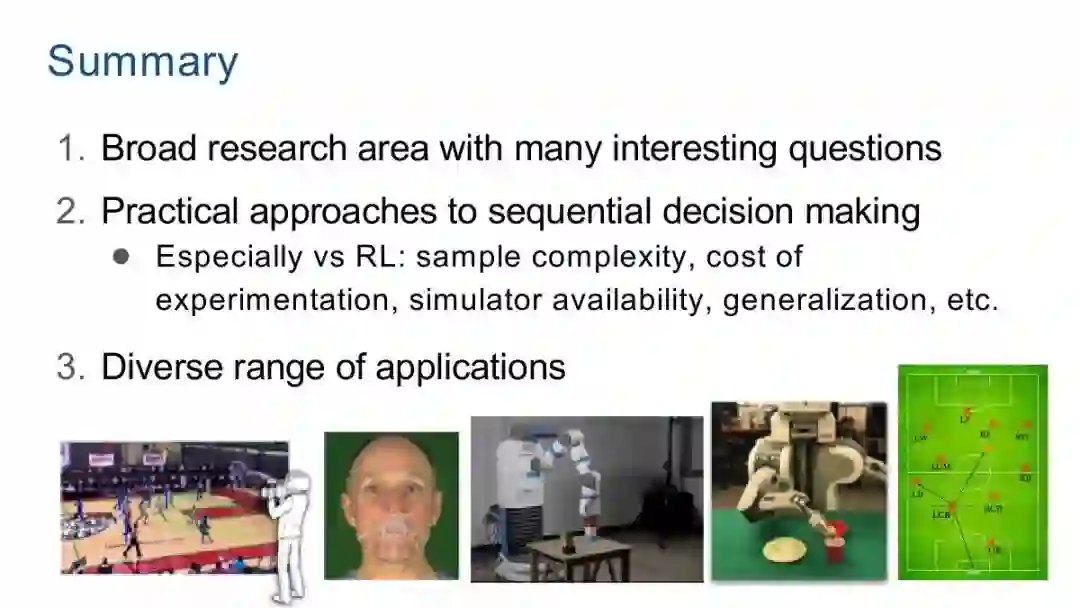

在传统的强化学习任务中,通常通过计算累积奖赏来学习最优策略(policy),这种方式简单直接,而且在可以获得较多训练数据的情况下有较好的表现。然而在多步决策(sequential decision)中,学习器不能频繁地得到奖励,且这种基于累积奖赏及学习方式存在非常巨大的搜索空间。而模仿学习(Imitation Learning)的方法经过多年的发展,已经能够很好地解决多步决策问题,在机器人、 NLP 等领域也有很多的应用。模仿学习是指从示教者提供的范例中学习,一般提供人类专家的决策数据每个决策包含状态和动作序列将所有「状态-动作对」抽取出来构造新的集合.

https://sites.google.com/view/icml2018-imitation-learning/

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“IL” 就可以获取149页模仿学习PPT下载链接~

附PPT原文

请关注专知公众号(扫一扫最下面专知二维码,或者点击上方蓝色专知),

后台回复“KGTIR” 就可以获取222页基于知识图谱的文本信息检索PPT下载链接~

-END-

专 · 知

人工智能领域主题知识资料查看与加入专知人工智能服务群:

【专知AI服务计划】专知AI知识技术服务会员群加入与人工智能领域26个主题知识资料全集获取。欢迎微信扫一扫加入专知人工智能知识星球群,获取专业知识教程视频资料和与专家交流咨询!

请PC登录www.zhuanzhi.ai或者点击阅读原文,注册登录专知,获取更多AI知识资料!

请加专知小助手微信(扫一扫如下二维码添加),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG等)交流~

请关注专知公众号,获取人工智能的专业知识!

点击“阅读原文”,使用专知