重建脑科学与AI之间的桥梁,人工神经网络比机器学习更优吗?

几十年来,神经科学在人工智能的研究历程中起到了举足轻重的作用,人工智能的奠基人 Donald Hebb、Warren McCulloch、Marvin Minsky 和 Geoff Hinton 最初的研究动力均源自对他们大脑工作机理的浓厚兴趣,当时的研究人员也一直试图模仿大脑的功能,构建神经科学与人工智能之间的桥梁。

1943 年,美国神经科学家麦卡洛克(Warren McCulloch)和逻辑学家皮茨(Water Pitts)在 “A Logical Calculus of Ideas Immanent in Nervous Activity” 一文中提出了神经元的数学模型,受人体大脑神经元的启发,机器学习领域早期的重要算法 —— 人工神经网络(Artificial Neural Networks)得以发展。

1949 年,加拿大神经心理学家 Donald Hebb 在《The Organization of Behavior》一书中首次提出的赫布理论,解释了在学习过程中大脑神经元所发生的变化,这一理论为后期机器学习的研究提供了理论支撑。Hebb 提出学习是通过大脑中突触强度的改变而进行的,一个突触强度的改变通常持续数十分钟,而一个神经元(节点)的时钟速度大约为一秒。

然而,从那以后,实验神经科学并没有直接推动机器学习领域的发展,这两门学科似乎都是独立发展的。

4 月 23 日,巴伊兰大学物理系和 Gonda(Goldschmied)多学科脑研究中心的 Ido Kanter 教授等人在《科学报告》杂志上发表了一项最新研究成果,成功地在实验神经科学和高级人工智能学习算法之间重建桥梁。

研究人员根据 Hebb 的理论,通过一项新的神经元培养实验,成功展示了一种受大脑启发的人工神经网络学习机制。该机制被用于手写数字识别时,其成功率大大超过了传统的机器学习算法。

Ido Kanter 教授说:"我们大脑中的一个学习步骤被认为通常会持续几十分钟甚至更久,而在计算机中,它的学习时间一般为纳秒级。虽然大脑的速度极慢,但其计算能力却超过了最先进的人工智能算法,或者说可以与之相媲美,“

为了重建这一桥梁,研究人员最初作出两个假设:

-

通常认为大脑学习是极其缓慢的假设可能是错误的; -

大脑的动力学系统可能包括加速学习机制。

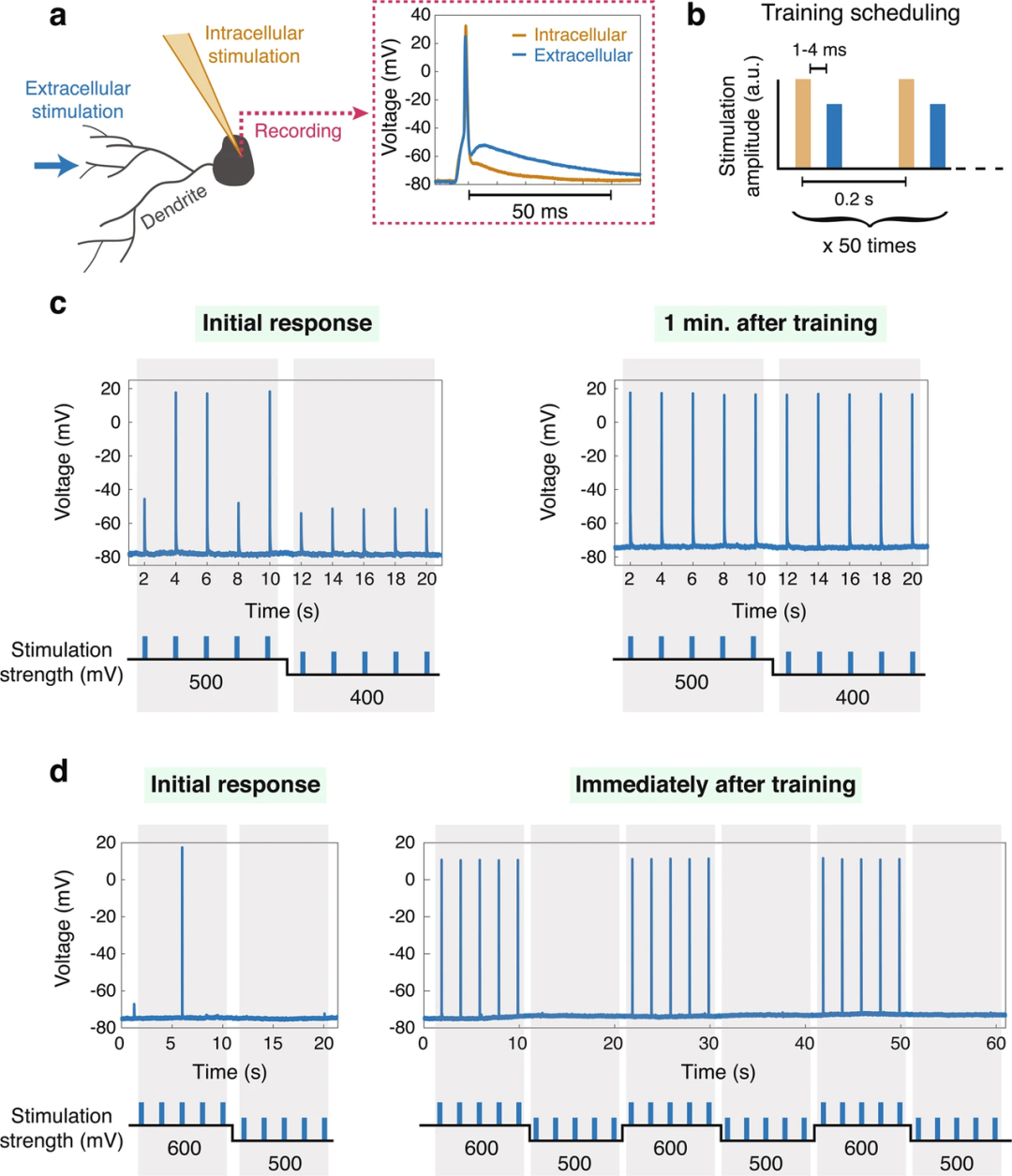

研究人员采用机械和酶解程序在新生大鼠(Sprague-Dawley)出生后 48 h 内获得其皮层神经元,作为培养对象。实验是在培养的皮层神经元上进行的,这些神经元通过谷氨酸能和氨基丁酸能突触的药理阻断而从它们的网络中分离出来的。

所有实验流程均按照美国国立卫生研究院的《实验室动物护理和使用指南》和巴伊兰大学的《实验室动物护理和使用研究指南》进行,并得到巴伊兰大学动物护理和使用委员会的批准和监督。

这项研究中,研究人员使用 5Hz 的刺激频率,对树突的适应性进行了实验研究,训练模式选取 0.5Hz-1Hz。将神经元培养物置于添加了突触阻滞剂的多电极阵列上,突触阻滞剂从细胞外通过树突刺激一个修补过的神经元。适应过程包括一套 50 对刺激的训练集。经过阈值以上的细胞内刺激后,细胞外刺激没有达到预定的 1-4ms 的延迟。研究人员主要考虑了两个独立的树突状细胞激活神经元时,不同的细胞内外的波峰波形。

论文第一作者 Shira Sardi 表示:"通过在一秒钟内观察 10 次相同的图像进行学习,其效果不亚于在一个月内观察 1000 次相同的图像。重复相同的图像能迅速增强我们大脑中的适应性,使我们的大脑在几秒钟而不是几十分钟内就能适应。有可能我们大脑中的学习速度更快,但超出了我们目前的实验限制。“

这项研究的另一位作者 Roni Vardi 博士补充道, 利用这种新发现的、受大脑启发的加速学习机制,大大超过了常用的机器学习算法。 如对于手写数字识别,特别是在提供小数据集进行训练的情况下,利用这种新发现的、受大脑启发的加速学习机制,大大超过了常用的机器学习算法的运算速度。

参考资料:

https://www.eurekalert.org/pub_releases/2020-04/bu-rrt042020.php

https://www.nature.com/articles/s41598-020-63755-5

【3D视觉】:《3D视觉技术白皮书》

点击阅读原文,查看更多精彩!