题目: 对抗机器学习与对抗视觉

报告人: 韩亚洪 教授 天津大学

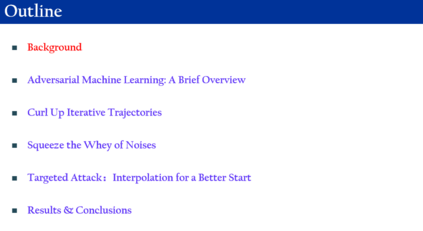

摘要: 随着深度学习方法的广泛应用,深度神经网络的脆弱性和抗攻击能力、以及由此带来的模型鲁棒性和安全性开始引起关注。对抗机器学习通过构建对抗样本来探测机器学习方法的脆弱性,即机器学习模型是否真正学习到了正确性概念,以及该模型在何种情况下失效。本报告介绍对抗机器学习的基本理论、方法和分类、对抗机器学习与人工智能安全、深度神经网络黑盒对抗攻击的最新模型和方法,并对其在对抗视觉上的应用进行讨论。

成为VIP会员查看完整内容

相关内容

专知会员服务

29+阅读 · 2019年11月18日