![]()

作者 | 高天宇

编辑 | Camel

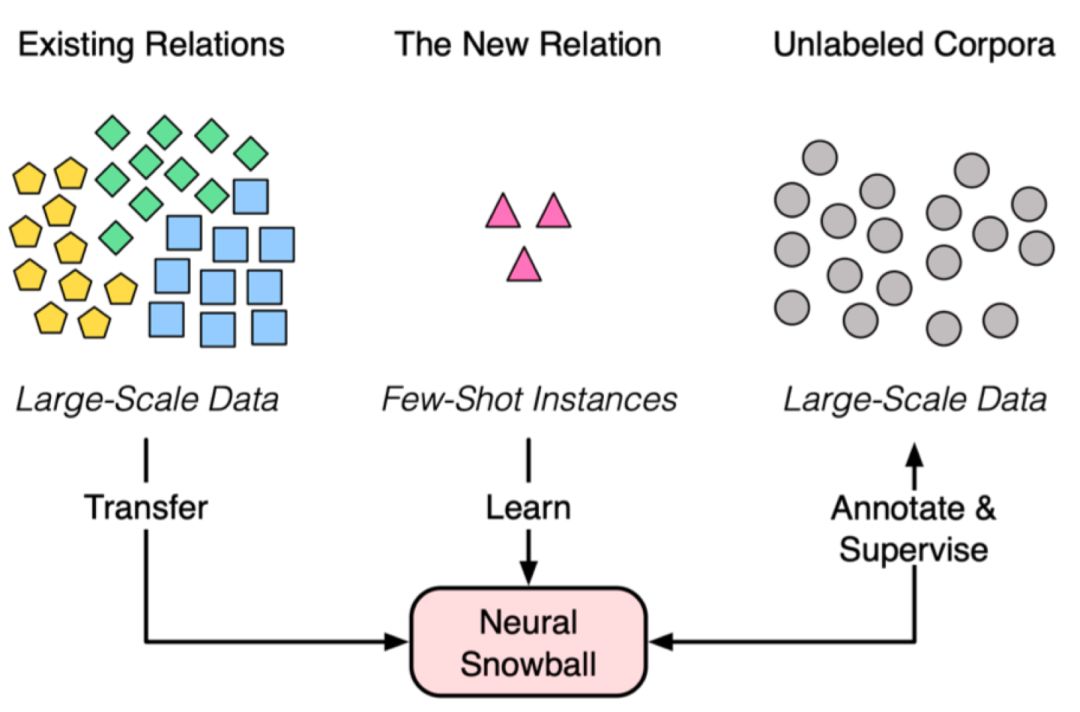

本文对清华大学孙茂松、刘知远团队完成、被 AAAI-20 录用的论文《Neural Snowball for Few-Shot Relation Learning》进行解读。目前的关系抽取,面临着开放式的关系增长问题,目前已有有监督、半监督、少次学习和自启动关系抽取,这些方法涉及到了三种类型的数据:在已有关系类型上的大规模监督数据,对于新关系的少量标注数据,以及大规模的无监督数据。高天宇等人提出Neural Snowball,充分利用了这三种数据,进行关系抽取。

![]()

论文:https://arxiv.org/abs/1908.11007

开源代码:https://github.com/thunlp/Neural-Snowball

论文简介:

关系抽取(Relation Extraction)是自然语言处理当中的一个重要研究课题,

其探究如何从文本中抽取结构化的关系事实

。例如,从句子“比尔盖茨是微软的创始人”中,我们可以抽取出(比尔盖茨,创始人,微软)这样一个关系三元组,并用于知识图谱补全等下游任务中。

与关系抽取相关的工作有很多,但他们大多针对预定义的关系类型,即给定一个人为定义好的关系集合,在抽取时仅考虑集合内的关系类型。然而,

我们面临着开放式的关系增长,随着新领域、新知识的出现,关系类型也在不断增多。因此,我们需要能够应对关系增长的关系抽取模型。

目前的研究当中,主要有以下几种关系抽取的场景,他们所针对的关系类型和利用的数据都有所不同:

有监督的关系抽取(Supervised Relation Extraction)

:其针对预定义的关系集合,使用大规模的监督数据。

半监督的关系抽取(Semi-Supervised Relation Extraction)

:其针对的也是预定义的关系集合,希望使用相对较少的监督数据,在大量无监督数据的帮助下,能够取得与有监督关系抽取类似的效果。

少次学习关系抽取(Few-Shot Relation Extraction)

:其针对的新的(没见过的)关系类型,通过在已有关系类型上的大规模数据预先训练,再快速迁移到新关系类型的少量数据上,达到少次学习的目的。

自启动关系抽取(Bootstrapping Relation Extraction)

:其面向的也是开放的关系场景,对于新的关系类型,仅给定少量的启动样本,以迭代的方式从大规模的数据中挖掘更多的信息,从而得到更加强大的关系抽取模型。

从上面的分析中可以看出,这些方法涉及到了三种类型的数据:在已有关系类型上的大规模监督数据,对于新关系的少量标注数据,以及大规模的无监督数据。我们希望能够充分的利用这三种数据:

如上图所示,Neural Snowball通过在已有关系上的大规模数据上训练距离度量(下文中会有详细阐述),迁移到新的关系类型上,利用新关系的少量数据作为启动种子,从大规模的无监督数据中挖掘有用信息,挖掘越多的有用信息,我们就能得到越好的关系抽取模型。

(或者到AI研习社官网观看更多AAAI 2020 论文解读视频:http://www.mooc.ai/open?from=meeting)

文字版解读:清华大学:用于少次关系学习的神经网络雪球机制

关注「AI科技评论」微信公众号,后台回复「高天宇@AAAI2020」下载讲解 PPT。

作者简介:

![]()

高天宇,清华大学本科四年级学生,清华大学自然语言处理实验室成员,导师刘知远。其主要研究方向为自然语言处理当中的关系抽取问题,在人工智能和自然语言处理领域的国际会议AAAI、EMNLP上发表过多篇文章。同时他也是开源工具包OpenNRE的主要作者。

更多AAAI 2020信息,将在「AAAI 2020 交流群」中进行,加群方式:添加AI研习社顶会小助手(AIyanxishe2),备注「AAAI」,邀请入群。

![]()

AAAI 2020 论文解读系列:

13. [中科院自动化所] 通过解纠缠模型探测语义和语法的大脑表征机制

14. [中科院自动化所] 多模态基准指导的生成式多模态自动文摘

15. [南京大学] 利用多头注意力机制生成多样性翻译

16. [UCSB 王威廉组] 零样本学习,来扩充知识图谱(视频解读)

17. [上海交大] 基于图像查询的视频检索,代码已开源!

18. [奥卢大学] 基于 NAS 的 GCN 网络设计(视频解读)

19. [中科大] 智能教育系统中的神经认知诊断,从数据中学习交互函数

20. [北京大学] 图卷积中的多阶段自监督学习算法

29. [中山大学] 基于树状结构策略的渐进强化学习

30. [东北大学] 基于联合表示的神经机器翻译(视频解读)

31.[计算所] 引入评估模块,提升机器翻译流畅度和忠实度(视频解读)

![]()

![]()

![]()

![]() 点击“阅读原文” 前往 AAAI 2020 专题页

点击“阅读原文” 前往 AAAI 2020 专题页