AI 鉴黄 | 沙漠是黄色,但不是真的“黄色”

近日,美国知名科技博客Gizmodo报道了一则新闻,英国警察想用人工智能技术来发现和识别互联网上的色情内容,但是总把沙漠的照片误认为是裸体。

Gizmodo报道:英国警察想用AI监控色情

但总是把沙漠照片误认是裸体

文章介绍说,伦敦警方借助AI技术已经对毒品、枪支和钱币等物品实现了有效的识别,但面对裸露图片时,依然不太可靠。有时一个沙漠的图片,就可能被图像识别软件认为是色情的。互联网上很多人有在沙漠中的照片,往往会被不太可靠的AI技术认为是肤色。

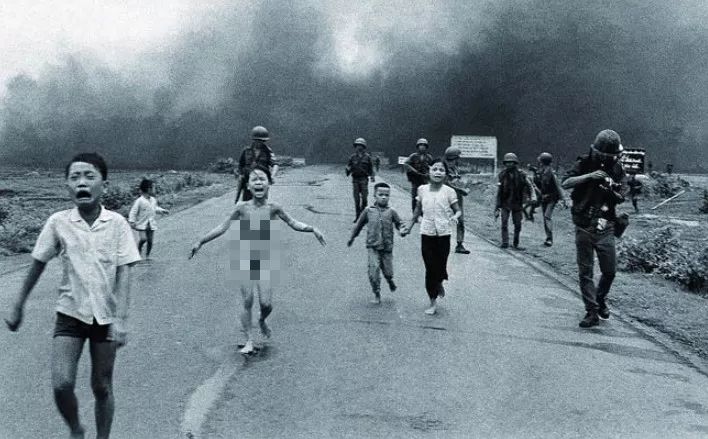

此外,伦敦警方也在帮助美国硅谷的合作伙伴培训人工智能算法理解和识别儿童色情、儿童虐待的图像。此前,Facebook上一张全身赤裸的小女孩在越南战争中逃离汽油弹袭击的照片被AI算法标记出来,随即被管理员删除,而这张照片正是1973年荣获普利策奖的《火从天降》,后来Facebook恢复了这张照片并承认这并不是儿童色情。

1973年荣获普利策奖的《火从天降》

(图片来源网络,敏感部位做了处理)

尽管小女孩全身裸露,但没有人会觉得这张反映战争残酷的照片会有一丝色情的味道,这说明机器还缺乏理解人类细微差别的能力,也不太了解儿童裸体形象的严重性和具体语境。

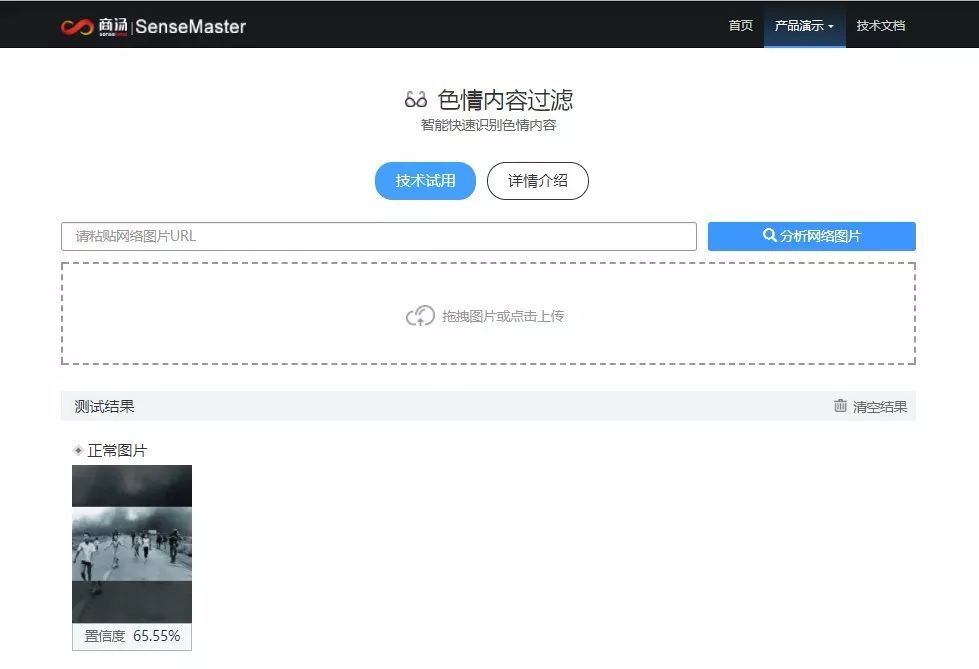

但是,就像你不能小瞧小孩子的创造力一样,你不能想当然的认为人工智能技术还停留在“此前”,AI技术的快速迭代让人工智能技术每天都获得飞跃式的进步,能够识别更多,也能够感知更多。目前,商汤科技SenseMaster技术方案,已经能够理解出《火从天降》这张图片里所要表述的东西,并且可以灵活地结合具体背景和聚焦点给出判断:当画面是一个整体呈现时,人们看到的更多是一个悲惨和惊恐的情景;但是当你把注意力更多地聚焦在小女孩裸露的身体上时,整个画面的事件背景就被忽略了,此时只会看到儿童裸体。

全景照片测试

SenseMaster判定《火从天降》为正常图片

当画面重点更多地放大女孩身体时,正常图片的置信度会产生下降;而当画面没有背景,完全聚焦在女孩身上时SenseMaster判定为色情图片(敏感部位做了处理)

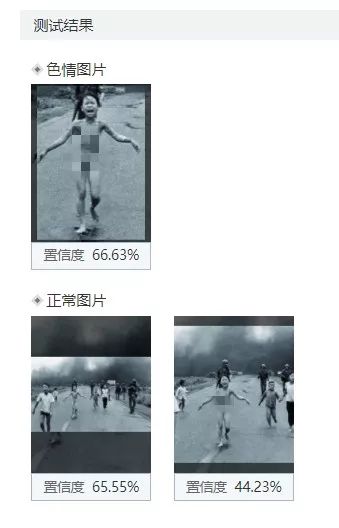

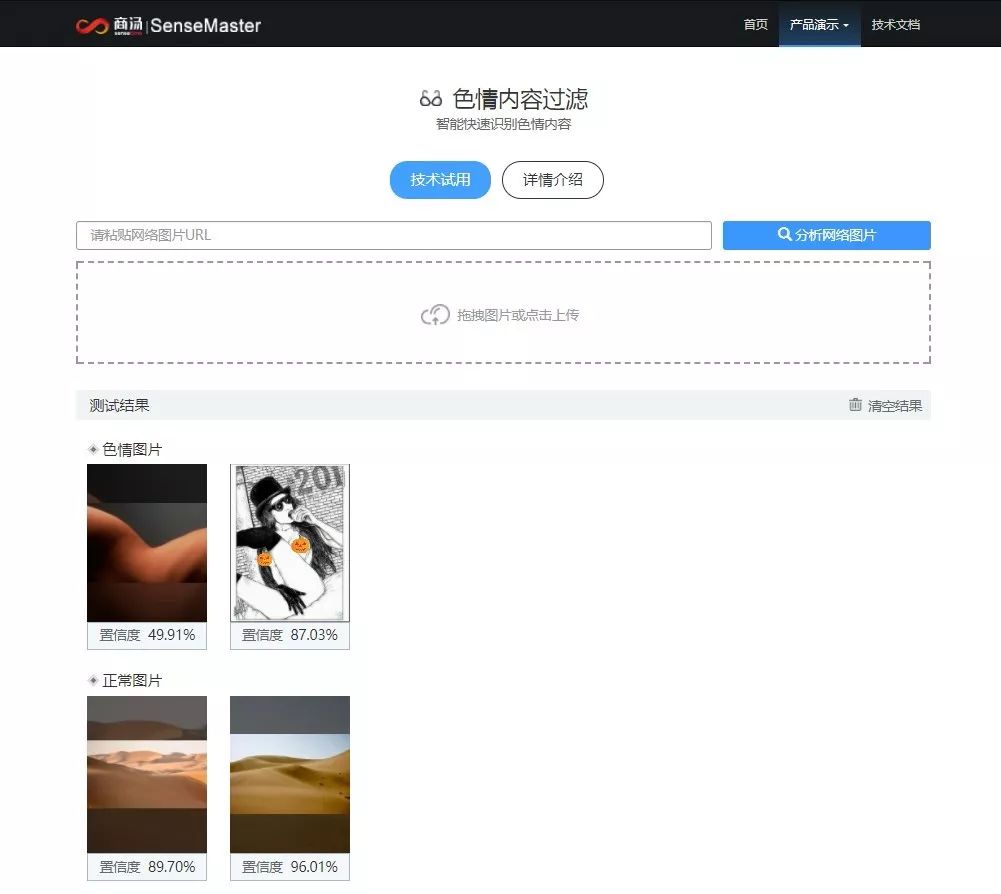

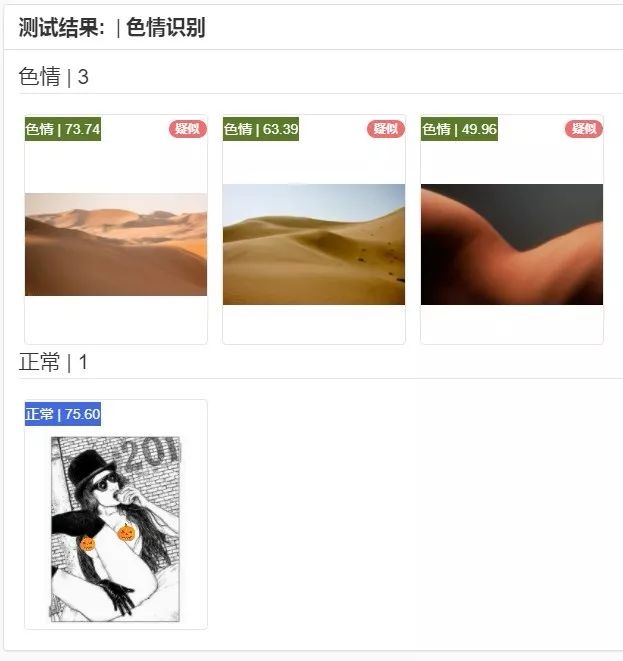

通过上面的测试,已经明确商汤SenseMaster不会犯Facebook那样的错误。那么回到开始的问题,中国的人工智能技术能解决沙漠照片和裸体照片误识的问题吗?毕竟这是英国警方和美国硅谷的合作伙伴都一直没能很好解决的难题。

SenseMaster识别网络图片,内容过滤

(测试图片来源网络,敏感信息做了处理)

再来看看其他图像识别开放测试平台的结果。

这个平台将沙漠识别成色情,真色情居然识别成正常,并且置信度高达90.48%。

这个平台判定沙漠完全变成了色情,真正的色情图片也并没有识别出来。

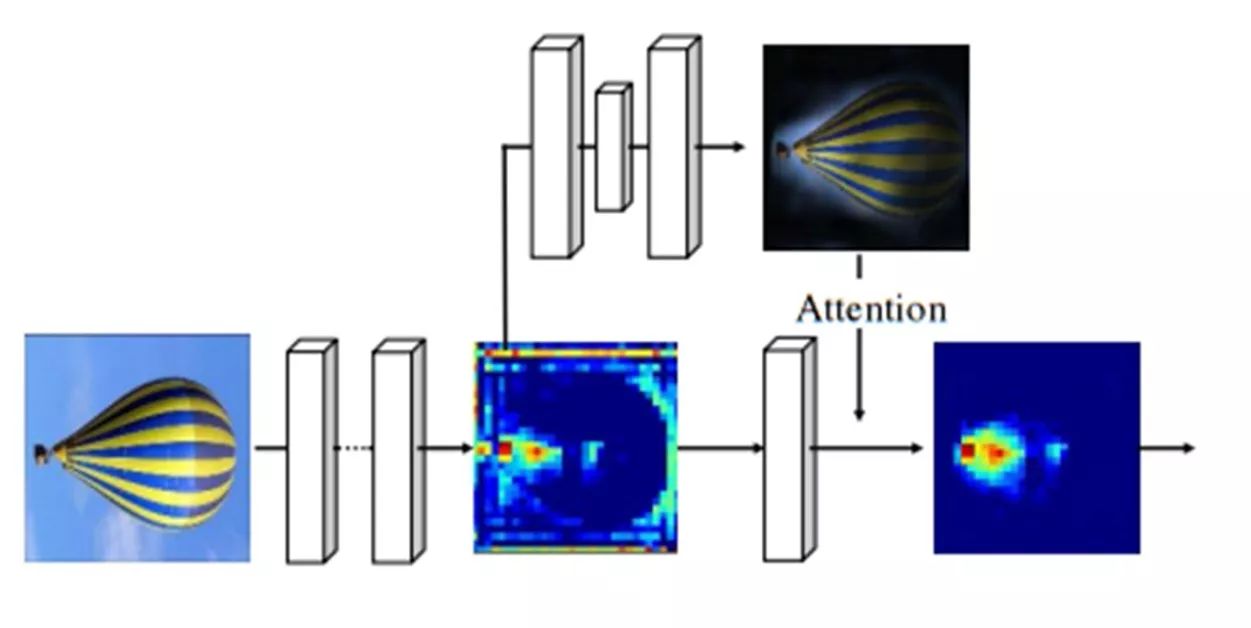

可以看到,在上面的几个测试中,商汤SenseMaster技术方案有很大优势,准确率很高。这一方面得益于商汤科技利用深度神经网络,在十亿级图片库中进行的大规模训练,另一方面则是商汤在使用深度学习来训练模型时引入了注意力机制(Attention Model)。

视觉注意力机制是人类视觉所特有的大脑信号处理机制,也是人类得以快速通过视觉认知事物最基本的技能。人类视觉通过快速扫描全局图像获得需要关注的目标区域,而后重点获取所需关注的目标信息,并抑制其他无用信息,进而做到快速识别和理解图像所要表达的核心内容。在很多和时序相关的进程中,人类的注意力都不是一成不变的,随着进程发展,人类视觉的注意力会不断调整和改变。因此,引入人类视觉注意力机制,会极大提高视觉信息处理的效率与准确性,商汤自适应注意力模型可以大幅提高违规色情区域较小,或者屏幕翻拍等场景的精度。

如今,我国互联网用户规模世界第一,互联网内容和各种应用迅猛发展,同时网络不良信息的多元化趋势也已经非常明显,“校园裸贷”、“色情直播”、“色情网站”,这些甚至成为长期困扰公众的社会性问题。面对海量信息和丰富渠道,依靠人力解决已非常不现实,必须依靠AI技术实现自主监控、自主审核、自主过滤,才能实现对互联网的高效管理。目前,商汤SenseMaster公有云技术已在酷狗、探探等互联网社交和娱乐平台中实现了应用,帮助这些平台在海量用户内容中精准识别涉黄图片和各种敏感信息,极大降低人工审核成本。此外,SenseMater还能提供丰富的图像识别功能,比如服饰、logo、明星等,助力互联网和广电行业精准管理多媒体内容和精准推荐营销。商汤还为TCL研究院提供视频智能解析平台私有云技术,提高用户体验,增强与用户的互动,加速智能电视成为下一个流量入口的发展过程。

如有拿捏不准的图片

不知道网络照片有没有“过界”

可以来这里上传试一下哦!

SenseMaster公有云体验进入

http://master.sensetime.com