AI听 | Hinton:反向传播要被彻底放弃了!游戏商Unity推出 ML 训练环境,24分钟训练ImageNet……

本文转载自「AI研习社」,搜索「okweiwu」即可关注

主播 | 吴璇

选题 | 徐普 程炜 Heo

本周关键词

反向传播|Machine Learning Agents

ImageNet|信息瓶颈

▼点击可听

\ 这里有你想知道的本周 AI 大事件 /

· 深度学习可能要彻底放弃反向传播

· Unity推出Machine Learning Agents

· 24分钟训练完ImageNet创纪录

· “信息瓶颈”理论揭示深度学习本质,Hinton说他要看1万遍

NO/1 Geffory Hinton:深度学习可能要彻底放弃反向传播

据科技媒体Axios报道,上周三在多伦多举行的一个AI会议上Hinton表示,他现在对反向传播算法“深感怀疑”。

反向传播是用来训练人工神经网络的常见方法,该方法计算对网络中所有权重计算损失函数的梯度。这个梯度会反馈给最优化方法,用来更新权值以最小化损失函数。值得一提的是,Hinton本人是反向传播算法的早期提出者,1986年,Hinton在一篇论文中首次将反向传播算法引入多层神经网络训练。

尽管在这次会议上,不少参会的科学家表示在人工智能的未来反向传播仍处于核心地位,但Hinton的发言一锤定音:可能会有全新的方法推出。Hinton在现场引用普朗克的名言称:“Max Planck 曾说:‘科学之道,不破不立。’未来取决于对我所说的一切持怀疑态度的那些研究生。”他还表示,如果要让深神经网络变得更聪明,即向无监督学习过渡,“这可能意味着要彻底放弃反向传播。”

这一观点在Twitter上引起了广泛讨论,Pedro Domingos、李飞飞等多人纷纷转发。在李飞飞转发的Twitter上,雷锋网注意到,前几天的“few tools lives enternity”已经悄然变成了“no tool is eternal”,Hinton这一观点对AI研究者的震撼之大可见一斑。(来源:雷锋网)

NO/2 打造AI训练基础平台!Unity推出Machine Learning Agents

全球最大的3D游戏引擎Unity宣布发布Unity Machine Learning Agents,通过将其游戏引擎与TensorFlow等机器学习框架相连接,游戏中的NPC有望通过机器学习的方式变得更有策略性,从而增加游戏的对 抗性和可玩性。

目前Unity已经发布了测试版ML-Agent SDK。ML-Agents SDK可以让研究人员和开发人员将使用Unity Editor所创建的游戏和模拟场景转换为可以使用Python API,通过深度增强学习等机器学习方法对智能代理进行训练的环境。对Unity的ML-Agent SDK感兴趣的开发者,可以访问其Github页面获得更详细的消息。(来源:雷锋网)

NO/3 24分钟训练完ImageNet创纪录

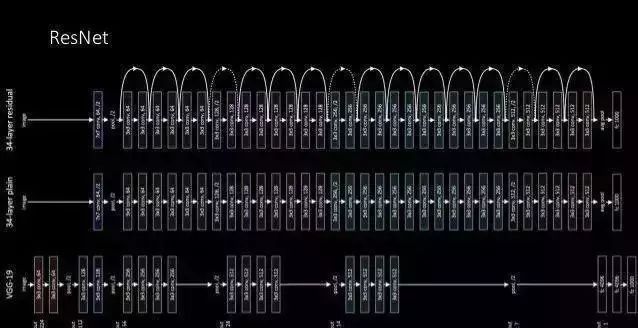

今年 6 月,Facebook研究人员使用256块GPU在1小时内训练完ImageNet,通过增加批量大小以加快并行训练速度的方式引发了人们的关注。现在,这项纪录被刷新:伯克利、TACC和UC戴维斯的研究人员使用新算法,在24分钟内训练完ImageNet的Alex模型,创下新的世界纪录。

同时,研究人员表示他们仅使用了120万美元的硬件(相比Facebook当时410万美元),也是使用ResNet-50在一小时内进行ImageNet训练迄今最低的预算,新的方法使用的计算设备成本(120 万美元)大大低于 Facebook(410 万美元)。(来源:新智元、机器之心)

NO/4 “信息瓶颈”理论揭示深度学习本质,Hinton说他要看1万遍

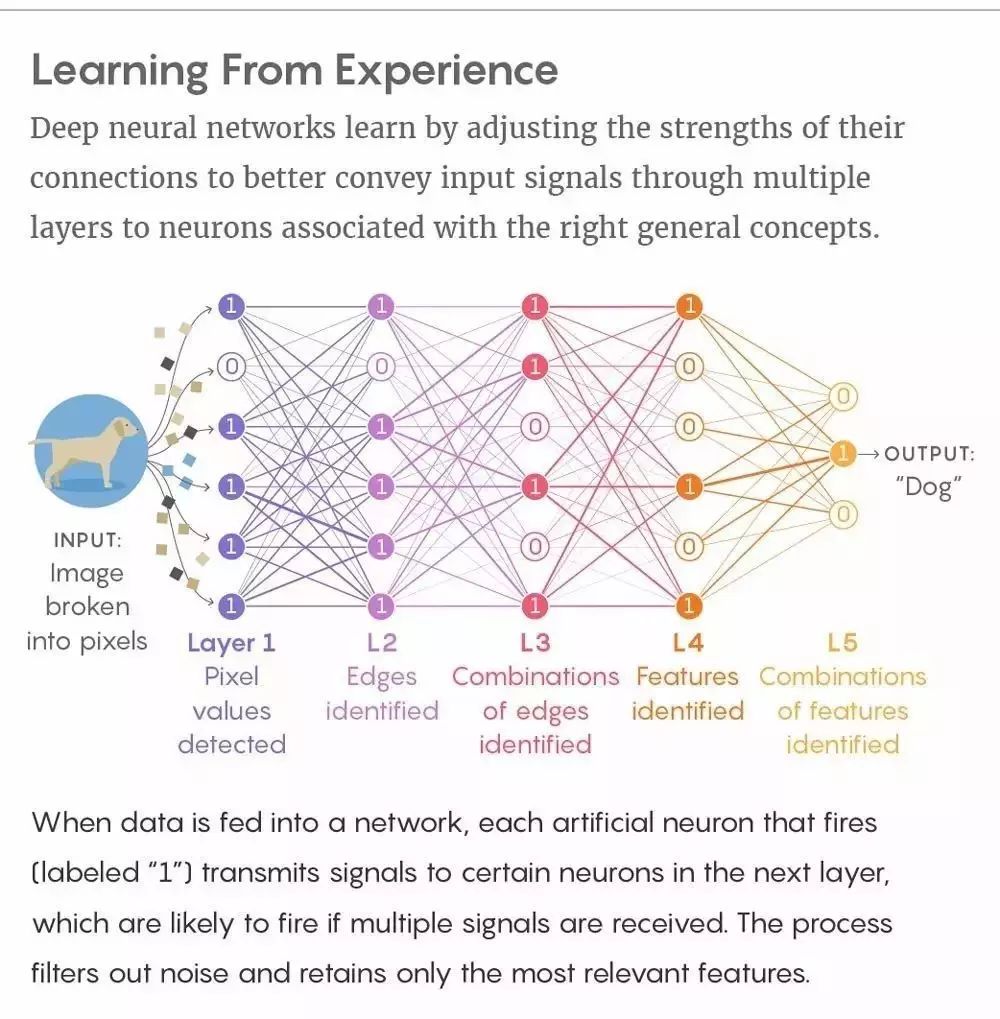

日前,希伯来大学的计算机科学家和神经学家 Naftail Tishby,提出了一种解释深度学习工作原理的新理论,并给出了证据支撑。Tishby认为,深度神经网络根据一种被称为“信息瓶颈”的过程在学习。

信息瓶颈理论认为,网络像把信息从一个瓶颈中挤压出去一般,去除掉那些含有无关细节的噪音输入数据,只保留与通用概念(general concept)最相关的特征。Tishby和他的学生在最新实验,展示了深度学习过程中这种“挤压”是如何发生的。(至少在他们所研究的案例里)

Naftali Tishby在柏林的演讲《深度学习:理论、算法和应用》,时长约58分钟。Hinton评价说,这是近年来少有的干货演讲。

深度学习先驱Geoffrey Hinton在看完Tishby的柏林演讲后发电子邮件给Tishby。“这简直太有趣了,”Hinton写道:“我还得听上10,000次才能真正理解它,但如今听一个演讲,里面有真正原创的想法,而且可能解决重大的问题,真是非常罕见了。”(来源:新智元)

还有什么想听的内容

留言告诉我们吧

关注 AI 研习社,后台回复 “我要进群” 加入 AI 技术讨论群

上周语音 在此聆听

▼▼▼