为什么果蝇求爱“姿势”会变化?普林斯顿新研究:通过看,揪出背后的神经元 | Nature子刊

鱼羊 十三 发自 凹非寺

量子位 报道 | 公众号 QbitAI

人类在破解大脑的道路上又有新方法、新突破和新发现。

之前为了探究大脑的奥秘,科学家们可谓是尝试了各种各样的办法:

直接观察活体大脑→光脉冲控制神经元→构建复杂装置和虚拟现实环境。

其实,只要能准确、高效地观察动物行为,就能探究大脑中的神经元。

正如哈佛医学院的神经生物学家 Bob Datta 所说:

我们不了解大脑的输出,要弄清楚这些高密度的神经编码,就需要对行为有更深入的了解。这项研究来自普林斯顿大学,作者Mala Murthy和她的团队用深度神经网络模型,成功根据果蝇的行为,预测出了雄性果蝇会在何时以何种方式,对着“心上蝇”唱出一曲“情歌”。

这些方式对应了雄性果蝇的不同策略,研究人员根据这个信息确定了能够控制雄性果蝇做不同决策的神经元。

作者Mala Murthy表示:

这是一个重要的突破。我们期待这个模型被广泛应用,将神经活动和自然行为联系起来。

这项研究还登上了Nature Neuroscience。

看行为动作,预测大脑状态

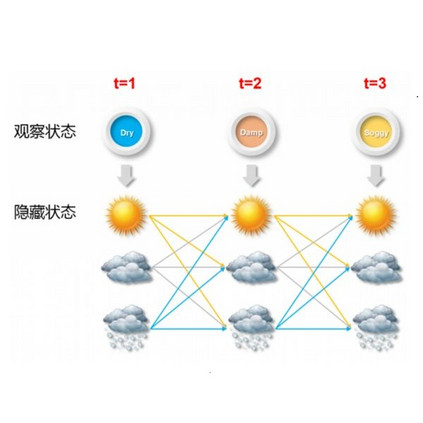

捕捉果蝇行为变化的神经网络,是广义线性模型(GLM)+ 隐马尔可夫模型(HMM)。

这是一种无监督的方法。

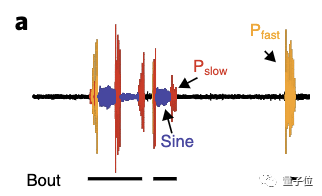

在求偶过程中,雄性果蝇会对着雌性果蝇唱歌,这种声音有三种不同的模式:一种是正弦形态,另外两种是脉冲形态。

△果蝇求偶声音的三种形态

研究人员收集了276对野生型(wild-type)数据,其中包含2765分钟的求偶互动行为。

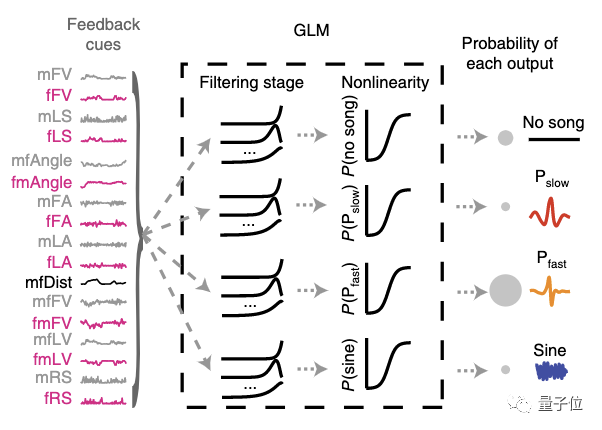

并用这一数据集训练多项式GLM,来预测整个求偶过程中雄蝇的唱歌行为。

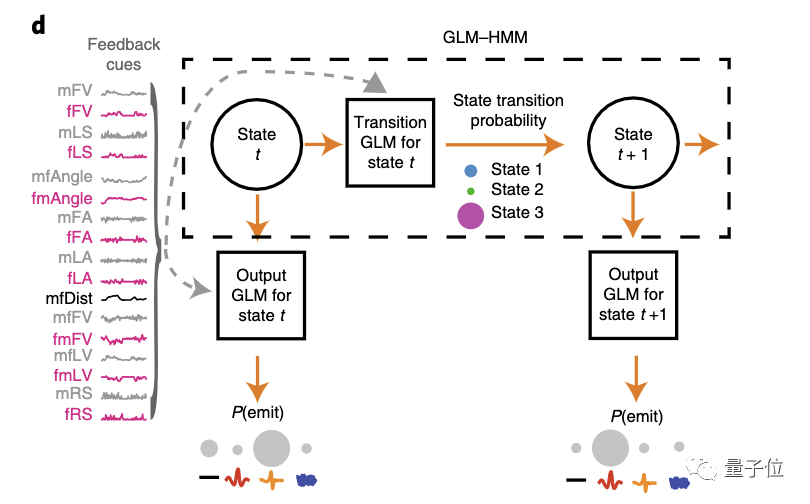

在此基础上,研究人员创建了一个GLM-HMM模型,该模型在根据反馈线索(feedback cues)预测唱歌模式时会合并隐藏状态。(注:反馈线索,由雄蝇和雌性的运动和相互作用来定义)

GLM-HMM允许每个状态拥有关联的多项式GLM,用来描述反馈线索→预测发出特定动作的概率这一过程的映射关系。

同时,每个状态还有单独的多项式GLM,可以产生另一个映射关系:反馈线索-从当前状态到下一状态转移的概率。

也就是说,这一概率会随着雄蝇收到的反馈的变化而变化,并且,研究人员能够确定在每个时间点,是哪些反馈线索影响了最终的转换概率。

GLM-HMM模型与其他预测行为的模型之间最主要的区别,是该模型允许每个状态使用不同的回归权重来预测行为。

果蝇求偶实验

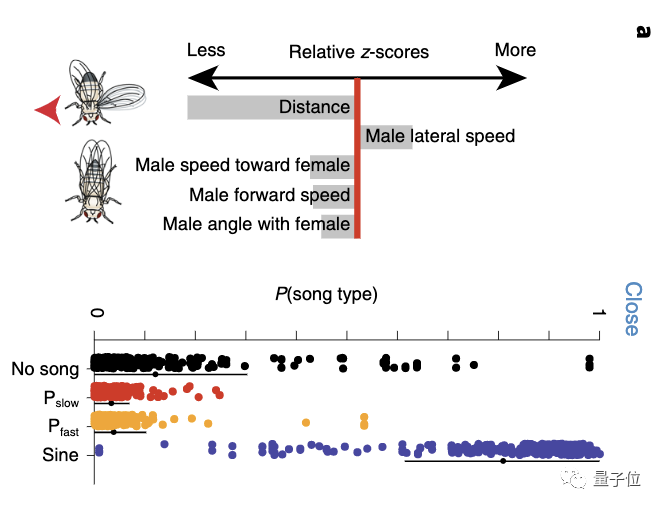

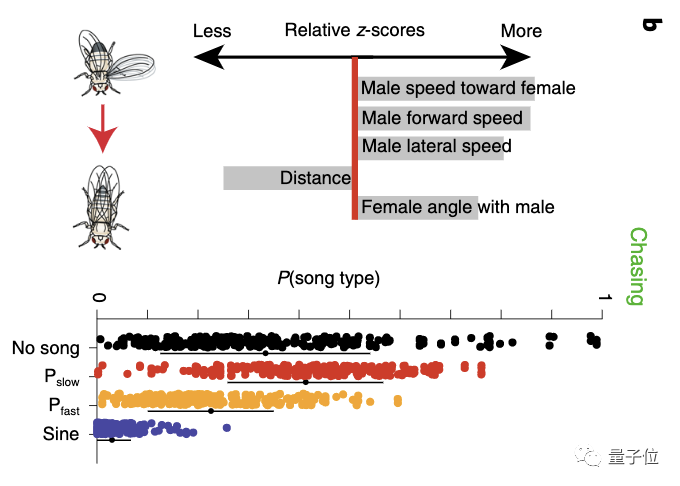

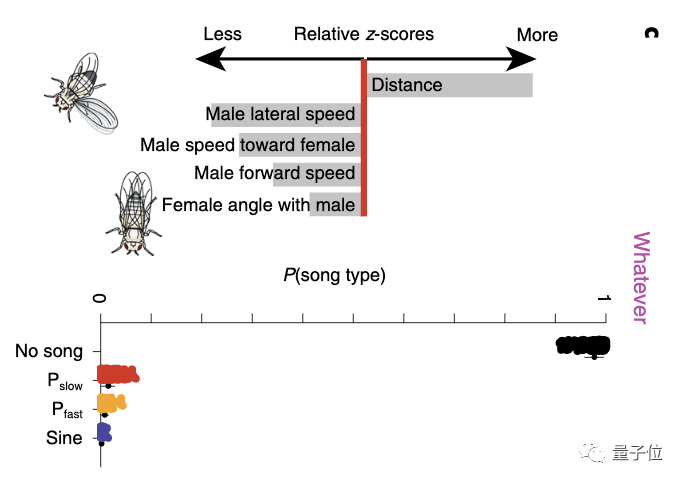

通过GLM-HMM模型研究人员总结了果蝇求偶过程的三种状态。

第一种状态,称为靠近(Close)。雄蝇与雌蝇之间的平均距离更短,并且雄蝇正在朝着雌蝇缓慢移动。

这种状态下,雄蝇的歌声主要呈正弦形态。

第二种状态,称为追逐(Chasing)。雄蝇以更快的速度向雌蝇靠近。

这种状态下,雄蝇的歌声主要呈脉冲形态。

第三种状态,称为不感兴趣(Whatever)。雄蝇与雌蝇的平均距离较远,雄蝇移动缓慢且朝向远离雌蝇的方向。

这种状态下,雄蝇就不怎么发出声了。

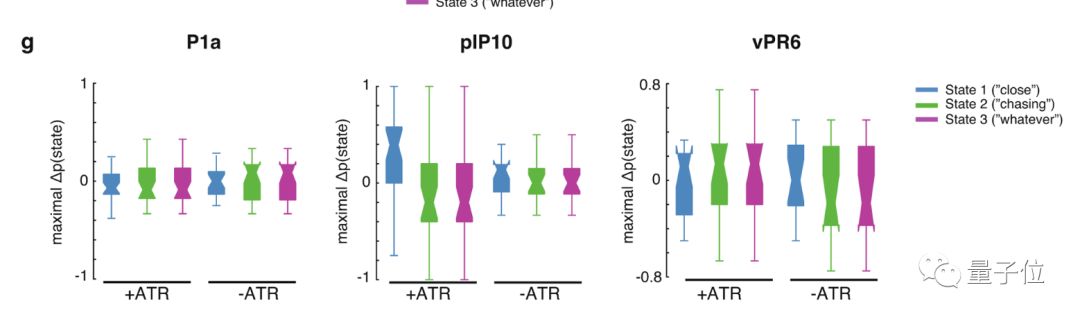

接着,研究人员通过激活各种神经元,来探究是哪些神经元驱动了不同状态之间的转变。

被重点关注的有三类神经元:P1a,pIP10和vPR6。

实验结果表明,当pIP10这一对下行神经元被激活时,果蝇进入“靠近”状态的可能性大大增加,但激活P1a和vPR6神经元并没有太大的影响。

也就是说,研究人员找出了果蝇求偶行为背后,操纵其大脑活动的那一对神经元。

行为生物学交叉跨界破解大脑

几十年来,科学家们对动物行为研究没有止步过。

1973年,《Nature》发表了一项研究,描述了一只老鼠梳理毛发的过程,并估计了在不同环境下,某些动作发生的概率。

但在当时,研究人员需要捕捉老鼠的所有动作,因为他们不知道所观察到的哪些动作是比较重要的。

接着,有些科学家就开始采取相反的策略做研究。

他们把动物放在受控制的环境中,让它们做简单的二元决策,例如在迷宫里面是左转还是右转。

但是人为的干扰也损害了对自然行为的理解。

于是乎,科学家们通过“更定量地思考行为”来让这个领域变得更加现代化。

数据收集和数据分析的自动化已经成为这种转变的关键因素。

到了1980年代,科学家们开始改进计算机视觉算法来解决动物行为问题。

在接下来的几十年里,人们开发了一种系统,可以在视频的每一帧中标记动物的位置,用来区分多种生物体,甚至可以开始识别身体的某些部位和方向。

尽管如此,这些项目并没有达到科学家们所需要的效率。

直到机器学习的出现。

通过深度学习,研究人员已经开始通过训练神经网络,来跟踪几乎所有动物的关节和主要身体部位。

所需要的只是一些标记好的帧。

但在动物身上做上这些标记还真不是一件简单的事情。

五年前,挪威科技大学的研究人员为了标记老鼠,把它们身上的毛剃光,背上轻轻地涂上一些玻璃珠(glasses bead),还在动物的关节上涂上发光的墨水和抛光剂。

但有时候这些标记物根本不够亮,无法被追踪,而且还会干扰动物的行为。

最后,它们决定使用粘在动物背部三个点上的小块反光胶带来重建脊柱的运动,并使用一个带有另外四块胶带的小头盔来追踪头部的运动。

不过,很多科学家并不想在动物身上做这样的标记。

于是乎,各种各样的应用系统就诞生了。

首先是哈佛大学开发的DeepLabCut,于去年上线。

他们重新设计了一个神经网络,这个网络已经可以分类非常多的物体。

其他的应用系统还包括:LEAP、SLEAP和DeepPoseKit。

上述这些姿态跟踪应用的诞生,大大简化了数据集收集的工作。

哈佛大学行为生物学家Benjamin de Bivort表示:

现在我们可以考虑其他问题了。

但科学研究就是如此,永远不能止于现状。

虽然有了这些好用的应用,但是它们都依赖于监督学习,也就是说受过训练,能够从手工标记的数据推断出身体部位的位置。

科学家们希望通过无监督的方式来实现这个过程。无监督方法本身就有希望揭示隐藏的行为结构。

2008年出现了一个有趣的例子。

当时研究人员确定了四种构成蠕虫运动的基本单元,这些基本单元可以叠加在一起,以捕捉动物全部的运动。

2013年,Datta用他的 Xbox Kinect 技术将这种方法提升到了一个全新的水平。

动物的三维动态行为似乎自然地分割成小块(chunk),平均持续300毫秒。

基于这个发现,他和团队建立了一个深度神经网络,通过分解动物的活动来识别这些小块,从而可以预测未来的行为。

行为生物学,就这样也成为了破解大脑方法大家庭中的一员:

对动物行为的深入了解,有利于揭秘复杂、高密度的神经编码。

关于作者

△Jonathan W. Pillow

Adam J. Calhoun,普林斯顿大学神经科学研究所,研究助理。重点研究大脑如何做出决策以及选择行为。开发的工具和技术可以通过机器学习精确地量化动物的行为。△Adam J. Calhoun

Jonathan W. Pillow,普林斯顿大学心理学、神经科学教授。研究领域包括神经科学、统计学和机器学习交叉的问题。开发了表征高维数据结构的统计方法,并与实验小组密切合作来研究神经系统及其执行的计算。对大脑在自然任务中执行统计推断的能力以及控制感觉系统功能和设计的理论原理感兴趣。

△Mala Murthy

Mala Murthy,普林斯顿大学神经科学教授。研究重点是果蝇沟通的神经机制。

传送门

论文:

https://www.nature.com/articles/s41593-019-0533-x

QuantaMagazine:

https://www.quantamagazine.org/to-decode-the-brain-scientists-automate-the-study-of-behavior-20191210/

— 完 —

AI内参|把握AI发展新机遇

拓展优质人脉,获取最新AI资讯&论文教程,欢迎加入AI内参社群一起学习~

跟大咖交流 | 进入AI社群

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态

喜欢就点「在看」吧 !