ICCV 2019 接收论文体现了哪些计算机热门方向?

加入极市专业CV交流群,与6000+来自腾讯,华为,百度,北大,清华,中科院等名企名校视觉开发者互动交流!更有机会与李开复老师等大牛群内互动!

同时提供每月大咖直播分享、真实项目需求对接、干货资讯汇总,行业技术交流。关注 极市平台 公众号 ,回复 加群,立刻申请入群~

本文来自知乎问答,回答均已获作者授权,禁止二次转载

问题:如何评价 ICCV 2019 收稿论文?可以体现哪些计算机热门方向?

中国在被接受论文数量方面优势明显,位列世界第一。

10月27日至11月2日,ICCV2019在韩国首尔举办。作为计算机视觉领域的顶会之一,本届ICCV热度空前。据官网数据显示,本届ICCV注册参会人数再创新高,超过7000人,是2017年ICCV的2倍。

在论文收稿和入围数量方面,ICCV 19 共收到论文投稿4303篇,最终入围1075篇(官方数据),入选率为25%,较上届的29%有所下降。

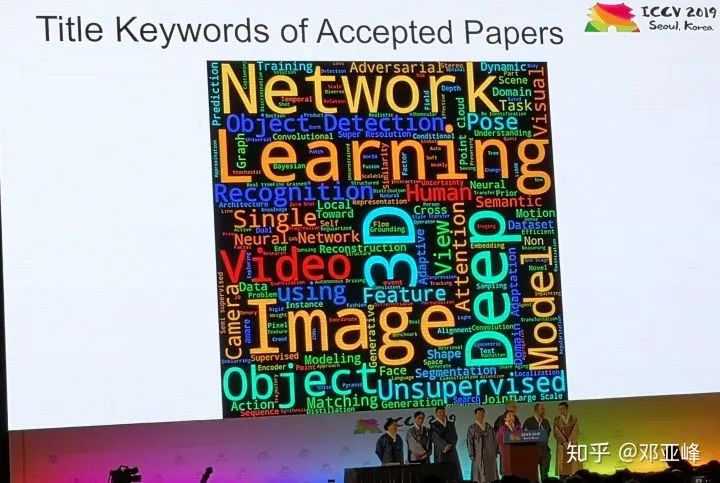

在投稿论文的关键词上,占据前列的分别为图像、目标、检测、3D、视频、分割等。其中图像(155篇)、目标(104篇)、检测(101篇)位列关键词热度前三位。

https://www.zhihu.com/question/353051329

知乎高质量回答

一、作者:yafeng deng

https://www.zhihu.com/question/353051329/answer/889534043

本次 ICCV 的关键词组成了一张图像(如下图),里面看起来出现频率比较高的词,除了network、learning、image、deep、object、model等相对通用的词汇外,最醒目的要数3D和Video,其他还有object detection、pose、unsupervised、adversarial、reconstruction、attention等关键词。

best paper授予了sinGAN,而Best student paper和Best Paper Honorable Mentions则授予了和成像相关的两篇文章。这体现了一个趋势,deep learning基础模型以及detection等high level vision层面的任务今年并没有特别突出的工作,而图像生成以及视觉底层成像受到了更多的关注。

整体上,个人的感觉有下面几点,抛砖引玉:

1,在多年来深度学习粗暴的刷新视觉各个任务之后,cv界终于开始重视3D等视觉本身的domain knowledge和表示结构,无论是由2d image输出3d信息表示(比如mesh rcnn,当然也有少量工作由双目或3d信息输出更好的3d信息),还是在表示模型中加入3d model,无论是普通物体,还是人脸,都有很多工作涉及;个人觉得这是后面非常重要的方向,在简单粗暴之后,我们需要在视觉表示框架中加入3d等信息,这无疑更为合理;

2,GAN相关的工作依然很多,但基础方法没有看到突破性进展,反而是Adversarial的思维方式或方法在很多任务中都被使用,比如best paper就是如何通过一副图像训练模型来生成各种新的图像,还有很多衣服搭配、视频动作生成等应用工作,期待未来有更多应用工作可以用GAN的思路来解决;

3,今年reid的文章非常多,有关于domain transfer的,关于样本生成的,有考虑姿态的,有处理遮挡的,有考虑局部更好对齐的,有考虑low shot learning问题的,有基于检索来设计loss function或通过rerank来获得更好的metric的,能想到的思路都有了;人体已经俨然代替人脸开始成为各种任务的研究目标了,可能真的是人脸不好做了吧;

4,前面说到3d和person reid,其实用2d camera获得human的3d信息在今年也非常抢眼,特别是很多工作的效果让人眼前一亮,应该有机会推动一波应用;

5,还有很多关于video understanding相关的工作,个人关注比较少,但整体上看起来都还比较简单粗暴,类似于rcnn做detection的阶段,只是先把deep learning用来做表示,缺少对于video understanding框架的细致设计,未来应该还有很长路要走,也说明机会很多;

6,今年有很多工作关于low shot learning、transfer learning、meta learning、metric learning等相关工作,最后一天的workshop:Visual learning with limited labeled data应该是最受欢迎的一个,人多到挤不进去,这也说明这个方向慢慢成为一个热点,不过从工业界视角看,目前还不能实用,但作为学术界的研究课题应该是值得关注;

7,传统的detection、segmentation、pose estimation缺少突破性的工作,不过,如同我一直坚信的,用大一统的框架来同时表示detection、pose estimation、Semantic segmentation、instance segmentation、3d/2d mesh是正确的方向,也许不是最快的,但一定是最优雅的;这粗看起来是个multi-task learning的问题,但更进一步如何让各个任务之间相互促进(特别是高层任务对底层任务的帮助),一直是一个没有被非常好证明但看起来挺有道理的方向;

8,还有一些关于模型结构、gcn等基础表示方向,我没有看到特别突破性的工作;

9,关于tutorial,ross做的detection的tutorial讲得非常清楚(强烈推荐,用统一的视角看待检测框架,主要覆盖了几乎所有two stage的方法,后续需要把one stage的思路也一起统一,会对detection的未来非常有启发),amazon组织的everything you need to know to reproduce sota deep learning models讲了很多很实用的技巧,当然也大大推广了一把mxnet,某种意义上非常羡慕今天的小朋友,遥想当年的convnet,再想想今天的mxnet、pytorch,一种想哭的感觉;

10,韩国召开的iccv当然不能不提韩国,招待晚宴,韩国果然谜之自信,把自己和中国、印度、两河文明并列,一个历史悠久的现代国家;在统计论文所属国家时把taiwan单列,让人难免遐想;还有就是首尔真的没啥可玩的;

关于未来,我看了十几年的视觉论文,真正经历时间的考验被后人记住的论文是比较少的(大部分论文的价值是启发了相关工作,推动了领域前进),那么未来哪些方向是可能出现被人铭记的工作的呢?我抛一下砖。

1,在视觉表示模型中加入3d模型的约束也许会成为以后的一些问题的标配,毕竟我们要理解的是一个3d世界的2d投影,同时,由2d image得到3d信息(特别是人脸、人体3d模型确定的物体)也是重要趋势;

2,检测、定位、语义分割、3d信息理解,这些任务未来将在一个优雅的框架下被完美解决,而且各个任务互相促进;进一步,遮挡、属性、身份等未必需要和detection在一个框架下解决,但对于单个目标,遮挡、属性、身份、定位、语义分割、3d信息等也会通过一个框架解决;当然,上述是一个理想模型,考虑到速度,也许是一个层次性或attention相关的模型,这更符合人的理解方式;

3,在视觉领域,一直非常关注representation,最近几年,gan的出现使得大家非常关注生成,表示和生成其实应该是一个可逆的过程,以人脸为例,我们希望将一个人脸表示为属性、id、姿态,再考虑到背后的人脸模型、光照、context信息,那么表示模型就是希望将一张图像(或多张)表示为id(鉴别特征+3d model)、属性(男、女、表情等等)、姿态、光照、context等信息,同样,如果这个表示非常好,那么这些信息反过来一定可以生成这个脸,更重要的是,上述信息在这个过程中被解耦,那么我们可以去编辑这些控制信息来生成各种不同的图像,比如不同姿态的图像,比如不同身份的图像;这样,也许可以把表示和生成打通,当前,利用表示来帮助改善生成已经被证明有效,反之,还需要得到验证;

4,基础模型层面,肯定是需要更多好的工作,这样的工作也许会结合特定硬件架构出现,或者说,基础模型、硬件架构、软件inference框架会融合出现突破性进展;

5,Cv领域对于成像关注是比较少的,未来,也许视觉理解会和成像结合非常紧密(出现真正意义上的智慧传感器),我觉得这也许是视觉领域最fundamental的工作,而且,会和attention、video结合,这是人的理解机制;

最后的这些看法是非常粗浅的,一方面期待大家的指正,另外一方面,talk is cheap,希望未来真的有相关工作在这些问题上取得一个个进展。

二、作者:匿名用户

https://www.zhihu.com/question/353051329/answer/874708006

最近几天在开会,看到仍然有很多研究者仍然在关注我们这个领域最基础的检测和分割,觉得很欣慰。

不可否认,这些方向已经基本成型,已经由前几年的火热慢慢的冷却,给旁人的感觉似乎是,“物理学的大厦已经建成,只需要后人修修补补”。

事实上,我们还是很清楚他们的发展,远远没有达到能work的境地,远远没有。拿检测而言,实话说,业界早就发现堆数据比换模型有用的多;再者一些方法,用一些非业内人士看不出来的手法把准确率给堆上去,速度却又比 faster rcnn 还低,你好意思说自己是 one-stage 么?

这些基础方向的天空里还没有发展到只像20世纪初的物理学只存在两朵乌云,而是乌云密布。因为他们实在是太基础,而且十分重要。真诚的希望,能有一批务实、有天赋的研究者与工程师推进这些方向,使得一些多模态、理解等这类通向智能的任务不再是飘浮的空中楼阁。

-End-

*延伸阅读

CV细分方向交流群

添加极市小助手微信(ID : cv-mart),备注:研究方向-姓名-学校/公司-城市(如:目标检测-小极-北大-深圳),即可申请加入目标检测、目标跟踪、人脸、工业检测、医学影像、三维&SLAM、图像分割、姿态估计、超分辨率、嵌入式视觉、OCR 等极市技术交流群(已经添加小助手的好友直接私信),更有每月大咖直播分享、真实项目需求对接、干货资讯汇总,行业技术交流,一起来让思想之光照的更远吧~

△长按添加极市小助手

△长按关注极市平台

觉得有用麻烦给个在看啦~