终身学习(LLL)作为一种新兴方法打破了传统机器学习的局限性,并赋予了模型能够像人类一样在学习 过程中不断积累、优化并转移知识的能力。近年来,随着深度学习的广泛应用,越来越多的研究致力于解决深度神经 网络中出现的灾难性遗忘问题和摆脱稳定性-可塑性困境,并将LLL方法应用于各种各样的实际场景中,以推进人工 智能由弱向强的发展。针对计算机视觉领域,首先,在图像分类任务中将LLL方法归纳为四大类型:基于数据驱动的 方法、基于优化过程的方法、基于网络结构的方法和基于知识组合的方法;然后,介绍了 LLL方法在其他视觉任务中 的典型应用和相关评估指标;最后,针对现阶段LLL方法的不足之处进行讨论并提出了LLL方法未来发展的方向。

传统的机器学习总是被限制在一个封闭的静态环境中, 通常被称为孤立学习,这种学习方式不考虑任务以外的信 息,即针对一个任务,模型的训练和推理只在符合独立同分 布假设的数据上进行;然而这样的学习方式是低效的,毕竟 现实场景显然是一个开放的动态环境,人类在这种环境下会 不断地积累知识并优化形成经验,用于帮助解决出现的 问题[1] 。 终身学习(LifeLong Learning, LLL)范式是通过模仿人类 的学习过程抽象而来。人类拥有强大的获取、调整和迁移知 识的能力,例如会骑自行车的人能够很快学会骑摩托车,在 遇到新任务或者新问题时会很快产生联想并无缝地将这些 知识迁移,然后根据特定的问题进行特别的学习。这样的学 习方式是高效且自然的,这也是终身学习过程中最为重要的 一环。

在计算机视觉领域,以深度学习为代表的学习框架尚未 达到终身学习范式的要求。例如要单独训练一个过参数化 的深度模型,就必须为每个任务收集大量的数据和进行繁琐 的人工预处理等,这使得学习成本随着任务量大幅增加,这 无疑是耗时且低效的方式,尤其是在一些对时间和性能有特 殊要求的应用场景下甚至是不被允许的。深度学习独特的 训练和推理模式使得深度学习模型还远远达不到人类的学 习效果,例如要融入终身学习范式目前还存在着两个严峻的挑战:1)灾难性遗忘,即网络在学习了新的知识之后,可能会 彻底遗忘在先前任务上学到的知识[2] ;2)概念漂移,即网络 对属于同类但是不同分布的新数据表现效果差[3] 。因此要 求深度学习模型既要满足一定的可塑性以适应新数据的输 入,又要具备一定的稳定性以避免在整合新知识的同时产生 大量的遗忘,即摆脱稳定性-可塑性困境[4] 。 此外,一个简单的思路是融合所有的数据训练一个大规 模模型,即联合训练或者多任务学习,但这并不在本文定义 的终身学习范式内;因为把时间线拉长,无休止地存储所有 数据必然无法实现,所以需要对它进行一定程度的限制,其 次每当接受新任务时就要重新训练所有的数据也不符合人 类的学习方式。针对深度学习的框架,直观上联合训练或许 是终身学习方法的一个上界,因为深度学习是一个优化问 题,联合训练更有可能找到所有任务的全局最优解。 为满足对模型存储上的限制要求,大量的研究者从深度 学习的框架入手,从多个角度探索终身学习的解决方式,并 在多个应用方向展现了它的可行性。本文调研并跟踪了近 年来的终身学习相关文献,相较于文献[5-6],本文增加了评 估终身学习模型性能的相关指标,不仅考虑了模型在终身学 习过程中识别的能力,同时考虑了存储即资源利用的能力; 相较于文献[7-8],本文不仅在图像分类中详细调研了终身 学习的相关应用,还介绍了终身学习在其他计算机视觉如目 标检测等中的应用。终身学习不仅要解决实际应用环境中 的成本问题,更有可能是现阶段弱人工智能迈向未来强人工 智能的重要一步。

1 终身学习的定义

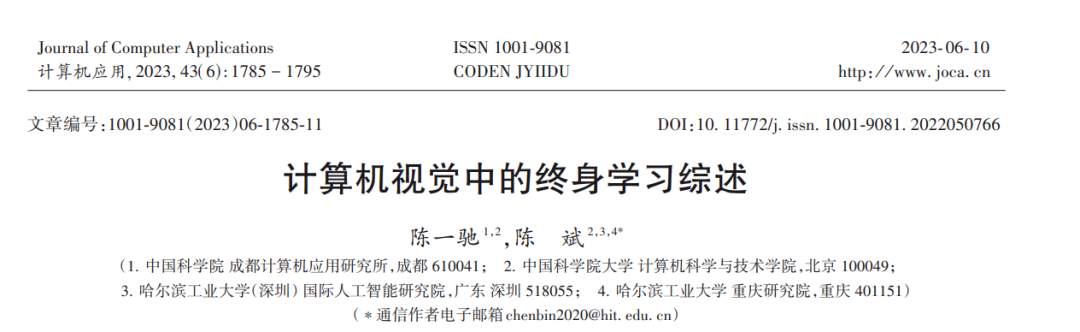

终身学习是一个连续学习的过程。假设在时间点 t模型 Mt 已经完成了 N 个学习任务 T1,T2,⋯,TN,其中每个任务都 有对应的数据集 D1,D2,⋯,DN,任务之间没有严格的约束并 且此时模型积累了源自这 N 个任务的知识并存储于知识库 中。当面对新的任务 TN + 1 及其数据 DN + 1 时,Mt 可以利用知 识库中积累的先验知识帮助学习 TN + 1,并且在学习 TN + 1 后, Mt能够根据从 TN + 1中学到的知识进行同步更新为 Mt + 1以供 未来继续使用,同时 Mt + 1 能最大限度地保留在先前 N 个任 务上的性能。由此可见,终身学习的关键是持续地学习和不 断积累知识,即 Mt 如何利用先验知识学习 TN + 1 和如何存储 新知识演化为 Mt + 1。在这个定义下,还额外需增加一个存储 限制,即知识库不能保留所有的训练数据,否则将会与多任 务学习无异,违背终身学习的初衷。

2 终身学习方法的分类

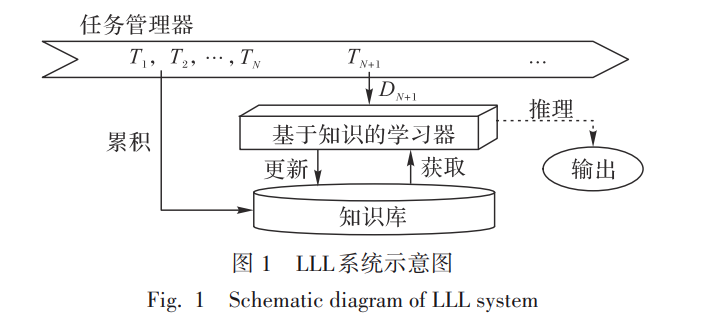

计算机视觉作为深度学习最为成功的应用,框架一般可 以拆解为输入、优化和结构这 3 个部分,用于积累和再应用 的知识就可以以这 3 个部分作为切入点,同时也可以组合使 用它们。本文将从知识的角度对终身学习方法进行分类与 归纳,如表 1所示。

3 终身学习的其他应用

终身学习不仅在解决基础问题中开阔了研究空间,也逐 渐 助 力 于 目 标 检 测(Object Detection)[77-81] 、语 义 分 割 (Semantic Segmentation)[77-81] 、图像生成[90-95] 和其他[96-102] 等各 类计算机视觉的研究方向。

4 结语 本文主要回顾了终身学习在图像分类任务上的基本方 法,介绍了在其他计算机视觉任务上的成功应用,最后简要 探讨了在未来可以进一步推动终身学习发展的方向。终身 学习给予了模型在动态环境中更多更强大的学习能力,虽然 目前仍处于起步阶段,但不可置疑这是人工智能发展的重要 一环,无论是理论上的研究,还是工业界的落地都具有非常 大的意义。