本文总结了关于自主军事系统的测试、评估、验证和确认(TEV&V)的挑战和建议的部分文献。本文献综述仅用于提供信息,并不提出任何建议。

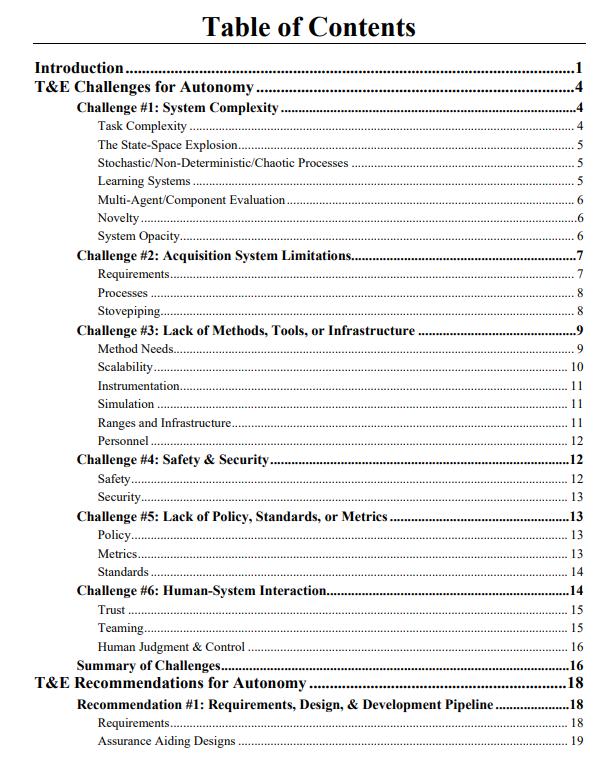

对文献的综合分析确定了以下几类TEV&V挑战:

1.自主系统的复杂性产生的问题。

2.当前采购系统的结构所带来的挑战。

3.缺少测试的方法、工具和基础设施。

4.新的安全和保障问题。

5.在政策、标准和衡量标准方面缺乏共识。

6.围绕如何将人类融入这些系统的操作和测试的问题。

关于如何测试自主军事系统的建议可以分为五大类:

1.使用某些程序来编写需求,或设计和开发系统。

2.进行有针对性的投资,以开发方法或工具,改善我们的测试基础设施,或提高我们劳动力的人工智能技能组合。

3.使用特定的拟议测试框架。

4.采用新的方法来实现系统安全或网络安全。

5.采用具体的建议政策、标准或衡量标准。

在过去的十年中,计算和机器学习的进步导致了工业、民用和学术应用中人工智能(AI)能力的激增(例如,Gil & Selman,2019;Narla, Kuprel, Sarin, Novoa, & Ko, 2018;Silver等人,2016;Templeton,2019)。由人工智能促成的系统往往在某种意义上表现得很自主:它们可能会接管传统上由人类做出的决定,或者在较少的监督下执行任务。然而,与武装冲突期间的错误决定相比,一个真空机器人、一个高频股票交易系统,甚至一辆自主汽车做出错误的选择是可以通过纠正措施相对恢复的。军事系统将面临与民用系统相同的大部分挑战,但更多地是在结构化程度较低的环境中运作,所需的反应时间较短,而且是在对手积极寻求利用错误的情况下。人工智能和自主军事系统将需要强有力的测试,以保证不理想的结果,如自相残杀、附带损害和糟糕的任务表现是不太可能的,并且在可接受的风险参数范围内。

为了自信地投入使用自主军事系统(AMS),必须相信它们会对设计时可预见的问题和它们必须适应的不可预见的情况做出适当的决定。简而言之,这些系统必须是熟练的、灵活的和值得信赖的。 当AMS要在狭义的情况下运行时(例如,要求一个 "智能"地雷在一天中的特定时间内施加特定的压力时爆炸),要保证系统的行为符合要求就容易多了。它能遇到的相关不同情况的数量和它的行为反应(即其决策的状态空间)都是有限的。扩大这个状态空间会使保证更加困难。例如,一个自主的基地防御系统旨在根据目前的ROE用适当的武力来应对任何可能的威胁,预计会遇到更多的情况,包括设计的和不可预见的。要在这种情况下适当地运作,需要更多的灵活性,这反过来又要求系统更加熟练,允许它运作的人类更加信任。这些需求的相互作用是这些系统的许多T&E困难的一个核心驱动因素。

人工智能技术为美国防部(DoD)内的采购项目的测试和评估过程带来了一系列的挑战。首先,这些系统纯粹的技术复杂性和新颖性可能难以驾驭。此外,美国防部的采购流程是在假设的基础上进行优化的,而自主权可能不再成立(Tate & Sparrow, 2018)。例如,将承包商、开发和操作测试分开,假设我们有离散的、相对线性的开发阶段,导致系统的 "生产代表 "版本。对于AMS来说,这可能不是真的,特别是如果它们在整个生命周期中继续学习。此外,在我们拥有一个系统之前就写需求,是假设我们事先了解它将如何被使用。因为AMS的熟练度、灵活性和可信度会随着时间的推移而发展,并会影响人类如何使用或与系统互动,所以与标准系统相比,作战概念(CONOPS)和战术、技术和程序(TTPs)将需要与系统共同开发,其程度更高(Haugh, Sparrow, & Tate, 2018; Hill & Thompson, 2016; Porter, McAnally, Bieber, & Wojton, 2020; Zacharias, 2019b)。

然而,即使美国防部的采购流程被更新,美国防部员工用于测试和评估(T&E)的具体方法、工具和基础设施将无法保证系统的性能达到预期。开发和设计工作包含了测试,通过内部仪器建立可测试性;提高软件的透明度、可追溯性或可解释性;对培训和其他数据进行良好的管理和验证,可以改善开发过程,同时也为测试和评估铺平道路,但它们没有被普遍采用。此外,能够帮助项目克服所有这些挑战的政策和标准要么缺乏,要么不存在。

什么是自主性?

自主性的定义繁杂众多,有些定义对美国防部来说不如其他定义有用。许多定义包含了独立、不受外部控制或监督、或与其他实体分离的概念(例如,牛津英语词典,2020年)。然而,假设任何参与者将在没有控制或监督的情况下运作,甚至是人类作战人员,这与美国防部的政策和指挥与控制(C2)的思想相悖。不希望自主系统拥有选择行动路线的完全自由,而是在其分配的任务中拥有一些受约束的自由。

与作战人员一样,可能希望与自主系统有一个C2或智能体关系。希望:1. 明确具体任务和/或整体任务的目标或目的,可能还有这些目标的更大原因,如指挥官的意图(即做什么和为什么)。2.明确与任务相关的约束,如交战规则(ROE,即不能做什么)。3. 不指定使用的方法或对每一种情况给出明确的应急措施,如对对手的反应做出反应(即如何完成任务)。

一个系统是否被授权为一项任务做出这些 "如何 "的决定,是本文将区分自主系统和非自主系统的方法。

在 "是什么"、"不是什么 "和 "为什么 "的限制下,为 "如何 "做出有用的、理想的选择,假定了某种程度的智能。因为这些是机器,这就意味着存在某种程度的人工智能。需要人工智能来实现对非琐碎任务的有用的自主性,这可能解释了为什么人工智能和自主性经常被混为一谈。在本文件中,我们将自主性称为系统在其操作环境中的行为,而人工智能则是与该环境进行有意义的互动的 "内在 "促成因素。