![]() 研究背景 近年来,人工智能领域经历了跨越式发展,其中生成模型在计算机视觉、自然语言处理和强化学习等多个领域取得了长足进步。生成对抗网络(GANs)、变分自编码器(VAEs)和归一化流等传统方法曾长期占据主导地位,但近期扩散模型(Diffusion Models)的兴起引发了生成模型范式的转变。扩散模型由三个关键组成部分构成:正向过程将数据分布转化为随机噪声;反向过程使用可学习神经网络逐步估计变换核从而逆转正向过程;采样过程利用优化后的网络从随机噪声生成数据。尽管在理论基础、训练稳定性和损失函数简洁性方面具有优势,但扩散模型通常需要更多的采样时间,且难以控制和引导生成过程。为解决这些挑战,研究人员提出了多种解决方案,包括改进的常微分方程(ODE)或随机微分方程(SDE)求解器、模型蒸馏技术以加速采样,以及引导机制来根据条件校正无条件生成的方向。这些条件可涵盖图像、文本或2D姿态等多种形式。 研究目的 虽然已有多篇综述文章探讨了扩散模型的各个方面,但在可控生成的全面回顾方面仍存在空白。本综述着力填补这一空白,提供了一个全面的分类框架,总结了扩散模型图像合成中各种形式的控制技术和策略,并探讨了可控生成在不同应用场景中的实践。我们期望能为可控扩散模型的潜力提供有价值的见解,并启发未来在这一蓬勃发展的新型生成模型领域的进一步研究方向。 研究方法 首先,本文概述了扩散模型的公式、采样方法以及推动其发展的关键方向。扩散模型是一种基于概率分布的生成模型,通过模拟数据分布的随机过程来生成新的数据样本。在采样方法方面,扩散模型采用了多种策略,如马尔可夫链蒙特卡洛采样、朗之万采样等,以提高生成样本的质量和多样性。然而,单纯的扩散模型在实际应用中往往难以满足特定需求。因此,可控扩散模型应运而生。可控扩散模型在传统扩散模型的基础上,引入了多种可控因素,如语义可控、空间位置可控、ID可控、图像风格可控以及程度可控等。这些可控因素使得模型能够根据不同的需求,生成具有特定属性或特征的样本,大大提高了模型的实用性和灵活性。在可控技术的推进过程中,评估指标的建立至关重要。通过设定合理的评估标准,我们可以对模型的性能进行量化分析,从而指导模型的优化和改进。目前,常用的评估指标包括生成样本的质量、多样性、语义匹配性等方面,这些指标共同构成了评估可控扩散模型性能的基础框架。除了理论层面的研究,可控扩散模型在多个领域的应用也取得了显著的成果。在图像处理领域,可控扩散模型可以用于生成具有特定风格或内容的2D图像,如艺术画作、人脸合成等,也能用于图像修复、视频、3D生成以及个人定制生成。 研究结果和结论 随着深度学习技术的不断进步,模型的性能将得到进一步提升,生成样本的质量和多样性将得到显著提高。其次,随着大数据时代的到来,可控扩散模型将在处理海量数据方面发挥更大的作用,为各个领域的实际问题提供更为有效的解决方案。最后,随着多模态数据的发展,可控扩散模型将在跨模态生成方面取得重要突破,实现文本、图像、音频等多种数据形式之间的自由转换和生成。可控扩散模型作为一种新兴的技术,在解决实际问题中展现出了巨大的潜力。通过深入了解其核心原理、技术进展以及应用领域,我们可以为未来的研究和发展提供有力的支持。

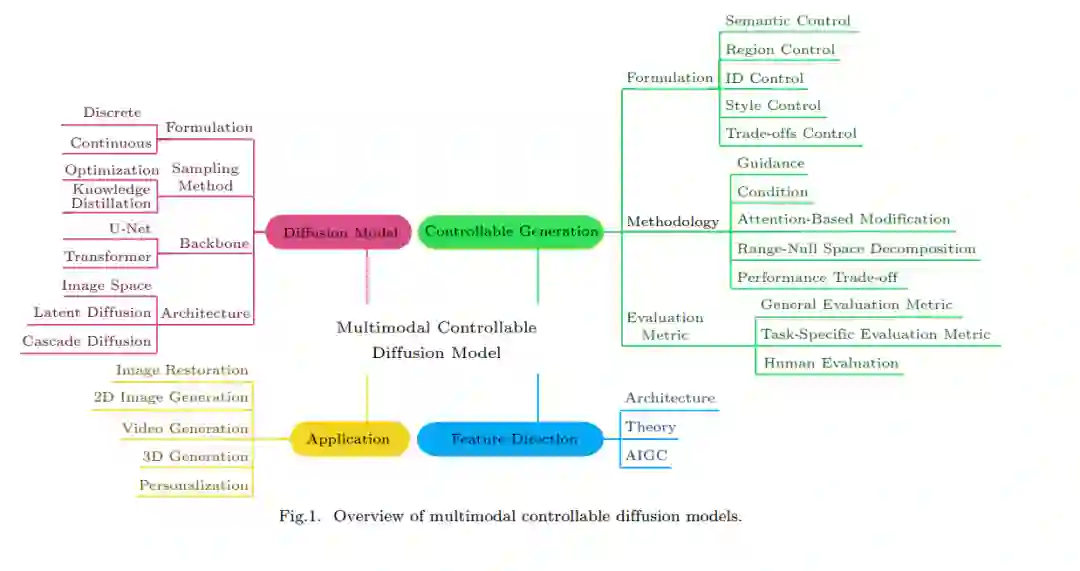

研究背景 近年来,人工智能领域经历了跨越式发展,其中生成模型在计算机视觉、自然语言处理和强化学习等多个领域取得了长足进步。生成对抗网络(GANs)、变分自编码器(VAEs)和归一化流等传统方法曾长期占据主导地位,但近期扩散模型(Diffusion Models)的兴起引发了生成模型范式的转变。扩散模型由三个关键组成部分构成:正向过程将数据分布转化为随机噪声;反向过程使用可学习神经网络逐步估计变换核从而逆转正向过程;采样过程利用优化后的网络从随机噪声生成数据。尽管在理论基础、训练稳定性和损失函数简洁性方面具有优势,但扩散模型通常需要更多的采样时间,且难以控制和引导生成过程。为解决这些挑战,研究人员提出了多种解决方案,包括改进的常微分方程(ODE)或随机微分方程(SDE)求解器、模型蒸馏技术以加速采样,以及引导机制来根据条件校正无条件生成的方向。这些条件可涵盖图像、文本或2D姿态等多种形式。 研究目的 虽然已有多篇综述文章探讨了扩散模型的各个方面,但在可控生成的全面回顾方面仍存在空白。本综述着力填补这一空白,提供了一个全面的分类框架,总结了扩散模型图像合成中各种形式的控制技术和策略,并探讨了可控生成在不同应用场景中的实践。我们期望能为可控扩散模型的潜力提供有价值的见解,并启发未来在这一蓬勃发展的新型生成模型领域的进一步研究方向。 研究方法 首先,本文概述了扩散模型的公式、采样方法以及推动其发展的关键方向。扩散模型是一种基于概率分布的生成模型,通过模拟数据分布的随机过程来生成新的数据样本。在采样方法方面,扩散模型采用了多种策略,如马尔可夫链蒙特卡洛采样、朗之万采样等,以提高生成样本的质量和多样性。然而,单纯的扩散模型在实际应用中往往难以满足特定需求。因此,可控扩散模型应运而生。可控扩散模型在传统扩散模型的基础上,引入了多种可控因素,如语义可控、空间位置可控、ID可控、图像风格可控以及程度可控等。这些可控因素使得模型能够根据不同的需求,生成具有特定属性或特征的样本,大大提高了模型的实用性和灵活性。在可控技术的推进过程中,评估指标的建立至关重要。通过设定合理的评估标准,我们可以对模型的性能进行量化分析,从而指导模型的优化和改进。目前,常用的评估指标包括生成样本的质量、多样性、语义匹配性等方面,这些指标共同构成了评估可控扩散模型性能的基础框架。除了理论层面的研究,可控扩散模型在多个领域的应用也取得了显著的成果。在图像处理领域,可控扩散模型可以用于生成具有特定风格或内容的2D图像,如艺术画作、人脸合成等,也能用于图像修复、视频、3D生成以及个人定制生成。 研究结果和结论 随着深度学习技术的不断进步,模型的性能将得到进一步提升,生成样本的质量和多样性将得到显著提高。其次,随着大数据时代的到来,可控扩散模型将在处理海量数据方面发挥更大的作用,为各个领域的实际问题提供更为有效的解决方案。最后,随着多模态数据的发展,可控扩散模型将在跨模态生成方面取得重要突破,实现文本、图像、音频等多种数据形式之间的自由转换和生成。可控扩散模型作为一种新兴的技术,在解决实际问题中展现出了巨大的潜力。通过深入了解其核心原理、技术进展以及应用领域,我们可以为未来的研究和发展提供有力的支持。 ![]()