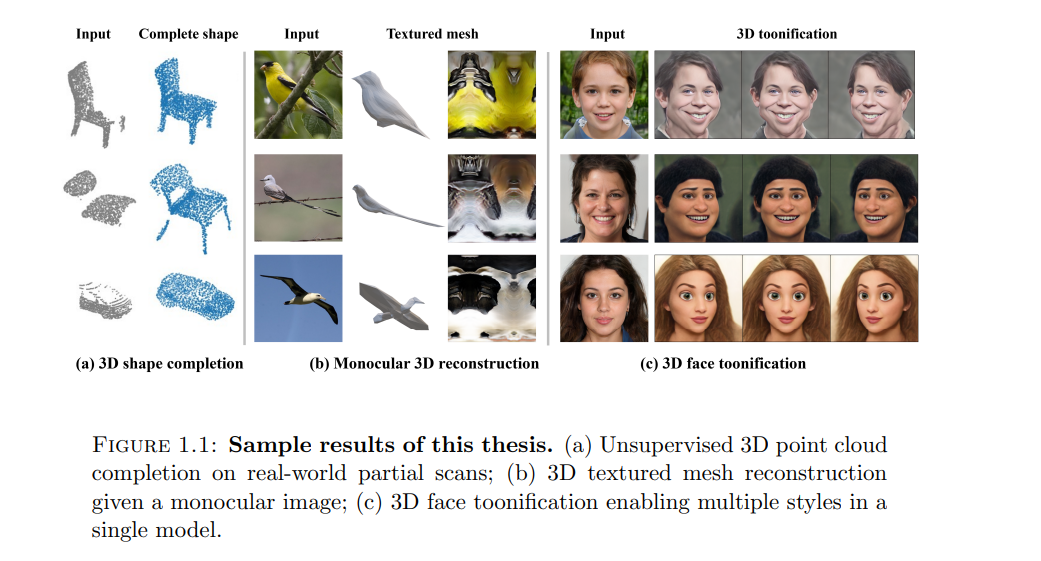

在过去的十年里,深度学习引发了计算机视觉领域的革命,尤其是在二维图像感知与生成方面的巨大进展。这一突破主要归功于大量可用的训练数据,即图像数据。然而,我们所处的真实世界是三维的,理解周围环境的几何结构与视觉外观对于深度学习系统至关重要。这些系统构成了众多应用的基础,包括机器人技术、虚拟/增强现实、视觉生成式人工智能(AIGC)、电子游戏和元宇宙等。然而,3D数据的获取通常成本高昂且充满挑战,导致用于训练深度学习模型的可靠3D真实数据极度稀缺。因此,迫切需要能够在有限观测条件下(如来自RGB相机的单目2D图像或来自深度传感器的不完整3D扫描)高效恢复或风格化3D物体的学习机制。 本论文聚焦于有限监督下的三维任务,即训练数据有限且不完整的场景。具体而言,本文关注以下三个任务:(1) 3D形状补全,即训练时可用的部分-完整形状对极为有限;(2) 3D纹理网格重建,训练数据仅由单目图像集合组成;(3) 3D人脸卡通化,训练过程中仅能获得伪2D真实标签。为了解决这些挑战,本研究探讨了预训练的3D生成对抗网络(GANs)作为几何和视觉先验知识的宝贵来源。通过利用这些预训练模型中丰富的先验知识,目标是在这些具有有限监督的3D任务中开发出能够实现准确且稳健的形状补全、重建和风格化的有效解决方案。

3D形状补全

在3D形状补全方面,大多数现有方法高度依赖于完全监督学习,需要部分-完整形状对进行训练。尽管这些方法在域内数据上表现出色,但在处理不同形式的部分形状或真实世界的部分扫描数据时,往往由于域间差距而产生不理想的结果。为了解决这一限制,本文提出了ShapeInversion方法,该方法首次将GAN反演引入到形状补全中。该方法使用在完整形状上预训练的GAN,通过搜索潜在空间中的最佳潜码,从部分输入中重建出完整的3D形状。通过直接引入完整形状的丰富先验,ShapeInversion在没有真实标签的真实扫描数据上展现了出色的泛化能力。

3D纹理网格重建

在3D重建任务中,从单个单目图像重建具有纹理的3D网格是一个极具挑战性的反问题,尤其是在训练数据仅由单目图像集合组成的现实场景下。为了解决这一难题,本文提出了一个名为MeshInversion的全新框架,该框架通过GAN反演利用了预训练的3D纹理网格GAN的生成先验。通过使用预训练GAN所捕获的丰富3D语义(包括网格几何和纹理),在GAN流形中进行搜索自然能够增强重建的真实性和保真度。更为关键的是,这种正则化直接发生在3D空间中,为2D空间中未观察到的网格部分提供了必要的几何引导。因此,MeshInversion不仅能够生成高度真实的3D重建,还能够在遮挡或不常见物体等具有挑战性的场景下表现出色。

3D人脸卡通化

3D人脸卡通化旨在将艺术域的风格应用于目标3D人脸,同时对其几何与纹理进行风格化。然而,在真实空间或风格空间中均不存在3D数据的情况下,这一任务变得尤为复杂。尽管对预训练GAN进行微调以适应风格空间已广泛用于2D卡通化,但这种方法在3D领域面临以下局限性:一是可能导致原始GAN潜在空间的损坏,二是每次引入新的风格都需要单独的优化过程。为克服这些挑战,本文提出了DeformToon3D,该方法完全保留了预训练3D GAN的原始潜在空间,并将3D卡通化分解为几何风格化与纹理风格化两个独立阶段。 具体而言,DeformToon3D引入了一个新颖的模块——StyleField,该模块用于预测条件3D形变,将真实空间的NeRF(神经辐射场)对齐到风格空间以实现几何风格化。基于StyleField的设计,纹理风格化可通过自适应风格混合(adaptive style mixing)轻松实现,即将艺术域的信息注入到预训练3D GAN的解码器中。凭借这种独特的设计,DeformToon3D能够在单一模型下实现多风格卡通化,并提供灵活的风格控制,使用户能够根据需要调整风格程度,并实现针对形状和纹理的特定风格交换。