大型语言模型(LLMs)的迅速发展为在多种应用领域利用人工智能提供了新机遇,包括网络安全领域。随着网络威胁的数量和复杂性不断增长,迫切需要能够自动检测漏洞、分析恶意软件并响应攻击的智能系统。在这项综述中,我们对LLMs在网络安全(LLM4Security)中的应用进行了全面的文献回顾。通过全面收集超过30,000篇相关论文,并系统分析来自顶级安全和软件工程领域的127篇论文,我们旨在提供一个关于LLMs如何被用于解决网络安全领域多样化问题的整体视角。

通过我们的分析,我们识别出几个关键发现。首先,我们观察到LLMs被应用于网络安全的广泛任务中,包括漏洞检测、恶意软件分析、网络入侵检测和钓鱼检测。其次,我们发现这些任务中用于训练和评估LLMs的数据集往往在大小和多样性上有限,这突显了需要更全面和具有代表性的数据集的必要性。第三,我们识别出几种将LLMs适应特定网络安全领域的有希望的技术,如微调、迁移学习和领域特定的预训练。最后,我们讨论了LLM4Security未来研究的主要挑战和机遇,包括需要更多可解释和可说明的模型、解决数据隐私和安全问题的重要性,以及利用LLMs进行主动防御和威胁狩猎的潜力。

总体而言,我们的综述提供了LLM4Security当前最先进状态的全面概述,并识别了未来研究的几个有希望的方向。我们相信,这项综述中呈现的见解和发现将有助于增加LLMs在网络安全应用方面的知识体系,并为在该领域工作的研究人员和实践者提供宝贵的指导。

1 引言

在过去十年中,自然语言处理(NLP)的快速发展主要得益于大型语言模型(LLMs)的发展。通过利用变换器架构[205]和在大量文本数据上的训练,像BERT[49]、GPT-3,4[147, 149]、PaLM[40]、Claude[15]和Chinchilla[78]这样的LLMs在广泛的NLP任务中取得了显著的表现,包括语言理解、生成和推理。这些基础模型学习了丰富的语言表征,可以通过最小的微调来适应下游应用,实现了如开放域问答[1]、对话系统[151, 230]和程序合成[5]等领域的突破。特别是在网络安全这一重要领域,LLMs开始显示出潜力。随着网络威胁的数量和复杂性的增长,迫切需要智能系统自动检测漏洞、分析恶意软件并响应攻击[19, 35, 137]。近期的研究已经探索了LLMs在广泛的网络安全任务中的应用,即此后称为LLM4Security。在软件安全领域,LLMs已被用于从自然语言描述和源代码中检测漏洞,以及生成安全相关的代码,如补丁和漏洞利用代码。这些模型在识别易受攻击的代码片段和为常见漏洞类型生成有效补丁方面表现出高精度[29, 39, 64]。在代码级分析之外,LLMs还被应用于理解和分析更高层次的安全文档,如安全政策和隐私政策,帮助分类文件和检测潜在违规[74, 134]。在网络安全领域,LLMs已展示出从网络流量数据中检测和分类各种类型攻击的能力,包括DDoS攻击、端口扫描和僵尸网络流量[9, 10, 139]。恶意软件分析是LLMs显示出前景的另一个关键领域,模型被用于基于文本分析报告和行为描述对恶意软件家族进行分类,以及检测恶意域名和URLs[22, 122]。LLMs还在社交工程领域被用于通过分析电子邮件内容和识别欺骗性语言模式来检测和防御钓鱼攻击[89, 171]。此外,研究人员正在探索使用LLMs来增强安全系统本身的鲁棒性和复原力,通过生成对抗性样本来测试安全分类器的鲁棒性,并模拟现实攻击场景以用于培训和评估[30, 178, 197]。这些多样的应用展示了LLMs在通过处理和提取大量非结构化文本的洞见、从庞大数据集中学习模式以及生成用于测试和培训的相关示例方面,提高网络安全实践的效率和效果的显著潜力。

尽管已有几项宝贵的努力在文献中对LLM4Security进行了调查[42, 50, 140, 229],鉴于这一方向工作的日益增多,这些研究通常具有更加聚焦的范围。许多现有的综述主要集中于审查LLMs可以应用的任务类型,而没有提供关于这些任务的其他关键方面的广泛分析,如所使用的数据和领域特定技术[145, 231],如表1所示。例如,Divakaran等人[50]仅分析了LLMs在各种安全任务中的前景和挑战,分别讨论了每个任务的特点。然而,它缺乏对这些安全任务的要求与数据之间的联系以及LLMs在领域特定技术中的应用的洞察。 为了解决这些限制并提供对LLM4Security最新研究的深入了解,我们进行了一项系统而广泛的文献调查。通过全面收集38,112篇相关论文并系统分析来自顶级安全和软件工程领域的127篇论文,我们的调查旨在提供一个关于LLMs如何被用于解决网络安全领域多样化问题的整体视角。除了识别LLMs正在使用的任务类型外,我们还检查了每种情况中使用的具体数据集、预处理技术和领域适应方法。这使我们能够提供不同方法的优势和限制的更细致分析,并识别未来研究最有前景的方向。具体来说,我们专注于回答四个关键研究问题(RQs):

**• RQ1:哪些LLMs被用于支持安全任务? ** **• RQ2:哪些类型的安全任务已通过基于LLM的方法得到了促进? ** **• RQ3:使用了哪些领域规范技术来适应LLMs到安全任务? ** • RQ4:在将LLMs应用到安全任务时,数据收集和预处理有何不同?

对于每个研究问题,我们提供了对调查论文中使用的方法、数据集和评估协议的细致分析。我们识别常见主题并按不同维度对论文进行分类,以提供景观的结构化概览。此外,我们强调当前方法的主要挑战和限制,以指导未来的研究弥补这些差距。我们相信我们的调查可以为在NLP、AI和网络安全交叉领域工作的研究人员提供宝贵的资源。此项工作的贡献总结如下: •** 我们进行了一项全面的系统性文献综述(SLR),以调查LLM4Security的最新研究,提供了当前景观的映射**。我们的搜索涵盖了超过38,112篇论文,通过进一步基于质量和相关性的筛选,我们保留了127篇论文以供后续详细审查。 •** 我们制定了四个关键RQs**,以了解LLM在安全中的各个不同维度的应用,包括使用的LLM类型、得到促进的安全任务、领域规范技术以及数据收集和预处理的差异。 • 我们分析了127篇选定论文在会议地点和时间上的分布,揭示了特别是在2022-2023年LLM4Security研究的迅速增长,并对主流LLMs在安全领域的使用特征进行了分类。 调查按以下框架进行。我们在第2节概述了我们的调查方法,包括搜索策略、包含/排除标准和数据提取过程。第3至6节可以找到对四个研究问题的分析和发现。第7至8节探讨了我们结果的约束和意义,同时也识别了未来研究的有前景的方向。最后,第9节总结了本文。

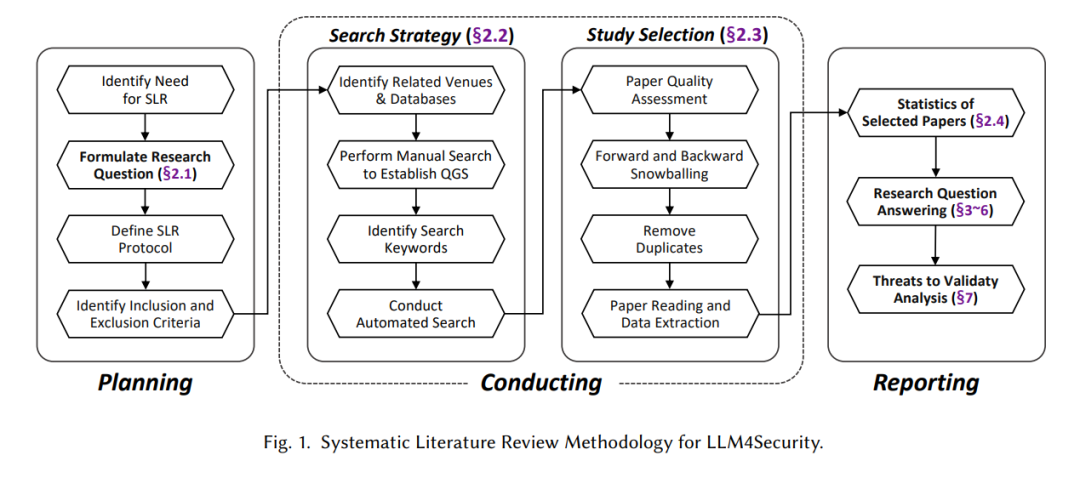

在这项研究中,我们进行了一项系统性文献综述(SLR),以调查LLM4Security的最新研究。这项综述旨在提供一个全面的景观映射,识别LLMs如何被部署以增强网络安全措施。根据既定的SLR指南[98, 163],我们的方法论被结构化为三个关键阶段,如图2所示:规划(§2.1)、执行(§2.2, §2.3)和报告(§2.4),每个阶段都被精心设计以确保对这一新兴领域的研究状态进行全面覆盖和深入分析。

规划 最初,我们制定了精确的研究问题,以理解LLMs如何在安全任务中被利用、所得益处及相关挑战。随后,我们制定了一个详细的协议,描述了我们的搜索策略,包括具体的数据库和关键词、包含和排除标准以及数据提取。每位合作者都审查了这一协议,以增强其稳健性并与我们的研究目标保持一致。 执行 我们精心设计了文献搜索,以确保全面性,采用了手动和自动策略,跨越多个数据库,涵盖了广泛的研究。识别的每项研究都经历了严格的筛选过程,最初基于标题和摘要,随后对全文进行彻底审查,以确保符合我们预定义的标准。为了防止忽视相关论文,我们还对收集的论文进行了前向和后向滚动式引用搜索。 报告 我们通过结构化的叙述呈现我们的发现,辅以流程图和表格等视觉辅助工具,提供了现有文献的清晰和全面概览。讨论深入探讨了我们的发现的含义,解决了LLMs革新网络安全实践的潜力,并识别了需要进一步调查的空白。