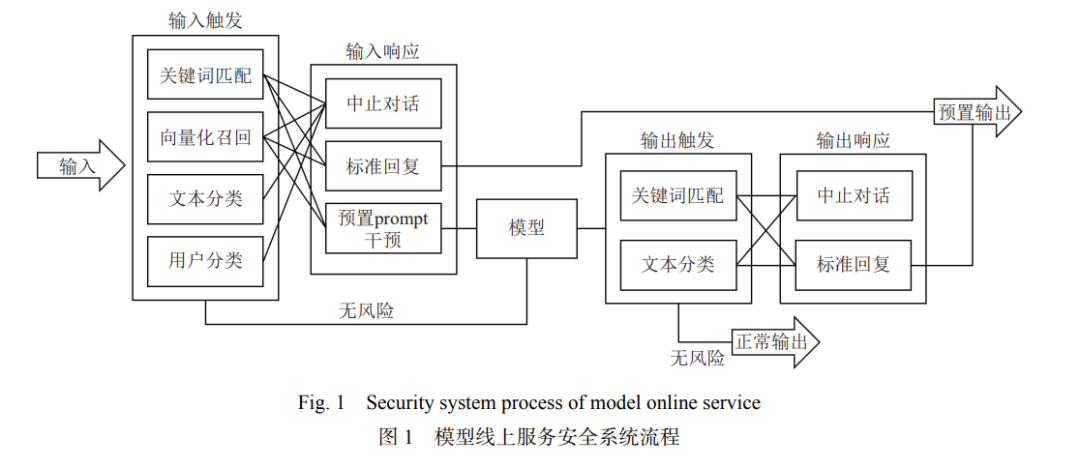

随着人工智能领域大模型(Big Model)的广泛应用,大模型,尤其是大规模语言模型的安全问题受到了广泛关注. 大模型作为一种新兴技术,与之相关的安全态势分析以及安全体系建设均亟待挖掘与探索. 本文从社会关系以及技术应用两个视角,分析了大模型安全的整体趋势. 同时,本文基于大模型自身的特点,梳理了大模型安全能力建设的实践思路,为大模型研发、大模型应用构建提供了安全体系构建的参考方案. 本文介绍的大模型安全能力实践方案包括安全评估基准建设、模型价值观对齐方法、模型线上服务安全系统建设三个部分.

随着深度学习技术的不断发展和应用,大模型 逐渐成为学术界和工业界研究的热点. 这些模型具 有非常强大的表示能力和学习能力,可以处理各种 复杂的任务,如图像识别、自然语言处理、语音识别 等. 特别是近几年 LLM(large language model) 所展现 的惊人能力,已开始对社会发展造成一定影响,因此 模型安全问题开始显得尤为重要. 本文从人类整体 发展、国家竞争以及技术应用的 3 个不同视角看待 大模型安全,将重点介绍技术应用视角,而技术应用 主要讨论 3 个参与方的安全管理问题,并最终分析 生成内容安全的未来发展趋势. 在上述分析的基础上,本文梳理了大模型安全 能力建设的实践思路,从模型安全评估基准建设、模 型价值观对其方法、模型线上服务安全系统 3 个方 面,阐述了大模型安全能力支撑体系的构建方案. 本文所述的大模型安全,主要围绕大模型生成内容的安全性. 大模型安全主要包括系统安全、生成 内容安全 2 个方向. 大模型系统安全方面所遇到的问 题、问题的解决方案与计算机领域传统信息安全领 域接近,本文仅对此方面进行简要介绍. 生成内容安 全是大模型特有的安全问题,这一问题是由大模型 自然语言生成能力相对于以往的语言模型有显著提 升带来的,因此本文主要针对生成内容安全问题进 行讨论.