近期在深度学习模型方面的进步在各种计算机视觉任务中展示了令人印象深刻的能力,这鼓励了将这些模型整合到真实世界的视觉系统中,例如智能设备。这种整合带来了新的挑战,因为模型需要满足复杂的真实世界要求。本论文致力于构建实用的深度学习模型,我们关注视觉系统中的两个主要挑战:数据效率和变异性。我们通过提供一个通用的模型适应框架来解决这些问题,该框架扩展了模型的实用功能。

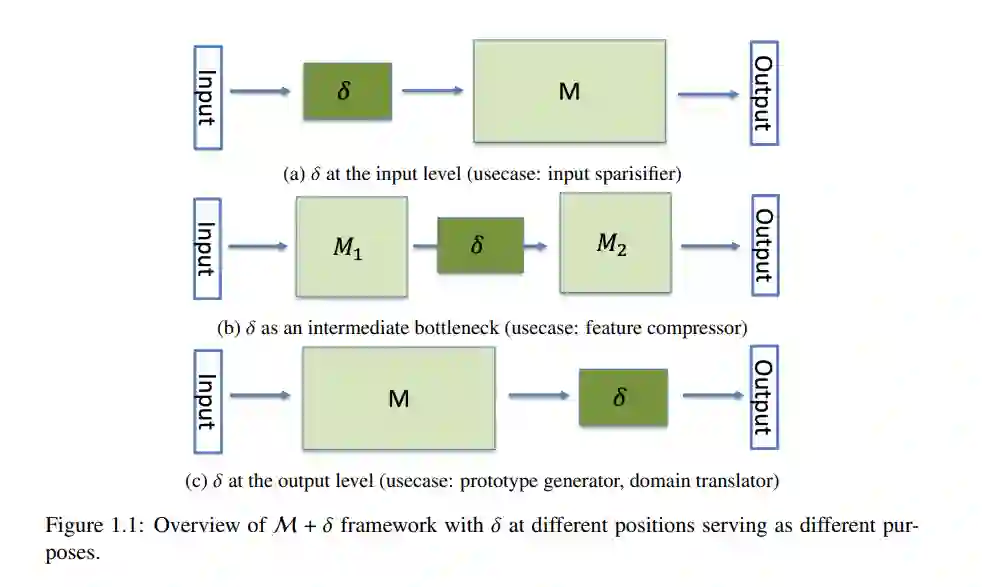

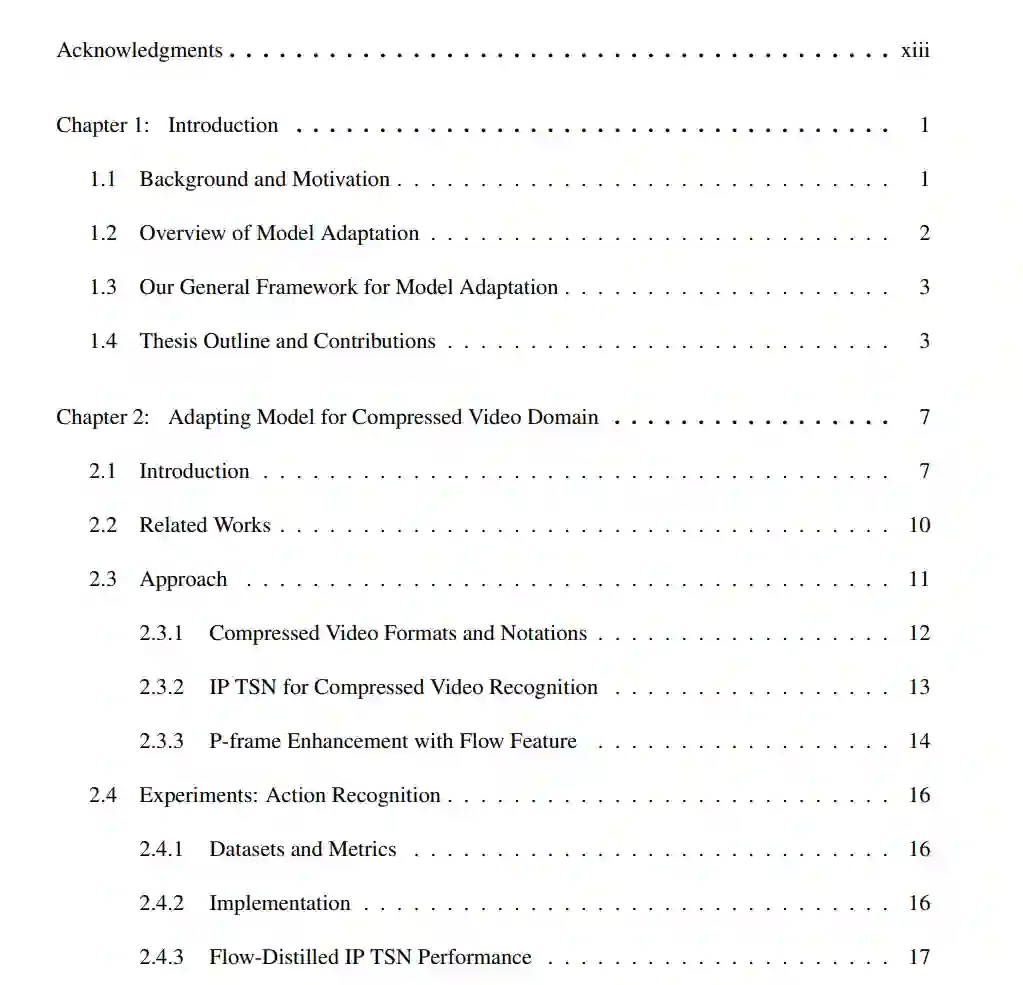

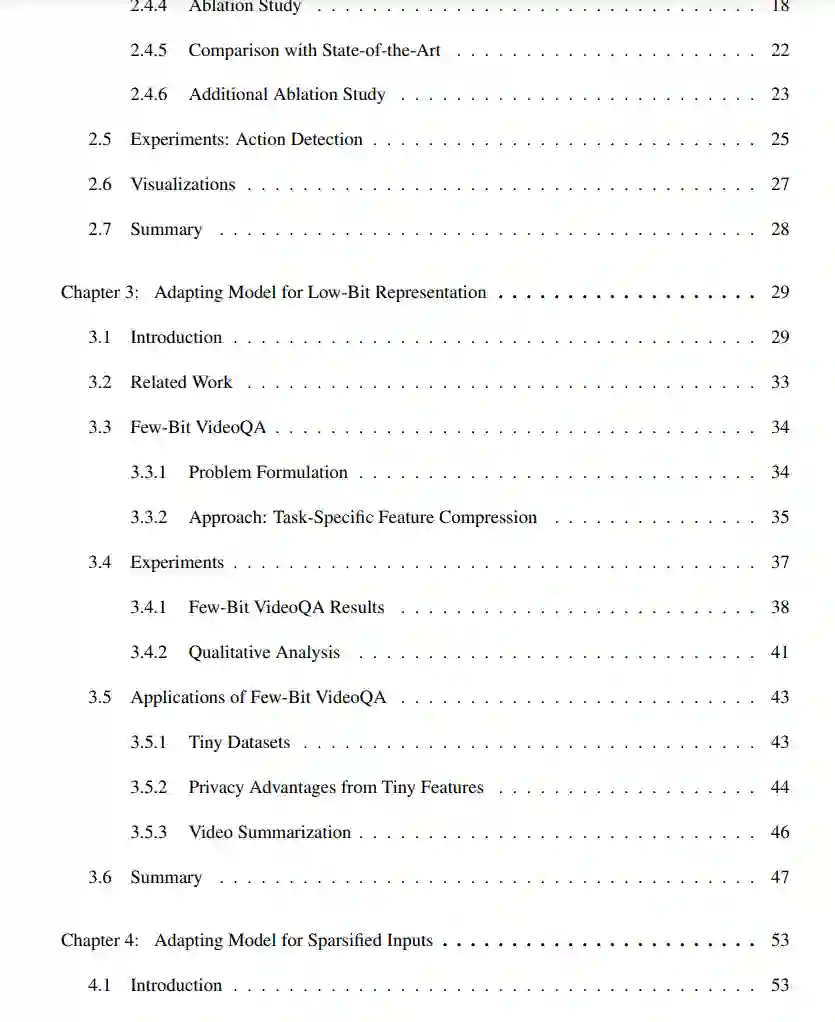

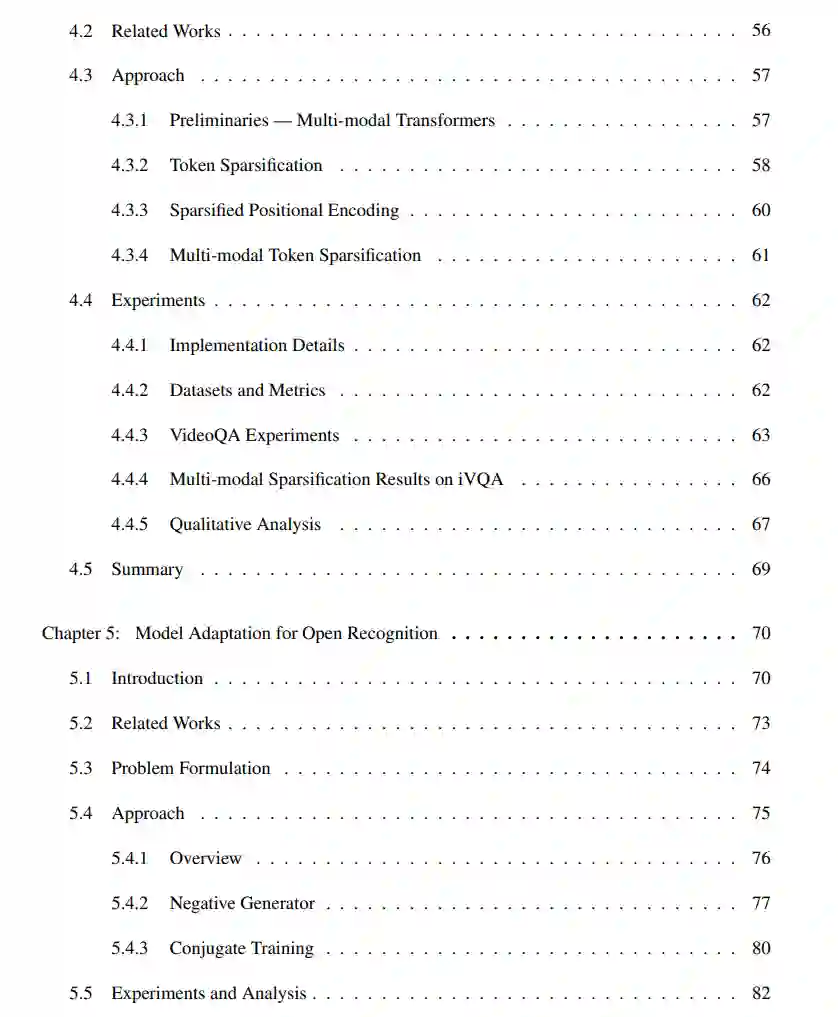

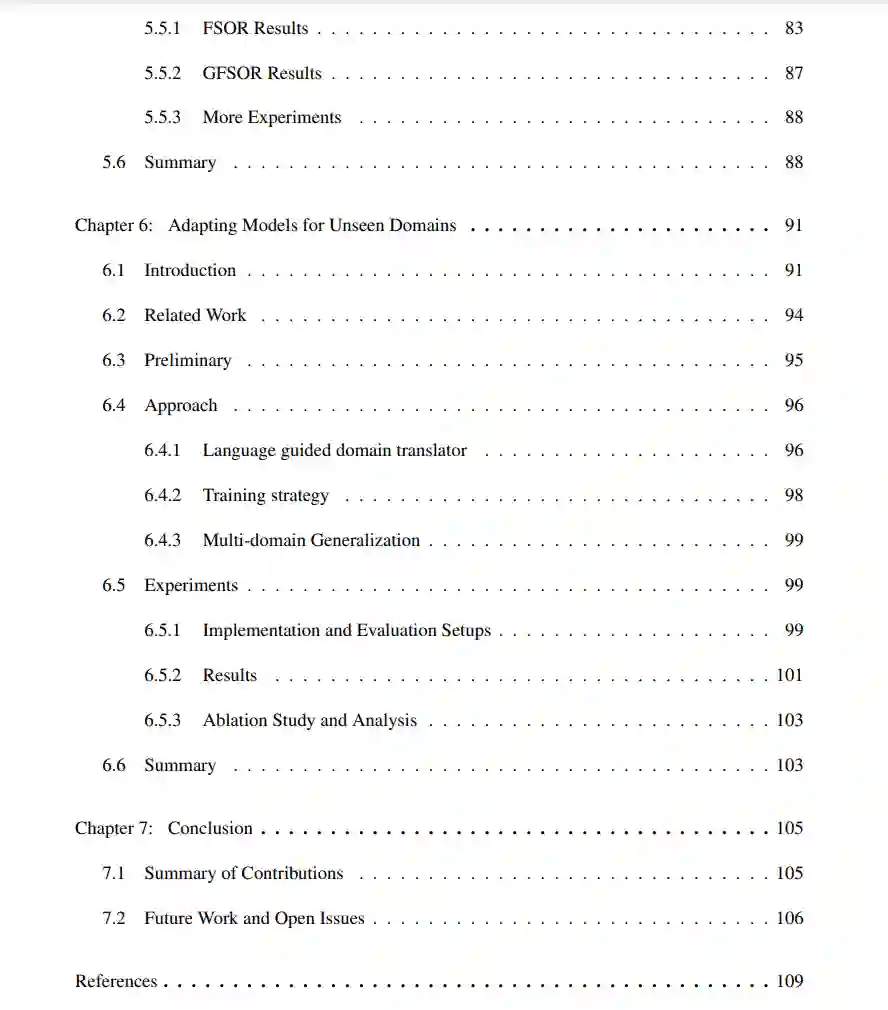

在论文的第一部分,我们探索了用于高效表示的模型适应方法。我们阐述了不同类型的高效数据表示的好处,包括来自视频编解码器的压缩视频模态、低比特特征以及稀疏化的帧和文本。通过使用这种高效的表示,系统复杂性如数据存储、处理和计算可以大大减少。我们系统地研究了提取、学习和利用这些表示的各种方法,提出了新方法来使机器学习模型适应它们。提出的方法包括一个具有粗到细蒸馏训练策略的压缩域视频识别模型、一个针对低比特视频和语言理解的任务特定特征压缩框架,以及一个可学习的令牌稀疏化方法,用于稀疏化人类可解释的视频输入。我们展示了在各种应用中以更实用和高效的方式表示视觉数据的新视角。 论文的第二部分关注开放环境挑战,我们探索了模型适应新的、未见过的类别和领域。我们考察了当前识别模型中的实际限制,并引入了各种方法来增强模型在处理开放识别场景中的能力。这包括一个用于管理新类别和异常值的负面设想框架,以及一个用于处理未见领域数据的多域转换方法。我们的研究显示了一条朝向模型在真实世界应用中通过多样化数据环境导航的有希望的轨迹。

https://academiccommons.columbia.edu/doi/10.7916/hz0n-pa15

成为VIP会员查看完整内容

相关内容

Arxiv

86+阅读 · 2023年4月4日

Arxiv

153+阅读 · 2023年3月29日