采用神经网络模型的预测系统已被部署到非安全关键领域和高度安全关键领域。当模型无法达到预期性能时,通常很难找出根本原因。在故障可能造成不可挽回的损失或生命或财产损失的领域,必须采取措施向使用这些系统的人员提供可靠性,在设计过程中已经通过深思熟虑的分析降低了风险。本论文展示了系统理论过程分析(STPA)作为一种可重复的方法,用于选择和校准机器学习开发行为,从而在机器学习开发生命周期(MDLC)中提供保证。STPA 是一种系统分析方法,可识别安全关键型系统中由组件级交互引起的组件危险。在这项研究中,STPA 被用于评估机器学习开发的安全性,它符合负责任的人工智能(AI)原则,适用于一个利用分类模型根据音频特征检测海上船只的系统。分析结果提出了一些建议,这些建议可以主动指导人工智能设计过程,从而使生命周期每个阶段的决策都能得到解释。结果表明,通过应用这种方法,人工智能系统的可靠性更高,部署更安全。

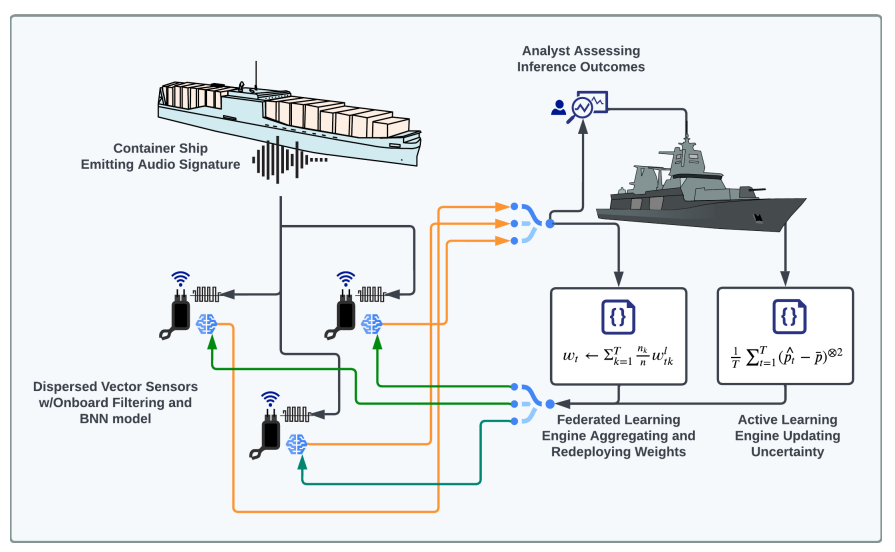

图 4.1:相关系统内的活动示意图。在这个拟议版本中,矢量传感器与信号处理能力和神经网络模型一起部署。在执行联合和主动学习程序时,每个传感器部署的本地模型都会更新。

成为VIP会员查看完整内容

相关内容

Arxiv

224+阅读 · 2023年4月7日