本简报以证据为基础,分析了有可能破坏即将于 7 月举行的英国大选以及其他即将举行的民主选举的人工智能影响力行动。该文件还为英国利益相关方提供了短期政策缓解措施,以提高选举复原力。

这是关于人工智能和选举安全的两份出版物中的第一份。将于 2024 年 9 月发布的最终研究报告将为保护民主进程的完整性提供长期的政策和技术建议。

主要发现如下:

-

目前,人工智能对具体选举结果的影响有限,但这些威胁显示出破坏更广泛民主制度的迹象。根据我们的研究,在 2023 年 1 月以来已经举行或即将于 2024 年举行的 112 次全国选举中,仅有 19 次被发现存在人工智能干扰。截至 2024 年 5 月,有证据表明,与民调数据中政治候选人的预期表现相比,选举结果没有明显变化的迹象。

-

然而,不管是有意还是无意,有证据表明,与日益退化和两极分化的信息空间有关的影响,会在选举过程之外产生二阶风险。这些影响包括:混淆人工智能生成的内容是否真实,破坏对网络来源的信任;深度伪造的内容在网上煽动对政治人物的仇恨,威胁他们的人身安全;政客利用人工智能虚假信息获取潜在的选举利益。这些动态的长期后果仍不确定。

-

现有的人工智能在选举中被滥用的例子很少,而且往往通过主流媒体被放大。识别和证实人工智能使用的实例十分困难,有限的实例往往通过媒体报道的反复引用而被放大。这有可能扩大公众的焦虑,夸大人工智能对选举过程的威胁。

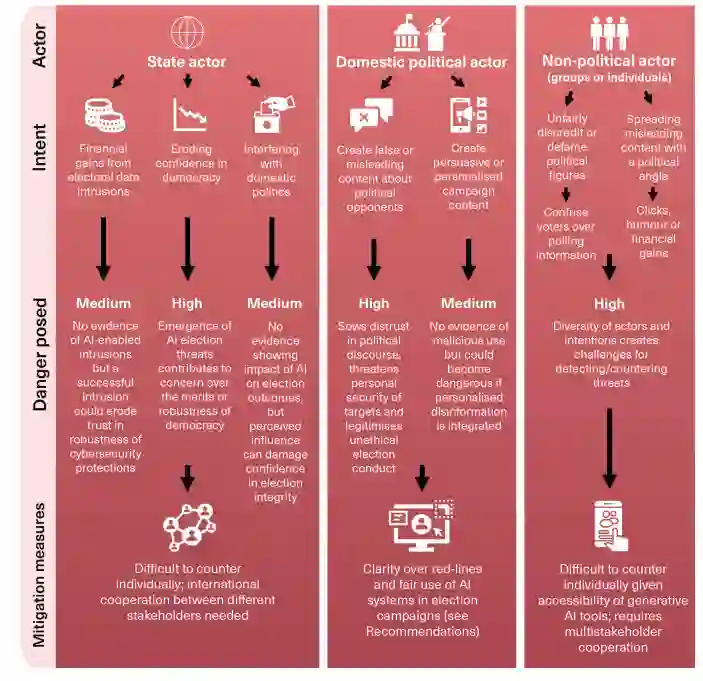

研究中发现的选举威胁并不是新的或专门针对人工智能的,但有可能在选举周期的不同阶段通过人工智能得到加强。网络钓鱼邮件、网络入侵和假新闻源都是以往选举中发现的问题。根据我们的分析,我们确定了当前选举安全威胁的三个类别,并指出这些威胁在意图和/或影响上往往是重叠的:

-

竞选威胁:旨在操纵选民对特定政治候选人或政治问题特定观点的行为或态度。其中一些威胁可能来自敌对行为者,而另一些威胁则来自政党本身--这表明有必要对竞选期间公平使用人工智能提供更明确的指导和限制。

-

选举信息威胁:旨在破坏选举信息环境的质量,混淆选民视听,损害选举结果的公正性。其中一些威胁对界定合法选举行为的界限提出了挑战,例如,候选人将可能准确的指控视为人工智能生成的,以避免承担责任。

-

选举基础设施威胁:旨在针对负责确保选举过程完整性的系统和个人,目的是操纵选举结果或削弱对选举结果的信心。这包括针对选举官员的 “黑客泄密 ”行动和人工智能生成的钓鱼邮件。

活动的时机、恶意行为者的不同意图以及上述三类活动之间的重叠都会加剧风险。那些试图破坏选举、获取经济利益或影响社区的人适时、协调地组合使用这些技术,会极大地扩大威胁面。因此,这就需要采取协调一致的整体政府方法来建设选举复原力。

最紧迫的是,研究发现,关于在选举期间使用人工智能的模糊选举法目前正在导致滥用。这些法律漏洞可能会被国内外行为者利用。例如,政党可能会利用人工智能使用指南的模糊性破坏选举进程--如编造政界人士的竞选背书(见图 2)。

接下来的一个月对英国监管机构和政府部门来说至关重要,它们要防范在其他国家观察到的人工智能威胁,这可能会影响即将到来的大选。由于英国大选已宣布将于 2024 年 7 月 4 日举行,因此对选举安全保护或选举法进行重大修改的时间非常有限。尽管如此,仍有许多工作可以做,以增强短期内抵御人工智能选举威胁的能力。当务之急是制定新的指导意见,对政党在选举期间公平使用人工智能以及媒体机构报告人工智能事件提出更明确的要求。最近于 5 月举行的英国地方选举也为了解大选前如何使用人工智能威胁提供了一个独特的机会。因此,必须密切分析这些选举的数据,为应急规划提供信息。

图 2:选举期间滥用人工智能系统的行为者和意图多种多样,使应对措施复杂化